Parce que les chatbots « Hallucinano »: la nouvelle analyse d'Openai

Dans une étude récente, les chercheurs d'OpenAI (en collaboration avec Georgia Tech) disent que les modèles linguistiques génèrent de fausses déclarations en toute confiance parce qu'ils sont formés avec des mesures qui récompensent « deviner » plutôt que d'admettre qu'ils ne savent pas. Selon eux, les modèles sont comme des étudiants: ils réagissent toujours, même s'ils sont incertains, car ils obtiennent un score.

Un problème qui résiste aux progrès

Malgré les grands pas en avant de modèles linguistiques tels que GPT-5, les hallucinations restent un défi non résolu. OpenI reconnaît que, malgré la réduction du phénomène dans les versions les plus récentes, les chatbots continuent de générer des déclarations plausibles mais inactées. Il s'agit d'une limite structurelle qui affecte aujourd'hui tous les principaux modèles linguistiques utilisés.

Que sont les hallucinations

«Hallucination» signifie que les informations inventées mais présentées comme vraies. Les exemples abondent: lorsque les chercheurs ont demandé à un chatbot le titre de thèse de doctorat de Adam Tauman Kalai (Co-auteur de l'étude), le système a fourni trois réponses différentes, toutes mal. Interrogé sur sa date de naissance, le modèle a produit trois dates, également incorrectes.

Parce que les modèles préfèrent deviner

Le cœur du problème est le système d'évaluation. Les méthodes actuelles mesurent les performances en fonction du pourcentage de réponses exactes, sans donner de valeur à l'admission de l'incertitude. En fait, comme dans un test à choix multiple, devinez peut apporter des points, tandis que le départ en blanc équivaut à une défaillance garantie.

Cela pousse les modèles pour essayer le sort même lorsqu'ils n'ont pas les informations nécessaires. Sur des milliers de questions, un modèle qui « risqué » semblera plus performant que plus prudent.

Erreurs, bonnes réponses et abstention

Selon OpenAI, les réponses possibles sont divisées en trois catégories: correcte, incorrecte et abstention (« Je ne sais pas »). En réalité, les erreurs sont pires que les abstentions, mais les systèmes d'évaluation actuels traitent du silence comme défaut. C'est là qu'un changement de paradigme est nécessaire.

OpenII souligne que l'abstention fait partie intégrante de l'humilité, l'une des valeurs clés de l'entreprise. Mieux vaut reconnaître les limites que de fournir des informations erronées avec conviction.

La route vers des modèles plus fiables

Pour réduire les hallucinations, OpenAI propose de mettre à jour les mesures d'évaluation, de récompenser l'admission de l'incertitude et de décourager les réponses inventées. C'est une transformation culturelle: des performances basées sur « toujours une opinion » en une approche plus transparente et responsable.

Selon les chercheurs, ce n'est que de cette manière que les chatbots peuvent devenir des outils plus fiables pour les utilisateurs, capables de distinguer certaines connaissances et zones fantômes.

Précision vs erreurs: une fausse dichotomie

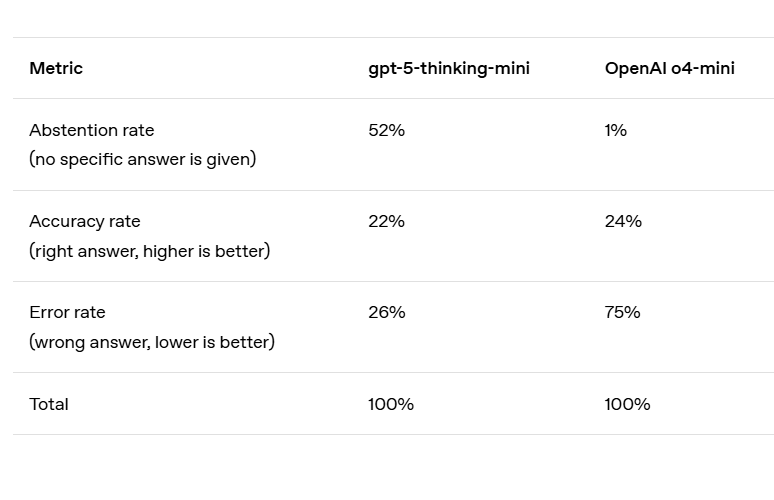

En termes de précision, l'ancien modèle Openai O4-Mini obtient des résultats légèrement meilleurs. Cependant, son taux d'erreur – c'est-à-dire le nombre d'hallucinations – est nettement plus élevé. En d'autres termes, il a deviné stratégiquement lorsque vous n'êtes pas sûr qu'il puisse améliorer le pourcentage de réponses correctes, mais au prix d'un nombre beaucoup plus élevé d'erreurs.

La plupart des évaluations se concentrent exclusivement sur la précision, créant une dichotomie artificielle entre le bien et le mal. Dans des tests simples, tels que SimpleQA, certains modèles atteignent près de 100% des réponses correctes, éliminant efficacement les hallucinations. Mais dans les évaluations les plus complexes – et surtout dans une utilisation réelle – la précision ne peut pas dépasser certains seuils, car il y a des questions sans réponse déterminables: informations manquantes, limites cognitives des modèles ou ambiguïtés plus petits qui nécessitent des clarifications.

Néanmoins, le classement Ils continuent de privilégier la précision. Cela encourage les développeurs à construire des modèles qui «risquent» plutôt que de rédiger, expliquant pourquoi, même avec des modèles plus avancés, les hallucinations persistent: les mauvaises réponses rendent avec trop de sécurité.

Erreurs, bonnes réponses et abstention

Selon OpenAI, les réponses possibles sont divisées en trois catégories:

- correct

- incorrect

- Abstention (« Je ne sais pas »).

En réalité, les erreurs sont pires que les abstentions, mais les systèmes d'évaluation actuels traitent du silence comme défaut. C'est là qu'un changement de paradigme est nécessaire.

OpenII souligne que l'abstention fait partie intégrante de l'humilité, l'une des valeurs clés de l'entreprise. Mieux vaut reconnaître les limites que de fournir des informations erronées avec conviction.

La route vers des modèles plus fiables

Pour réduire les hallucinations, OpenAI propose de mettre à jour les mesures d'évaluation, de récompenser l'admission de l'incertitude et de décourager les réponses inventées. C'est une transformation culturelle: des performances basées sur « toujours une opinion » en une approche plus transparente et responsable.

Selon les chercheurs, ce n'est que de cette manière que les chatbots peuvent devenir des outils plus fiables pour les utilisateurs, capables de distinguer certaines connaissances et zones fantômes.

Solution: repenser les mesures d'évaluation

La clé pour contrer les hallucinations est d'intervenir sur le système d'évaluation, pas simplement d'ajouter de nouveaux tests. OpenII suggère des marques qui pénalisent sévèrement les mauvaises réponses avec confiance et encouragent l'admission de l'incertitude. Dans les blogs et les communications, la société souligne la nécessité de mettre à jour le Évals Sur la base de la précision pour décourager le « Devinettes« .

RAG (Génération augmentée de récupération) peut aider les hallucinations

Le mécanisme du «prix à se livrer» pousse les modèles à toujours répondre, même sans certitude. LiveScience note qu'avec des modèles de plus en plus avancés, les hallucinations peuvent augmenter. Pour les combattre, il suggère: la génération assistée par des sources externes (RAG), des mécanismes de vérification interne et la capacité d'exprimer l'incertitude.

Dans un article de 2024, le journal filaire a observé que les hallucinations sont également nées de la compression des données: les modèles perdent des détails et créent des réponses plausibles mais incorrectes.

Les hallucinations représentent un risque grave, en particulier dans des domaines critiques tels que la médecine, la finance ou le droit. Bien que les éliminer complètement puisse être irréaliste, les modèles qu'ils connaissent lorsqu'ils peuvent devenir plus fiables.

Comment les hallucinations naissent de la prédiction du mot suivant

Avons-nous déjà expliqué pourquoi les hallucinations sont si difficiles à éliminer, mais d'où, en termes concrètes, ces inexactitudes factuelles spécifiques proviennent? Après tout, les grands modèles pré-eés commettent rarement d'autres types d'erreurs, tels que des parenthèses orthographiques ou non fermées. La différence concerne le type de modèles présents dans les données.

Les modèles linguistiques apprennent initialement par la pré-formation, un processus basé sur la prédiction du mot suivant en énormes quantités de textes. Contrairement aux problèmes traditionnels d'apprentissage automatique, il n'y a pas d'étiquettes « vraies / fausses » associées à chaque déclaration ici. Le modèle ne voit que des exemples positifs de langage fluide et doit se rapprocher de la distribution globale.

Il est doublement difficile de distinguer les affirmations valides de celles non valides lorsqu'il n'y a pas d'exemples étiquetés comme mauvais. Mais aussi avec les étiquettes, certaines erreurs sont inévitables. Pour le comprendre, nous considérons une analogie plus simple: dans la reconnaissance des images, si des millions de photos de chats et de chiens sont étiquetées comme «chat» ou «chien», les algorithmes peuvent apprendre à les classer avec fiabilité.

Mais imaginez au lieu d'étiqueter chaque photo de l'animal domestique avec sa date d'anniversaire. Étant donné que les anniversaires sont essentiellement aléatoires, cette tâche produirait toujours des erreurs, quelle que soit la sophistication de l'algorithme.

Le même principe s'applique à la pré-formation: l'orthographe et les parenthèses suivent des schémas réguliers, donc les erreurs dans ces zones ont tendance à disparaître avec l'échelle. Mais des faits arbitraires et rares, comme l'anniversaire d'un animal, ne peuvent être prédits que par des modèles dans les données et finissent donc par générer des hallucinations. L'analyse explique quels types d'hallucinations devraient découler de la prédiction du mot suivant. Idéalement, les phases suivant la formation devraient les éliminer, mais ce processus n'est pas entièrement efficace pour les raisons déjà discutées dans la section précédente.

Conclusions

Voici quelques arguments présentés dans l'article d'Openai qui clarifient la nature des hallucinations et aident à corriger certains malentendus courants:

Affirmation: pour mesurer les hallucinations, juste un bon test dédié est suffisant.

Résultat: Il existe déjà des tests d'évaluation des hallucinations. Cependant, ils ont peu d'effet lorsqu'ils entrent en collision avec des centaines de mesures traditionnelles basées uniquement sur la précision, qui pénalisent l'humilité et récompensent le danger. Au lieu de cela, toutes les principales mesures d'évaluation doivent être repensées pour récompenser l'expression de l'incertitude.

Affirmation: Les hallucinations disparaîtront en améliorant la précision, car un modèle avec 100% pas de précision hallucinum.

Résultat: La précision n'atteindra jamais à 100%, car certaines questions réelles sont intrinsèquement impossibles à répondre, quelle que soit la taille du modèle, de la recherche ou de la capacité de raisonnement.

Affirmation: Les hallucinations sont inévitables.

Résultat: ils ne le sont pas, car les modèles linguistiques peuvent s'abstenir lorsqu'ils sont incertains.

Affirmation: éviter les hallucinations nécessite un niveau d'intelligence accessible uniquement avec des modèles plus grands.

Résultat: il peut être plus facile pour un petit modèle de connaître vos limites. Par exemple, si vous lui demandez de répondre à une question en Maoris, un modèle qui ne connaît pas du tout la langue peut simplement dire « je ne sais pas », alors qu'un modèle qui ne connaît qu'un petit maori doit estimer son propre degré de sécurité. Comme discuté dans l'article, être «calibré» nécessite beaucoup moins de puissance de calcul que d'être précis.

Affirmation: Les hallucinations sont un mystérieux problème de modèles linguistiques modernes.

Résultat: Nous comprenons les mécanismes statistiques par lesquels les hallucinations émergent et sont même récompensées dans les évaluations.