Outil pour la formation sans formation, l'édition vidéo en temps réel et la séparation des arrière-plans développée

L'Université Bar-Ilan a annoncé aujourd'hui qu'une équipe de son département d'informatique a développé une percée dans le traitement vidéo qui simplifie considérablement la séparation des objets de premier plan de leurs antécédents, sans avoir besoin d'une formation ou d'une optimisation approfondie. La nouvelle méthode, appelée Omnimatzero, a été développée par le Dr Dvir Samuel et le professeur Gal Chechik, qui est également directeur principal de la recherche sur l'IA à NVIDIA. Le document est publié sur le arxiv serveur de préimprimée.

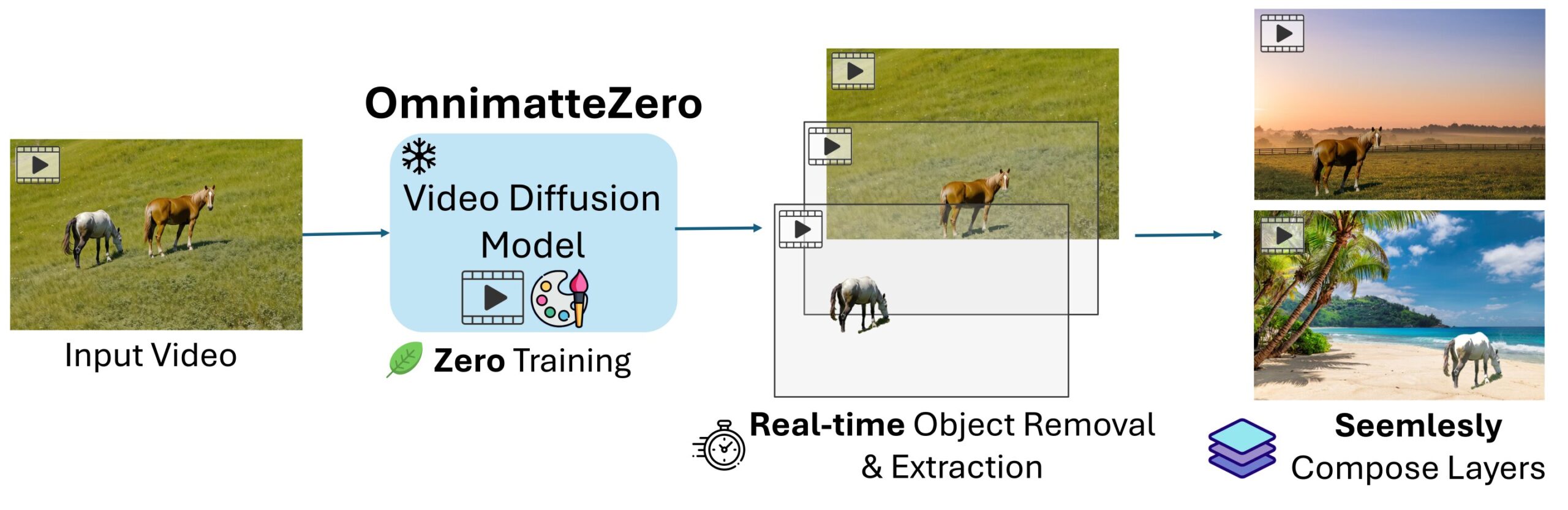

Récemment présenté à la conférence Siggraph Asia, la recherche traite de l'extraction d'objets ou de figures de leurs antécédents tout en préservant des éléments complexes tels que la fourrure, les cheveux, le feuillage, les ombres, les réflexions, la fumée ou l'ondulation de l'eau. Les méthodes actuelles de séparation des couches vidéo reposent sur des modèles d'intelligence artificielle qui doivent être formés à l'aide de millions d'exemples étiquetés ou de fortes méthodes d'optimisation, qui sont toutes deux à forte intensité de ressources et qui prennent du temps. Les recherches de l'équipe de Bar-ilan démontrent que des résultats équivalents peuvent être obtenus avec des efforts, un calcul et un coût considérablement réduits.

« Dans les systèmes de décomposition vidéo, l'algorithme doit identifier les effets qu'un objet impose sur la scène, puis le supprimer ou l'extraire d'une manière qui semble naturelle », a expliqué le Dr Dvir Samuel, qui a dirigé cette recherche en tant que doctorant sous la supervision du professeur Chechik.

« Jusqu'à présent, chaque méthode nécessitait des millions d'exemples pour former un modèle d'apprentissage, ainsi qu'une très grande puissance de calcul et une énergie. Même une fois que le modèle a été entièrement formé et prêt à l'emploi, le faire fonctionner pour atteindre le résultat souhaité pourrait encore prendre plusieurs minutes pendant quelques secondes de vidéo. »

L'approche fonctionne comme un « système de compostage visuel » qui permet le recyclage de contenu. Par exemple, un cygne dans un lac peut être extrait complet avec sa réflexion et placé de manière transparente dans une autre piscine, tandis que le lac lui-même, moins le cygne, peut être réutilisé comme arrière-plan pour une autre scène avec des résultats d'aspect naturel, notamment des réflexions cohérentes, des ombres et des mouvements.

Contrairement aux méthodes existantes, OmnimatTezero évite l'apprentissage supervisé ou l'optimisation auto-supervisée. Au lieu de cela, il exploite les techniques d'achat d'image traditionnellement appliquées aux images statiques, améliorées avec des modules qui suivent les changements à travers le temps et l'espace pour maintenir la cohérence de l'arrière-plan reconstruit. Les chercheurs ont démontré que les objets et leurs traces peuvent être identifiés sans s'entraîner grâce à un mécanisme d'auto-agence intégré qui relie les régions entre les cadres vidéo et dans les cadres vidéo.

Les recherches de l'équipe démontrent que les modèles dédiés ne sont pas nécessaires pour les tâches de séparation des calques vidéo, et la puissance de calcul exceptionnellement élevée n'est pas requise. La méthode ne nécessite qu'un modèle de génération de vidéo existant (comme WAN ou VEO3) appliqué à cette tâche spécifique. L'étude montre comment les modèles de génération vidéo actuels peuvent être utilisés pour détecter les effets créés par des objets et supprimer, extraire et réinsérer ces objets et leurs effets dans d'autres vidéos en temps réel, éliminant l'attente typique de traitement de plusieurs minutes.

L'approche cible les éditeurs vidéo et les concepteurs, les créateurs de contenu, les annonceurs et les chercheurs en IA. La preuve de faisabilité de l'étude suggère une accessibilité future potentielle à usage quotidien, y compris l'édition de vidéos enregistrées sur les smartphones. Plusieurs équipes universitaires du monde entier s'efforcent actuellement d'améliorer Omnimattezero.

La prochaine direction de recherche du Dr Samuel abordera la synchronisation solide. « Par exemple, s'il y a un chien qui aboie dans la vidéo et que nous retirons le chien, nous ne voulons pas continuer à entendre les aboiements en arrière-plan qui reste sans lui », a-t-il expliqué.

Le projet a été réalisé en collaboration avec des chercheurs de l'Université hébraïque et du Centre de recherche Originai, Israël.