Orientez les politiques vers le matériel pour garantir la sécurité de l’IA, disent les experts

Un registre mondial retraçant le flux de puces destinées aux supercalculateurs d’IA est l’une des options politiques mises en avant par un nouveau rapport majeur appelant à une réglementation du « calcul » – le matériel qui sous-tend toute l’IA – pour aider à prévenir les abus et les catastrophes de l’intelligence artificielle.

D’autres propositions techniques avancées par le rapport incluent des « plafonds de calcul » (limites intégrées au nombre de puces auxquelles chaque puce d’IA peut se connecter) et la distribution d’un « commutateur de démarrage » pour la formation en IA entre plusieurs parties afin de permettre un veto numérique sur les projets à risque. L’IA avant de se nourrir de données.

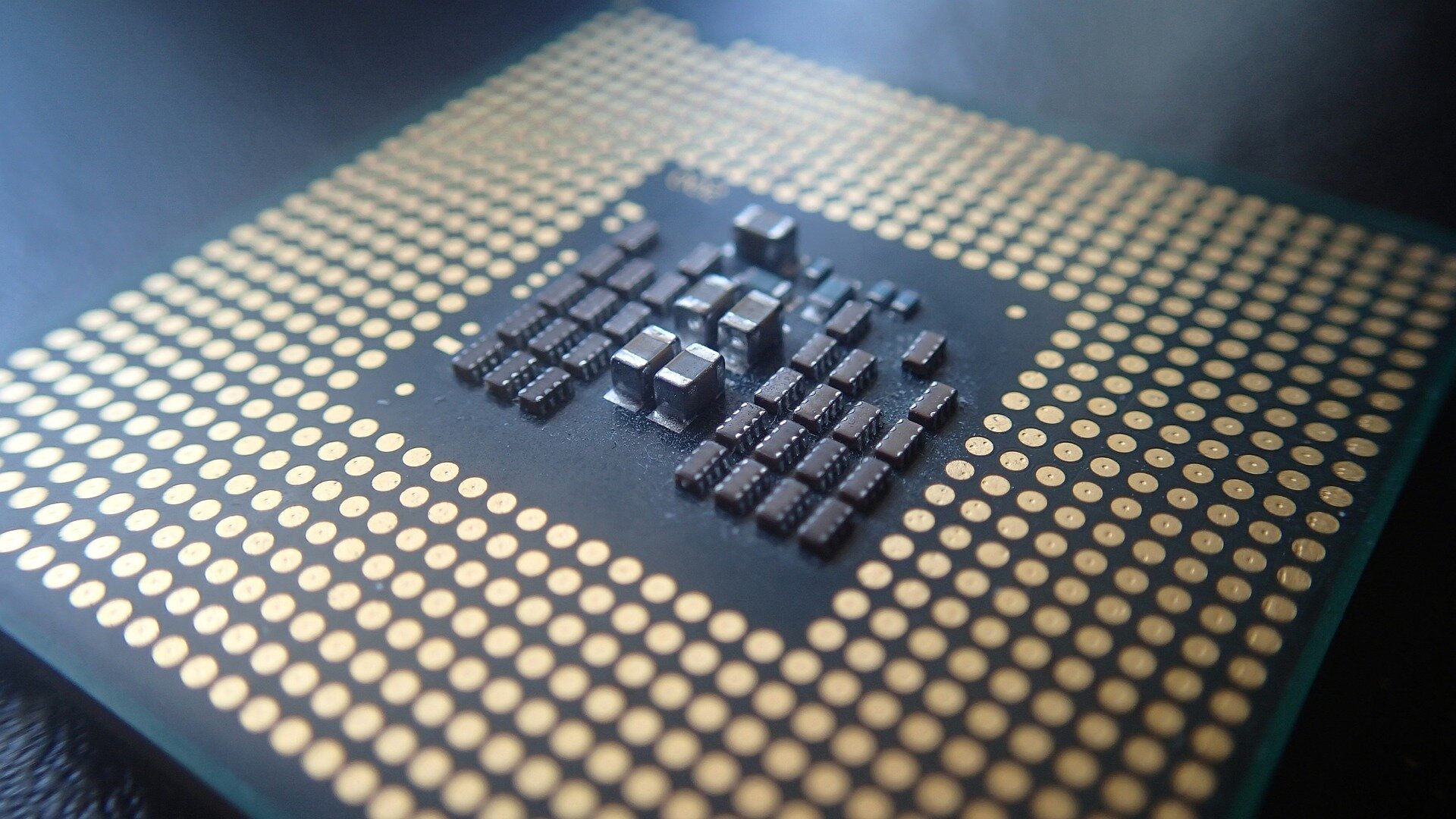

Les chercheurs affirment que les puces IA et les centres de données constituent des cibles plus efficaces pour le contrôle et la gouvernance de la sécurité de l’IA, dans la mesure où ces actifs doivent être physiquement possédés, alors que les autres éléments de la « triade IA » – données et algorithmes – peuvent, en théorie, être dupliqués à l’infini. et diffusé.

Les experts soulignent que les puces informatiques puissantes nécessaires au pilotage des modèles d’IA génératives sont construites via des chaînes d’approvisionnement très concentrées, dominées par une poignée d’entreprises seulement, ce qui fait du matériel lui-même un point d’intervention important pour les politiques d’IA réduisant les risques.

Le rapport est rédigé par dix-neuf experts et co-dirigé par trois instituts de l’Université de Cambridge – le Leverhulme Center for the Future of Intelligence (LCFI), le Center for the Study of Existential Risk (CSER) et le Bennett Institute for Public Policy – ainsi que avec OpenAI et le Centre pour la gouvernance de l’IA.

« L’intelligence artificielle a fait des progrès surprenants au cours de la dernière décennie, en grande partie grâce à la forte augmentation de la puissance de calcul appliquée aux algorithmes de formation », a déclaré Haydn Belfield, co-auteur principal du rapport du LCFI de Cambridge.

« Les gouvernements s’inquiètent à juste titre des conséquences potentielles de l’IA et cherchent à réglementer cette technologie, mais les données et les algorithmes sont intangibles et difficiles à contrôler.

« Les supercalculateurs d’IA sont constitués de dizaines de milliers de puces d’IA en réseau, hébergées dans des centres de données géants, souvent de la taille de plusieurs terrains de football, consommant des dizaines de mégawatts d’énergie », a déclaré Belfield.

« Le matériel informatique est visible, quantifiable, et sa nature physique signifie que des restrictions peuvent être imposées d’une manière qui pourrait bientôt devenir presque impossible avec davantage d’éléments virtuels de l’IA. »

La puissance de calcul derrière l’IA a augmenté de façon exponentielle depuis le début de « l’ère de l’apprentissage profond », la quantité de « calcul » utilisée pour former les plus grands modèles d’IA doublant environ tous les six mois depuis 2010. Les plus grands modèles d’IA en utilisent désormais 350 millions. fois plus de calcul qu’il y a treize ans.

Les efforts des gouvernements du monde entier au cours de l’année écoulée, notamment le décret américain sur l’IA, la loi européenne sur l’IA, la réglementation chinoise sur l’IA générative et l’IA Safety Institute du Royaume-Uni, ont commencé à se concentrer sur le calcul lorsqu’ils envisagent la gouvernance de l’IA.

En dehors de la Chine, le marché du cloud computing est dominé par trois sociétés, appelées « hyperscalers » : Amazon, Microsoft et Google.

« La surveillance du matériel aiderait grandement les autorités de la concurrence à contrôler le pouvoir de marché des plus grandes entreprises technologiques, ouvrant ainsi la voie à davantage d’innovation et à de nouveaux entrants », a déclaré la co-auteure, le professeur Diane Coyle du Bennett Institute de Cambridge.

Le rapport fournit des « esquisses » d’orientations possibles en matière de gouvernance informatique, soulignant l’analogie entre la formation à l’IA et l’enrichissement de l’uranium.

« La réglementation internationale des fournitures nucléaires se concentre sur un intrant vital qui doit passer par un processus long, difficile et coûteux », a déclaré Belfield. « Se concentrer sur le calcul permettrait à la réglementation de l’IA de faire de même. »

Les idées politiques sont divisées en trois camps : accroître la visibilité mondiale de l’informatique IA ; allouer les ressources informatiques pour le plus grand bénéfice de la société ; appliquer des restrictions sur la puissance de calcul.

Par exemple, un registre international de puces d’IA régulièrement audité exigeant que les producteurs, vendeurs et revendeurs de puces déclarent tous les transferts fournirait des informations précises sur la quantité de calcul possédée par les nations et les entreprises à tout moment.

Le rapport suggère même qu’un identifiant unique pourrait être ajouté à chaque puce pour empêcher l’espionnage industriel et la « contrebande de puces ».

« Les gouvernements suivent déjà de nombreuses transactions économiques, il est donc logique d’accroître la surveillance d’un produit aussi rare et puissant qu’une puce d’IA avancée », a déclaré Belfield. Cependant, l’équipe souligne que de telles approches pourraient conduire à un marché noir de « puces fantômes » introuvables.

D’autres suggestions pour accroître la visibilité – et la responsabilité – incluent le reporting des formations à l’IA à grande échelle par les fournisseurs de cloud computing et la « surveillance de la charge de travail » préservant la confidentialité pour aider à prévenir une course aux armements si des investissements informatiques massifs sont réalisés sans suffisamment de transparence.

« Les utilisateurs de l’informatique s’engageront dans un mélange d’activités bénéfiques, bénignes et nuisibles, et des groupes déterminés trouveront des moyens de contourner les restrictions », a déclaré Belfield.

« Les régulateurs devront créer des freins et contrepoids qui contrecarreront les utilisations malveillantes ou malavisées de l’informatique IA. »

Celles-ci peuvent inclure des limites physiques sur la mise en réseau puce à puce ou une technologie cryptographique permettant la désactivation à distance des puces IA dans des circonstances extrêmes.

Une approche suggérée nécessiterait le consentement de plusieurs parties pour débloquer le calcul de l’IA pour des entraînements particulièrement risqués, un mécanisme familier avec les armes nucléaires.

Les politiques d’atténuation des risques liées à l’IA pourraient donner la priorité au calcul pour la recherche la plus susceptible de bénéficier à la société, de l’énergie verte à la santé et à l’éducation. Cela pourrait même prendre la forme de grands « mégaprojets » internationaux d’IA qui s’attaqueraient à des problèmes mondiaux en mettant en commun les ressources de calcul.

Les auteurs du rapport sont clairs sur le fait que leurs suggestions politiques sont « exploratoires » plutôt que des propositions à part entière et qu’elles comportent toutes des inconvénients potentiels, allant des risques de fuites de données exclusives aux impacts économiques négatifs et à l’entrave au développement positif de l’IA.

Ils proposent cinq considérations pour réglementer l’IA par le calcul, notamment l’exclusion de l’informatique à petite échelle et sans IA, la révision régulière des seuils de calcul et l’accent mis sur la préservation de la vie privée.

Belfield a ajouté : « Essayer de gouverner les modèles d’IA au fur et à mesure de leur déploiement pourrait s’avérer futile, comme chasser les ombres. Ceux qui cherchent à établir une réglementation de l’IA devraient regarder en amont vers le calcul, la source du pouvoir qui alimente la révolution de l’IA.

« Si le calcul reste non gouverné, cela présente de graves risques pour la société. »