OpenClaw est l’une des IA les plus fascinantes et « dangereuses » du moment. Une entreprise de Malaga est venue à la rescousse

En 2025, nous avons eu un « moment DeepSeek » et en 2026, nous vivons un « moment OpenClaw ». Cet agent IA est super puissant, mais aussi très peu sécurisé. Il y a cependant une bonne nouvelle, car la société de Malaga VirusTotal s'est associée au projet OpenClaw pour tenter d'atténuer l'un des risques de cybersécurité les plus importants de cet agent d'IA : ses compétences.

Que s'est-il passé ? OpenClaw (anciennement Moltbot, et avant Clawdbot) a annoncé avoir entamé une collaboration avec la société de cybersécurité de Malaga VirusTotal, propriété de Google. L'accord verra VirusTotal se charger du « scan » et de l'analyse des soi-disant « compétences », qui fonctionnent comme les plugins OpenClaw et ajoutent toutes sortes de fonctions. Ils le font, bien sûr, mais beaucoup en profitent pour introduire des instructions malveillantes qui leur permettent de voler des données et de faire fonctionner à distance les agents d'IA d'autres personnes.

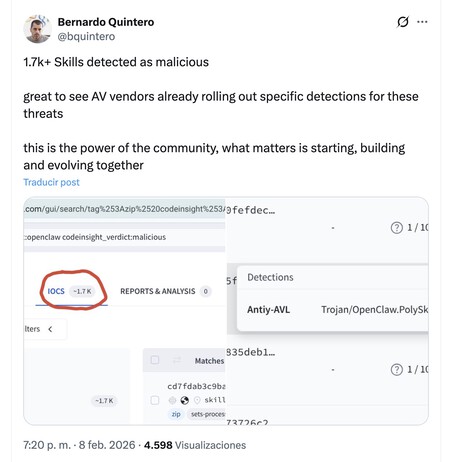

Plus de sécurité pour l'IA perturbatrice. Peter Steinberger, créateur du projet, s'est joint à Jamieson O'Reilly, expert en cybersécurité et fondateur de la société Dvuln, et à Bernardo Quintero, fondateur de VirusTotal, pour offrir cette « couche de sécurité supplémentaire à la communauté OpenClaw ». Dans l'annonce officielle, ils expliquent que « toutes les compétences publiées sur ClawdHub (le « magasin » officiel des compétences du projet) sont désormais analysées via le système Threat Intelligence de Virus Total, y compris sa nouvelle fonctionnalité Code Insight. » Bernardo Quintero a indiqué sur Twitter que cet effort a déjà permis d'identifier 1 700 compétences comme malveillantes.

Si la compétence est malveillante, elle est bloquée. Cette analyse réalisée avec les outils VirusTotal permet d'identifier les compétences comme malveillantes et de les bloquer immédiatement afin qu'elles ne puissent pas être téléchargées. Et ce n'est pas tout : les compétences classées comme bénignes sont analysées à nouveau chaque jour pour détecter des scénarios dans lesquels, pour une raison quelconque, elles pourraient finir par devenir malveillantes.

Soyez quand même prudent. Les responsables d'OpenClaw préviennent : l'analyse VirusTotal aide beaucoup, mais ce n'est pas une garantie totale qu'une compétence puisse effectuer des actions malveillantes sur la machine sur laquelle notre agent IA est installé. Des attaques sophistiquées peuvent parvenir à franchir cette barrière, mais bien sûr cette collaboration signifie que les utilisateurs d'OpenClaw peuvent être beaucoup plus sereins quant aux compétences disponibles dans le référentiel ClawdHub.

OpenClaw veut être beaucoup plus sécurisé. Ce premier effort rejoint l'ambition d'OpenClaw de disposer d'un modèle de cybersécurité complet comprenant des éléments tels qu'une feuille de route publique pour ses innovations dans ce domaine, un processus de communication formel et des détails sur des audits complets de son code.

Corriger un problème qui pourrait tuer OpenClaw. Le projet OpenClaw est rapidement devenu viral en raison de ses options flashy, mais peu de temps après, un premier audit de sécurité de 2 851 compétences a détecté 341 compétences malveillantes. Des entreprises comme BitDefender ont également rejoint ces efforts pour éviter les problèmes avec des outils comme AI Skills Checker pour vérifier si une compétence était dangereuse ou non. Ces compétences malveillantes étaient, par exemple, capables d'exécuter des commandes shell sur la machine victime, ce qui donnait à l'attaquant un contrôle total sur ces ressources.

Attaquer la machine, c’est la confondre avec le langage naturel. Normalement, les attaques de cybersécurité sont complexes, mais le problème avec les agents IA est qu’ils fonctionnent en langage naturel. Cela implique que pour infiltrer ces systèmes, il n'est pas nécessaire d'utiliser du code, mais simplement de « convaincre » et de « tromper » l'IA avec le langage naturel. C’est là qu’interviennent les attaques par injection rapide, qui consistent à donner des instructions aux agents d’IA qui peuvent les confondre pour obtenir quelque chose qu’ils ne devraient théoriquement pas leur permettre d’obtenir. Données personnelles, clés API des modèles que nous utilisons chez OpenClaw, comptes de messagerie et mots de passe pour tous types de services… les possibilités sont infinies, et OpenClaw, qui a accès à tout cela pour fonctionner de manière autonome, peut finir par se faire « piéger » en transférant lesdites données.

Méfiez-vous d'OpenClaw. Ces problèmes semblent désormais un peu moins réalisables grâce à la collaboration avec VirusTotal, mais ceux qui essaient OpenClaw sur leurs machines ou sur toute autre plateforme devraient être très vigilants dès le début. Il existe des guides qui vous aident à l'installer avec certaines barrières de sécurité importantes, et le projet lui-même dispose d'une commande (« openclaw security audit –deep –fix » pour auditer les problèmes les plus importants et les résoudre.

À Simseo | OpenAI a un problème : Anthropic réussit là où le plus d'argent est en jeu