Openai a pris tout ce qu’il voulait sur Internet pour former son IA. Accuse maintenant Depseek de voler ses données

Les modèles de DePseek sont vraiment bons. Il est démontré par les tests comparatifs que nous publions hier et qui l’ont mis au niveau de Chatgpt, Claude ou Gemini. Cela a déclenché des louanges, mais aussi des soupçons. Il y a des gens qui ne croient pas que la formation de Depseek n’a coûté que 5,6 millions de dollars, mais maintenant à Openai accuse Depseek de quelque chose d’autre.

Deepseek, vous utilisez nos données sans autorisation. Les porte-parole d’OpenAI ont indiqué que les temps financiers ont découvert des preuves que les techniques de « distillat » des modèles OpenAI utilisées par Deepseek ont été utilisées.

Qu’est-ce que cela est « distillé » dans l’IA? Hier, nous parlons de la façon dont les développeurs Depseek ont utilisé un grand nombre de techniques pour atteindre un modèle aussi efficace. Parmi eux se démarque de l’apprentissage du renforcement, mais il est également connu qu’ils utilisent des modèles distillat. Dans cette technique, un plus petit « modèle d’étudiant » apprend à se comporter comme un « modèle de professeur » plus grand et plus avancé. Les données du «modèle enseignant» sont utilisées afin que le petit modèle soit plus rapide et plus efficace, mais tout aussi intelligent dans des tâches spécifiques.

Utiliser non autorisé. Le distillat ou la distillation des modèles est une pratique courante dans l’industrie, mais les termes du service OpenAI interdisent que leurs modèles soient utilisés à cette fin. Ainsi, il est spécifié que les utilisateurs ne peuvent pas « copier » aucun de leurs services ou « utiliser la sortie (des modèles OpenAI) pour développer des modèles qui rivalisent avec OpenAI ».

Openai et Microsoft ont déjà étudié cela. Selon Bloomberg, les deux sociétés ont analysé les comptes passés qui étaient utilisés pour profiter de leurs chatbots et qui appartenaient apparemment aux développeurs Deepseek. Ils ont utilisé l’API d’Openai, mais on soupçonne qu’ils avaient violé les conditions d’utilisation en profitant de cet accès pour faire le distillat de leurs modèles.

Beaucoup font. David Sacks, responsable de l’IA dans l’équipe de Donald Trump, l’a alerté de ce qui se passait et a déclaré qu’il y avait des preuves que DePseek avait utilisé des données Openai. Les porte-parole de la société dirigée par Sam Altman ont indiqué que « nous savons que les entreprises de la République populaire de Chine – et d’autres – essaient constamment de distiller les modèles des principales entreprises en IA aux États-Unis ».

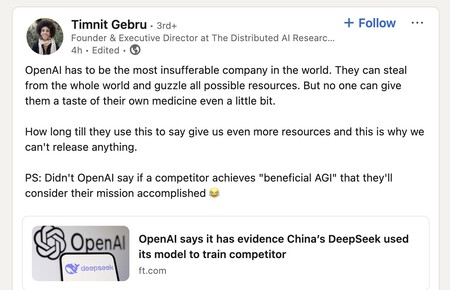

Le voleur est cru que tout le monde est de son état. L’ironie ici est qu’Openai n’a pas eu de scrupules lors de la collecte de données Internet pour former leurs modèles, violant également les conditions d’utilisation de ces plateformes. L’année dernière, il a été découvert par exemple comment il a transcrit un million d’heures YouTube pour former le GPT-4. Timnit Gebru, célèbre pour son licenciement controversé de Google, a commenté LinkedIn qu’Openai « devait être l’entreprise la plus insupportable du monde ». Et il a poursuivi: « Ils peuvent voler le monde entier et avaler toutes les ressources possibles. Mais personne ne peut leur donner leur propre médicament et même pas un peu. »

Si vous êtes sur Internet, il peut être utilisé, non? D’autres entreprises font exactement la même chose et sont protégés dans l’argument de «l’utilisation équitable». Ils collectent un contenu public sur Internet sans demander la permission des utilisateurs ou des plateformes. Non seulement cela: il est soupçonné que dans de nombreux cas, ces modèles sont formés avec des œuvres protégées par le droit d’auteur, ce qui a donné lieu à de nombreuses demandes.

Image | TechCrunch

Dans Simseo | La prochaine phase de l’IA n’est pas de voir qui investit plus mais qui investit moins