Nous pensions qu'aucun modèle ouvert ne pouvait surpasser GPT-5. Une startup chinoise nous prouve le contraire

Une startup chinoise appelée Moonshot vient de lancer Kimi K2 Thinking, un gigantesque modèle ouvert avec mille milliards de paramètres qui a réalisé quelque chose qui semblait presque impossible : surpasser les meilleurs modèles propriétaires d'entreprises comme OpenAI, Google ou Anthropic. Si nous pensions que les modèles « Open Source » ne pourraient jamais rivaliser avec GPT-5, Gemini 2.5 Pro ou Claude, nous nous trompions.

Que s'est-il passé ? Ce « laboratoire d'IA » avait déjà annoncé Kimi K2 en juillet avec cette taille gigantesque de mille milliards de paramètres, mais ils ont maintenant lancé la version « Thinking » avec cette même taille (32 milliards de paramètres actifs, architecture Mixture of Experts). Selon les responsables, le modèle est capable de maintenir une utilisation stable des outils agentiques sur entre 200 et 300 appels séquentiels. Ou ce qui revient au même : il peut enchaîner de longues séquences d’actions de manière autonome et apparemment sans erreur. Le meilleur de tout n'est pas ça : c'est qu'il surpasse GPT-5 ou Claude Sonnet 4.5 dans divers tests et coûte bien moins cher que ces modèles.

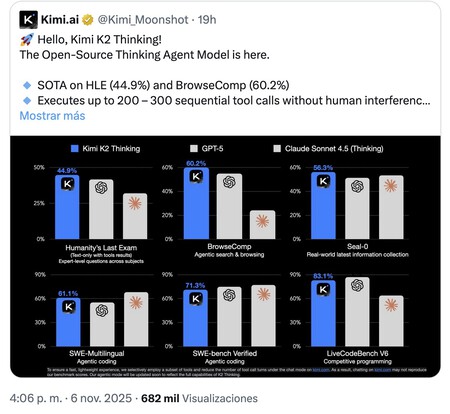

Les repères. Les responsables de Moonshot ont expliqué comment Kimi K2 Thinking obtient les scores les plus élevés au Humanity's Last Exam (connaissances générales, 44,9 %) et à BrowserComp (navigateurs d'agents, 60,2 %). Il est presque au niveau de Claude dans le test de développement logiciel SWE, et est également presque le meilleur dans un autre de ces benchmarks, LiveCodeBench v6. Il est vrai que dans certains tests, il est encore légèrement en retard par rapport à ses rivaux « occidentaux », mais la réussite est spectaculaire.

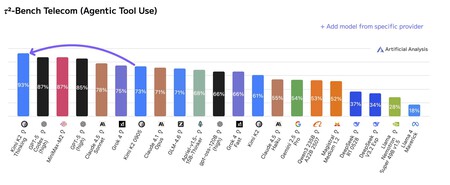

Plus de repères. Les responsables de l'analyse artificielle ont montré leurs premières conclusions après l'avoir évaluée avec divers tests. Ainsi, ils mettent en évidence son comportement dans des tâches agentiques qui simulent que le modèle agit en tant qu'agent du service client. Dans ce test, il a obtenu 93 % du maximum, surpassant de loin tous ses concurrents (GPT-5 Codex High a obtenu 87 %, par exemple). Ils feront d’autres tests, mais pour l’instant les perspectives sont fantastiques.

Et en plus, pas cher. CNBC indique que la formation du modèle a coûté 4,6 millions de dollars, un chiffre ridicule si l'on considère que la formation de modèles propriétaires comme GPT-5 coûte environ 500 millions de dollars selon les estimations. L'utilisation de l'API Kimi K2 Thinking est également très abordable : 0,6 $ par million de jetons entrants et 2,5 $ par million de jetons sortants. GPT-5 Chat coûte respectivement 1,25 $/10, tandis que Claude Sonnet 4.5 coûte respectivement 3/15 $.

Les détails. Le modèle utilise une quantification INT4 pour améliorer son efficacité sans compromettre la précision et la qualité de ses réponses. Sa fenêtre contextuelle – la « taille » des données que nous pouvons saisir lors de la création d’invites – est de 256 Ko, un chiffre relativement modeste pour les grands modèles mais néanmoins remarquable. Et comme c'est un bon modèle ouvert, nous pouvons le télécharger pour l'utiliser localement… si nous avons un vrai monstre à notre disposition. Le modèle pèse 594 Go, et par exemple en réunissant deux Mac Studio M3 Ultra il est possible de le faire fonctionner localement de manière relativement fluide à environ 15 t/s.

Alibaba est derrière. Bien que le modèle soit développé par une startup indépendante appelée Moonshot, cette société a été soutenue financièrement par Alibaba, qui est en train de devenir une puissance absolue dans ce domaine. Elle ne se contente plus de développer ses propres modèles, qui sont remarquables (Qwen en est un parfait exemple), mais finance également le développement d'autres modèles comme Kimi K2/Thinking.

La Chine et son amour pour les modèles d’IA ouverts. Au cours des derniers mois, nous avons vu à quel point la Chine dominait dans le domaine des modèles d'IA ouverts – et non « Open Source » -. Le géant asiatique a adopté une philosophie écrasante avec des modèles de plus en plus performants mais qui semblait jusqu'à présent plusieurs longueurs de retard sur les grands modèles propriétaires d'OpenAI, Anthropic ou Google. Ce n'est plus le cas.

La course est animée. Cette réalisation représente un nouveau vote de confiance pour les modèles ouverts provenant des entreprises chinoises. Il est vrai qu’ils sont énormes et que cela rend très difficile leur utilisation pratique par les utilisateurs finaux, mais ils présentent une alternative intéressante pour les entreprises.

Images | Idnaklss avec Midjourney

À Simseo | Il existe de nombreuses races « internes » au sein de la grande race de l’IA. Et Alibaba gagne l'Open Source