Microsoft soutient Anthropic dans la bataille juridique avec le Pentagone

Le géant du logiciel Microsoft a décidé de soutenir le procès intenté par la start-up d'intelligence artificielle Anthropic contre le Pentagone, avertissant que les mesures prises contre l'entreprise pourraient avoir de « larges répercussions négatives » sur l'ensemble du secteur technologique américain.

Dans un dossier judiciaire du 10 mars 2026, Microsoft a demandé une ordonnance d'interdiction temporaire suspendant la décision du ministère de la Défense de classer Anthropic comme risque de chaîne d'approvisionnement pendant que le tribunal examine l'appel de l'entreprise.

C'est le premier grand groupe technologique à prendre ouvertement position dans le conflit qui oppose Anthropic et le Pentagone sur les règles régissant l'utilisation militaire de ses modèles d'intelligence artificielle.

Anthropic et Pentagone : une fracture dans la Silicon Valley

L'affrontement a créé des divisions dans la Silicon Valley, qui évitait jusqu'à récemment de critiquer ouvertement l'administration du président Donald Trump, de retour à la Maison Blanche.

Selon Microsoft, bloquer temporairement la décision du Pentagone permettrait de gagner du temps pour un accord négocié et une « discussion raisonnée » sur l'utilisation de l'intelligence artificielle dans les opérations militaires et de renseignement.

La question des armes autonomes et de la surveillance

Les négociations entre Anthropic et le ministère de la Défense ont échoué à la fin du mois dernier, lorsque la start-up – évaluée à environ 380 milliards de dollars – a rejeté un contrat pour l'utilisation militaire de sa technologie.

Le PDG Dario Amodei a fixé certaines « lignes rouges », notamment l'interdiction d'utiliser les systèmes de l'entreprise pour des armes mortelles autonomes ou pour la surveillance de masse des citoyens américains.

Ensuite, le secrétaire à la Défense Pete Hegseth a initié l'exclusion d'Anthropic de la chaîne d'approvisionnement du Pentagone, une mesure habituellement réservée aux entreprises de pays rivaux comme la Chine ou la Russie.

Dans le même temps, l’administration a demandé à toutes les agences fédérales de cesser d’utiliser le chatbot Claude, dans le cadre d’une campagne contre ce qu’elle appelle «L'IA s'est réveillée».

La position de Microsoft sur l'intelligence artificielle

Microsoft a déclaré que l'IA ne devrait être utilisée que dans des contextes légaux et correctement supervisés.

Selon l’entreprise, l’IA ne devrait pas être utilisée à des fins de surveillance de masse nationale ou pour mettre le pays dans une position où des machines autonomes peuvent déclencher une guerre sans contrôle humain.

Le groupe basé à Seattle, qui détient d'importants contrats militaires, a également averti qu'un arrêt soudain de la collaboration avec Anthropic pourrait entraver les capacités opérationnelles de l'armée américaine à un moment critique.

Le rôle croissant de l’IA dans les systèmes militaires

Claude est actuellement le seul outil d’IA utilisé dans des contextes militaires classifiés, même si OpenAI a récemment signé un accord avec le Pentagone.

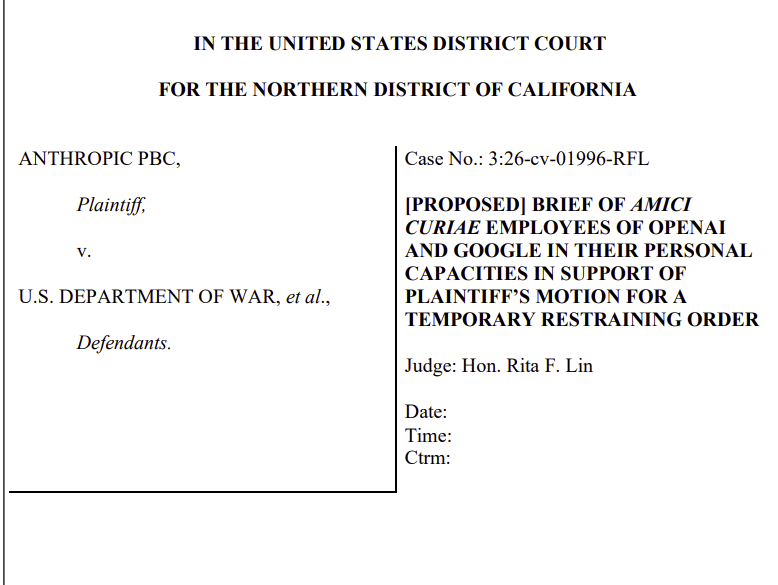

Microsoft n'est pas défendeur dans le procès mais a déposé une plainte mémoire d'amicus devant les tribunaux de Californie et du District de Columbia pour soutenir la position de la start-up.

Pour renforcer le front en faveur d'Anthropic, une lettre signée par plus de 30 chercheurs de Google et d'OpenAI, dont le scientifique en chef de Google DeepMind, Jeff Dean, est également arrivée.

Relations technologiques et intérêts stratégiques

Bien qu'il détienne 27 % d'OpenAI, Microsoft a développé des relations étroites avec Anthropic ces dernières années, en signant un accord de 30 milliards de dollars pour des services de cloud computing en novembre.

Cette semaine encore, la société a annoncé l'intégration des modèles de programmation d'Anthropic dans son logiciel d'entreprise, également largement utilisé par le gouvernement fédéral américain.

Google, Amazon et Microsoft avaient déjà déclaré que leurs services juridiques pensaient qu'il était possible de continuer à utiliser la technologie d'Anthropic pour des activités non militaires.

Peur pour l'écosystème de l'IA

Selon Microsoft, la désignation d'Anthropic comme risque pour la chaîne d'approvisionnement oblige les entrepreneurs gouvernementaux à suivre des directives vagues et mal définies, jamais appliquées auparavant à une entreprise américaine.

« Ce n’est pas le moment de mettre en péril l’écosystème de l’intelligence artificielle que l’administration elle-même a contribué à promouvoir », a conclu l’entreprise.