Lorsqu'ils nous ont vendu une « intelligence artificielle » générative, nous savions qu'elle serait artificielle et générative mais pas « intelligente ».

Il y a quelques mois, un groupe de chercheurs espagnols a pensé à tester un chatbot IA avec un curieux test. Ils ont téléchargé une image d’une horloge analogique sur le chatbot et ont demandé à l’IA un simple « Quelle heure est-il sur cette horloge ? L’IA a échoué de manière inquiétante.

Machine, peux-tu me dire l'heure ? Des chercheurs de l'Université Polytechnique de Madrid, de l'Université de Valladolid et du Politecnico de Milano ont signé il y a un mois une étude dans laquelle ils voulaient évaluer l'intelligence artificielle de ces modèles. Pour ce faire, ils ont construit un large ensemble d’images synthétiques de montres analogiques, disponibles sur Hugging Face, dans lesquelles 43 000 heures différentes étaient affichées.

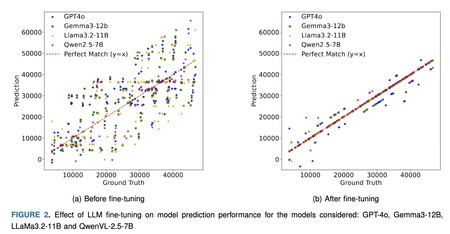

Avant d’affiner leur comportement, les modèles d’IA échouaient systématiquement lorsqu’ils essayaient de donner l’heure. Après ajustement, le comportement était bien meilleur, mais toujours imparfait. Cela ne devrait pas arriver avec un problème aussi « simple » pour les humains.

Résultat désastreux. À partir de là, ils ont demandé à quatre modèles d’IA génératifs quelle heure affichaient ces images de ces horloges analogiques. Aucun d’entre eux n’a réussi à donner l’heure avec précision. Ce groupe de modèles était composé de GPT-4o, Gemma3-12B, LlaMa3.2-11B et QwenVL-2.5-7B, et tous avaient de sérieux problèmes pour « lire » l'heure et différencier, par exemple, les aiguilles ou l'angle et la direction de ces aiguilles par rapport aux chiffres marqués sur la montre.

Mise au point à améliorer. Après ces premiers tests, le groupe de chercheurs a réussi à améliorer considérablement le comportement de ces modèles après avoir effectué des réglages fins : ils les ont entraînés avec 5 000 images supplémentaires de cet ensemble de données, puis ont réévalué le comportement des modèles. Cependant, les modèles ont encore une fois échoué systématiquement lorsqu’ils ont été testés avec un ensemble différent d’images d’horloges analogiques. La conclusion était claire.

Ils ne savent pas généraliser. Ce qu'ils ont découvert avec ce test est une confirmation de ce que nous observons depuis le début avec les modèles d'IA : ils sont doués pour reconnaître les données qu'ils connaissent (mémorisées), mais ils échouent souvent dans des scénarios auxquels ils n'ont jamais été confrontés et qui ne font pas partie de leurs ensembles de formation. Ou ce qui revient au même : ils étaient incapables de généraliser.

Dalí entre en scène. Pour tenter de découvrir les causes de ces échecs, les chercheurs ont créé de nouveaux ensembles d'images dans lesquels, par exemple, ils ont utilisé les célèbres horloges déformées de Dalí, ou dans lesquels ils ont inclus des flèches au bout des aiguilles. Les humains sont capables de lire l’heure sur des horloges analogiques même si elles sont déformées, mais pour les modèles d’IA, c’était un énorme problème.

S'ils font cela avec des montres, imaginez avec une analyse médicale. Le danger de ces conclusions est qu’elles relancent le débat sur la question de savoir si les modèles d’IA générative sont effectivement artificiels et génératifs, mais peu intelligents. S’ils ont ces difficultés à identifier les mains ou leur orientation, les choses sont dangereuses si les modèles doivent analyser des images médicales ou, par exemple, des images en temps réel d’une voiture autonome traversant une ville.

Les IA sont très stupides. S'il est vrai que les modèles d'IA génératifs sont fantastiques en tant qu'aide dans divers scénarios tels que la programmation, la réalité est qu'ils « régurgitent » des réponses qui font déjà partie de leurs données d'entraînement. Comme l'explique Thomas Wolf, directeur scientifique de Hugging Face, une IA générative « ne posera jamais des questions auxquelles personne n'avait pensé ou que personne n'avait osé poser ». Bien que grâce à leur énorme mémoire et à leur formation, ils puissent récupérer une multitude de données et les présenter de manière utile, trouver des solutions à des problèmes pour lesquels ils n'ont pas été formés est très compliqué. Pour des experts comme Yann LeCun, la réalité est claire : l’IA générative est extrêmement stupide et, de surcroît, une impasse.

Source : clocks.brianmoore.com

L'IA ne dessine pas non plus très bien les horloges. À l’expérience de ces chercheurs s’ajoute un autre petit test qui remet une fois de plus en question la capacité de l’IA générative. Il s’agit de demander à différents modèles de créer le code qui permet d’afficher une horloge analogique avec l’heure actuelle. Un concepteur nommé Brian Moore a voulu partager le résultat de plusieurs modèles d'IA et la vérité est que le résultat obtenu dans la plupart d'entre eux est terrible, même si d'autres comme Kimi K2 obtiennent un bon résultat. Nous avons testé avec les récents Grok 4.1 et GPT-5.1. Après un peu d'insistance, Grok 4.1 a dessiné l'horloge parfaite et ça marche. Avec GPT-5.1, il n'y a eu aucun moyen, du moins lors de nos tests.

Une réalité inquiétante. Cette incapacité à résoudre des tâches qui paraissent simples signifie certainement que ces modèles ne sont pas à leur place. Il est vrai qu’une bonne invite peut aider à résoudre certaines de ces limitations, mais ce qui devient de plus en plus évident, c’est que les modèles d’IA continuent de commettre des erreurs malgré le passage du temps. La révolution théorique de cette technologie a justement besoin de les éradiquer, et il ne semble pas que nous soyons en passe d’y parvenir. Les modèles s'améliorent, certes, mais pas suffisamment pour que l'on puisse leur faire confiance à 100 %.

Images | Yaniv Knobel

À Simseo | Comme s'il n'y avait pas assez d'entreprises d'IA, Jeff Bezos vient de sortir de l'ombre pour en construire une autre, selon le NYT