Local Model, l'IA Générative qui n'a pas besoin du cloud

Le modèle économique selon consommationtypique des Large Language Models les plus avancés, a longtemps été le seul point d’accès à l’IA générative pour les PME. Cette approche est efficace dans de nombreux scénarios opérationnels, mais dans d’autres elle soulève des questions complexes non seulement en matière de confidentialité et de résidence des données, mais également en matière de durabilité des coûts à long terme, liées au modèle de tarification des jetons.

Récemment, de grands efforts de développement de modèles de langage se sont également concentrés sur l’optimisation des ressources. De ce mouvement est née une série de Small Language Models, comme Phi, Gemma ou Qwen, suffisamment compacts et efficaces pour fonctionner sur un bon ordinateur portable ou même un modeste serveur d'entreprise. Le résultat de ces optimisations sont des Modèles Locaux : des modèles linguistiques également très efficaces sur des tâches spécifiques, qui sont exécutés entièrement sur une infrastructure contrôlée par l'entreprise, souvent hors ligne.

Examinons trois outils qui simplifient la gestion des modèles locaux, avec des interfaces graphiques faciles à utiliser et des API pré-packagées compatibles avec la norme OpenAI. Il s’agit de LM Studio, Jan et AnythingLLM, des outils aux philosophies différentes qui poursuivent pourtant le même objectif : rendre l’IA locale accessible à un large public.

Pourquoi local plutôt que cloud ?

L’une des principales raisons pour lesquelles un modèle local, dans certains scénarios, est la seule solution viable concerne la gestion de la confidentialité et la souveraineté des données. Le RGPD représente une barrière architecturale contre l’utilisation imprudente d’API publiques lors de la manipulation de données pouvant être sensibles. Si un employé colle un rapport financier confidentiel dans ChatGPT pour le résumer, ces données quittent le périmètre de l'entreprise. Même avec des assurances Entreprise proposés par certains vendeurs, les données voyagent, sont traitées et parfois conservées pendant des durées de rétention pas toujours transparent. L'inférence locale élimine ce problème : le traitement est éphémère, les données entrent dans la RAM de la machine exécutant le modèle, sont traitées et disparaissent dès la fermeture de la session.

Ensuite, il y a aussi un enjeu purement économique qui touche le modèle SaaS (Software as a Service). Le modèle économique de l'API est basé sur la consommation : lorsque vous intégrez l'IA dans un processus principal et que ce processus évolue, la facture mensuelle d'OpenAI augmentera de manière linéaire. L’approche locale transforme cette charge d’exploitation variable et potentiellement infinie (OPEX) en une dépense en capital fixe et amortissable (CAPEX). L’achat d’un poste de travail adapté est un coût ponctuel, et l’électricité devient le seul coût variable. Pour la phase d’inférence, c’est-à-dire pour la génération proprement dite du contenu, ce coût peut même être négligeable.

Reste enfin la question de la vitesse. Les infrastructures critiques ne peuvent pas dépendre de la latence d'une connexion Internet ou de l'état des serveurs d'un fournisseur tiers. Il existe des scénarios dans lesquels un système basé sur l’IA doit fonctionner hors ligne, à tout moment et instantanément. Les LLM locaux peuvent garantir cette continuité opérationnelle ; Voici trois propositions.

Studio LM

Essayer d'exécuter un modèle de langage open source il y a quelque temps aurait pu être un cauchemar de dépendances Python brisées, de pilotes CUDA incompatibles et de référentiels GitHub complexes à interpréter. LM Studio élimine cette complexité d’un seul coup, ce qui en fait sans doute la passerelle la plus élégante vers l’IA sur site disponible aujourd’hui.

La philosophie de LM Studio est de rendre l'inférence accessible à toute personne possédant des compétences informatiques de base. Vous n'avez pas besoin de savoir programmer. L'interface est épurée, moderne, avec une barre latérale qui sert de navigateur intégré pour Hugging Face, le conteneur universel pour les modèles d'IA. L'utilisateur recherche par nom le modèle qu'il souhaite exécuter et LM Studio affiche les options de téléchargement déjà filtrées par compatibilité.

Outre l'interface graphique simplifiée, LM Studio possède également un autre point fort : la gestion de la quantification.

Pour comprendre sa valeur, il faut comprendre une limitation physique fondamentale dans l’exécution d’un modèle de langage : la mémoire. Un modèle d’IA pure pèse des centaines de gigaoctets, trop pour une station de travail abordable. La quantification est une technique qui permet de réduire la précision des poids du modèle (de 16 bits à 4 ou 5 bits), perdant ainsi une petite quantité d'« intelligence », mais réduisant considérablement les besoins en ressources. LM Studio supporte nativement le format GGUF, le standard de facto pour cette compression. Il permet par exemple de télécharger un modèle Llama 3 de 8 milliards de paramètres quantifiés sur 4 bits et de l'exécuter sur un ordinateur portable avec une certaine fluidité.

LM Studio vous permet également de répartir la charge de travail entre le CPU (le processeur) et le GPU (la carte vidéo). Sur les machines équipées de puces Apple Silicon (M1, M2, M3), il profite de la mémoire unifiée pour charger des modèles énormes qui nécessiteraient normalement des serveurs coûtant des dizaines de milliers de dollars. Pour une équipe de développement qui a besoin de prototyper une application d'IA, l'utilisation de LM Studio peut réduire considérablement le temps requis.

Jan : L’alternative transparente

Jan est la réponse open source à LM Studio. Ce projet se positionne avec un objectif ambitieux et presque audacieux : être une alternative rendez-vous à ChatGPT, mais qui vit entièrement localement et garantit une transparence maximale de la pile technologique.

Jan est construit sur Cortex, un moteur d'inférence open source hautes performances écrit en C++. Il peut également faire office de serveur API parfaitement compatible avec le standard OpenAPI, étant ainsi immédiatement interchangeable avec les API ChatGPT.

Ce logiciel est également adapté aux contextes de sécurité en air gap : il est en effet conçu pour fonctionner dans des environnements où la connexion internet est physiquement absente. Cela en fait un bon choix dans les secteurs à haute sécurité tels que la finance, le juridique ou la défense. La gestion des données est totalement transparente : les conversations sont enregistrées dans des fichiers simples JSON sur le système de fichiers local, facilement sauvegardé ou supprimé conformément aux politiques de conservation des données de l'entreprise.

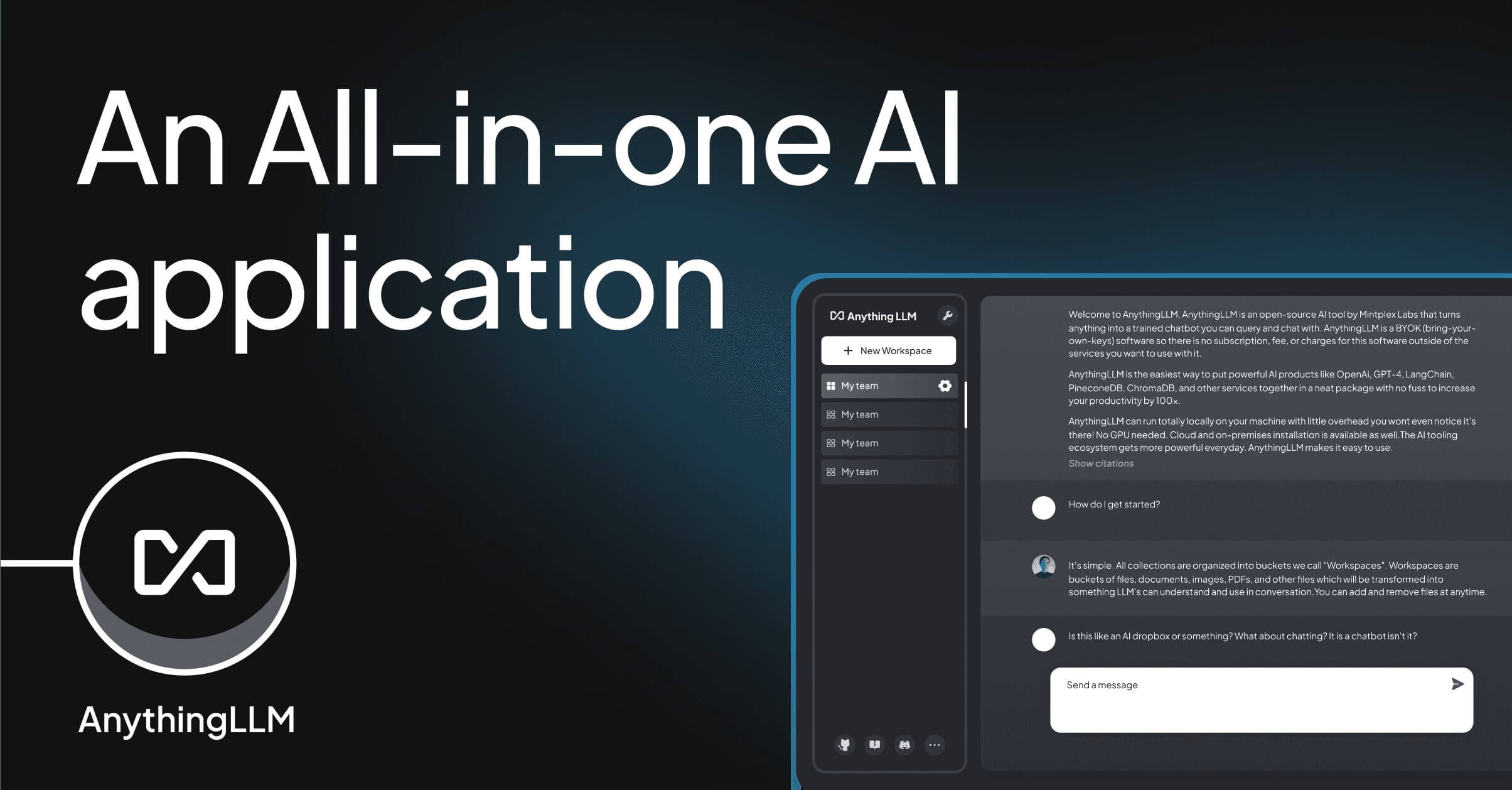

AnythingLLM : du chat à la business intelligence

AnythingLLM est un outil qui déplace l'accent de l'inférence pure vers le RAG (Retrieval-Augmented Generation). Le problème avec les modèles de langage a-contextuels est qu’ils peuvent souffrir d’hallucinations ou générer du contenu qui n’est pas conforme aux politiques et normes de l’entreprise. AnythingLLM permet de pallier ces problématiques en démocratisant la création de bases de connaissances vectorielles.

Techniquement, AnythingLLM est une suite tout-en-un. A l'intérieur, il intègre non seulement le runner pour les modèles (vous pouvez utiliser le vôtre ou vous connecter à LM Studio/Ollama), mais surtout une base de données vectorielles et un système d'intégration. Lorsque vous téléchargez un fichier PDF, Word ou une page intranet sur AnythingLLM, le logiciel les convertit en vecteurs numériques (longues chaînes de nombres qui représentent une signification sémantique) et les stocke localement.

Lorsqu'un utilisateur pose une question, AnythingLLM recherche d'abord dans la base de données vectorielles les fragments de documents les plus pertinents pour la question, puis les associe à l'invite, indiquant au modèle quelles informations utiliser pour donner une réponse ancrée à des données réelles, avec des citations précises de sources spécifiques.

Ce logiciel permet également de gérer des espaces de travail distincts en entreprise. Cette séparation des données est essentielle pour empêcher tout accès non autorisé aux informations sensibles.

Le système est multimodal et multi-utilisateurs : il peut être installé sur un serveur d'entreprise et servir toute une division via une interface web, avec gestion des autorisations. Il s’agit en effet d’une plateforme de business intelligence conversationnelle prête à l’emploi, capable de transformer des téraoctets de données oubliées sur les serveurs en une base de connaissances active, interrogeable en langage naturel, sans qu’un seul octet ne quitte le réseau local.

Comment choisir le bon outil

Le choix de l'outil à utiliser pour commencer à automatiser un processus ou à simplifier un pipeline commercial dépend du problème spécifique que vous essayez de résoudre.

Si l’objectif est la performance pure et le prototypage technique, le choix se porte sur LM Studio. C'est l'outil destiné aux utilisateurs expérimentés et aux équipes de R&D qui ont besoin de tirer le meilleur parti du matériel disponible. Sa capacité à gérer la quantification GGUF et le déchargement granulaire en fait un outil parfait pour ceux qui travaillent à bas niveau avec des modèles de langage.

Si votre priorité est la conformité, l'open source et l'intégration d'API, alors Jan est la solution idéale. Il convient aux entreprises ayant des politiques de sécurité complexes ou à celles qui ont besoin d'intégrer l'IA dans les flux de travail existants sans risquer le verrouillage du fournisseur. Son caractère transparent rassure les auditeurs, tandis que sa compatibilité avec les spécifications OpenAI vous permet de travailler avec les standards de l'industrie sans les payer au fur et à mesure.

Pour la gestion des connaissances et la recherche documentaire, AnythingLLM est le meilleur choix. Cela n’a pas beaucoup de sens de l’utiliser comme un simple chatbot : il devrait être utilisé pour construire de la business intelligence. La gestion intégrée de la base de données vectorielles vous permet d'accélérer tous les processus qui nécessitent la consultation de procédures, de manuels et d'autres documentations longues et complexes.

La solution hybride

Il existe également un scénario hybride, plus complexe à mettre en œuvre, mais encore plus efficace pour les entreprises ayant des besoins complexes. En fait, il est possible d'utiliser LM Studio ou Jan comme moteur backend qui expose l'API locale et connecte AnythingLLM comme interface pour la gestion de documents.

Cette architecture modulaire offre le meilleur des deux mondes : une puissance d'inférence optimisée et une gestion intelligente des connaissances.

La souveraineté des modèles locaux

Les modèles pionniers continuent de nécessiter des centres de données massifs et une puissance de calcul hors de portée de la plupart des entreprises. Nous les utilisons pour les tâches les plus complexes, créatives et généralistes, où le coût élevé et le risque pour la vie privée sont justifiés par une capacité de raisonnement supérieure.

Cependant, la plupart des tâches professionnelles quotidiennes ne nécessitent pas une telle puissance de calcul. Cela nécessite plutôt un modèle efficace, rapide, privé et résidant dans une infrastructure locale. L'adoption d'outils tels que LM Studio, Jan ou AnythingLLM permet aux PME de se doter d'une capacité de calcul d'IA indépendante et entièrement personnalisée.