L'intelligence artificielle est abaissée à une vitesse record. Le paradoxal est que l'utiliser est de plus en plus cher

Chaque fois que Chatgpt génère un mot, cela coûte de l'argent. Mais le prix de ce mot généré n'a pas cessé de baisser depuis le lancement de ce modèle, et il en va de même pour ses rivaux. Aujourd'hui, nous avons des modèles d'IA qui sont non seulement plus puissants, mais ils sont aussi moins chers que jamais, et la chose curieuse est que nous payons de plus en plus pour les utiliser. Ce qui se passe?

Les jetons OpenAI définissent les jetons comme « des séquences de caractères communes trouvées dans un ensemble de texte ». Cette « unité de base » d'informations est ce que ces modèles utilisent pour comprendre ce que nous disons, puis traiter ces textes pour répondre. Chaque fois que nous utilisons le chatppt, nous avons d'une part la demande avec le texte que nous introduisons (jetons d'entrée) et d'autre part le texte généré par le chatbot (jetons de sortie).

|

Prix par million de jetons (dollars) |

Entrée |

Sortie |

|---|---|---|

|

Gpt-5 |

1.10 |

10 |

|

GPT-4O |

2.5 |

10 |

|

O1 |

15 |

60 |

|

Gemini 2.5 Pro (<200k jetons) |

1.25 |

10 |

|

Gemini 2.5 Pro (> 200ktokens) |

2.5 |

15 |

|

Claude Opus 4.1 |

15 |

75 |

|

Claude Sonnet 4 (<200k jetons) |

3 |

15 |

|

Claude Sonnet 4 (> 200k jetons) |

6 |

22.5 |

Prix par million de jetons. Et lorsque nous utilisons un modèle d'IA, le prix de l'utilisation est mesuré avec précision combien il coûte chaque million de jetons d'entrée et chaque million de jetons de sortie. Plus un modèle est puissant, plus le prix de ces jetons est élevé et pour obtenir une idée, ceux-ci sont les prix de certains modèles actuels. Les prix des jetons de production (ceux générés par les machines) sont remarquablement plus élevés que ceux de l'entrée: il en coûte beaucoup plus pour générer du texte que «pour le recevoir et le comprendre».

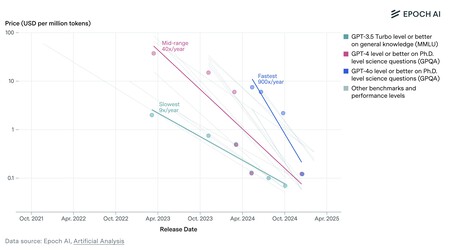

Les modèles d'IA s'améliorent et deviennent moins chers. Au moins, en termes de coût par million de jetons. Source: Epoch Ai.

Mais les prix ne se sont pas arrêtés. Ces prix par million de jetons d'entrée ou de sortie, cependant, ont chuté remarquablement depuis que Chatgpt (à l'époque basé sur GPT-3.5) est apparu sur la scène. Une étude de l'époque AI de mars 2025 s'est révélée comme le prix de l'inférence – générer du texte, comme ils le font Chatgpt, Gemini ou Claude – n'a pas cessé de tomber. Dans certains cas, les modèles sont plus petits et efficaces, et le matériel est également plus rentable, ce qui favorise cette baisse de prix.

Et nous payons encore de plus en plus pour l'utilisation de l'IA. Cependant, les développeurs qui utilisent ces modèles d'IA pour programmer se rendent compte que leurs factures sont de plus en plus élevées. Ces types de professionnels ont été ceux qui ont profité des avantages de cette technologie, mais ce faisant, ils ont réalisé cette contradiction. En fait, l'explication est simple.

Le raisonnement dépense de nombreux jetons. Le problème est que les modèles de raisonnement consomment de nombreux jetons. Ce type de technologie améliore la précision des réponses, mais pour y parvenir, les modèles n'arrêtent pas de « penser » et de générer différentes théories, puis de les analyser et de garder la solution qu'ils considèrent comme plus probable ou mieux. Les modèles qui «ne pensent pas» et ne génèrent pas de texte «une fois» ne consomment que peu de jetons, mais ceux qui «raisonnent» à multiplier remarquablement ce coût.

Le codage de l'ambiance est coûteux. L'exemple le plus cher de ces coûts élevés de l'IA l'a sur les plateformes de « codage d'ambiance ». Avec eux, il est possible de programmer presque sans savoir comment programmer, mais ces outils utilisent largement les modèles d'IA, et il y a la consommation de jetons (en particulier ceux de la sortie, qui sont les plus chers). Plusieurs sociétés de ce segment, telles que Windsurf ou Cursor, ont réalisé à quel point il est difficile de gagner de l'argent avec l'IA, et il y a aussi divers utilisateurs qui mettent en garde contre ces coûts licenciés dans Reddit, par exemple.

Et les agents de l'IA promettent d'être très chers. Les agents IA devraient être en mesure de faire beaucoup de choses pour nous, mais ces systèmes seront coûteux car ils consommeront également de nombreux jetons pour comprendre, « raison » et atteindre la solution souhaitée.

Solution: utilisez-vous ne pensez pas autant. Face à ces IAS qui «raisonnent» et consomment de nombreux coûts, l'alternative est claire: ne pas recourir aux modèles de raisonnement et opter plutôt pour des modèles qui «ne raisonnent pas» de réduire les coûts. Ces modèles sont beaucoup moins chers à utiliser et peuvent être utiles pour de nombreux scénarios. Heureusement, des modèles de efficaces et de plus en plus bon marché sont apparus cette raison: Deepseek R1 en est une bonne preuve.

Le célèbre routeur n'est peut-être pas une mauvaise idée. Lorsque OpenAI a lancé GPT-5, il l'a fait avec son célèbre « routeur » ou « routeur » qui a analysé la demande et a décidé de lui-même quelle variante du modèle (plus ou moins puissant) a dû répondre à la question. Comme nous l'avons vu, ce routeur a tendance à choisir d'utiliser le modèle « bon marché », mais ce n'est pas une mauvaise idée. Ni pour OpenAI (qui coûte beaucoup moins de traitement de la réponse) ni pour les utilisateurs (qui consomment également moins de ressources et ont plus de frais gratuits pour d'autres questions qui ont peut-être besoin de « raisonnement »).

Image | Photographie de Levart | Igal ness

Dans Simseo | Les agents de l'IA sont prometteurs. Mais comme dans le FSD de Tesla, vous feriez mieux de ne pas vous prendre la main du volant