L’intelligence artificielle : endiguer la vague de fausses informations

Le professeur Stefan Feuerriegel est directeur de l’Institut d’intelligence artificielle (IA) en gestion au LMU et ses recherches portent sur les défis de la vague de numérisation.

Dans un commentaire récemment publié dans la revue Comportement humainil souligne les dangers que représente la désinformation générée par l’IA et propose des moyens de les contrer.

D’une simple pression sur un bouton, les outils d’IA sont désormais capables de générer des textes, des images, des voix et même des vidéos convaincants. Pouvons-nous encore faire confiance à nos yeux, à nos oreilles et à notre bon sens à l’avenir ?

Stefan Feuerriegel : La photo du pape François, devenue virale au printemps dernier, illustre à quel point un tel contenu généré artificiellement est convaincant. Les gens ordinaires n’étaient guère équipés pour reconnaître si l’image était réelle ou non. Bien entendu, des artistes talentueux étaient autrefois capables de tromper le public et les experts avec des peintures contrefaites.

Mais dans le cas de la photo du pape, c’est une personne qui a rapidement produit des dizaines de versions de cette photo. Cela a mis en évidence ce qui est possible avec l’IA aujourd’hui : produire ces images est facile et ne nécessite pas de compétences particulières.

Pour le moment, les programmes d’IA ne parviennent toujours pas à obtenir certains détails précis : parfois, l’arrière-plan est un peu décalé et l’IA a l’habitude de restituer les mains avec trop ou pas assez de doigts. Cependant, les ingénieurs développent et optimisent la technologie à un rythme rapide. Au cours des prochains mois, les améliorations seront visibles.

Qu’est-ce qui rend les fausses nouvelles générées par l’IA particulièrement dangereuses ?

Malheureusement, non seulement les contrefaçons avec un texte sans erreur et des images authentiques sont déjà très convaincantes, mais l’IA permet de personnaliser la désinformation et de l’adapter à la religion, au sexe ou aux convictions politiques des consommateurs individuels et de semer la rage ou la haine chez chacun. groupe ciblé.

Vous pouvez créer un robot qui ne se contente plus de publier un message, mais qui écrit personnellement aux personnes sur Facebook ou Twitter, répond aux réponses et poursuit des conversations. Cela s’étend même aux faux appels, où des escrocs ou d’autres mauvais acteurs génèrent délibérément une voix qui ressemble à celle d’un membre de la famille d’une personne.

Quand rechercher les fautes de frappe et compter les doigts ne suffit plus, quels sont les signes révélateurs qui peuvent nous alerter des contrefaçons ?

Concernant le contenu, il n’y a aucun signe. Ou du moins, il n’y en aura bientôt plus. Soit vous vous appuyez sur certaines sources fiables, soit vous devez faire vos propres recherches. Cela étant dit, vous devez savoir que les fournisseurs de faux faits peuvent obtenir des classements importants dans les moteurs de recherche grâce à des sites Web et à des sources générés par l’IA. De plus, sur les réseaux sociaux, les images sont si petites que les gens ne peuvent même pas repérer les erreurs qui pourraient s’y trouver.

Des images et des vidéos en basse résolution circulent sur Internet et ne permettent pas aux utilisateurs de déterminer correctement si elles sont réelles ou fausses. Il est donc difficile de distinguer la désinformation du contenu authentique. Dans les conflits armés, le pouvoir des images et des médias sociaux joue un rôle important et peut avoir un impact politique explosif. Ici aussi, nous assistons déjà au déploiement de matériel généré par l’IA aux côtés des contrefaçons conventionnelles.

Sommes-nous en train d’entrer dans une nouvelle ère de désinformation ?

Beaucoup de mes collègues disent que nous vivons déjà dans une ère de fausses nouvelles. Le problème ne fera qu’empirer. La question décisive est la suivante : qui exploite ces nouvelles possibilités ? Je suis moins préoccupé par les particuliers qui diffusent des informations erronées via ChatGPT ou DALL·E. Ces personnes ont rarement la portée, voire le désir, d’exercer une influence majeure. Au lieu de cela, nous devons garder un œil sur les acteurs qui utilisent ces outils pour des campagnes de désinformation à grande échelle, les calibrer délibérément, voire développer leurs propres outils sans aucun mécanisme de sécurité intégré.

Les choses deviennent vraiment dangereuses lorsque les grands acteurs entrent en jeu, par exemple un acteur étatique dans un pays non démocratique avec un certain programme politique. Au cours de l’invasion russe de l’Ukraine, nous avons vu combien d’efforts ont été consacrés à la propagande pro-russe. En effet, pourquoi les agences responsables ne travailleraient-elles pas avec ces nouveaux outils, qui leur permettent de réagir plus rapidement et de produire des contenus d’apparence authentique à une échelle beaucoup plus grande ? Il serait naïf de croire que ces opportunités resteront inexploitées.

Les vérificateurs de faits sont-ils capables de suivre tout cela ?

Nous savons que les vérificateurs humains ont besoin de 24 heures pour vérifier une actualité. À ce stade, il est peut-être devenu viral depuis longtemps. Dans le contexte des crises actuelles en particulier, démystifier la désinformation avant qu’elle ne se propage constitue un défi de taille. Facebook et Twitter utilisent actuellement l’IA générative pour identifier automatiquement les fausses nouvelles.

Des discussions sont également en cours sur l’utilisation de filigranes, grâce auxquels les plateformes pourraient reconnaître et filtrer le contenu généré par l’IA. Cela nécessite la coopération des plateformes. Cela ne sert à rien si Twitter utilise cet outil, mais la désinformation devient alors virale sur WhatsApp. De plus, il peut encore y avoir des acteurs qui ne respectent pas les règles et programment leur propre IA sans filigrane.

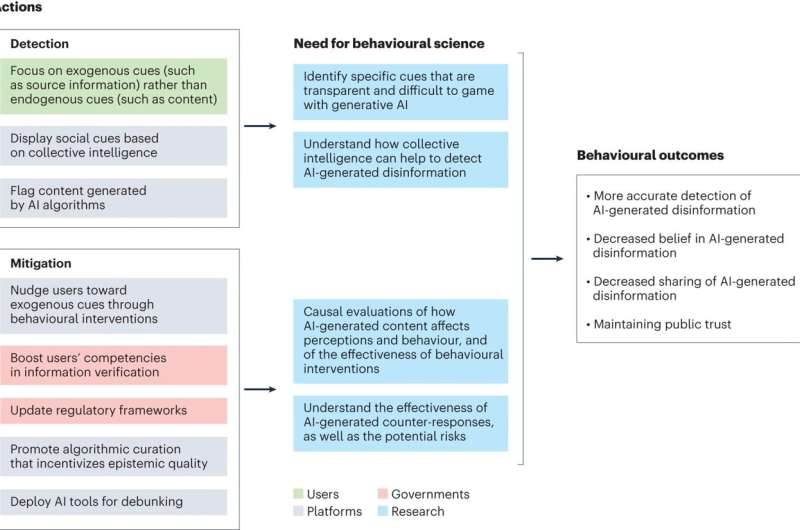

Comment pouvons-nous contrer le flot de désinformation sur l’IA ?

Personnellement, je suis devenu beaucoup plus circonspect dans le contenu que je consomme. Il faut être beaucoup plus vigilant quant à ce que l’on lit, notamment sur les réseaux sociaux. Malheureusement, beaucoup de gens ne sont pas conscients du problème. Bien qu’ils sachent que l’IA est capable de produire des textes de haute qualité et des images réalistes, ils ne voient pas encore comment cette technologie peut être utilisée à mauvais escient.

Tout d’abord, il faut faire en sorte que les plateformes assument leurs responsabilités. Ils connaissent les sources de l’information. Les utilisateurs voient simplement les publications, tandis que les plateformes peuvent voir si un programme informatique publie ces contenus en arrière-plan ou si une personne réelle se trouve derrière eux. En outre, les opérateurs des réseaux peuvent rappeler à leurs membres d’évaluer et de vérifier les informations de manière critique. Les plateformes pourraient également faire beaucoup plus pour filtrer les fausses nouvelles : certaines font des efforts en ce sens, d’autres moins.

Deuxièmement, nous devons informer et préparer chaque individu et le grand public. Nous avons besoin de cours de formation sur les compétences médiatiques et l’alphabétisation numérique qui couvrent la désinformation liée à l’IA et qui sont continuellement mis à jour à mesure que la technologie évolue.

Et puis, troisièmement, se pose la question de savoir ce que les hommes politiques devraient faire et dans quelle mesure la réglementation est utile et efficace. C’est un sujet épineux car de telles mesures peuvent aller à l’encontre de la liberté d’expression. L’IA est actuellement en tête de l’agenda du Parlement européen, et je pense que nous pourrions trouver de bonnes solutions relativement rapidement en termes de cadres réglementaires.

Sommes-nous prêts pour ce qui s’en vient ? Où avons-nous besoin de plus de recherches ?

Non, nous ne sommes pas suffisamment préparés. Nous avons affaire à une nouvelle technologie que nous devons mieux comprendre et qui nécessite beaucoup plus de recherche fondamentale. Heureusement, de nombreuses recherches sont menées dans ce domaine, notamment au LMU. Des linguistes, des sociologues, des politologues et des chercheurs de nombreuses autres disciplines se penchent sur ce sujet complexe. Les spécialistes du comportement s’efforcent de comprendre comment les gens réagissent à de telles informations générées artificiellement.

Les juristes étudient les obstacles juridiques et cherchent à trouver un équilibre entre le précieux bien qu’est la liberté d’expression et les approches réalisables et orientées vers des solutions. Pendant ce temps, le service informatique est chargé de découvrir ce qui est technologiquement réalisable. Nous avons un environnement interdisciplinaire à LMU, où de nombreux domaines de recherche différents développent collectivement un programme de recherche.