L'IA physique utilise à la fois la vue et le toucher pour manipuler des objets comme un humain

Dans la vie quotidienne, c'est une évidence de pouvoir prendre une tasse de café de la table. Plusieurs entrées sensorielles telles que la vue (voir à quelle distance la tasse) et le toucher sont combinées en temps réel. Cependant, le recréer en intelligence artificielle (IA) n'est pas aussi simple.

Un groupe international de chercheurs a créé une nouvelle approche qui intègre des informations visuelles et tactiles pour manipuler les armes robotiques, tout en répondant de manière adaptative à l'environnement. Par rapport aux méthodes conventionnelles basées sur la vision, cette approche a atteint des taux de réussite des tâches plus élevés. Ces résultats prometteurs représentent une progression significative dans le domaine de l'IA physique multimodale.

Les détails de leur percée ont été publiés dans la revue Robotique IEEE et lettres d'automatisation.

L'apprentissage automatique peut être utilisé pour soutenir l'intelligence artificielle (IA) pour apprendre les modèles de mouvement humain, permettant aux robots d'effectuer de manière autonome des tâches quotidiennes telles que la cuisine et le nettoyage. Par exemple, Aloha (un système matériel open-source à faible coût pour la téléopération bimanuelle) est un système développé par l'Université de Stanford qui permet le fonctionnement à distance à faible coût et polyvalent et l'apprentissage des robots à double bras. Le matériel et les logiciels sont open source, donc l'équipe de recherche a pu s'appuyer sur cette base.

Cependant, ces systèmes reposent principalement sur des informations visuelles uniquement. Par conséquent, ils n'ont pas les mêmes jugements tactiles qu'un humain pourrait faire, comme la distinction de la texture des matériaux ou des côtés avant et arrière des objets. Par exemple, il peut être plus facile de dire qui est l'avant ou l'arrière du velcro en le touchant simplement au lieu de discerner son apparence. S'appuyer uniquement sur la vision sans autre contribution est une malheureuse faiblesse.

« Pour surmonter ces limitations, nous avons développé un système qui permet également des décisions opérationnelles basées sur la texture des objets cibles – qui sont difficiles à juger à partir de l'information visuelle seule », explique Mitsuhiro Hayashibe, professeur à la Graduate School of Engineering de l'Université Tohoku.

« Cette réalisation représente une étape importante vers la réalisation d'une IA physique multimodale qui intègre et traite plusieurs sens tels que la vision, l'ouïe et le toucher – tout comme nous. »

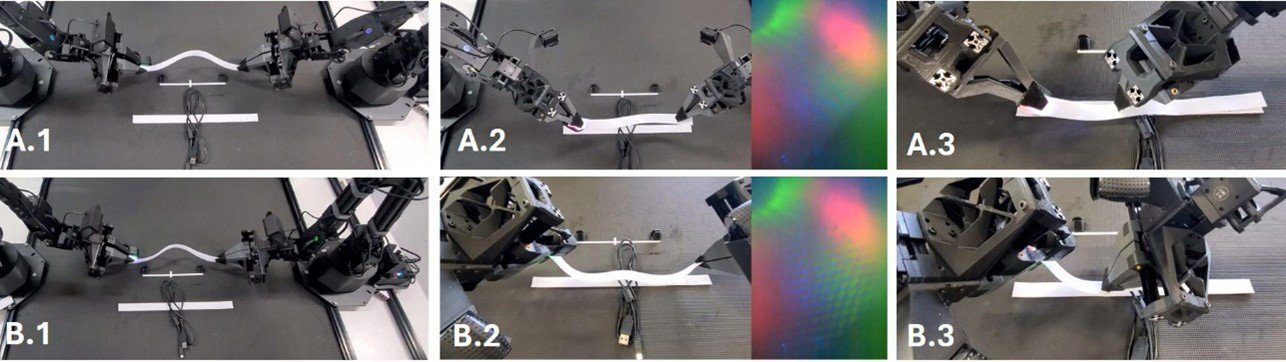

Le nouveau système a été surnommé «Tactilealoha». Ils ont constaté que le robot pouvait effectuer des opérations bimanuelles appropriées même dans les tâches où les différences de front et l'adhésivité sont cruciales, comme avec les liens velcro et zip. Ils ont constaté qu'en appliquant une technologie de transformateur visuelle-tactile, leur robot d'IA physique présentait un contrôle plus flexible et adaptatif.

La méthode AI physique améliorée a pu manipuler avec précision les objets, en combinant plusieurs entrées sensorielles pour former des mouvements adaptatifs et réactifs. Il y a des applications pratiques possibles presque infinies de ces types de robots pour donner un coup de main. Les contributions à la recherche telles que Tactilealoha nous rapprochent de ces aides robotiques devenant une partie transparente de notre vie quotidienne.

Le groupe de recherche était composé de membres de la Graduate School of Engineering de l'Université Tohoku et du Center for Transformative Garment Production, de Hong Kong Science Park et de l'Université de Hong Kong.