Les voitures autonomes apprennent à partager les connaissances sur la route grâce à un bouche à oreille numérique

Une équipe de recherche dirigée par NYU Tandon a développé un moyen pour les véhicules autonomes de partager ses connaissances sur les conditions routières indirectement, ce qui permet à chaque véhicule d’apprendre des expériences des autres, même lorsqu’ils se rencontrent rarement sur la route.

La recherche, qui sera présentée dans un article de l’Association for the Advancement of Artificial Intelligence Conference (AAAI 2025) le 27 février 2025, aborde un problème persistant en intelligence artificielle: comment aider les véhicules à apprendre les uns des autres tout en gardant leurs données privées. Le papier est disponible sur le arxiv serveur de préimprimée.

En règle générale, les véhicules ne partagent ce qu’ils ont appris lors de brèves rencontres directes, limitant la rapidité avec laquelle ils peuvent s’adapter aux nouvelles conditions.

« Pensez-y comme créer un réseau d’expériences partagées pour les voitures autonomes », a déclaré Yong Liu, qui a supervisé la recherche dirigée par son doctorat. Étudiant Xiaoyu Wang. Liu est professeur au département de génie électrique et informatique de NYU Tandon et membre de son Center for Advanced Technology in Telecommunications and Distributed Information Systems et de NYU Wireless.

« Une voiture qui n’a conduit qu’à Manhattan pourrait maintenant se renseigner sur les conditions de la route à Brooklyn à partir d’autres véhicules, même si elle n’y conduit jamais elle-même. Cela rendrait chaque véhicule plus intelligent et mieux préparé pour des situations qu’il n’a pas rencontrées personnellement », a déclaré Liu.

Les chercheurs appellent leur nouvelle approche en cache, un apprentissage fédéré décentralisé (Cached-DFL). Contrairement à l’apprentissage fédéré traditionnel, qui s’appuie sur un serveur central pour coordonner les mises à jour, Cached-DFL permet aux véhicules de former leurs propres modèles d’IA localement et de partager ces modèles avec d’autres directement.

Lorsque les véhicules se situent à moins de 100 mètres les uns des autres, ils utilisent une communication de dispositif à haute vitesse pour échanger des modèles formés plutôt que des données brutes. Surtout, ils peuvent également transmettre des modèles qu’ils ont reçus des rencontres précédentes, permettant aux informations de se propager bien au-delà des interactions immédiates. Chaque véhicule maintient un cache allant jusqu’à 10 modèles externes et met à jour son IA toutes les 120 secondes.

Pour empêcher les informations obsolètes de dégrader les performances, le système supprime automatiquement les modèles plus anciens en fonction d’un seuil de stage, garantissant que les véhicules hiérarchisent les connaissances récentes et pertinentes.

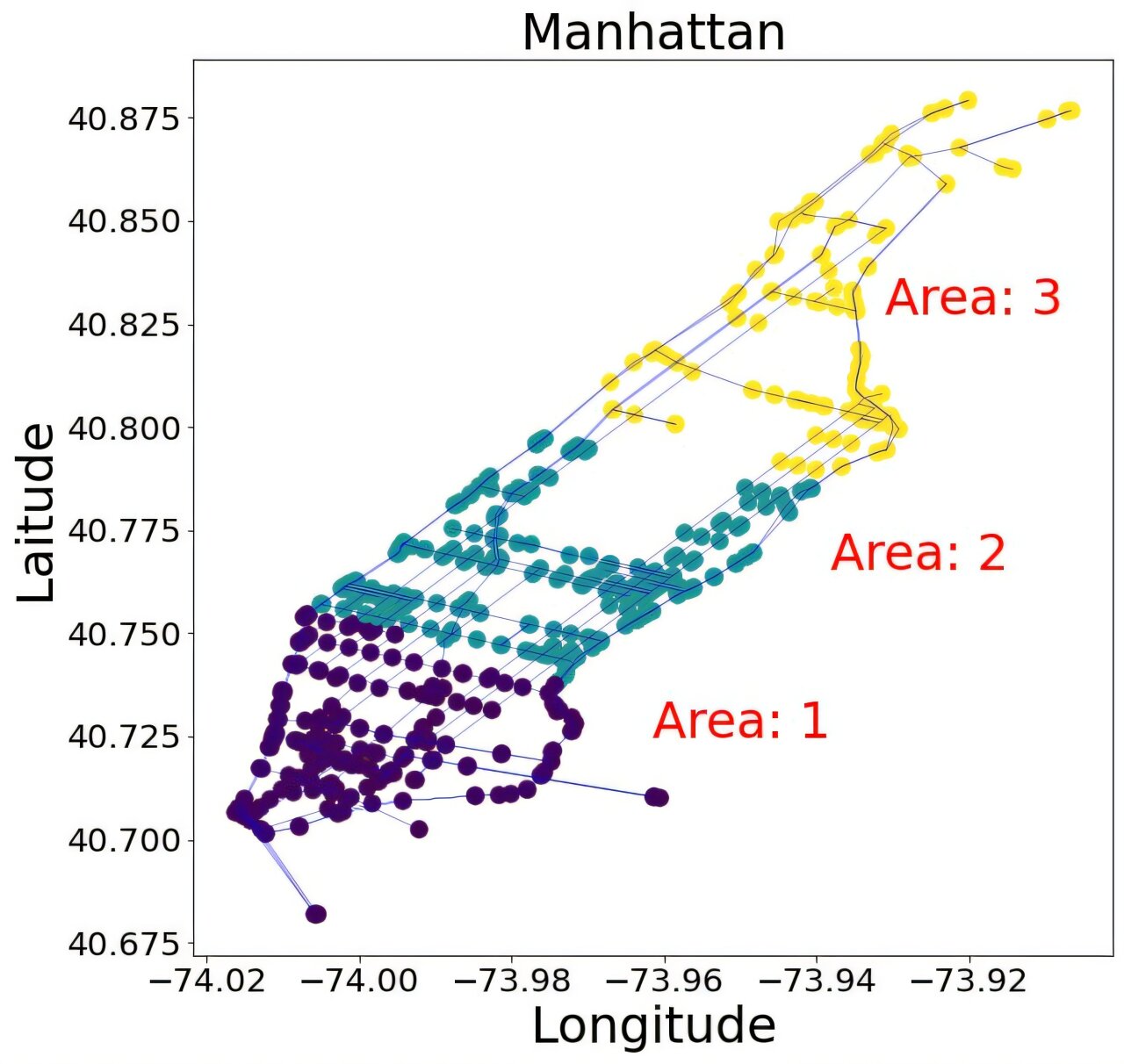

Les chercheurs ont testé leur système à travers des simulations informatiques en utilisant la disposition des rues de Manhattan comme modèle. Dans leurs expériences, les véhicules virtuels se sont déplacés le long de la grille de la ville à environ 14 mètres par seconde, ce qui fait des virages aux intersections en fonction de la probabilité, avec 50% de chances de poursuivre les chances droites et égales de se tourner vers d’autres routes disponibles.

Contrairement aux méthodes d’apprentissage décentralisées conventionnelles, qui souffrent lorsque les véhicules ne se réunissent pas fréquemment, CACHED-DFL permet aux modèles de voyager indirectement via le réseau, tout comme la façon dont les messages se propagent dans les réseaux tolérants à retard, qui sont conçus pour gérer la connectivité intermittente en stockant et en transférant des données jusqu’à ce qu’une connexion soit disponible. En agissant comme relais, les véhicules peuvent transmettre des connaissances même s’ils ne souffrent jamais de certaines conditions.

« C’est un peu comme la façon dont l’information se propage dans les réseaux sociaux », a expliqué Liu. « Les appareils peuvent désormais transmettre les connaissances des autres qu’ils ont rencontrés, même si ces appareils ne se rencontrent jamais directement. »

Ce mécanisme de transfert multi-HOP réduit les limites des approches traditionnelles de partage du modèle, qui reposent sur des échanges immédiats et un à un. En permettant aux véhicules d’agir comme des relais, Cached-DFL permet à l’apprentissage de se propager sur une flotte entière plus efficacement que si chaque véhicule était limité aux seuls interactions directes.

La technologie permet aux véhicules connectés de se renseigner sur les conditions routières, les signaux et les obstacles tout en gardant des données privées. Ceci est particulièrement utile dans les villes où les voitures sont confrontées à des conditions variées mais se réunissent rarement assez longtemps pour les méthodes d’apprentissage traditionnelles.

L’étude montre que la vitesse du véhicule, la taille du cache et l’expiration du modèle ont un impact sur l’efficacité d’apprentissage. Des vitesses plus rapides et une communication fréquente améliorent les résultats, tandis que les modèles obsolètes réduisent la précision. Une stratégie de mise en cache basée sur le groupe améliore encore l’apprentissage en hiérarchisant divers modèles de différents domaines plutôt que les derniers.

Alors que l’IA passe des serveurs centralisés aux appareils Edge, Cached-DFL offre un moyen sécurisé et efficace pour les voitures autonomes d’apprendre collectivement, les rendant plus intelligents et plus adaptatifs. Cached-DFL peut également être appliqué à d’autres systèmes en réseau d’agents mobiles intelligents, tels que les drones, les robots et les satellites, pour un apprentissage décentralisé robuste et efficace pour obtenir une intelligence de la tension.