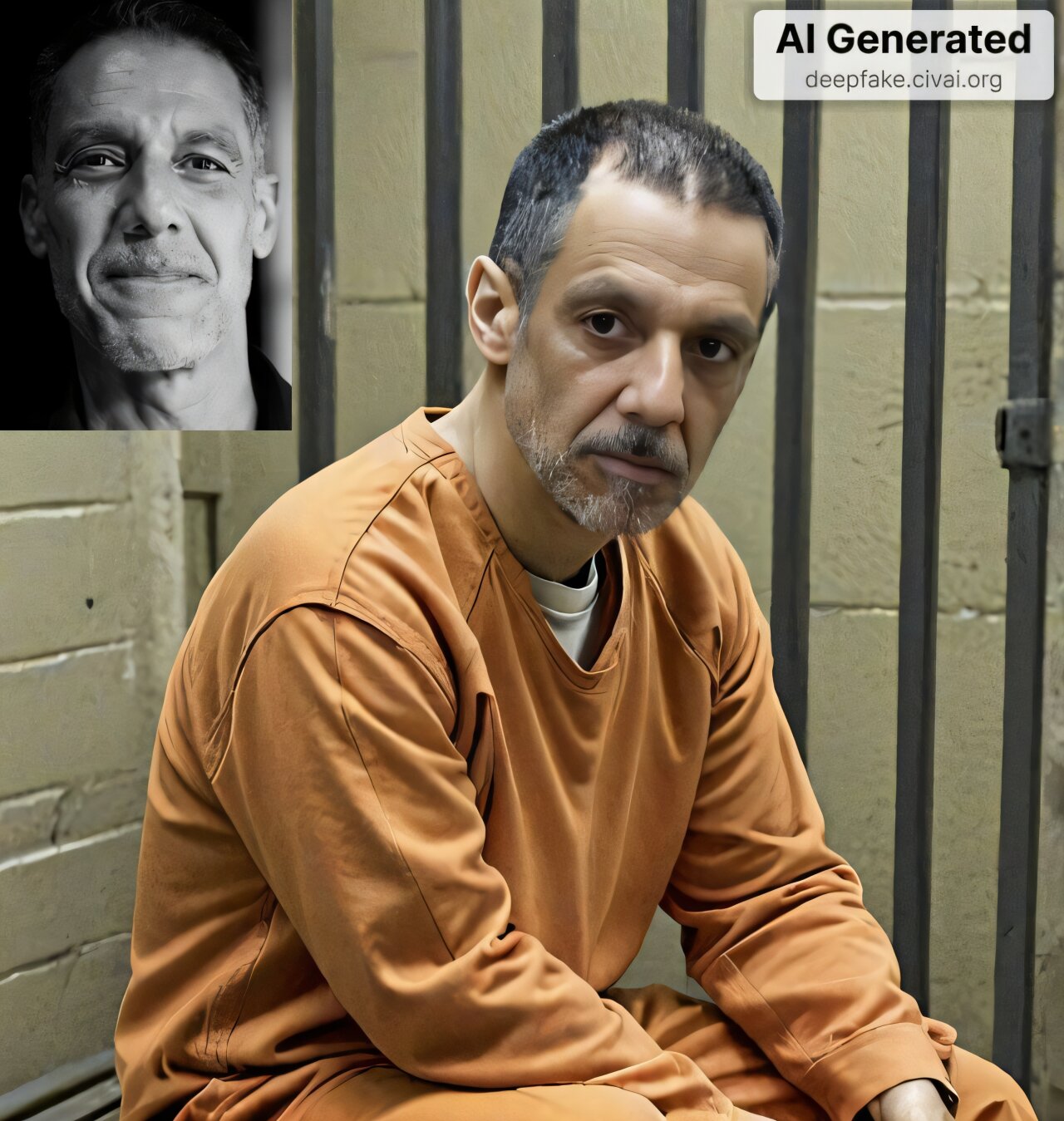

Les stratégies de détection de fraude décrites peuvent expliquer comment survivre à l'explosion de Deepfakes

Dans une perspective, Hany Farid met en évidence le risque d'images et de vidéos manipulées et frauduleuses, connues sous le nom de Fetfakes Deep, et explore les interventions qui pourraient atténuer les dommages que Deepfakes peut provoquer.

Dans le NEXUS PNAS Article, Farid explique que discriminer visuellement le réel du faux est devenu de plus en plus difficile et résume ses recherches sur les techniques médico-légales numériques, utilisée pour déterminer si les images et les vidéos ont été manipulées.

Farid célèbre les utilisations positives de l'IA générative, notamment en aidant les chercheurs, démocratisant la création de contenu et, dans certains cas, donnant littéralement la voix à ceux dont la voix a été réduite au silence. Mais il met en garde contre les utilisations nuisibles de la technologie, notamment l'imagerie intime non consensuelle, l'imagerie d'abus sexuels pour enfants, la fraude et la désinformation. De plus, l'existence de la technologie DeepFake signifie que les acteurs malveillants peuvent mettre en doute les images légitimes en affirmant que les images sont faites avec l'IA.

Alors, que faire? Farid met en évidence une gamme d'interventions pour atténuer ces dommages, y compris les exigences légales pour marquer le contenu de l'IA avec des métadonnées et des filigranes imperceptibles, des limites de ce que les invites devraient être autorisées par les services et les systèmes pour relier les identités de l'utilisateur au contenu créé.

De plus, les modérateurs de contenu des médias sociaux devraient interdire les images et les vidéos nocives. En outre, Farid appelle à la maîtrise des médias numériques pour faire partie du programme éducatif standard. Farid résume les techniques d'authentification qui peuvent être utilisées par des experts pour trier le réel du synthétique, et explore le paysage politique autour du contenu nocif.

Enfin, Farid demande aux chercheurs de s'arrêter et de se demander si leur production de recherche peut être utilisée à mauvais escient et, dans l'affirmative, de prendre des mesures pour prévenir une mauvaise utilisation ou même abandonner le projet. Ce n'est pas parce que quelque chose peut être créé qu'il doit être créé.

Fourni par PNAS Nexus