Les robots apprennent à bouger en se regardant

En regardant leurs propres mouvements avec une caméra, les robots peuvent s’apprendre à la structure de leur propre corps et à la façon dont ils se déplacent, une nouvelle étude des chercheurs de Columbia Engineering révèle maintenant. Équipées de ces connaissances, les robots pouvaient non seulement planifier leurs propres actions, mais aussi surmonter les dommages à leur corps.

Les chercheurs ont détaillé leurs résultats dans la revue Intelligence de la machine de la nature.

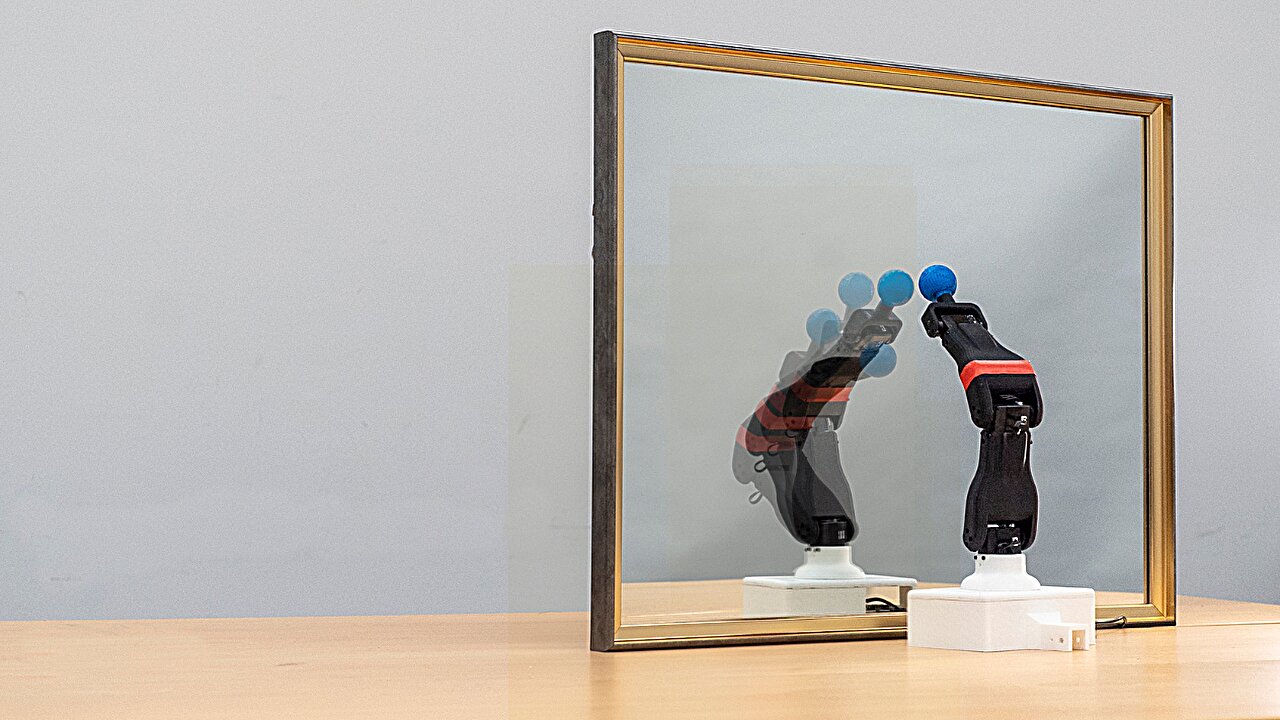

« Comme les humains apprenant à danser en regardant leur réflexion au miroir, les robots utilisent désormais une vidéo brute pour renforcer la conscience cinématique de soi », explique l’auteur principal de l’étude, Yuhang Hu, un doctorant au Creative Machines Lab de l’Université de Columbia, réalisé par Hod Lipson, James et Sally Scapa professeur d’innovation et présidente du Département du génie mécanique.

« Notre objectif est un robot qui comprend son propre corps, s’adapte aux dommages et acquiert de nouvelles compétences sans programmation humaine constante. »

La plupart des robots apprennent d’abord à se déplacer dans des simulations. Une fois qu’un robot peut se déplacer dans ces environnements virtuels, il est libéré dans le monde physique où il peut continuer à apprendre.

« Plus le simulateur est meilleur et plus réaliste, plus il est facile pour le robot de faire le saut de la simulation en réalité », explique Lipson.

Cependant, la création d’un bon simulateur est un processus ardu, nécessitant généralement des ingénieurs qualifiés. Les chercheurs ont enseigné à un robot comment créer un simulateur de lui-même simplement en regardant son propre mouvement à travers une caméra.

« Cette capacité permet non seulement d’économiser l’effort d’ingénierie, mais permet également à la simulation de continuer et d’évoluer avec le robot lorsqu’il subit l’usure, les dégâts et l’adaptation », explique Lipson.

Dans la nouvelle étude, les chercheurs ont plutôt développé un moyen pour les robots de modéliser de manière autonome leurs propres formes 3D en utilisant une seule caméra 2D ordinaire. Cette percée a été motivée par trois systèmes d’IA imitant le cerveau appelés réseaux de neurones profonds. Ceux-ci ont déduit le mouvement 3D de la vidéo 2D, permettant au robot de comprendre et de s’adapter à ses propres mouvements.

Le nouveau système pourrait également identifier les modifications des corps des robots, comme un virage dans un bras, et les aider à ajuster leurs mouvements pour se remettre de ces dommages simulés.

Une telle adaptabilité pourrait s’avérer utile dans une variété d’applications du monde réel. Par exemple, « Imaginez un vide du robot ou un bot d’assistant personnel qui remarque que son bras est plié après s’être heurté à des meubles », explique Hu. « Au lieu de décomposer ou d’avoir besoin d’une réparation, il se regarde, ajuste la façon dont il se déplace et continue de travailler. Cela pourrait rendre les robots de maison plus fiables – aucune reprogrammation constante requise. »

Un autre scénario pourrait impliquer un bras de robot qui est assuré de l’alignement dans une usine de voitures. « Au lieu d’arrêter la production, il pourrait se regarder, modifier ses mouvements et revenir à la soudage – en réduisant les temps d’arrêt et les coûts », explique Hu. « Cette adaptabilité pourrait rendre la fabrication plus résiliente. »

Alors que nous remettons des fonctions plus critiques aux robots, de la fabrication aux soins médicaux, nous avons besoin que ces robots soient plus résilients. « Nous, les humains, ne pouvons pas nous permettre de bébé constamment ces robots, de réparer les pièces cassées et d’ajuster les performances. Les robots doivent apprendre à prendre soin d’eux-mêmes s’ils deviennent vraiment utiles », explique Lipson. « C’est pourquoi l’auto-modélisation est si important. »

La capacité démontrée dans cette étude est la dernière d’une série de projets que l’équipe de Columbia a publiés au cours des deux dernières décennies, où les robots apprennent à devenir meilleurs pour l’auto-modélisation à l’aide de caméras et d’autres capteurs.

En 2006, les robots de l’équipe de recherche ont pu utiliser des observations pour ne créer que de simples simulations de type bâton d’eux-mêmes. Il y a environ dix ans, les robots ont commencé à créer des modèles de fidélité plus élevés en utilisant plusieurs caméras.

Dans cette étude, le robot a pu créer un modèle cinématique complet en soi en utilisant juste un court clip vidéo d’un seul appareil photo ordinaire, semblable à la recherche dans le miroir. Les chercheurs appellent cette nouvelle capacité «conscience de soi cinématique».

« Nous, les humains, sommes intuitivement conscients de notre corps; nous pouvons nous imaginer à l’avenir et visualiser les conséquences de nos actions bien avant d’exécuter ces actions en réalité », explique Lipson.

« En fin de compte, nous aimerions imprégner des robots avec une capacité similaire à s’imaginer, car une fois que vous pouvez vous imaginer à l’avenir, il n’y a pas de limite à ce que vous pouvez faire. »