Les régulateurs ont du mal à suivre le paysage rapide et compliqué des applications de thérapie d'IA

En l'absence de réglementation fédérale plus forte, certains États ont commencé à réglementer les applications qui offrent une «thérapie» de l'IA alors que de plus en plus de personnes se tournent vers l'intelligence artificielle pour des conseils de santé mentale.

Mais les lois, toutes adoptées cette année, ne traitent pas pleinement du paysage en évolution rapide du développement de logiciels de l'IA. Et les développeurs d'applications, les décideurs politiques et les défenseurs de la santé mentale disent que le patchwork des lois des États qui en résulte n'est pas suffisant pour protéger les utilisateurs ou tenir les créateurs de technologies nuisibles responsables.

« La réalité est que des millions de personnes utilisent ces outils et ils ne reviennent pas », a déclaré Karin Andrea Stephan, PDG et cofondatrice de l'application Mental Health Chatbot Earkick.

Les lois de l'État adoptent différentes approches. L'Illinois et le Nevada ont interdit l'utilisation de l'IA pour traiter la santé mentale. L'Utah a fixé certaines limites aux chatbots thérapeutiques, notamment en les obligeant à protéger les informations de santé des utilisateurs et à divulguer clairement que le chatbot n'est pas humain. La Pennsylvanie, le New Jersey et la Californie envisagent également des moyens de réguler la thérapie de l'IA.

L'impact sur les utilisateurs varie. Certaines applications ont bloqué l'accès dans les États ayant des interdictions. D'autres disent qu'ils n'apportent aucun changement car ils attendent plus de clarté juridique.

Et de nombreuses lois ne couvrent pas les chatbots génériques comme Chatgpt, qui ne sont pas explicitement commercialisés pour la thérapie mais sont utilisés par un nombre incalculable de personnes pour cela. Ces robots ont attiré des poursuites dans des cas horribles où les utilisateurs ont perdu leur emprise sur la réalité ou ont suivi leur vie après avoir interagi avec eux.

Vaile Wright, qui supervise l'innovation des soins de santé à l'American Psychological Association, a convenu que les applications pourraient répondre à un besoin, notant une pénurie nationale de prestataires de santé mentale, des coûts élevés de soins et un accès inégal pour les patients assurés.

Les chatbots en santé mentale qui sont enracinés dans la science, créés avec des contributions experts et surveillés par les humains pourraient changer le paysage, a déclaré Wright.

« Cela pourrait être quelque chose qui aide les gens avant de se mettre en crise », a-t-elle déclaré. « Ce n'est pas ce qui est sur le marché commercial actuellement. »

C'est pourquoi la réglementation fédérale et la surveillance sont nécessaires, a-t-elle déclaré.

Plus tôt ce mois-ci, la Federal Trade Commission a annoncé qu'elle ouvrait des demandes de renseignements sur sept sociétés de chatbot de l'IA, y compris les sociétés mères d'Instagram et Facebook, Google, Chatgpt, Grok (le chatbot sur X), le personnage.ai et le Snapchat – sur la façon dont ils « mesuraient, testent et surveillent les impacts potentiellement négatifs de cette technologie sur les enfants et les adolescents. Et la Food and Drug Administration convoque un comité consultatif le 6 novembre pour examiner les dispositifs de santé mentale génératifs compatibles AI.

Les agences fédérales pourraient considérer les restrictions sur la façon dont les chatbots sont commercialisés, limiter les pratiques addictives, exiger des divulgations aux utilisateurs qu'ils ne sont pas des prestataires médicaux, exigent que les entreprises suivent et signalent des pensées suicidaires et offrent des protections légales aux personnes qui signalent les mauvaises pratiques par les entreprises, a déclaré Wright.

Toutes les applications n'ont pas bloqué l'accès

Des « applications compagnes » aux « thérapeutes de l'IA » aux applications « bien-être mental », l'utilisation de l'IA dans les soins de santé mentale est variée et difficile à définir, sans parler d'écrire des lois.

Cela a conduit à différentes approches réglementaires. Certains États, par exemple, visent les applications compagnon conçues uniquement pour l'amitié, mais ne partez pas dans les soins de santé mentale. Les lois de l'Illinois et du Nevada interdisent des produits qui prétendent fournir un traitement de santé mentale, menaçant des amendes pouvant atteindre 10 000 $ en Illinois et 15 000 $ au Nevada.

Mais même une seule application peut être difficile à classer.

Stephan de Earkick a déclaré qu'il y avait encore beaucoup de choses « très boueuses » à propos de la loi de l'Illinois, par exemple, et que la société n'y a pas limité un accès.

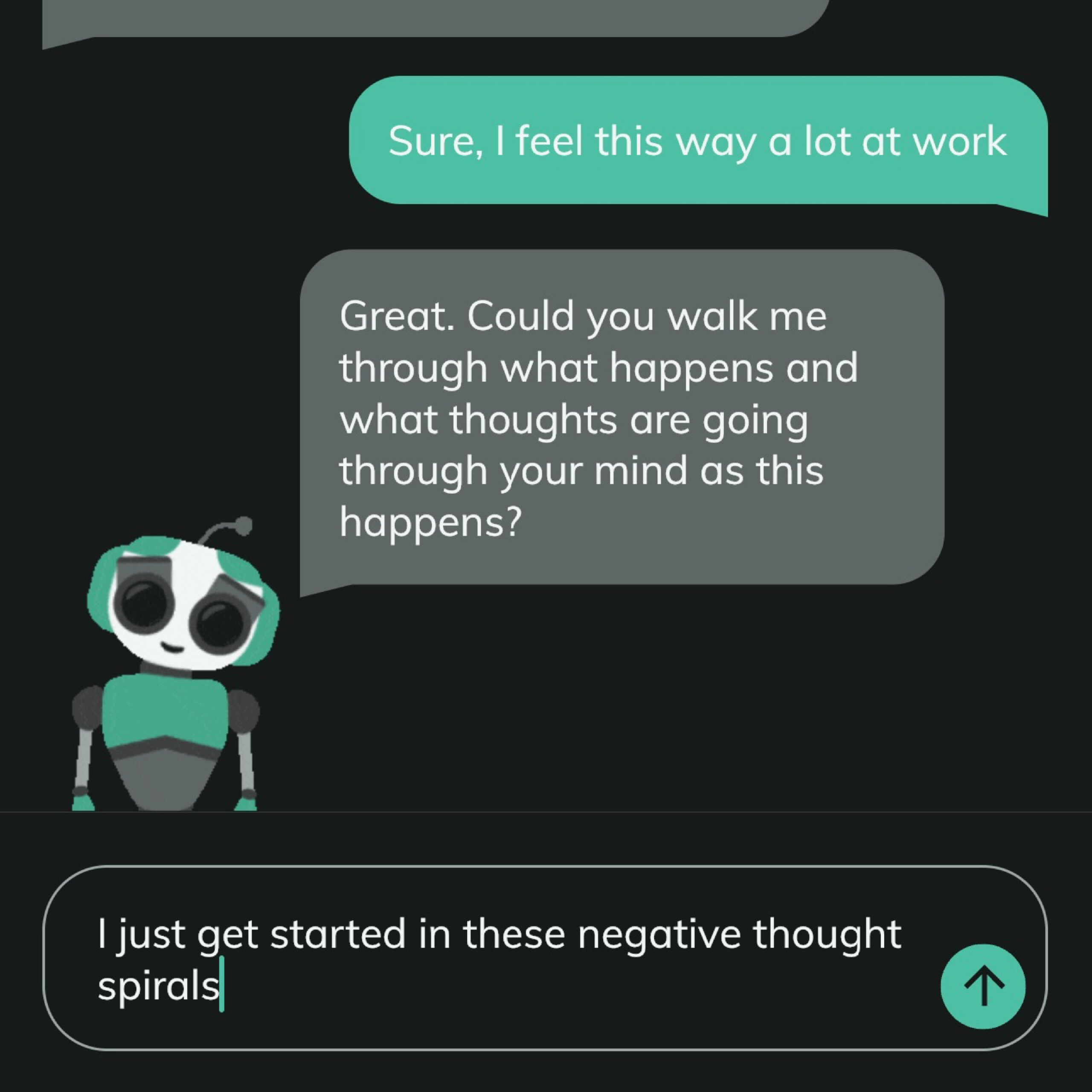

Stephan et son équipe ont initialement retenu l'appel de leur chatbot, qui ressemble à un panda de dessin animé, un thérapeute. Mais lorsque les utilisateurs ont commencé à utiliser le mot dans les critiques, ils ont adopté la terminologie afin que l'application apparaisse dans les recherches.

La semaine dernière, ils ont reculé en utilisant à nouveau la thérapie et les termes médicaux. Le site Web de Earkick a décrit son chatbot comme « votre conseiller d'empathique AI, équipé pour soutenir votre parcours de santé mentale », mais maintenant c'est un « chatbot pour les soins personnels ».

Pourtant, « nous ne diagnostiquons pas », a maintenu Stephan.

Les utilisateurs peuvent configurer un « bouton de panique » pour appeler un être cher de confiance s'ils sont en crise et que le chatbot « pousse » les utilisateurs à rechercher un thérapeute si leur santé mentale s'aggrave. Mais il n'a jamais été conçu pour être une application de prévention du suicide, a déclaré Stephan, et la police ne serait pas appelée si quelqu'un parlait au bot des pensées de l'automutilation.

Stephan a dit qu'elle était heureuse que les gens regardent l'IA avec un œil critique, mais s'inquiétaient de la capacité des États à suivre l'innovation.

« La vitesse à laquelle tout évolue est massive », a-t-elle déclaré.

D'autres applications ont immédiatement bloqué l'accès. Lorsque les utilisateurs de l'Illinois téléchargent l'application de thérapie AI Ash, un message les exhorte à envoyer un e-mail à leurs législateurs, arguant que la « législation erronée » a interdit les applications comme Ash « tout en laissant des chatbots non réglementés, il avait l'intention de réglementer gratuitement pour causer des dommages ».

Un porte-parole de Ash n'a pas répondu à plusieurs demandes d'interview.

Mario Treto Jr., secrétaire du Département de la réglementation financière et professionnelle de l'Illinois, a déclaré que l'objectif était finalement de s'assurer que les thérapeutes agréés étaient les seuls à suivre une thérapie.

« La thérapie est plus que des échanges de mots », a déclaré Treto. « Cela nécessite de l'empathie, il nécessite un jugement clinique, il nécessite une responsabilité éthique, dont aucune IA ne peut vraiment se reproduire dès maintenant. »

Une entreprise de chatbot essaie de reproduire pleinement la thérapie

En mars, une équipe basée à l'Université de Dartmouth a publié le premier essai clinique randomisé connu d'un chatbot d'IA génératif pour un traitement de santé mentale.

L'objectif était d'avoir le chatbot, appelé Therabot, de traiter les personnes diagnostiquées avec des troubles de l'anxiété, de la dépression ou de l'alimentation. Il a été formé sur des vignettes et des transcriptions écrites par l'équipe pour illustrer une réponse fondée sur des preuves.

L'étude a révélé que les utilisateurs ont évalué Therabot similaire à un thérapeute et présentaient des symptômes significativement inférieurs après huit semaines par rapport aux personnes qui ne l'utilisent pas. Chaque interaction a été surveillée par un humain qui est intervenu si la réponse du chatbot était nuisible ou non fondée sur des preuves.

Nicholas Jacobson, un psychologue clinicien dont le laboratoire mène la recherche, a déclaré que les résultats montraient une promesse précoce, mais que des études plus importantes sont nécessaires pour démontrer si Therabot travaille pour un grand nombre de personnes.

« L'espace est si dramatiquement nouveau que je pense que le domaine doit procéder avec beaucoup plus de prudence qui se produit en ce moment », a-t-il déclaré.

De nombreuses applications d'IA sont optimisées pour l'engagement et sont conçues pour soutenir tout ce que les utilisateurs disent, plutôt que de remettre en question les pensées des gens comme les thérapeutes. Beaucoup marchent sur la ligne de compagnie et de la thérapie, brouillant les pharmaciens des frontières d'intimité ne le feraient pas éthiquement.

L'équipe de Therabot a cherché à éviter ces problèmes.

L'application est toujours en test et pas largement disponible. Mais Jacobson s'inquiète de ce que les interdictions strictes signifieront pour les développeurs qui adoptent une approche attentive. Il a noté que l'Illinois n'avait pas de voie claire pour fournir une preuve qu'une application est sûre et efficace.

« Ils veulent protéger les gens, mais le système traditionnel en ce moment est vraiment des gens qui échouent », a-t-il déclaré. « Donc, essayer de rester avec le statu quo n'est vraiment pas la chose à faire. »

Les régulateurs et les défenseurs des lois disent qu'ils sont ouverts aux changements. Mais les chatbots d'aujourd'hui ne sont pas une solution à la pénurie de prestataires de santé mentale, a déclaré Kyle Hillman, qui a fait pression pour les projets de loi de l'Illinois et du Nevada grâce à son affiliation avec la National Association of Social Workers.

« Tous ceux qui se sentent tristes n'ont pas besoin d'un thérapeute », a-t-il déclaré. Mais pour les personnes ayant de vrais problèmes de santé mentale ou des pensées suicidaires, « leur disant: » Je sais qu'il y a une pénurie de main-d'œuvre, mais voici un bot « – c'est une position si privilégiée. »