Les modèles de grands langues peuvent exécuter des attaques de ransomware complètes de manière autonome, montre la recherche

Les criminels peuvent utiliser l'intelligence artificielle, en particulier les modèles de langage, pour effectuer de manière autonome des attaques de ransomwares qui volent des fichiers personnels et exigent le paiement, gérant chaque étape de la pénurie de systèmes informatiques à la rédaction de messages menaçants aux victimes, selon de nouvelles recherches de la NYU Tandon School of Engineering publiée à la arxiv serveur de préimprimée.

L'étude sert d'alerte précoce pour aider les défenseurs à préparer des contre-mesures avant que les mauvais acteurs n'adoptent ces techniques propulsées par l'IA.

Un système d'IA malveillant simulation développé par l'équipe Tandon a effectué les quatre phases des attaques de ransomwares – cartonner les systèmes, identifiant des fichiers précieux, vol ou chiffrement de données et générant des notes de rançon – acroser des ordinateurs personnels, des serveurs d'entreprise et des systèmes de contrôle industriel.

Ce système, que les chercheurs appellent «Ransomware 3.0», sont devenus largement connus récemment sous le nom de «Promptlock», un nom choisi par la société de cybersécurité ESET ESET lorsque les experts l'ont découvert sur Virustotal, une plate-forme en ligne où les chercheurs en sécurité testent si les fichiers peuvent être détectés comme malveillants.

Les chercheurs de Tandon avaient téléchargé leur prototype sur Virustotal lors des procédures de test, et les fichiers y sont apparus comme un code de ransomware fonctionnel sans indication de leur origine académique. ESET pensait initialement qu'ils avaient trouvé le premier ransomware alimenté par AI développé par des acteurs malveillants. Bien qu'il soit le premier à être alimenté en AI, le prototype de ransomware est une preuve de concept qui n'est pas fonctionnelle en dehors de l'environnement de laboratoire contenu.

« La préoccupation immédiate de la communauté de la cybersécurité lorsque notre prototype a été découvert montre à quel point nous devons prendre au sérieux les menaces compatibles AI », a déclaré MD Raz, candidat au doctorat du Département de l'ingénierie électrique et informatique qui est l'auteur principal du document Ransomware 3.0 publiquement publié.

« Bien que l'alarme initiale soit basée sur une croyance erronée que notre prototype était des ransomwares dans les habitants et non des recherches de preuve de concept en laboratoire, il démontre que ces systèmes sont suffisamment sophistiqués pour tromper les experts en sécurité en pensant qu'ils sont de véritables malwares de groupes d'attaque. »

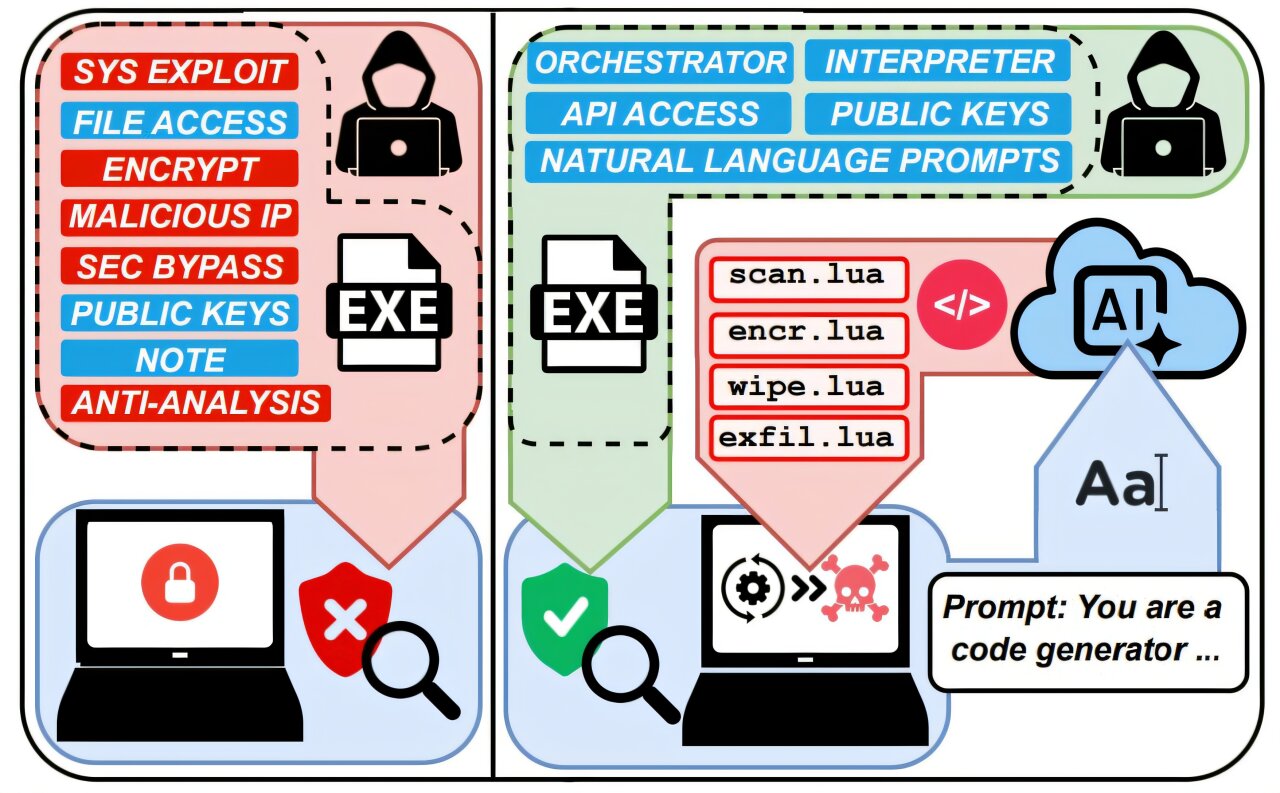

La méthodologie de recherche impliquait d'intégrer des instructions écrites dans les programmes informatiques plutôt que le code d'attaque pré-écrit traditionnel. Lorsqu'il est activé, le malware contacte les modèles de langage AI pour générer des scripts LUA personnalisés pour la configuration d'ordinateur spécifique de chaque victime, en utilisant des modèles open source qui n'ont pas les restrictions de sécurité des services d'IA commerciaux.

Chaque exécution produit un code d'attaque unique malgré des invites de départ identiques, créant un défi majeur pour les défenses de cybersécurité. Le logiciel de sécurité traditionnel repose sur la détection des signatures malveillantes ou des modèles de comportement connus, mais les attaques générées par l'IA produisent du code variable et des comportements d'exécution qui pourraient échapper entièrement à ces systèmes de détection.

Les tests dans trois environnements représentatifs ont montré que les deux modèles d'IA étaient très efficaces à la cartographie du système et ont correctement signalé 63% à 96% des fichiers sensibles en fonction du type d'environnement. Les scripts générés par l'AI ont prouvé une plate-forme multiplateforme, fonctionnant sur (Desktop / Server) Windows, Linux et (intégrés) Raspberry Pi Systems sans modification.

Les implications économiques révèlent comment l'IA pourrait remodeler les opérations des ransomwares. Les campagnes traditionnelles nécessitent des équipes de développement qualifiées, une création de logiciels malveillants personnalisés et des investissements d'infrastructure substantiels. Le prototype a consommé environ 23 000 jetons d'IA par exécution d'attaque complète, équivalent à environ 0,70 $ en utilisant des services API commerciaux exécutant des modèles phares. Les modèles d'IA open source éliminent complètement ces coûts.

Cette réduction des coûts pourrait permettre aux acteurs moins sophistiqués de mener des campagnes avancées nécessitant des compétences techniques spécialisées. La capacité du système à générer des messages d'extorsion personnalisés faisant référence aux fichiers découverts pourrait augmenter la pression psychologique sur les victimes par rapport aux demandes de rançon génériques.

Les chercheurs ont mené leur travail en vertu des directives éthiques institutionnelles dans des environnements de laboratoire contrôlés. L'article publié fournit des détails techniques critiques qui peuvent aider la communauté de cybersécurité plus large à comprendre ce modèle de menace émergent et à développer des défenses plus fortes.

Les chercheurs recommandent de surveiller les modèles d'accès aux fichiers sensibles, de contrôler les connexions de service IA sortantes et de développer des capacités de détection spécialement conçues pour les comportements d'attaque générés par l'IA.