Les lunettes intelligentes capturent les démos des tâches à la première personne

Au cours des dernières décennies, les robots ont progressivement commencé à se diriger vers divers paramètres du monde réel, y compris certains centres commerciaux, aéroports et hôpitaux, ainsi que quelques bureaux et ménages.

Pour que les robots soient déployés à plus grande échelle, servant d'assistants quotidiens fiables, ils devraient être en mesure d'effectuer une large gamme de tâches manuelles et de tâches courantes, telles que le nettoyage, le lavage de la vaisselle, la cuisson et la buanderie.

La formation des algorithmes d'apprentissage automatique qui permettent aux robots de terminer avec succès ces tâches peuvent être difficiles, car elles nécessitent souvent des données annotées et / ou des vidéos de démonstration annotées montrant les tâches. La conception de méthodes plus efficaces pour collecter des données pour former des algorithmes de robotique pourrait donc être très avantageuse, car elle pourrait aider à élargir davantage les capacités des robots.

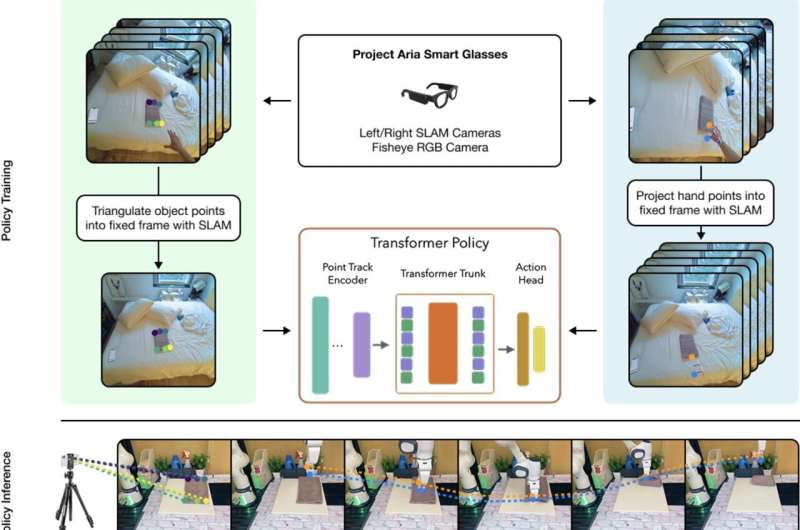

Des chercheurs de l'Université de New York et de l'UC Berkeley ont récemment introduit Egozero, un nouveau système pour collecter des démonstrations centrées sur l'ego d'humains accomplissant des tâches manuelles spécifiques. Ce système, introduit dans un article publié sur le arxiv Preprint Server, s'appuie sur l'utilisation des lunettes Aria Project, les lunettes intelligentes pour la réalité augmentée (AR) développée par Meta.

« Nous pensons que la robotique à usage général est goulot d'étranglement par un manque de données à l'échelle d'Internet, et que la meilleure façon de résoudre ce problème serait de collecter et d'apprendre des données humaines à la première personne », a déclaré Lerrel Pinto, auteur senior du journal, à Tech Xplore.

« Les principaux objectifs de ce projet étaient de développer un moyen de collecter des données marquées à l'action précises pour la formation des robots, d'optimiser pour l'ergonomie des vêtements de collecte de données nécessaires et de transférer les comportements humains dans des politiques de robot avec zéro données de robot. »

Egozero, le nouveau système développé par Pinto et ses collègues, s'appuie sur le projet Aria Smart Glasses pour collecter facilement les démonstrations vidéo des humains accomplissant des tâches tout en effectuant des actions exécutables de robot, capturées du point de vue de la personne portant les lunettes.

Ces démonstrations peuvent à leur tour être utilisées pour former des algorithmes de robotique sur de nouvelles politiques de manipulation, ce qui pourrait à son tour permettre aux robots de terminer avec succès diverses tâches manuelles.

« Contrairement aux travaux antérieurs qui nécessitent plusieurs caméras calibrées, des appareils portables du poignet ou des gants de capture de mouvement, Egozero est unique en ce qu'il est capable d'extraire ces représentations 3D avec seulement des lunettes intelligentes (Project Aria Smart Glasses) », a expliqué Ademi Adeniji, étudiant et co-chef d'auteur de The Paper.

« En conséquence, les robots peuvent apprendre une nouvelle tâche à partir de 20 minutes de démonstrations humaines, sans téléopération. »

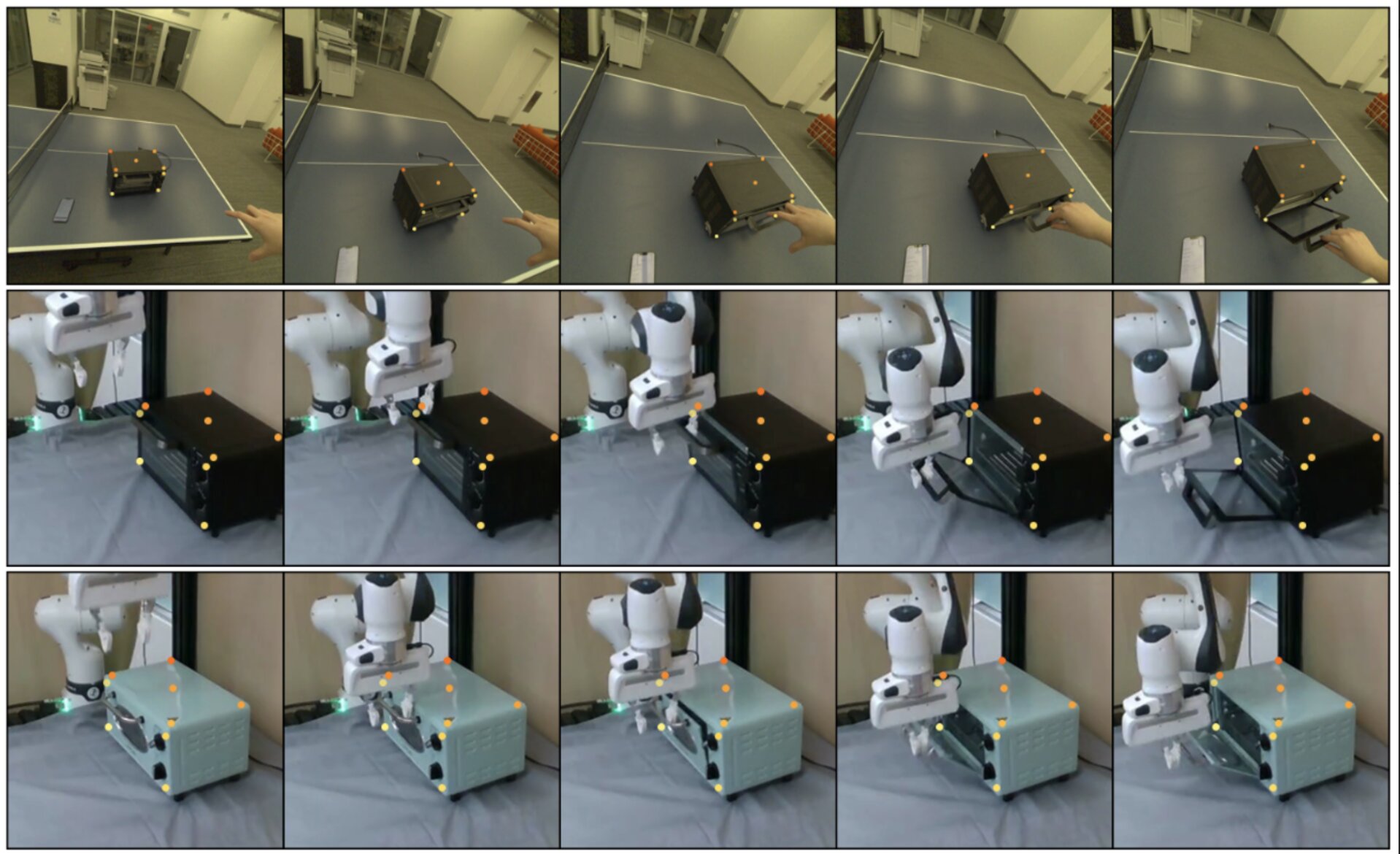

Pour évaluer leur système proposé, les chercheurs l'ont utilisé pour collecter des démonstrations vidéo d'actions simples qui sont couramment achevées dans un environnement domestique (par exemple, ouvrir une porte de four), puis ont utilisé ces démonstrations pour former un algorithme d'apprentissage automatique.

L'algorithme d'apprentissage automatique a ensuite été déployé sur Franka Panda, un bras robotique avec une pince attachée à sa fin. Notamment, ils ont constaté que le bras robotique a accompli avec succès la plupart des tâches sur lesquelles ils l'ont testé, même si l'algorithme planifiant ses mouvements a subi une formation minimale.

« La plus grande contribution d'Egozero est qu'elle peut transférer des comportements humains dans des politiques de robot avec des données de robot zéro, avec juste une paire de lunettes intelligentes », a déclaré Pinto.

« Il étend les travaux antérieurs (politique ponctuelle) en montrant que les représentations 3D permettent un apprentissage efficace des robots des humains, mais complètement dans le monde. Nous espérons que cela servira de base à l'exploration future des représentations et des algorithmes pour permettre l'apprentissage de l'homme à robot à grande échelle. »

Le code du système de collecte de données introduit par Pinto et ses collègues a été publié sur GitHub et peut être facilement accessible par d'autres équipes de recherche.

À l'avenir, il pourrait être utilisé pour collecter rapidement des ensembles de données pour former des algorithmes robotiques, ce qui pourrait contribuer au développement des robots, facilitant finalement leur déploiement dans un plus grand nombre de ménages et de bureaux dans le monde.

« Nous espérons maintenant explorer les compromis entre les représentations 2D et 3D à plus grande échelle », a ajouté Vincent Liu, étudiant et co-auteur du journal.

« Egozero et les travaux passés (Point Policy, P3PO) n'ont exploré que des politiques 3D une seule tâche, il serait donc intéressant d'étendre ce cadre d'apprentissage à partir de points 3D sous la forme d'un LLM / VLM de réglage fin, similaire à la façon dont les modèles VLA modernes sont formés. »

Écrit pour vous par notre auteur Ingrid Fadelli, édité par Lisa Lock, et vérifié et examiné par Robert Egan – cet article est le résultat d'un travail humain minutieux. Nous comptons sur des lecteurs comme vous pour garder le journalisme scientifique indépendant en vie. Si ce rapport vous importe, veuillez considérer un don (surtout mensuel). Vous obtiendrez un sans publicité compte comme un remerciement.