Les informaticiens développent des solutions pour rendre les modèles d’IA plus efficaces et personnalisables

L’intelligence artificielle (IA) est partout – des chatbots que nous consultons pour le support client aux outils prédisant comment les maladies pourraient se propager. Mais la puissance de calcul et l’énergie requises pour alimenter les modèles d’IA modernes – tels que les modèles de gros langues (LLM) – peuvent les rendre coûteux, inaccessibles et éprouvants pour l’environnement. Une équipe de chercheurs de l’Université Rice travaille sur des solutions pour changer cela.

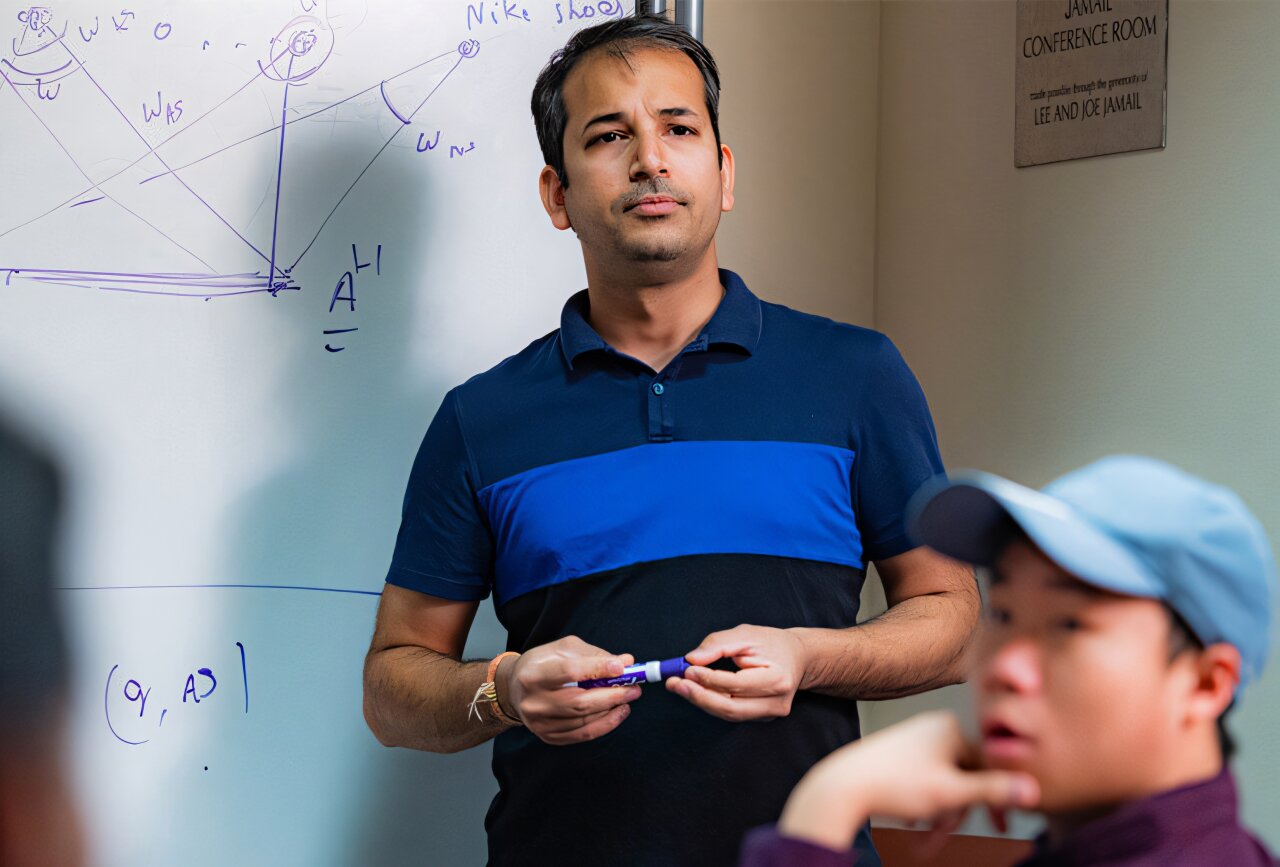

« L’intelligence artificielle générative en est encore à ses balbutiements en ce qui concerne une intégration plus large », a déclaré Anshumali Shrivastava, professeur agrégé d’informatique, d’ingénierie électrique et informatique et de statistiques et membre du Rice’s Ken Kennedy Institute. « Nous avons un long chemin à parcourir jusqu’à ce que nous voyions le plein potentiel de cette technologie en jeu. »

Shrivastava a expliqué que l’intégration réussie de l’IA implique des entreprises et des organisations ayant accès à des systèmes d’IA experts qui peuvent exploiter leur infrastructure de données en toute sécurité pour effectuer des tâches hautement spécialisées.

« Pour une IA pour bien résoudre les problèmes de physique, il doit être construit par les physiciens, et l’IA qui résout un problème médical doit être construite par des experts médicaux », a déclaré Shrivastava.

Plus facile à dire qu’à faire: le bâtiment LLMS à partir de zéro est un ascenseur majeur en termes de travail, d’énergie et de données. Dans la plupart des cas, afin de déployer des LLM dans des paramètres spécifiques au contexte tout en préservant la sécurité des données, la seule option disponible est de personnaliser les modèles existants.

Shrivastava et plusieurs membres de son groupe de recherche ont présenté trois de leurs avancées les plus récentes dans les ajustements LLMS pour mieux répondre aux besoins des utilisateurs lors de la dernière convenance des systèmes de traitement de l’information neuronale de la conférence de l’IA (INIPS) à Vancouver, en Colombie-Britannique, en décembre 2024.

Les trois articles développent des alternatives supérieures à des stratégies populaires telles que les approximations de faible rang et les quantifications standard, présentant le potentiel d’impact et la créativité de la recherche sur l’IA au riz.

Les LLM sont des systèmes de réseau neuronal qui apprennent et traitent les données du langage. Ces algorithmes sont équipés de paramètres ou de variables qui déterminent comment l’entrée (disons, une invite de chatppt) est transformée en sortie (un brouillon par e-mail).

Le « grand » dans LLM pointe la tendance au cours de la dernière décennie pour équiper les modèles de plus en plus de paramètres et de données, car cela se traduit par une intelligence améliorée. À son tour, cela a entraîné une augmentation significative de la puissance de calcul et de la mémoire nécessaire pour former et déployer les modèles; D’où l’empreinte de mémoire et d’énergie notoirement grande de LLMS.

L’un des articles de l’équipe Rice présentés chez Nerips explore un concept Shrivastava appelle le «partage des paramètres», introduisant des transformations structurées de croquis (SS1) – une méthode pour gérer les vastes tableaux de nombres, appelés matrices de poids ou mémoire de travail, sur lesquelles les modèles d’IA s’appuient sur faire des prédictions et des décisions.

SS1 exploite le partage des paramètres, une idée fondamentale des algorithmes probabilistes, pour réduire la mémoire et les besoins de calcul du modèle tout en maintenant son expressivité et sa précision. Par exemple, lorsqu’il est appliqué aux LLM populaires, la technique SS1 a accéléré des délais de traitement de plus de 11% sans nécessiter de réglage fin supplémentaire.

Aujourd’hui, les LLM – et plus largement, les modèles de fondation – se répercutent sur un matériel coûteux et avalé de puissance appelé GPU (unités de traitement graphique) pour effectuer les millions de calculs dont ils ont besoin. Cela signifie que les modèles de fondation sont souvent confinés aux centres de données appartenant à de grandes entreprises technologiques ou nécessitent du matériel coûteux loin de la portée de la plupart des personnes ou des petites organisations.

L’équipe de Shrivastava a développé un algorithme qui permet aux LLM de s’exécuter efficacement sur des processeurs informatiques standard (CPU) au lieu des GPU. Ce travail, décrit dans un deuxième article présenté chez Neirips, tire parti des capacités matérielles propres des CPU pour repenser comment les calculs se produisent: l’algorithme d’attention nomade remplace les opérations complexes par une alternative intelligente, en utilisant une fonctionnalité de l’architecture de mémoire des CPU d’une manière plus rapide qui est plus rapide et plus rapide, et moins à forte intensité de ressources.

« Notre algorithme fait que tout fonctionne deux fois plus rapidement sans aucune perte de précision », a déclaré Tianyi Zhang, un doctorant de riz en groupe de recherche de Shrivastava et premier auteur sur deux des articles présentés à Neirips.

Cette percée signifie que dans un avenir proche, les outils AI avancés pourraient non seulement vivre dans le cloud mais pourrait fonctionner directement sur un téléphone ou un ordinateur portable.

Un autre défi auquel les chercheurs des chercheurs sont confrontés est de gérer la mémoire de contexte. Les grands modèles d’IA n’ont pas seulement besoin de processeurs puissants – ils nécessitent également d’énormes quantités de mémoire à grande vitesse pour stocker leurs «pensées». Par exemple, les LLM comme Chatgpt gardent un « bloc-notes » temporaire de tout ce qu’ils ont vu dans une conversation. Connu sous le nom de «valeur clé» ou «kv-cache», cette mémoire se développe à mesure que la conversation se poursuit, tendant rapidement même les systèmes les plus avancés.

Dans un troisième article, l’équipe a introduit la «quantification couplée», une méthode pour compresser cette mémoire sans perdre la qualité des réponses du modèle. Les méthodes traditionnelles compressent chaque élément d’information individuellement, mais l’équipe de Shrivastava a réalisé que cette approche manque un élément clé de l’image: les différents morceaux de mémoire sont interconnectés. En compressant les pièces connexes ensemble, leur méthode réalise une efficacité beaucoup plus grande.

« Nous avons constaté que nous pouvions réduire la mémoire jusqu’à un bit par morceau d’informations – en grande partie la plus petite taille possible – tout en préservant toujours les performances du modèle », a déclaré Zhang. « À ma connaissance, nous sommes les premiers à y parvenir. »

Le travail de Shrivastava reflète une vision plus large de l’avenir de l’IA, où une IA avancée est disponible pour tous, pas seulement les géants de la technologie. Seule une poignée d’organisations disposent actuellement des ressources pour former et affiner les LLM, ce qui laisse la plupart des entreprises dépendantes des systèmes préfabillés. Shrivastava a déclaré qu’il voyait un avenir où chaque organisation pourrait créer ses propres outils d’IA adaptés à ses besoins spécifiques sans se ruiner.

Mais y arriver nécessitera plus que des percées techniques. Comme le souligne Shrivastava, « Nous ne faisons que gratter la surface de ce que l’IA peut faire, et déjà les demandes d’énergie et d’informatique sont importantes. Si nous voulons un avenir où l’IA résout les problèmes des soins de santé, de la science du climat, etc., nous avons besoin Pour le rendre beaucoup plus efficace.