« Les chatbots ne sont rien de plus que des machines de plagiar »

En 2021, le monde n'avait pas encore appris ce qui allait arriver, mais Emily Bender – linguiste et professeur à l'Université de Washington – était très claire. C'est alors qu'il a copié une étude célèbre dans laquelle il a décrit les modèles d'IA existants comme des «perroquets stochastiques». Depuis lors, cette expression est devenue l'une des meilleures façons de définir le fonctionnement de base de Chatgpt. Et quatre ans plus tard, cet expert réaffirme en position: il est sceptique avec des arguments.

Perroquets stochastiques. L'idée fondamentale de son analogie était de comparer les modèles qui étaient alors (parmi lesquels GPT-3, précurseur de l'usage dans le chatppt) comme perroquets stochastiques. Les « perroquets » sont clairs, car les modèles répètent essentiellement ce qu'on leur dit par la formation. Le « stochastique », un terme non si bien connu, fait référence au fait que le LLM ne répète pas de manière déterministe ou correcte, mais prédit de manière probabiliste quel est le mot suivant dans une séquence basée sur le contexte.

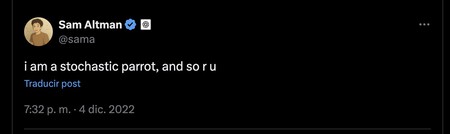

Les humains ne sont pas des humains? Sam Altman a ramassé le gant un an plus tard, alors que l'expression était déjà connue. Il l'a fait le 4 décembre 2022, quatre jours après la libération de Chatgpt. Il voulait essayer de nous faire voir que, selon lui, les êtres humains étaient aussi des perroquets stochastiques. Dans un sens, nous sommes: nous apprenons les modèles de langage et les phrases répétées que nous entendons en plus de prédire ce qui vient ensuite dans une conversation. Cependant, il existe des différences critiques avec les modèles d'IA.

- Nous comprenons ce que nous disons, tandis que le LLM non

- Nous avons la sensibilisation et l'intentionnalité lorsque nous parlons, nous produisons non seulement des séquences probables

- Nous avons un raisonnement abstrait et nous sommes en mesure d'adapter la raison, de généraliser et de corriger nos erreurs de manière flexible: notre pensée n'est pas purement statistique

Sceptiques déclarés. Emily Bender n'a pas changé d'avis au cours de toutes ces années. En fait, il vient de publier son livre, «L'IA avec» (quelque chose comme «le Timo de l'IA») sur lequel il développe précisément les arguments sur lesquels il fonde ses réserves et son scepticisme concernant l'intelligence artificielle. Dans une récente interview avec Financial Times, Bender a souligné que les chatbots d'AIS ne sont rien de plus que des « machines de plagiat » et que les grands modèles de langue (LLM) sur lesquels ils sont basés « sont nés en tant que merde ».

Ils nous ont vendu un mensonge. Cet expert estime que les entreprises génératives nous ont vendu un mensonge. Ses modèles, dit-il, ne tiendront pas ces promesses, mais ils ne mettront pas fin à la race humaine, comme certains ont voulu avertir. Malgré toutes les attentes générées, à leur avis, les chatbots sont mauvais dans la plupart des tâches et même les meilleurs modèles d'aujourd'hui ont encore quelque chose de similaire à l'intelligence.

Et de « raisonnement », rien. Les nouveaux modes de «raisonnement» qui soulèvent des modèles tels que O1, O3 ou Deepseek R1 sont un autre mensonge à leur avis, et cette déclaration selon laquelle ils comprennent que le monde n'a aucun sens. Nous « imaginons un esprit derrière les textes (générés) », explique-t-il, « mais toute cette compréhension vient de notre côté », pas celle de l'IA.

Ce n'est pas l'intelligence, c'est l'automatisation. Bender, qui a actuellement 51 ans, a passé ses premières années académiques à Stanford et Berkeley, et a fini par travailler comme professeur à l'Université de Washington, où il s'est spécialisé dans la façon dont les ordinateurs se moquent du langage humain. À son avis, le nom de l'intelligence artificielle lui-même est exagéré – un ancien débat – et doit simplement être appelé l'automatisation.

Chatbots contrôlés par la puissance. Dans son livre «The Ai with», elle et son co-auteur, Alex Hanna, mettent en garde contre le danger des modèles actuels de l'IA. D'autant plus qu'ils sont contrôlés par les grandes entreprises ayant certains intérêts. «Grâce aux énormes sommes investies, une petite clique de caméra a la capacité d'influencer ce qui arrive aux grandes bandes de la société, explique-t-il.

Trop . Et devant les discours et promesses d'Altman ou d'Amodei, qui promettent que nous arriverons bientôt à l'AGI ou que l'IA remplace des millions de travailleurs, la vision de Bender est beaucoup plus sceptique. Pour elle, ce n'est rien de plus qu'un « beau emballage pour les feuilles de calcul », mais il n'y a ni magie ni esprit émergent.

Une balle magique 8 avec des prétentions. Sa vision sceptique va à l'encontre de personnalités telles que Sam Altman ou Elon Musk, qui n'arrête pas de promettre toutes sortes de révolutions. « Le fait que tout le monde croit que cette (IA) est une entité pensante va à leur avantage et très puissante », explique-t-il, « au lieu de faire penser aux gens que ce n'est rien de plus qu'une balle magique avec des prétentions », pointant ce jouet que Agitas vous posait une question et vous répond avec un « oui », « non », « dépend » ou d'autres options.

Image | Wikimedia | Village Global

Dans Simseo | Chatgpt emmène certaines personnes au bord de la folie. La réalité est moins alarmiste et beaucoup plus complexe