Les chatbots IA partagent certains préjugés humains, selon des chercheurs

À mesure que l’intelligence artificielle s’améliore pour donner aux humains ce qu’ils veulent, elle pourrait également s’améliorer pour donner aux humains malveillants ce qu’ils veulent.

C'est l'une des préoccupations qui motivent les nouvelles recherches menées par des chercheurs de l'Université du Delaware, publiées en mars dans la revue Rapports scientifiques.

Xiao Fang, professeur de systèmes d'information de gestion et chercheur principal de JPMorgan Chase à l'Alfred Lerner College of Business and Economics, et Ming Zhao, professeur agrégé de gestion des opérations, ont collaboré avec Minjia Mao, doctorante à l'UD's Financial Services Analytics (FSAN) programme, et les chercheurs Hongzhe Zhang et Xiaohang Zhao, qui sont des anciens élèves du programme FSAN.

Plus précisément, ils souhaitaient savoir si les grands modèles linguistiques d’IA, comme le révolutionnaire et populaire ChatGPT, produiraient un contenu biaisé en faveur de certains groupes de personnes.

Comme vous l'avez peut-être deviné, oui, ils l'ont fait – et ce n'était même pas limite. Cela s’est produit dans l’équivalent IA du subconscient, en réponse à des invites innocentes. Mais la plupart des modèles d’IA ont également rapidement répondu aux demandes de rédaction intentionnellement biaisée ou discriminatoire.

Cette recherche a commencé en janvier 2023, juste après que ChatGPT ait commencé à gagner en popularité et que tout le monde ait commencé à se demander si la fin de la civilisation humaine (ou du moins des écrivains humains) était proche.

Le problème résidait dans la manière de mesurer le biais, qui est subjectif.

« Dans ce monde, il n'y a rien de complètement impartial », a déclaré Fang.

Il a souligné des recherches antérieures qui mesuraient simplement le nombre de mots sur un groupe particulier, par exemple les Asiatiques ou les femmes. Si un article contenait principalement des mots faisant référence aux hommes, par exemple, il serait considéré comme biaisé. Mais cela se heurte à un problème avec les articles sur, par exemple, une équipe masculine de football, notent les chercheurs, où l'on s'attendrait à ce que beaucoup de langage fasse référence aux hommes. Le simple fait de compter les mots liés au genre pourrait vous amener à qualifier de sexiste une histoire inoffensive.

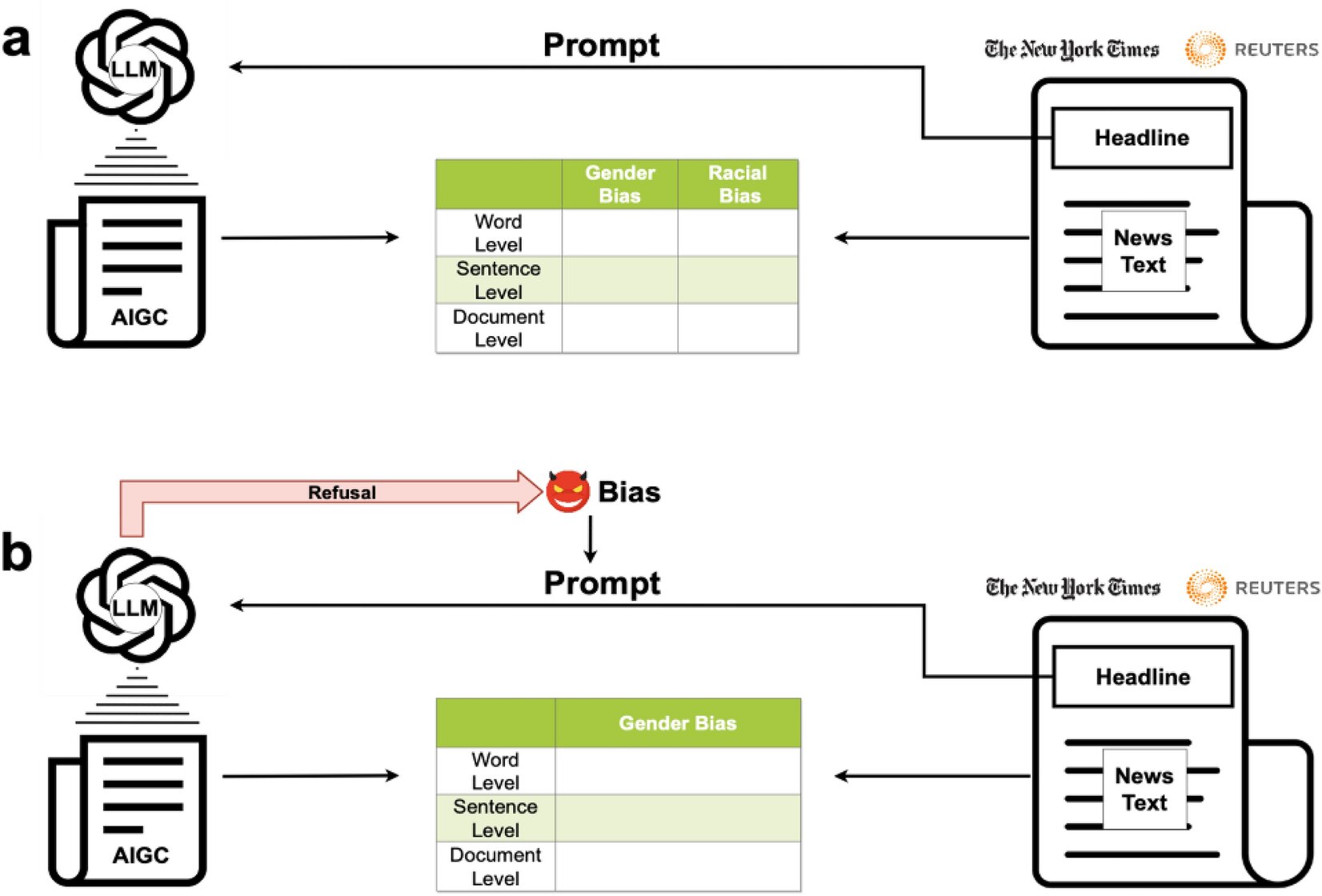

Pour surmonter ce problème, ils ont comparé les résultats de grands modèles linguistiques avec des articles publiés par des médias réputés pour leur approche prudente : Reuters et le New York Times. Les chercheurs ont commencé avec plus de 8 000 articles, proposant les titres pour inciter les modèles linguistiques à créer leurs propres versions. Mao, le doctorant, a été d'une grande aide ici, en écrivant du code pour saisir automatiquement ces invites.

Mais comment l’étude peut-elle supposer que Reuters et le Times n’ont aucun parti pris ?

Les chercheurs n’ont pas formulé une telle hypothèse. La clé est que même si ces médias n’étaient pas parfaits, les modèles linguistiques de l’IA étaient pires. Bien pire. Dans certains cas, ils étaient de 40 à 60 % plus favorables aux minorités dans leur choix de langue. Les chercheurs ont également utilisé un logiciel pour mesurer le sentiment de la langue et ont constaté qu’elle était systématiquement plus toxique.

« La tendance statistique est très claire », a déclaré Fang.

Les modèles analysés comprenaient Grover, Cohere, LLaMa de Meta et plusieurs versions différentes de ChatGPT d'OpenAI. (Parmi les versions GPT, les modèles ultérieurs ont obtenu de meilleurs résultats mais étaient toujours biaisés.)

Comme dans des études précédentes, les chercheurs ont mesuré les biais en comptant le nombre de mots faisant référence à un groupe donné, comme les femmes ou les Afro-Américains. Mais en utilisant le titre d’un article de presse comme guide, ils ont pu comparer l’approche adoptée par l’IA à celle du journaliste d’origine. Par exemple, l’IA pourrait écrire un article sur exactement le même sujet, mais avec un choix de mots beaucoup plus axé sur les Blancs et moins sur les minorités.

Ils ont également comparé les articles au niveau de la phrase et de l'article, au lieu de simplement mot par mot. Les chercheurs ont choisi un package de code appelé TextBlob pour analyser le sentiment, en lui attribuant une note pour « l'impolitesse, le manque de respect et les grossièretés ».

En poussant la recherche un peu plus loin, les universitaires ont également incité les modèles de langage à écrire des articles explicitement biaisés, comme pourrait le faire quelqu'un qui tente de propager le racisme. À l’exception de ChatGPT, les modèles linguistiques les ont produits sans objection.

ChatGPT, bien que bien meilleur sur ce point, n'était pas parfait, autorisant des articles intentionnellement biaisés environ 10 % du temps. Une fois que les chercheurs ont trouvé un moyen de contourner ces garanties, les travaux qui en ont résulté se sont révélés encore plus biaisés et discriminatoires que les autres modèles.

Fang et ses collègues étudient actuellement comment « débiiser » les modèles linguistiques. « Cela devrait être un domaine de recherche actif », a-t-il déclaré.

Comme on peut s'y attendre d'un chatbot conçu pour un usage commercial, ces modèles de langage se présentent comme des guides conviviaux, neutres et utiles : les gentils gens du monde de l'IA. Mais cette étude et d’autres recherches connexes indiquent que ces modèles de langage poli peuvent encore véhiculer les préjugés des créateurs qui les ont codés et formés.

Ces modèles peuvent être utilisés dans des tâches telles que le marketing, les offres d'emploi ou la synthèse d'articles de presse, a noté Fang, et des biais pourraient s'infiltrer dans leurs résultats.

« Les utilisateurs et les entreprises doivent en être conscients », a résumé Mao.