Les Big Tech investissent des milliards de dollars dans les GPU pour l’IA. 95% sont inactifs

Lorsque la pandémie de COVID-19 a commencé, le papier toilette et la levure ont volé hors des supermarchés. Du papier parce que c’est un bien de base, mais de la levure parce que tout le monde allait faire beaucoup de pain à la maison. C’était la prévision, mais il faudrait vraiment voir combien d’entre nous finiraient par faire du pain. Eh bien, quelque chose de similaire se produit actuellement dans les centres de données. Les hyperscalers ont dépensé des milliards et des milliards de dollars en GPU pour l’IA, et selon un rapport, 95 % d’entre eux sont inactifs la plupart du temps.

Et tout cela à cause de la peur d’être exclu.

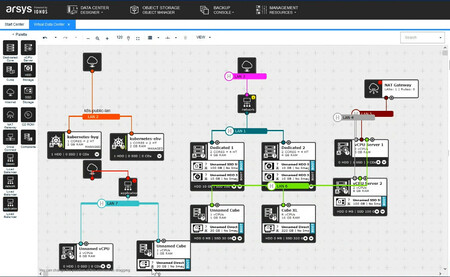

Kubernetes. Avant d’entrer dans le vif du sujet, il y a une notion sur laquelle il faut se poser. C’est celui de kubernetes. Il s’agit d’une sorte de « système d’exploitation » dans les centres de données, le contremaître qui organise et surveille tous les logiciels utilisés. Imaginez qu’un centre de données soit un supermarché, que les rayons soient les serveurs et que les produits soient les applications.

Exemple de panneau de contrôle

Ce contremaître trouve l’étagère parfaite pour placer le produit de la manière la plus optimale possible. De plus, il surveille en permanence tous les rayons dans le but de ne rien manquer et de s’assurer que le flux de données soit parfait. C’est en bref un logiciel qui gère de nombreux serveurs physiques de manière très optimisée et 24h/24 et 7j/7.

Ce qui se passe. Cela dit, le rapport 2026 State of Kubernetes Optimization Report préparé par Cast AI vient de révéler quelque chose : la formidable inefficacité des centres de données. Ils ont analysé environ 23 000 clusters Kubernetes dans des géants tels qu’AWS (Amazon), Azure (Microsoft) et GCP (Google) et ont découvert que l’utilisation moyenne du GPU de ces centres de données n’est que de 5 %.

Cela se traduit autrement : 95 % sont inactifs la plupart du temps, ce qui implique que ces entreprises paient pour obtenir 20 fois plus de capacité de calcul que ce dont elles ont réellement besoin. À l’heure actuelle, vous vous demandez peut-être s’il valait la peine de détruire le marché de la RAM et des SSD, en rendant les ordinateurs, les téléphones portables, les consoles et pratiquement tout plus chers. Et c’est une question qui a tout le sens du monde, mais il y a un autre fait intéressant.

Pire encore. Comme nous le voyons dans TechRadar, les responsables de Cast AI soulignent que c’est « la troisième année que nous publions ce rapport et les chiffres empirent ». Plus précisément, nous parlons d’une utilisation du processeur qui est passée de 10 % l’année dernière à 8 % actuellement, tandis que l’utilisation de la mémoire a chuté de 23 % à 20 %.

Des besoins surdimensionnés. Le rapport souligne également que, même si l’utilisation d’équipements diminue par rapport à l’année précédente, les hyperscalers continuent d’acheter comme si la fin du monde allait se produire. Le surprovisionnement du processeur, comme ils le décrivent, est passé de 40 % à 69 %. Dans le cas de la mémoire, ce chiffre est passé à 79 %.

FOMO. Il y a quelques semaines, l’un des dirigeants du SMIC, la grande fonderie chinoise, soulignait déjà que les Big Tech achetaient toutes les ressources dont elles auront besoin, ou pensent en avoir besoin, au cours de la prochaine décennie… mais dans quelques années seulement. Ils investissent une fortune dans la création de larges autoroutes alors qu’il n’y a pas de voitures ni de demande réelle, et depuis Cast AI, ils vont dans la même direction.

Les hyperscalers achètent au coup par coup par crainte d’être exclus. C’est ce qu’on appelle FOMO ou , quelque chose qui s’applique à de nombreux scénarios, mais ici, il s’agit de ne pas vouloir être le dernier dans la course qui déplace plusieurs millions d’un endroit à un autre.

Cet instinct de stockage alimente un cycle de pénurie de composants qui affecte les consommateurs, mais aussi l’industrie elle-même. Selon le rapport, il est logique de vouloir tout acheter le plus tôt possible car les délais de livraison sont longs, mais c’est précisément le cas parce que chacun achète plus de capacité que ce dont il a besoin.

Le calcul ne fonctionne pas. Dans l’analyse, ils soulignent également qu’il existe des clusters qui n’ont pas de si mauvaises performances et que certains utilisent 49% de leur H200 ou 30% de leur H100, bien au-dessus des 5% susmentionnés, mais ce n’est pas la norme. Et au-delà de l’explosion du marché des composants, la conséquence d’avoir autant d’équipements inutilisés est qu’ils perdent de l’argent parce qu’ils ne sont pas rentables.

Selon les calculs, un CPU inutilisé coûte quelques centimes par heure, mais un GPU inactif coûte plusieurs dollars. Et c’est là que réside une autre clé de toute cette affaire. Les centres de données Amazon ou Azure servent à satisfaire les demandes de leurs propres entreprises, mais ils louent également de la puissance de calcul à ceux qui en ont besoin. Et comme l’arrêt des GPU leur coûte de l’argent, on a signalé ces derniers mois que les prix de ces locations se multipliaient.

Quand tout cela finira-t-il ? Cast AI n’est pas optimiste, car ils affirment que la plupart des hyperscalers préfèrent supporter les coûts plutôt que de changer leurs habitudes, de peur que cela ne décolle un jour et ne les prenne du mauvais pied. La traduction est que… Je n’aurai jamais ma Steam Machine, puisque tout le monde se concentre sur la création de matériel d’IA.

Images | Nvidia

À Simseo | Il y a des centres de données surveillés et gardés par des chiens robots car apparemment, le futur est déjà le présent