L'enseignement de l'IA modélise les larges coups pour esquisser plus comme les humains

Lorsque vous essayez de communiquer ou de comprendre des idées, les mots ne font pas toujours l'affaire. Parfois, l'approche la plus efficace consiste à faire un simple croquis de ce concept – par exemple, le schémas d'un circuit pourrait aider à comprendre le fonctionnement du système.

Mais que se passe-t-il si l'intelligence artificielle pouvait nous aider à explorer ces visualisations? Bien que ces systèmes soient généralement compétents pour créer des peintures réalistes et des dessins caricaturaux, de nombreux modèles ne parviennent pas à capturer l'essence de l'esquisse: son processus itératif, qui aide les humains, qui aide les humains à réfléchir et à modifier la façon dont ils veulent représenter leurs idées.

Un nouveau système de dessin du Laboratoire d'intelligence informatique et d'intelligence artificielle du MIT (CSAIL) et de l'Université de Stanford peut esquisser davantage comme nous. Leur méthode, appelée « SketchAgent », utilise un modèle de langue multimodale – des systèmes AI qui s'entraînent sur du texte et des images, comme le sonnet Claude 3.5 d'Anthropic – pour transformer les invites en langage naturel en croquis en quelques secondes. Par exemple, il peut gribouiller une maison seul ou par collaboration, dessinant avec un humain ou incorporant une entrée textuelle pour esquisser chaque partie séparément.

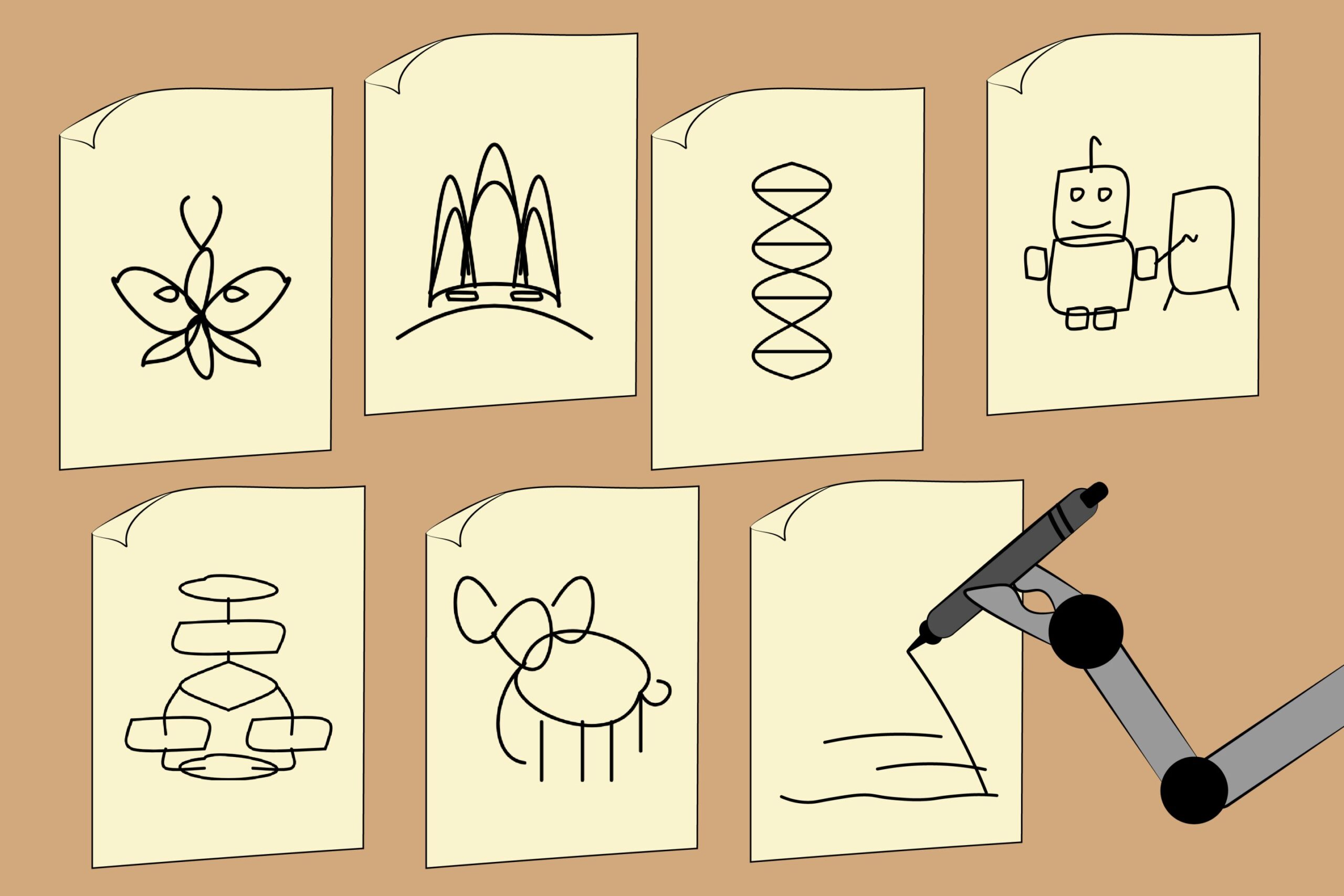

Les chercheurs ont montré que Sketchagent peut créer des dessins abstraits de divers concepts, comme un robot, un papillon, une hélice d'ADN, un organigramme et même l'opéra de Sydney. Un jour, l'outil pourrait être étendu à un jeu d'art interactif qui aide les enseignants et les chercheurs à schématiser des concepts complexes ou donner aux utilisateurs une leçon de dessin rapide.

CSAIL Postdoc Yael Vinker, qui est l'auteur principal d'un article introduisant SketchAgent, note que le système introduit un moyen plus naturel pour les humains de communiquer avec l'IA.

« Tout le monde n'est pas conscient de combien ils attirent leur vie quotidienne. Nous pouvons dessiner nos pensées ou nos idées d'atelier avec des croquis », dit-elle. « Notre outil vise à imiter ce processus, ce qui rend les modèles de langage multimodaux plus utiles pour nous aider à exprimer visuellement les idées. »

SketchAgent enseigne à ces modèles à dessiner un coup par coup sans s'entraîner sur aucune donnée – au lieu, les chercheurs ont développé un « langage de croquis » dans lequel un croquis est traduit en une séquence numérotée de traits sur une grille. Le système a reçu un exemple de la façon dont des choses comme une maison seraient dessinées, chaque AVC étiqueté selon ce qu'il représentait – comme le septième coup étant un rectangle étiqueté comme une « porte d'entrée » – pour aider le modèle à se généraliser aux nouveaux concepts.

Vinker a écrit le journal aux côtés de trois affiliés de CSAIL – le Tamar Rott Shaham, le chercheur de premier cycle Alex Zhao, et le professeur MIT Antonio Torralba – ainsi que la chercheur de recherche de l'Université de Stanford, Kristine Zheng, et le professeur adjoint Judith Ellen Fan. Ils présenteront leur travail à la conférence sur la vision par ordinateur et la reconnaissance des modèles (CVPR 2025) ce mois-ci. Le papier est disponible sur le arxiv serveur de préimprimée.

Évaluation des capacités d'esquisse de l'IA

Alors que les modèles de texte à l'image tels que Dall-E 3 peuvent créer des dessins intrigants, ils manquent d'une composante cruciale de l'esquisse: le processus spontané et créatif où chaque AVC peut avoir un impact sur la conception globale. D'un autre côté, les dessins de Sketchagent sont modélisés comme une séquence d'accidents vasculaires cérébraux, apparaissant plus naturel et plus fluide, comme les croquis humains.

Les travaux antérieurs ont également imité ce processus, mais ils ont formé leurs modèles sur des ensembles de données dessinés par l'homme, qui sont souvent limités en échelle et en diversité. SketchAgent utilise à la place des modèles de langage pré-formés, qui sont bien informés sur de nombreux concepts, mais ne savent pas comment esquisser. Lorsque les chercheurs ont enseigné aux modèles du langage ce processus, SketchAgent a commencé à esquisser divers concepts sur lesquels il n'avait pas explicitement formé.

Pourtant, Vinker et ses collègues voulaient voir si Sketchagent travaillait activement avec les humains sur le processus de croquis, ou s'il travaillait indépendamment de son partenaire de dessin. L'équipe a testé son système en mode collaboration, où un modèle humain et un modèle de langue travaille à dessiner un concept particulier en tandem. La suppression des contributions de Sketchagent a révélé que les traits de leur outil étaient essentiels au dessin final. Dans un dessin d'un voilier, par exemple, la suppression des traits artificiels représentant un mât a rendu l'esquisse globale méconnaissable.

Dans une autre expérience, les chercheurs de CSAIL et de Stanford ont branché différents modèles de langage multimodal en sketchagent pour voir qui pourrait créer les croquis les plus reconnaissables. Leur modèle de squelette par défaut, Claude 3.5 Sonnet, a généré les graphiques vectoriels les plus humains (des fichiers essentiellement basés sur le texte qui peuvent être convertis en images haute résolution). Il a surperformé des modèles comme GPT-4O et Claude 3 Opus.

« Le fait que Claude 3.5 sonnet a surpassé d'autres modèles comme GPT-4O et Claude 3 Opus suggère que ce modèle traite et génère différemment les informations liées à des visuels », explique le co-auteur Tamar Rott Shaham.

Elle ajoute que SketchAgent pourrait devenir une interface utile pour collaborer avec des modèles d'IA au-delà de la communication standard basée sur le texte. « Alors que les modèles avancent dans la compréhension et la génération d'autres modalités, comme les croquis, ils ouvrent de nouvelles façons pour les utilisateurs d'exprimer des idées et de recevoir des réponses qui se sentent plus intuitives et humaines », explique Shaham. « Cela pourrait enrichir considérablement les interactions, ce qui rend l'IA plus accessible et polyvalent. »

Bien que les prouesses de dessin de SketchAgent soient prometteuses, cela ne peut pas encore faire des croquis professionnels. Il rend des représentations simples des concepts en utilisant des figures de bâton et des griffonnages, mais lutte pour griffonner des choses comme les logos, les phrases, des créatures complexes comme les licornes et les vaches, et des figures humaines spécifiques.

Parfois, leur modèle a également mal compris les intentions des utilisateurs dans les dessins collaboratifs, comme lorsque SketchAgent a attiré un lapin avec deux têtes. Selon Vinker, cela peut être dû au fait que le modèle décompose chaque tâche en étapes plus petites (également appelée le raisonnement « chaîne de pensée »).

Lorsque vous travaillez avec des humains, le modèle crée un plan de dessin, potentiellement mal interpréter à quelle partie de ce déclencheur d'un humain contribue. Les chercheurs pourraient éventuellement affiner ces compétences en dessin en formant des données synthétiques à partir de modèles de diffusion.

De plus, Sketchagent nécessite souvent quelques cycles d'incitation à générer des griffonnages en forme d'homme. À l'avenir, l'équipe vise à faciliter l'interaction et l'esquisse avec des modèles de langage multimodal, y compris le raffinage de leur interface.

Pourtant, l'outil suggère que l'IA pourrait dessiner divers concepts comme les humains, avec une collaboration humaine étape par étape, qui se traduit par des conceptions finales plus alignées.