L'élite des modèles ouverts parlait chinois. Mistral vient de placer l’Europe à un niveau que même les États-Unis n’ont pas réussi à atteindre

Au cours de l'année écoulée, l'élite des modèles ouverts de programmation assistée, du moins comme SWE-Bench Verified, a parlé avec des accents chinois. Des noms comme DeepSeek, Kimi ou Qwen se sont imposés aux plus hautes positions lors des tests et ont donné le ton dans des tâches complexes d'ingénierie logicielle, alors que l'Europe cherchait encore sa place. L'arrivée de Devstral 2 modifie cette distribution. Cela ne déplace pas ceux qui étaient déjà au sommet, mais cela place Mistral au même niveau d'exigence et fait d'une entreprise européenne un véritable concurrent dans un domaine qui semblait jusqu'ici réservé aux autres.

Changement de championnat : le saut technique qui se préparait depuis quelques temps. Au cours des derniers mois, les modèles ouverts développés en Europe et aux États-Unis ont montré une évolution constante, bien que toujours sans les performances nécessaires pour concourir dans les tests les plus exigeants. Le progrès était évident, mais il manquait un projet capable de le consolider à un niveau supérieur et de démontrer que cette voie pouvait donner des résultats comparables à ceux du secteur.

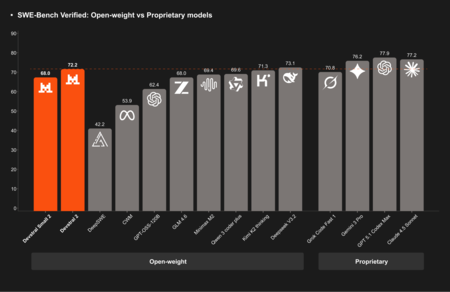

Devstral 2 en données : performances, taille et licences. Le nouveau modèle Mistral atteint 123B de paramètres dans une architecture dense et propose un contexte étendu de 256K tokens, accompagné d'une licence MIT modifiée qui facilite son adoption dans des environnements ouverts. Sa version compacte, Devstral Small 2, réduit le modèle à 24B de paramètres sous licence Apache 2.0. Dans les chiffres SWE-Bench Verified publiés par l'entreprise, Devstral 2 obtient 72,2%, une note qui le place dans la section la plus compétitive des modèles ouverts évalués et confirme sa présence parmi les alternatives les plus avancées du segment.

Elle se reflète dans un panorama concentré dans la partie supérieure de la montagne. Parmi les modèles ouverts, DeepSeek V3.2 est en tête du peloton avec 73,1%, suivi de Kimi K2 Thinking avec 71,3% et de propositions telles que Qwen 3 Coder Plus et Minimax M2, qui tournent autour de 69 points. Aux niveaux inférieurs, GLM 4.6, GPT-OSS-120B, CWM et DeepSWE apparaissent, avec des résultats plus modérés. Dans le domaine commercial fermé (modèles propriétaires), le graphique intègre des scores plus élevés : Gemini 3 Pro atteint 76,2%, GPT 5.1 Codex Max monte à 77,9% et Claude Sonnet 4,5 signe 77,2%, tous au-dessus des meilleures notes enregistrées par les modèles ouverts.

Ce que SWE-Bench Verified mesure réellement et pourquoi c'est important. SWE-Bench Verified est un test conçu pour évaluer si un modèle peut résoudre des tâches de programmation réelles, et non des exercices synthétiques. Chaque cas présente un bug dans un référentiel open source et nécessite un correctif pour réussir les tests précédemment échoués. L'évaluation cherche à mesurer si le système comprend la structure du projet, identifie la cause du problème et propose une solution cohérente. Il s'agit d'une métrique utile et exigeante, bien que limitée aux référentiels Python et à un ensemble spécifique de situations qui ne couvrent pas l'ensemble du travail logiciel.

Des copilotes aux agents qui agissent sur le projet. L'arrivée de Devstral 2 coïncide avec un changement plus large dans la manière de travailler avec les outils de programmation. Il ne s'agit plus seulement de recevoir des suggestions dans l'éditeur, mais de disposer d'agents capables d'explorer l'intégralité d'un référentiel, d'interpréter sa structure et de proposer des modifications cohérentes avec son état réel. Dans ce contexte apparaît Vibe CLI, un outil qui permet à Devstral d'analyser des fichiers, de modifier des parties du code et d'exécuter des actions directement depuis le terminal, rapprochant ces capacités du flux de travail quotidien des développeurs.

Coût et déploiement : ce que chaque type d'utilisateur peut faire avec Devstral. Le modèle sera disponible gratuitement pendant une période initiale et coûtera ensuite 0,40 $ par million de jetons pour l'entrée et 2,00 $ par million pour la sortie, tandis que la version Small 2 aura un prix inférieur. Son déploiement fait également la différence : Devstral 2 nécessite au moins quatre GPU de classe H100, destinés aux centres de données, tandis que Devstral Small 2 est destiné à fonctionner sur un seul GPU et, selon la documentation Mistral, la famille Devstral Small peut également fonctionner dans des configurations CPU uniquement, sans GPU dédié. Cette variété permet aux entreprises et aux développeurs individuels de trouver un point d’entrée approprié.

L'apparition de Devstral 2 introduit un élément inattendu dans un espace où les entreprises chinoises donnent le ton et où même les États-Unis, malgré leur leadership en intelligence artificielle, ne disposaient pas d'un modèle ouvert dans cette gamme haute performance dans SWE-Bench Verified. Mistral ne remplace pas ceux qui étaient déjà au sommet, mais il élargit le débat et montre que l'Europe peut rivaliser dans un domaine où elle n'apparaissait pas jusqu'à présent. Il s'agit d'un mouvement qui ne modifie pas la hiérarchie générale, même s'il ouvre une nouvelle marge pour l'évolution des outils de programmation assistée.

Images | Simseo avec Gémeaux 3

À Simseo | OpenAI et Google nient vouloir diffuser des publicités dans ChatGPT et Gemini. La réalité est que les comptes ne viennent pas uniquement avec des abonnements