Le nouveau cadre d’IA vise à supprimer les biais dans des domaines clés tels que la santé, l’éducation et le recrutement

Des chercheurs du Data Science and Artificial Intelligence Institute (DATAI) de l’Université de Navarra (Espagne) ont publié une méthodologie innovante qui améliore l’équité et la fiabilité des modèles d’intelligence artificielle utilisés dans la prise de décision critique. Ces décisions ont un impact significatif sur la vie des gens ou les opérations des organisations, comme cela se produit dans des domaines tels que la santé, l’éducation, la justice ou les ressources humaines.

L’équipe, formée par des chercheurs Alberto García Galindo, Marcos López de Castro et Rubén Armañanzas Arnedillo, a développé un nouveau cadre théorique qui optimise les paramètres des modèles d’apprentissage automatique fiables. Ces modèles sont des algorithmes d’IA qui font de manière transparente des prédictions, garantissant certains niveaux de confiance. Dans cette contribution, les chercheurs proposent une méthodologie capable de réduire les inégalités liées à des attributs sensibles tels que la race, le sexe ou le statut socioéconomique.

L’œuvre est publiée dans la revue Apprentissage automatique. Il combine des techniques de prédiction avancées (prédiction conforme) avec des algorithmes inspirés de l’évolution naturelle (apprentissage évolutif). Les algorithmes dérivés offrent des niveaux de confiance rigoureux et assurent une couverture équitable entre différents groupes sociaux et démographiques. Ainsi, ce nouveau cadre d’IA fournit le même niveau de fiabilité quelles que soient les caractéristiques des individus, garantissant des résultats justes et impartiaux.

« L’utilisation généralisée de l’intelligence artificielle dans des domaines sensibles a soulevé des préoccupations éthiques en raison des discriminations algorithmiques possibles », explique Armañanzas Arnedillo, chercheur principal de Datai à l’Université de Navarra.

« Our approach enables businesses and public policymakers to choose models that balance efficiency and fairness according to their needs, or responding to emerging regulations. This breakthrough is part of the University of Navarra’s commitment to fostering a responsible AI culture and promoting ethical and transparent use of cette technologie. «

Application dans de vrais scénarios

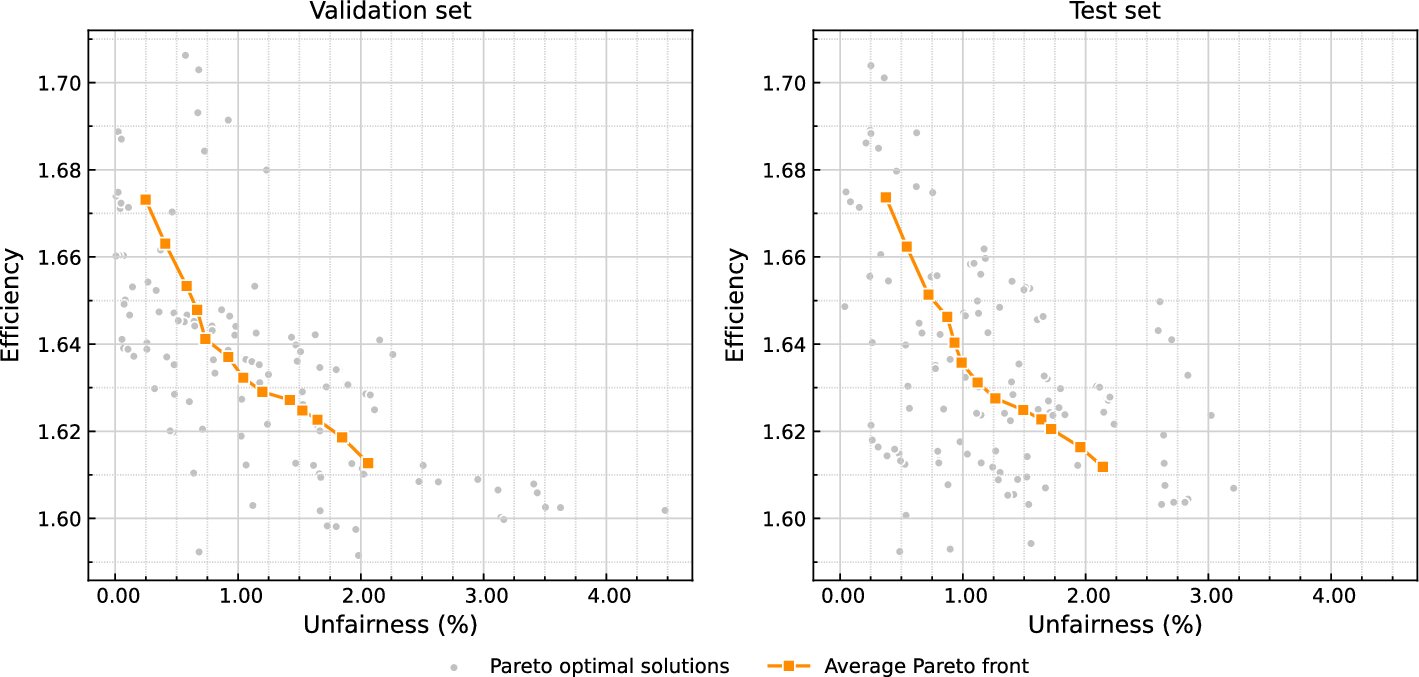

Les chercheurs ont testé cette méthode sur quatre ensembles de données de référence avec différentes caractéristiques des domaines du monde réel liés au revenu économique, à la récidive criminelle, à la réadmission à l’hôpital et aux applications scolaires. Les résultats ont montré que les nouveaux algorithmes de prédiction réduisaient considérablement les inégalités sans compromettre la précision des prédictions.

« Dans notre analyse, nous avons constaté, par exemple, des préjugés frappants dans la prédiction des admissions scolaires, en manifestant un manque d’équité significatif basé sur la situation financière familiale », note Alberto García Galindo, chercheur préoctoral Datai à l’Université de Navarra et premier auteur de de le papier.

« À son tour, ces expériences ont démontré que, à plusieurs reprises, notre méthodologie parvient à réduire ces biais sans compromettre la capacité prédictive du modèle. Plus précisément, avec notre modèle, nous avons trouvé des solutions dans lesquelles la discrimination a été pratiquement complètement réduite tout en maintenant la précision de la prédiction. »

La méthodologie propose un « front Pareto » d’algorithmes optimaux « , qui nous permet de visualiser les meilleures options disponibles en fonction des priorités et de comprendre, pour chaque cas, comment l’équité et la précision algorithmiques sont liées. »

Selon les chercheurs, cette innovation a un grand potentiel dans les secteurs où l’IA doit soutenir la prise de décision critique et éthique critique. Garcia Galindo souligne que leur méthode « non seulement contribue à l’équité mais permet également une compréhension plus approfondie de la façon dont la configuration des modèles influence les résultats, ce qui pourrait guider les recherches futures dans la régulation des algorithmes d’IA ».

Les chercheurs ont créé le code et les données de l’étude accessible au public pour encourager de nouvelles applications de recherche et la transparence dans ce domaine émergent.