Le génie est-il sorti de la bouteille ? Pouvez-vous faire confiance à ChatGPT dans la rédaction scientifique ?

Depuis son lancement en novembre 2022, ChatGPT, un modèle de langage de pointe développé par OpenAI, LLC à San Francisco, Californie, États-Unis, a attiré l’attention de la communauté scientifique. Alors que les débats sur l’impact de ChatGPT sur tous les aspects du monde universitaire se multiplient dans le monde entier, une équipe de l’Université de médecine vétérinaire de Hanovre, en Allemagne, dirige un projet avec plusieurs partenaires internationaux pour explorer les limites et les avantages potentiels associés à l’application de ChatGPT dans la rédaction scientifique.

Cette étude, intitulée « ChatGPT et articles scientifiques en neurologie vétérinaire : le génie est-il sorti de la bouteille ? » Publié dans Frontières de la science vétérinaireSection Neurologie Vétérinaire et Neurochirurgie, étudie la capacité de ChatGPT à générer des articles scientifiques dans le domaine de la neurologie vétérinaire.

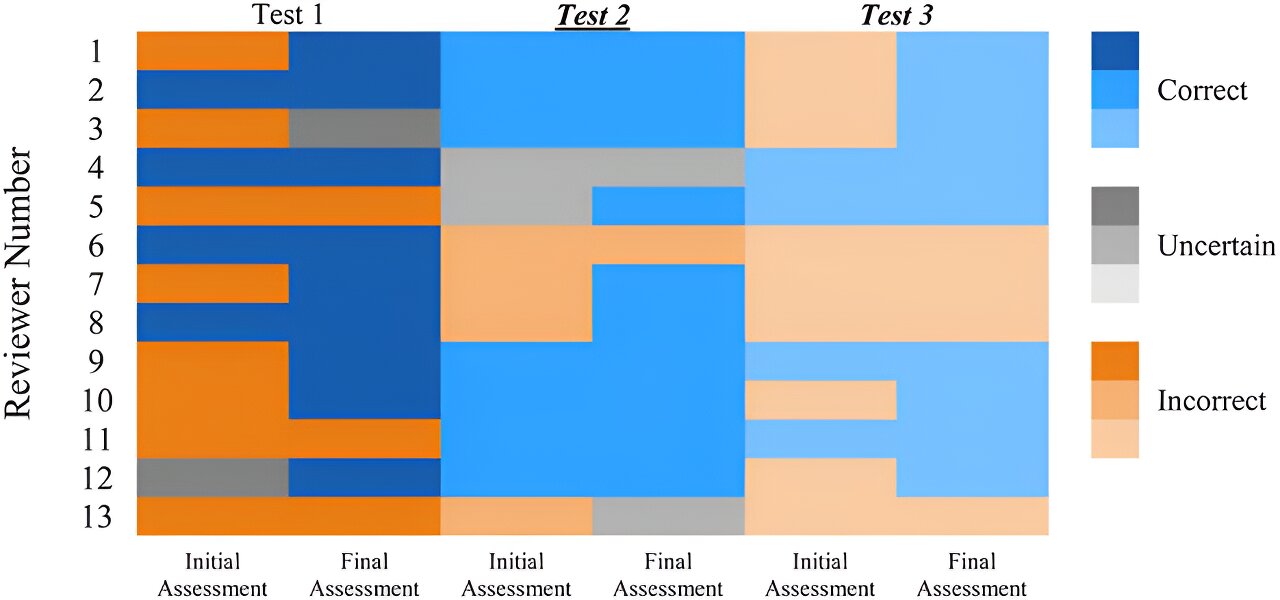

Les résumés et les sections d’introduction, y compris les références, de trois articles de recherche originaux différents et d’articles générés par ChatGPT en neurologie vétérinaire ont été évalués à l’aide de détecteurs de sortie d’IA et de détecteurs de plagiat. Treize neurologues certifiés ont également été invités à déterminer l’originalité et la fiabilité du contenu.

« Nous sommes ravis que ces travaux soient publiés en début d’année universitaire. Comme toute autre technologie, un outil d’IA comme ChatGPT peut soit constituer une menace pour l’intégrité scientifique et la transparence, soit aider les chercheurs, selon la manière dont ils sont utilisés. Je recommande fortement l’intégration de l’éducation sur l’utilisation appropriée et l’utilisation abusive potentielle des outils basés sur l’IA dans le milieu universitaire en tant qu’aspect fondamental de la bonne pratique scientifique », déclare Samira Abani, première auteure de l’Université de médecine vétérinaire de Hanovre.

Jasmin Neßler, l’auteur correspondant de l’Université de médecine vétérinaire de Hanovre, commente : « Nous pensons que la popularité de l’IA nécessite une collaboration scientifique interdisciplinaire pour établir des lignes directrices claires pour son utilisation responsable, garantissant l’intégrité et la transparence de la littérature publiée. sera toujours l’approche la plus efficace pour prévenir les abus ; nous devrions plutôt saisir cette opportunité pour exploiter le potentiel de l’IA au profit de la société. »

Le professeur Holger Volk, directeur de la clinique pour petits animaux de l’université de médecine vétérinaire de Hanovre, ajoute : « Nous avons appris que les grands modèles linguistiques (LLM) comme ChatGPT sont formés pour imiter les styles d’écriture humains et produire des textes cohérents et plausibles. , ce qui peut parfois tromper les experts humains. Cependant, les modèles comme ChatGPT sont sujets aux hallucinations et peuvent générer un contenu biaisé.

« Cela soulève des inquiétudes quant à l’intégrité de l’utilisation de tels modèles dans les écrits universitaires. Nous devons nous rappeler que, malgré les progrès récents, nous devrions être sceptiques quant à l’idée de nous fier entièrement à ChatGPT ou à tout autre outil d’IA, du moins pour le moment. »

Fourni par la Stiftung Tierärztliche Hochschule Hannover