L’avenir de l’IA pourrait être « open source » ou fermé. Les géants de la technologie sont divisés alors qu’ils font pression sur les régulateurs

Les leaders technologiques ont été de fervents partisans de la nécessité de réglementer l’intelligence artificielle, mais ils font également pression pour s’assurer que les nouvelles règles jouent en leur faveur.

Cela ne veut pas dire qu’ils veulent tous la même chose.

Meta et IBM, société mère de Facebook, ont lancé mardi un nouveau groupe appelé AI Alliance, qui plaide en faveur d’une approche « scientifique ouverte » du développement de l’IA, ce qui les met en contradiction avec leurs rivaux Google, Microsoft et OpenAI, le fabricant de ChatGPT.

Ces deux camps divergents – le camp ouvert et le camp fermé – ne s’entendent pas sur l’opportunité de développer l’IA de manière à rendre la technologie sous-jacente largement accessible. La sécurité est au cœur du débat, tout comme la question de savoir qui profite des progrès de l’IA.

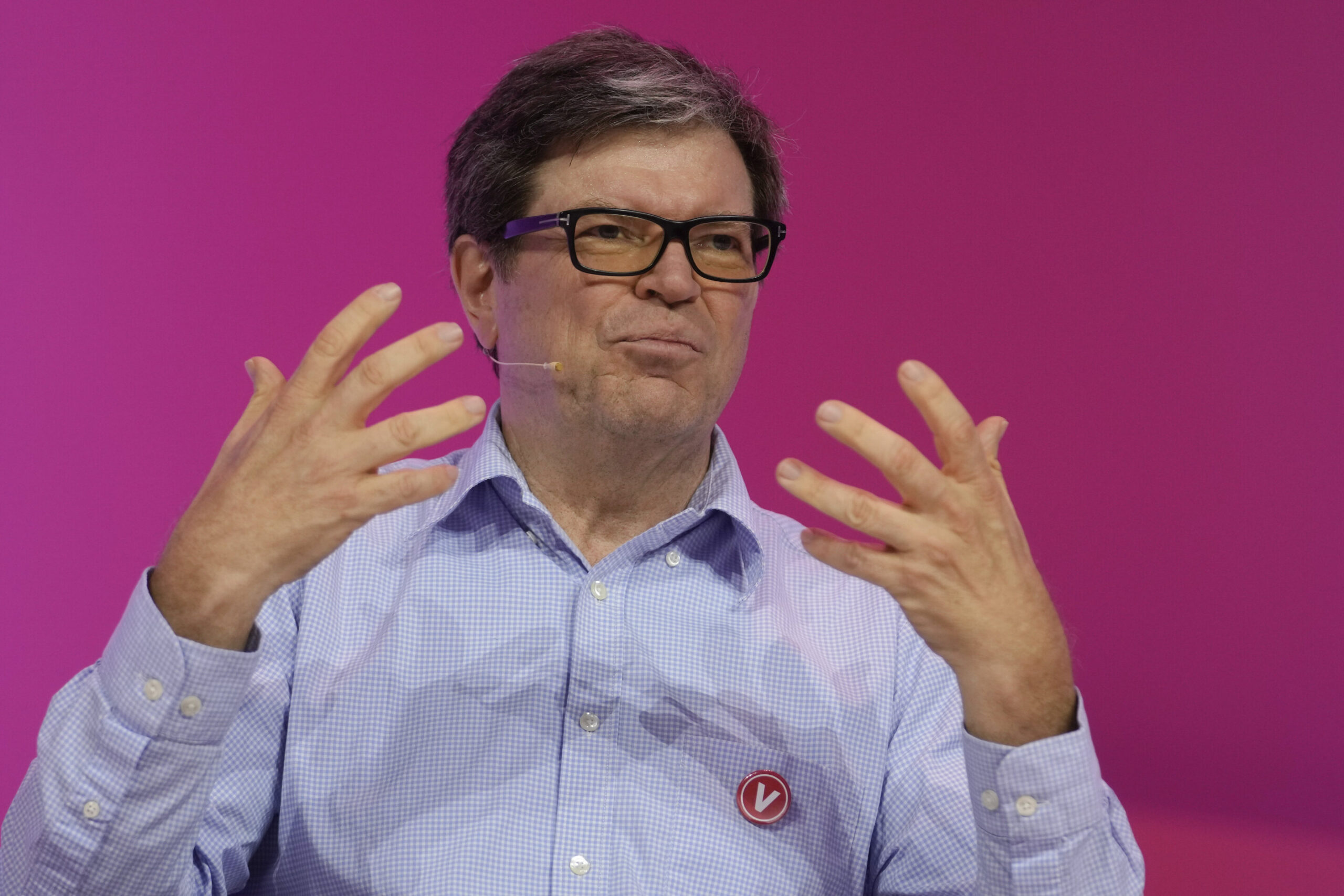

Les partisans de l’ouverture privilégient une approche « non propriétaire et fermée », a déclaré Darío Gil, vice-président senior d’IBM qui dirige sa division de recherche. « Ce n’est donc pas comme si quelque chose était enfermé dans un tonneau et personne ne savait ce que c’était. »

QU’EST-CE QUE L’IA OPEN SOURCE ?

Le terme « open source » vient d’une pratique vieille de plusieurs décennies consistant à créer des logiciels dont le code est gratuit ou largement accessible à tous pour l’examiner, le modifier et le développer.

L’IA open source implique bien plus que du code et les informaticiens diffèrent sur la manière de la définir en fonction des composants de la technologie qui sont accessibles au public et s’il existe des restrictions limitant son utilisation. Certains utilisent la science ouverte pour décrire une philosophie plus large.

L’AI Alliance, dirigée par IBM et Meta et comprenant Dell, Sony, les fabricants de puces AMD et Intel ainsi que plusieurs universités et startups de l’IA, « se réunit pour exprimer, en termes simples, que l’avenir de l’IA va se construire fondamentalement sur l’échange scientifique ouvert d’idées et sur l’innovation ouverte, y compris l’open source et les technologies ouvertes », a déclaré Gil dans une interview accordée à l’Associated Press avant son dévoilement.

Une partie de la confusion autour de l’IA open source vient du fait que malgré son nom, OpenAI – la société derrière ChatGPT et le générateur d’images DALL-E – construit des systèmes d’IA résolument fermés.

« Pour énoncer une évidence, il existe des incitations commerciales et à court terme contre l’open source », a déclaré Ilya Sutskever, scientifique en chef et co-fondateur d’OpenAI, dans une interview vidéo organisée par l’Université de Stanford en avril. Mais il existe également une inquiétude à plus long terme concernant le potentiel d’un système d’IA doté de capacités « incroyablement puissantes » qui serait trop dangereux pour être rendu public, a-t-il déclaré.

Pour plaider en faveur des dangers de l’open source, Sutskever a avancé l’hypothèse d’un système d’IA qui avait appris à démarrer son propre laboratoire biologique.

EST-IL DANGEREUX?

Même les modèles d’IA actuels présentent des risques et pourraient être utilisés, par exemple, pour intensifier les campagnes de désinformation afin de perturber les élections démocratiques, a déclaré David Evan Harris, chercheur à l’Université de Californie à Berkeley.

« L’Open Source est vraiment formidable dans de nombreux domaines technologiques », mais l’IA est différente, a déclaré Harris.

« Tous ceux qui ont regardé le film ‘Oppenheimer’ savent que lorsque de grandes découvertes scientifiques sont faites, il y a de nombreuses raisons de réfléchir à deux fois avant de partager les détails de toutes ces informations de manière à ce qu’elles puissent tomber entre de mauvaises mains. , » il a dit.

Le Center for Humane Technology, critique de longue date des pratiques de Meta en matière de médias sociaux, fait partie des groupes qui attirent l’attention sur les risques liés aux modèles d’IA open source ou divulgués.

« Tant qu’il n’y a pas de garde-fous en place pour le moment, il est tout simplement totalement irresponsable de déployer ces modèles auprès du public », a déclaré Camille Carlton du groupe.

Est-ce alarmiste ?

Un débat de plus en plus public a émergé sur les avantages ou les dangers de l’adoption d’une approche open source du développement de l’IA.

Yann LeCun, scientifique en chef de l’IA chez Meta, a visé cet automne sur les réseaux sociaux OpenAI, Google et la start-up Anthropic pour ce qu’il a décrit comme un « lobbying massif des entreprises » visant à rédiger des règles d’une manière qui profite à leurs modèles d’IA hautement performants et pourrait se concentrer. leur pouvoir sur le développement de la technologie. Les trois sociétés, ainsi que Microsoft, partenaire clé d’OpenAI, ont formé leur propre groupe industriel appelé Frontier Model Forum.

LeCun a déclaré sur X, anciennement Twitter, qu’il craignait que les propos alarmistes de ses collègues scientifiques sur les « scénarios apocalyptiques » de l’IA ne donnent des munitions à ceux qui veulent interdire la recherche et le développement open source.

« Dans un avenir où les systèmes d’IA sont sur le point de constituer le référentiel de toutes les connaissances et de la culture humaines, nous avons besoin que les plateformes soient open source et disponibles gratuitement afin que chacun puisse y contribuer », a écrit LeCun. « L’ouverture est le seul moyen de faire en sorte que les plateformes d’IA reflètent l’intégralité des connaissances et de la culture humaines. »

Pour IBM, l’un des premiers partisans du système d’exploitation open source Linux dans les années 1990, le conflit alimente une concurrence beaucoup plus longue qui précède le boom de l’IA.

« Il s’agit en quelque sorte d’une approche classique de capture de la réglementation consistant à tenter de susciter des craintes concernant l’innovation open source », a déclaré Chris Padilla, qui dirige l’équipe mondiale des affaires gouvernementales d’IBM. « Je veux dire, c’est le modèle de Microsoft depuis des décennies, n’est-ce pas ? Ils se sont toujours opposés aux programmes open source qui pourraient concurrencer Windows ou Office. Ils adoptent une approche similaire ici. »

QUE FONT LES GOUVERNEMENTS ?

Il était facile de passer à côté du débat sur l’« open source » lors de la discussion autour du décret radical du président américain Joe Biden sur l’IA.

En effet, l’ordonnance de Biden décrivait les modèles ouverts sous le nom très technique de « modèles de fondation à double usage avec des poids largement disponibles » et indiquait qu’ils nécessitaient une étude plus approfondie. Les pondérations sont des paramètres numériques qui influencent les performances d’un modèle d’IA.

« Lorsque les pondérations d’un modèle de fondation à double usage sont largement disponibles, par exemple lorsqu’elles sont publiées publiquement sur Internet, il peut y avoir des avantages substantiels pour l’innovation, mais également des risques de sécurité importants, tels que la suppression des garanties au sein du modèle, » L’ordre de Biden dit. Il a donné jusqu’en juillet à la secrétaire américaine au Commerce, Gina Raimondo, pour s’entretenir avec des experts et formuler des recommandations sur la manière de gérer les avantages et les risques potentiels.

L’Union européenne a moins de temps pour s’en rendre compte. Alors que les négociations ont atteint leur point culminant mercredi, les responsables travaillant à finaliser l’adoption d’une réglementation de pointe sur l’IA débattent toujours d’un certain nombre de dispositions, dont une qui pourrait exempter certains « composants d’IA gratuits et open source » des règles affectant les modèles commerciaux.