Il devrait être impossible pour un iPhone 17 Pro d’exécuter un gigantesque modèle d’IA de 400 Go. Devrait

L’iPhone 17 Pro dispose de 12 Go de mémoire unifiée. C’est un chiffre très correct pour un téléphone mobile, mais en théorie absolument insuffisant pour exécuter localement de grands modèles d’IA. Et c’est là que réside la surprise : un nouveau projet a permis à ce téléphone mobile d’exécuter localement un modèle avec 400 milliards de paramètres (400B). Et cela ouvre les portes d’un horizon prometteur.

Modèle d’IA géant, mémoire naine. Un développeur nommé Daniel Woods (@dandeveloper) a créé, grâce à l’IA, un nouveau moteur d’inférence appelé Flash-MoE dont le code a été publié en Open Source sur GitHub accompagné d’une étude sur son comportement. Woods a réussi à faire tourner localement le modèle Qwen 3.5 397B (la version complète, sans distillation ni quantification) sur son MacBook Pro doté de 48 Go de RAM. Il a téléchargé le modèle (209 Go sur disque) et développé ce moteur d’inférence pour réaliser quelque chose qui semblait presque impossible. D’autres développeurs sont allés encore plus loin et ont réussi à faire tourner des modèles comme DeepSeek-V3 (671B) ou encore Kimi K2.5 (1 026B !!) sur leurs MacBook. La vitesse est lente, sans doute, mais ils fonctionnent, ils fonctionnent. C’est incroyable.

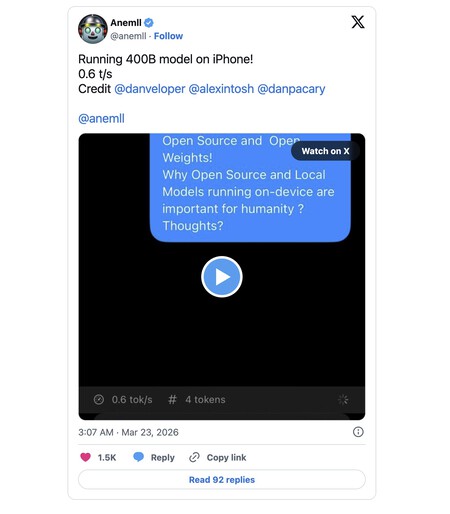

L’iPhone 17 Pro est capable d’exécuter un modèle 400B. Un autre développeur appelé Anemll a voulu aller un peu plus loin et essayer de faire tourner ce modèle avec près de 400 000 millions de paramètres sur son iPhone 17 Pro avec 12 Go de RAM… et il a réussi. Il est vrai que le modèle est très lent en réponse (0,6 jeton par seconde, très inutilisable), mais réaliser quelque chose comme ça ouvre les portes d’un avenir dans lequel la vidéo ou la mémoire unifiée ne sont plus aussi critiques pour pouvoir utiliser localement d’énormes modèles d’IA. Il y a quelques heures, il a doublé la vitesse à 1,1 jeton par seconde, réduisant ainsi le nombre d’experts à quatre (perte de qualité des réponses de 2,5%). Il n’est pas encore entièrement utilisable, mais la démonstration technique est évidente. Un autre utilisateur a préféré utiliser un modèle un peu plus petit (Qwen 3.5 35B) mais toujours énorme pour l’iPhone, et a déjà réussi à le faire fonctionner localement à un rythme plus qu’acceptable de 13,1 jetons par seconde.

Pourquoi est-ce important ? Les modèles d’IA que nous utilisons dans le cloud (ChatGPT, Gemini, Claude) sont gigantesques et fonctionnent dans des centres de données dotés de milliers de puces et d’énormes quantités de mémoire et de stockage. Ils sont les plus puissants car ils fonctionnent sur les machines les plus puissantes. Bien qu’il soit possible d’utiliser des modèles d’IA localement, les modèles que nous pouvons exécuter sont beaucoup plus petits, ce qui rend difficile leur comportement aussi bien en termes de qualité de réponses que de vitesse ou de précision. Cette méthode ouvre la porte à un avenir dans lequel même sur des machines « modestes », il sera possible d’exécuter des modèles d’IA géants qui donneront de meilleures réponses et permettront d’éviter d’utiliser des modèles dans le cloud.

Apple a déjà prévenu. Il y a trois ans, un groupe de chercheurs d’Apple a publié l’étude « LLM in a flash » qui soulignait précisément cela : pour exécuter localement des modèles d’IA, il serait possible de profiter non seulement de la mémoire unifiée des Mac, mais aussi de leurs unités de stockage. La vitesse serait certes lente, mais cela ouvrirait la possibilité d’exécuter de gigantesques modèles localement sur des machines dotées de quantités de mémoire unifiée beaucoup plus réduites. Woods a utilisé Claude Code avec Claude Opus 4.6 et a appliqué la nouvelle méthodologie « d’autorecherche » d’Andrej Karpathy pour implémenter Flash-MoE sur la base de cette recherche. Le résultat est vraiment prometteur.

La mémoire vidéo était tout. Sur mon Mac mini M4 par exemple, je dispose de 16 Go de mémoire unifiée. Cela signifie qu’avec des outils comme Ollama, vous pouvez installer et exécuter des modèles comme Qwen 3.5 4B localement avec une certaine fluidité, mais les modèles 7B ou d’autres comme gpt-oss 20B seraient beaucoup plus lents à répondre (ou resteraient complètement bloqués). La mémoire vidéo (ou unifiée sur les appareils Apple) est le paramètre le plus important lors de l’exécution de modèles locaux, tant en termes de quantité que de bande passante. Si vous souhaitez les utiliser de manière fluide, c’est le facteur limitant. Il est possible d’utiliser de la RAM « normale », mais les vitesses d’utilisation sont si drastiquement réduites qu’il est souvent préférable de ne pas utiliser du tout cette option.

Si vous possédez un SSD rapide, vous possédez un trésor. Désormais, le facteur limitant est notre disque SSD, puisque le modèle l’utilise comme s’il s’agissait d’une sorte de substitut à la mémoire vidéo. Et plus le disque SSD de notre ordinateur est rapide, mieux c’est. Il y a de bonnes nouvelles ici, car ces derniers temps, nous voyons comment les disques PCIe 5.0 atteignent environ 15 Go/s sans trop de problèmes, et cette vitesse donne déjà suffisamment de marge de manœuvre pour utiliser localement des modèles d’IA beaucoup plus grands que ceux que nous pouvions utiliser auparavant.

Un avenir prometteur pour l’IA locale (et plus privée). Cette découverte est vraiment frappante pour tous ceux qui souhaitent utiliser l’IA localement, car elle permet d’utiliser des modèles énormes sans avoir à faire un énorme investissement dans des cartes graphiques de dernière génération ou, par exemple, dans un Mac avec beaucoup de mémoire unifiée : un Mac Studio M3 Ultra avec 512 Go de mémoire, par exemple, coûte plus de 10 000 euros. Avec cette nouvelle méthode, nous pourrions opter pour une machine beaucoup moins chère qui, avec une bonne unité SSD, nous permettrait d’utiliser des modèles géants de manière assez décente. Pas aussi rapide que ces autres options, bien sûr, mais toujours très décent. Il s’agit d’une avancée notable pour profiter des avantages de l’exécution de modèles d’IA locaux, y compris le plus important de tous : la confidentialité. Avec ce type d’exécution locale, nos conversations et tout ce que nous disons au chatbot restent sur notre machine, ils ne finissent pas sur les serveurs d’entreprises comme Google, OpenAI, Meta ou Anthropic.

À Simseo | Jensen Huang pense que nous avons atteint « l’arrivée du loup IA ». C’est parfait pour nourrir un Tamagotchi