Google vient de changer les règles du modèle léger

Ces dernières années, nous nous sommes habitués à une idée assez répandue dans le monde de l’IA : les modèles plus rapides ont tendance à être moins intelligents que ceux qui mettent plus de temps à réagir. Ces variantes « légères » fonctionnent très bien en termes de coûts et de latence pour de nombreuses applications, mais lorsque le raisonnement est décisif, l'habitude est de monter d'un niveau.

Aujourd’hui, dans la course au développement de l’intelligence artificielle, quelque chose d’inhabituel vient de se produire. Gemini 3 Flash, le nouveau modèle de Google, a surpassé GPT-5.2 Extra High, la variante à raisonnement plus élevé d'OpenAI, dans plusieurs tests de performances. Et cela nous oblige à repenser certaines règles que nous tenions pour acquises.

Un modèle rapide qui raisonne aussi. Le nouveau modèle de Google comporte une promesse très précise : démontrer que « la vitesse et l'évolutivité ne doivent pas nécessairement se faire au détriment de l'intelligence ». Bien qu'il ait été conçu dans un souci d'efficacité, tant en termes de coût que de rapidité, Google insiste sur le fait que Gemini 3 Flash excelle également dans les tâches de raisonnement.

Selon l'entreprise, le modèle peut ajuster votre capacité de réflexion. Il est capable de « réfléchir » plus longtemps lorsque le cas d'utilisation l'exige, mais utilise également 30 % de jetons en moins en moyenne que le Gemini 2.5 Pro, mesuré avec un trafic typique, pour effectuer une grande variété de tâches avec une grande précision et sans pénaliser les temps de réponse.

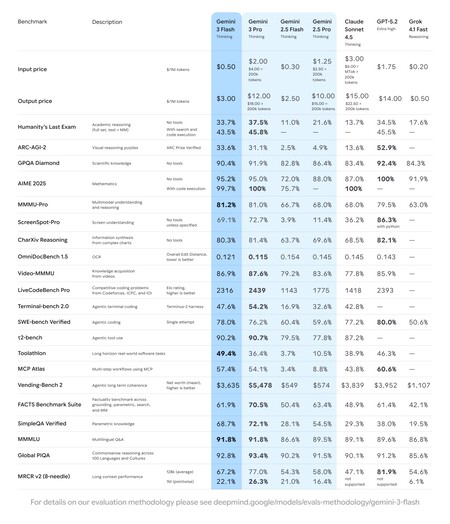

La vérité est dans les benchmarks. Les benchmarks sont-ils parfaits ? Non, mais ils restent l’un des outils les plus utiles dont nous disposons pour comparer les modèles d’IA, les comparer les uns aux autres et détecter dans quels scénarios ils fonctionnent mieux ou moins bien. Et dans ce domaine, Gemini 3 Flash s'en sort bien.

Dans SimpleQA Verified, un test qui mesure la fiabilité des questions de connaissances, Gemini 3 Flash atteint 68,7 % contre 38,0 % pour GPT-5.2 Extra High. En raisonnement multimodal, au sein de MMMU-Pro, le modèle de Google obtient un score de 81,2 % contre 79,5 % pour OpenAI. En Vidéo-MMMU, Flash atteint 86,9 % contre 85,9 % pour GPT-5.2 Extra High.

Si l’on regarde les capacités multilingues et culturelles, Flash est encore une fois en tête, avec 91,8 % contre 89,6 % pour GPT-5.2 Extra High. Dans Global PIQA, axé sur le bon sens en 100 langues, la différence demeure : 92,8 % pour Flash contre 91,2 % pour le modèle OpenAI. Tout indique que Gemini 3 Flash est spécialement optimisé pour capturer les nuances en dehors de l'anglais et raisonner plus couramment dans des contextes mondiaux.

Il excelle également dans l’utilisation des outils et des agents. Dans Toolathlon, Flash obtient un score de 49,4 %, contre 46,3 % pour GPT-5.2 Extra High. Dans l'étude FACTS Benchmark Suite, l'écart est plus serré, mais toujours en faveur de Google : 61,9 % contre 61,4 %. Dans les tâches d'exécution d'outils à long terme, Flash semble faire preuve d'une plus grande cohérence.

Mais il n’est pas le roi du raisonnement pur. Maintenant, cela vaut la peine de regarder la photo complète. Bien que Gemini 3 Flash surpasse le meilleur modèle OpenAI dans plusieurs tests, si vous recherchez un raisonnement « pur », la balance change. Dans les tests les plus exigeants dans ce domaine, GPT-5.2 Extra High continue de constituer la référence.

Le modèle d'OpenAI est en tête de l'ARC-AGI-2, axé sur les énigmes visuelles, avec 52,9 % contre 33,6 % pour Flash. En AIME 2025, avec exécution de code, il atteint 100 % contre 99,7 %. Et dans SWE-bench Verified, destiné au génie logiciel, il obtient 80,0 % contre 78,0 % pour Gemini 3 Flash.

Qu’est-ce que GPT-5.2 Extra High exactement ? Tout au long de l'article, le nom GPT-5.2 Extra High apparaît à plusieurs reprises, et il est normal de se demander s'il s'agit de quelque chose de nouveau ou de peu connu. En réalité, ce n’est pas un modèle habituellement évoqué auprès du grand public.

Google utilise ce nom dans son tableau comparatif pour désigner le niveau maximum de raisonnement disponible dans l'API OpenAI pour GPT-5.2 Thinking et Pro. Dans la documentation officielle d'OpenAI, il est identifié comme « xhigh ».

Où Gemini 3 Flash peut être utilisé. L'accès à Gemini 3 Flash ne dépend pas du pays. Si vous avez accès à l'application Gemini, vous utilisez déjà ce modèle, devenu l'option par défaut. Il atteint également les développeurs via l'API, AI Studio et Vertex AI. Aux États-Unis, le déploiement va encore plus loin puisque Gemini 3 Flash est devenu le modèle par défaut du mode AI du moteur de recherche Google.

Le prix d’utilisation de Gemini 3 Flash. Pour ceux qui souhaitent intégrer Gemini 3 Flash dans leurs applications, le modèle coûte 0,50 $ par million de jetons d'entrée et 3 $ par million de jetons de sortie. Il s'agit d'une légère augmentation par rapport à Gemini Flash 2.5, qui était de 0,30 $ par million de jetons entrants et de 2,50 $ par million de jetons sortants.

Une course de plus en plus serrée. Il est révolu le temps où Google essayait de confronter ChatGPT avec Bard, ou où OpenAI semblait avoir des années d'avance sur les autres. Aujourd’hui, les distances entre les grands acteurs de l’IA se sont drastiquement réduites. La compétition est plus directe, plus technique et surtout beaucoup plus serrée.

Images | Google

À Simseo | Amazon prépare un investissement de 10 milliards dans OpenAI car si vous ne pouvez pas battre votre ennemi, le mieux est de le rejoindre