Google défie Nvidia : le rôle clé des puces TPU ébranle le marché

Selon de nombreux analystes, la puce TPU propriétaire de Google – développée en interne pour le traitement de l'intelligence artificielle – serait au centre du succès du nouveau modèle Gemini 3. La puce TPU, en fait, a permis des performances telles que Gemini 3 a surpassé le GPT-5 d'OpenAI lors de tests indépendants.

Le résultat a suscité une grande inquiétude chez OpenAI, qui a réagi par une véritable « alerte rouge » : selon certaines sources, le PDG Sam Altman a ordonné la réorientation des ressources pour améliorer la vitesse, la fiabilité et la qualité du chatbot.

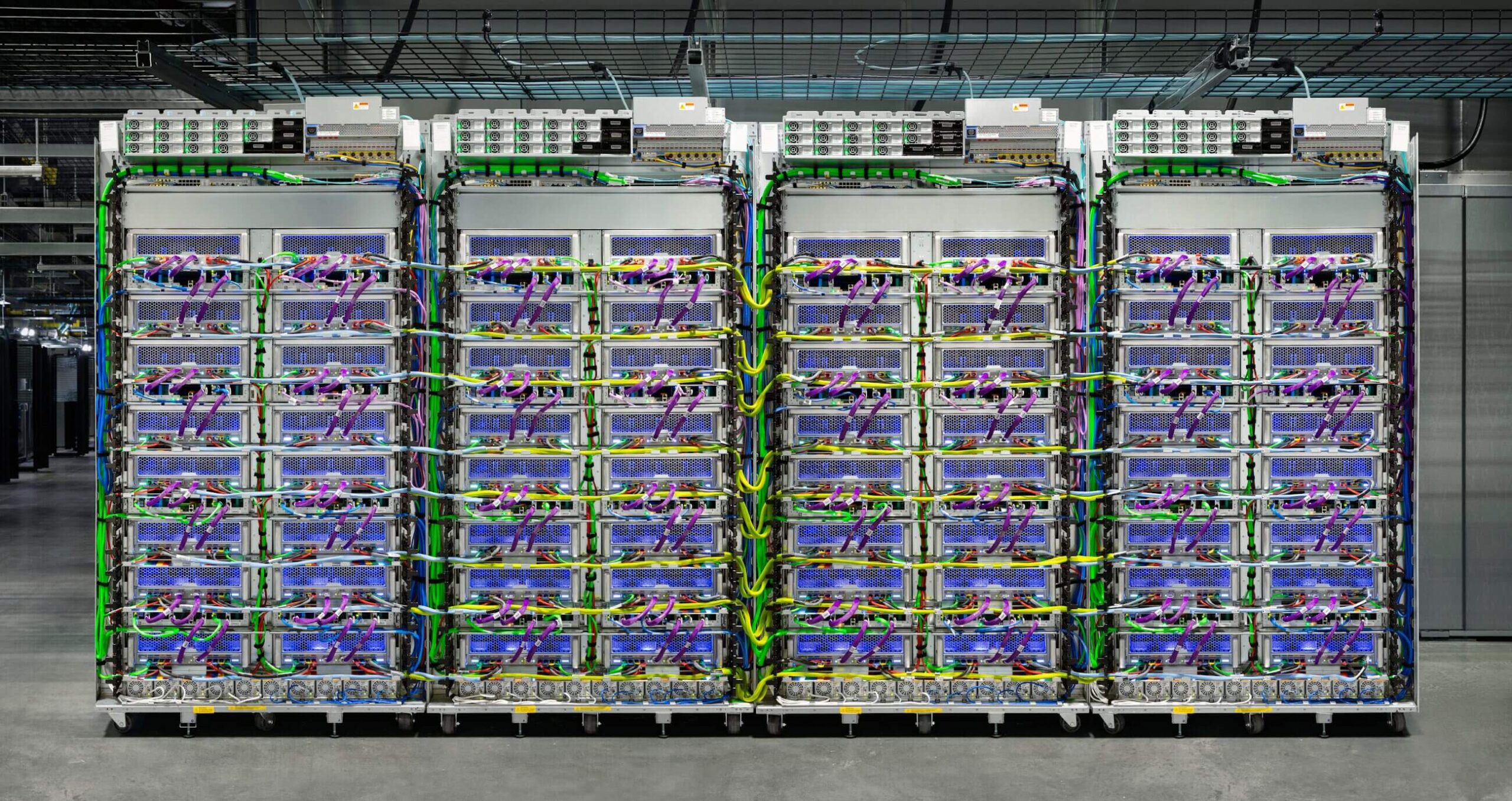

Google vise haut : production de TPU et ventes externes

Jusqu'à récemment, les puces TPU n'étaient utilisées qu'en interne par Google. Aujourd’hui, l’entreprise a également commencé à les proposer à des tiers : nous parlons de gros clients, parmi lesquels des startups Meta et AI.

Selon certains analystes, la production de TPU pourrait plus que doubler d'ici 2028 – une expansion qui reflète les nobles ambitions de Google en matière de matériel d'IA.

Cette stratégie d’« intégration verticale » – puces, logiciels et infrastructure cloud développés en interne – semble offrir à Google un avantage concurrentiel à la fois technique et économique.

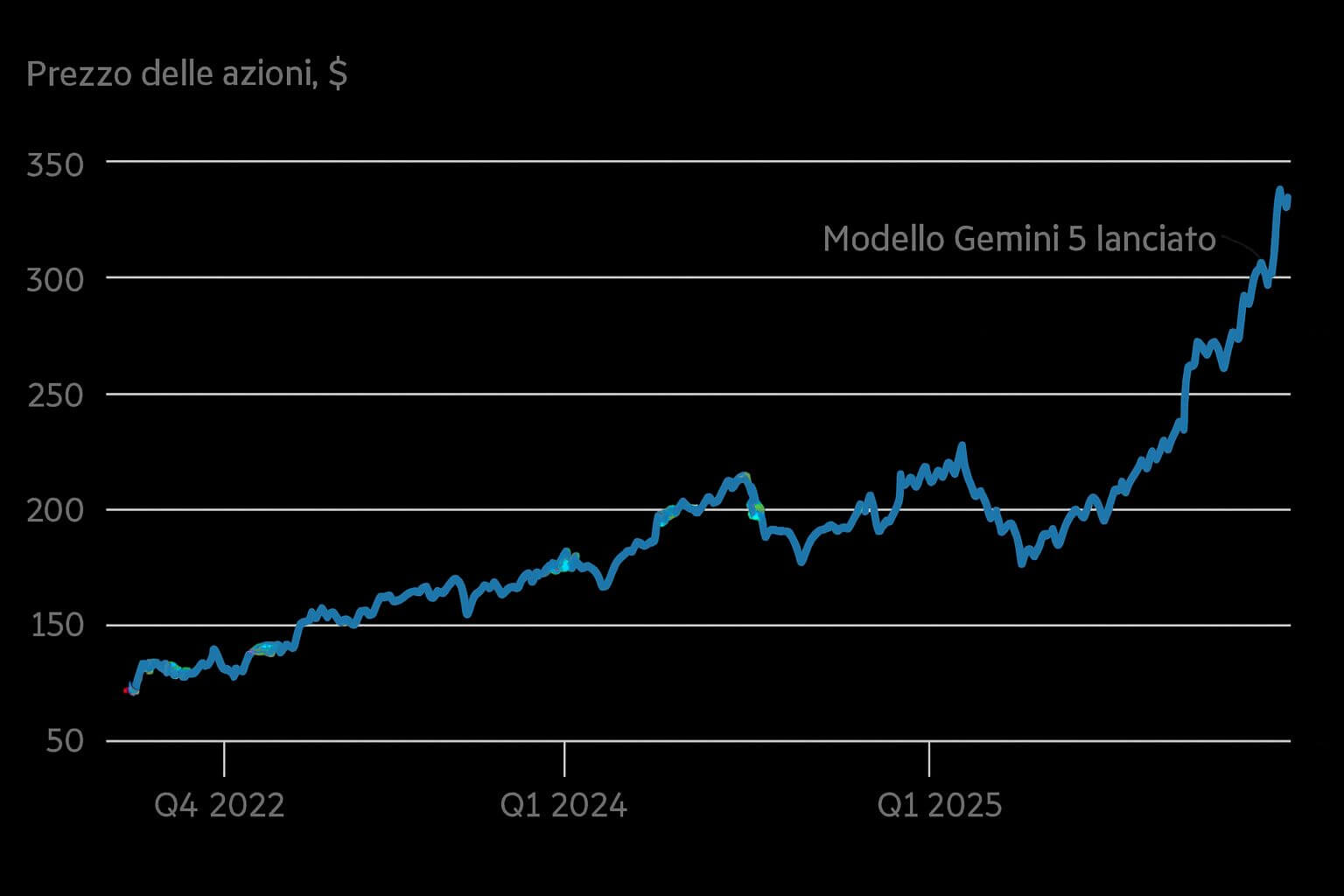

Choc pour Nvidia et le marché des puces IA

La perspective d'un déploiement à grande échelle des TPU a eu des impacts immédiats sur le marché : les actions de Nvidia ont chuté, alors que l'on craignait que sa position dominante dans le secteur des GPU IA ne soit sérieusement remise en cause.

En particulier, les rumeurs sur un éventuel accord entre Google et Meta ont provoqué de fortes turbulences sur les valeurs du secteur.

Selon certains observateurs, d’autres grandes entreprises – comme la société d’IA Anthropic – s’intéresseraient également aux TPU, amplifiant les implications concurrentielles.

Défis et limites : TPU vs GPU

Malgré les atouts, la transition ne se fait pas sans obstacles. Un problème principal concerne la compatibilité logicielle : de nombreux frameworks d’IA (comme PyTorch, très populaire dans la recherche et l’industrie) ne sont pas conçus nativement pour fonctionner sur TPU, mais nécessitent une couche de traduction (par exemple via XLA), ce qui complique une adoption massive.

De plus, selon certaines analyses – tout en reconnaissant l’intérêt des TPU pour des tâches spécifiques, comme la formation ou l’inférence de modèles à grande échelle – les GPU Nvidia conservent un avantage en termes de flexibilité, de polyvalence et de prise en charge d’un large éventail de charges de travail.

Ce que cela signifie pour l’avenir de l’IA

Le scénario qui se dessine est celui d’un marché en évolution rapide. Si Google parvient à augmenter sa production et à attirer des clients externes à grande échelle – réduisant ainsi sa dépendance aux GPU à usage général – les TPU pourraient devenir une alternative crédible et souvent préférable pour de nombreuses applications d’IA.

Pour autant, la suprématie des GPU ne disparaîtra pas du jour au lendemain : leur compatibilité avec un large écosystème, la flexibilité et la maturité des outils logiciels représentent encore des atouts difficiles à surmonter.

Pour les entreprises développant des modèles d’IA, cela signifie que l’avenir sera probablement hybride : TPU pour des charges massives et prévisibles, GPU pour la flexibilité, le prototypage et la recherche.

Pendant ce temps, « l'échiquier » de l'IA semble s'être retourné : de la domination presque absolue des puces génériques, nous sommes passés à une ère dans laquelle les puces personnalisées et les stratégies intégrées – matériel, cloud, modèles – pourraient dicter le rythme du marché.