Écrivez 1 000 mots par seconde

Mistral est en compétition devant les géants, mais n’abandonne pas. Hier, il a lancé une nouvelle version de son chatbot, Le Chat, en plus de l’offrir dans iOS et Android et de lancer une version de paiement avec des options AI avancées. Sa plate-forme, disponible dans Chat.mistral.ai, gagne entier et devient plus polyvalente, mais a également un avantage sur ses concurrents: la vitesse.

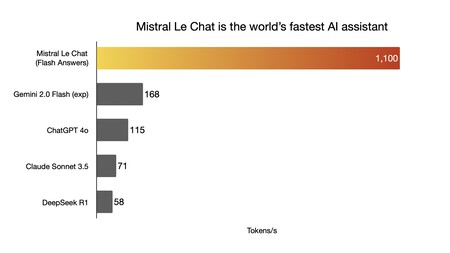

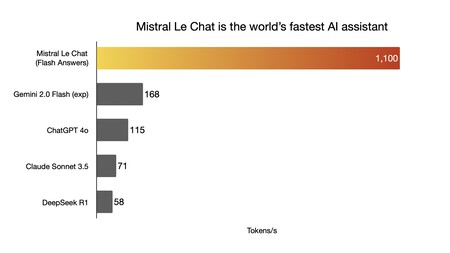

Un chatbot à 1 000 mots par seconde. Mistral responsable ne présume pas offrir des réponses plus précises ou meilleures que leurs concurrents, mais ils sont clairs sur une chose: « La raison du chat, réagit et répond plus rapidement que tout autre assistant de chat, à environ 1 000 mots par seconde. »

Réponses flash. C’est le nom de cette caractéristique de Le Chat, qui, selon ses créateurs, est amélioré par les modèles de performances et de latence les plus élevés, en plus de « les moteurs d’inférence les plus rapides de la planète ». La fonctionnalité Flash Answers vient de faire ses débuts dans une version préliminaire pour tous les utilisateurs, et les utilisateurs peuvent le désactiver s’ils le souhaitent.

Premier test. Pour démontrer la vitesse des réponses de Le Chat, nous voulions faire une comparaison avec Chatgpt et Claude, deux des chatbots les plus réputés en ce moment. Nous voulions d’abord demander « ce qu’est Simseo » pour voir ce que ces moteurs ont répondu. La réponse de Claude est la plus étendue, mais aussi pleine d’erreurs. Le Chat répond, bien sûr, très rapidement et est plus concis, mais fait également une erreur (les blogs SL ont été acquis par WebEdia il y a des années). Chatgpt est le plus précis de la description.

Deuxième test. Mais si ce que nous voulons, c’est voir à quelle vitesse ces chatbots génèrent, il est préférable de vous demander explicitement d’écrire beaucoup. Ici, nous demandons aux trois de nous écrire 10 paragraphes sur la situation des tarifs aux États-Unis. Le Chat s’est avéré être le plus rapide lors de la génération du texte, et sa réponse a également été très bien structurée, elle était à jour et comprenait des rendez-vous. La réponse de Claude, bien que pertinente, était davantage axée sur les mesures précédentes du gouvernement de Joe Biden et n’a pas inclus de nominations. Chatgpt, bien qu’il ait pris plus de temps, a également offert un très correct et des références.

Troisième test. Enfin, nous voulions tester la qualité de la traduction de l’espagnol vers l’anglais pour voir si cela a affecté la vitesse. Nous passons un lien à l’un de nos derniers articles sur Google et demandons aux trois chatbots de le traduire. Ici, Claude s’est excusé d’abord indiquant qu’il ne pouvait pas accéder à Internet, mais nous pourrions copier le texte. Le Chat était à nouveau le plus rapide, bien qu’il ait été noté que dans la traduction, cette vitesse était un peu plus faible. Ce modèle et Chatgpt ont fait une traduction assez décente, bien que trop fidèle au texte. Il est vrai que ces modèles peuvent toujours être invités à faire une traduction plus libre, mais sa qualité en tout cas est remarquable.

Le Chat gagne de loin en vitesse (et ce n’est rien de mal en précision). Le modèle Mistral a démontré dans ces tests compétitifs dans la précision et la qualité des réponses, ce qui est certainement prometteur pour les aspirations de la startup française. Le meilleur de tous est qu’il s’avère effectivement beaucoup plus rapide dans l’inférence et la génération de texte (il ne s’applique pas dans d’autres sections telles que la génération d’images), quelque chose qui sans aucun doute ses rivaux s’efforcera de correspondre à l’avenir .

Image: cerveau.

Pourquoi est-ce un chat si rapide? La réponse est simple: pour générer ces réponses MyStral très rapides, elle s’est alliée à la Brain Company, qui est l’auto-alimentation comme «le fournisseur d’inférence le plus rapide au monde». Ils appliquent leurs jetons et leur technologie au modèle Mistral Large 2 123B qui est basé sur le chat, et grâce à cela, ils atteignent jusqu’à 1 100 jetons par seconde dans les demandes de texte.

Recherche également sur le Web. Les réponses de Le Chat sont également soutenues par des consultations auprès des médias ou des agences d’information en tant qu’AFP – avec qui Mistral a un accord de collaboration – mais également pour la possibilité de rechercher le Web avec une vitesse pour collecter des informations pour créer leurs réponses. Dans ces réponses, les sources à partir desquelles les informations sont supprimées sont citées (bien que toujours).

Et génère même des images. Dans le nouveau CHAT, les options arrivent en tant qu’option de chargement de document avancé pour les traiter avec OCR, une toile pour utiliser le chat LE de manière conversationnelle / collaborative et même un interprète de code qui vous permet d’exécuter du code dans un bac à sable. Mais il est également possible de l’utiliser pour générer des images grâce au modèle Flux Ultra Generative of Black Forest Labs, l’un des plus à la mode ces derniers temps. Ces types d’options peuvent être appréciés dans la version gratuite, mais si nous voulons les utiliser avec plus de consultations quotidiennes, nous pouvons payer l’abonnement de 14,99 euros par mois de la version Le Chat (les étudiants ne paient que 4,99 euros par mois).

Dans Simseo | Amazon a perdu le train AI, mais veut le récupérer. Le nouvel Alexa avec IA arrivera ce mois-ci pour essayer