Combatter Deepfakes avec une vérification de type CAPTCHA qui utilise des interactions physiques en temps réel

Des chercheurs du Carnegie Mellon University Robotics Institute et du Massachusetts Institute of Technology (MIT), ont créé Charcha (évaluation humaine informatique pour recréer des personnages avec des actions humaines), un protocole de vérification sécurisé et personnalisé qui permet à la ressemblance d’un individu de paraître dans le contenu vidéo génératif. L’équipe a été inspirée pour créer de la charcha pour répondre aux problèmes éthiques dans une IA générative, comme des FaKes Deepfakes non autorisés. La recherche est publiée sur le arxiv serveur de préimprimée.

« Lorsque nous avons réalisé à quel point il était facile de gratter les données d’Internet et de créer un contenu d’IA réaliste sans consentement, nous savions que nous voulions développer une sauvegarde », a déclaré Mehul Agarwal, chercheur co-dirigé et étudiant de la maîtrise en 2024 à la CMU. « Nous réagissons à la capacité croissante des acteurs malveillants à abuser de l’IA générative et à essayer de rester en avance sur la courbe. »

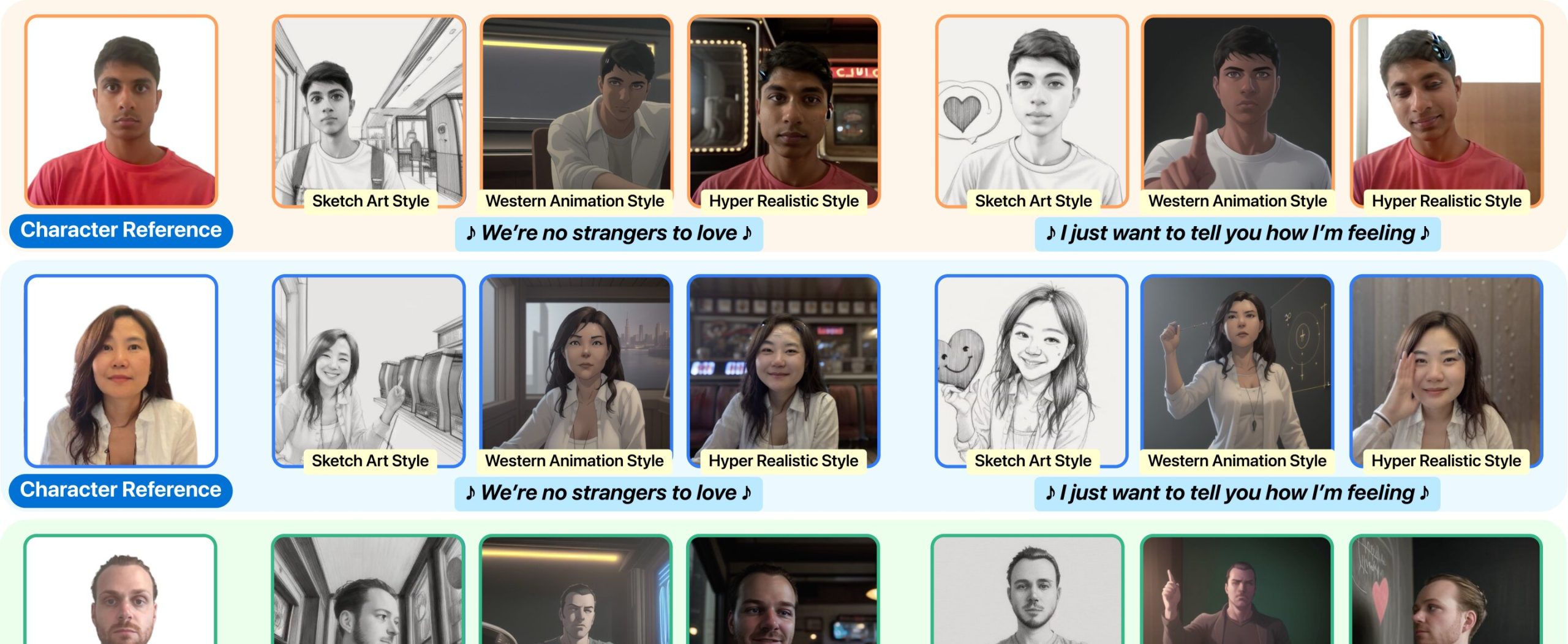

Le système Charcha a été inspiré par l’héritage de vérification de Captcha. Alors que CAPTCHA utilise des tests de texte ou d’image pour différencier les humains et les bots, Charcha s’appuie sur des interactions physiques en temps réel pour les différencier. Le programme demande aux utilisateurs d’effectuer un ensemble d’actions physiques randomisées devant une webcam, comme tourner la tête de gauche à droite, les yeux aux yeux ou souriant de dents.

Le processus de vérification en direct, qui prend environ 90 secondes, analyse les actions pour s’assurer que la personne est présente et imiter les demandes appropriées. En s’assurant que la personne interagit avec le système, Charcha empêche les images vidéo préenregistrées ou fixes de contourner la vérification.

« Les algorithmes intégrés analysent les micro-mouvements pour vérifier que l’utilisateur est physiquement présent et non une simulation », a déclaré Gauri Agarwal, chercheur co-dirigé et école des anciens de la CMU en informatique travaillant au MIT Media Lab. « Une fois qu’il est convaincu que vous avez terminé l’action avec précision et en temps réel, le programme utilisera ces images pour former notre modèle. »

Le processus Charcha offre un niveau d’autonomie unique aux utilisateurs qui choisissent d’interagir avec elle. En utilisant le programme, les utilisateurs n’ont pas à abandonner entièrement le contenu d’IA génératif, mais peuvent à la place personnaliser des clips ou d’autres contenus en toute confiance.

« De nombreuses plates-formes stockent indéfiniment les données et ont des politiques peu claires sur la façon dont le contenu généré par l’IA peut être utilisé », a déclaré Mehul. « Charcha déplace la responsabilité envers les utilisateurs en leur permettant de se vérifier avant que des images puissent être générées. Il ne s’appuie pas sur des politiques de confidentialité externes et donne aux gens un plus grand contrôle sur leur ressemblance. »

Gauri et Mehul Agarwal ont présenté Charcha lors de la conférence 2024 sur les systèmes de traitement de l’information neuronal (INIPS), où il a suscité un intérêt important de la part de multiples leaders de l’industrie.

« Je pense que la réponse positive de notre public lors de la conférence met vraiment en évidence la nécessité de sécurité entourant des outils d’IA génératifs », a déclaré Gauri. « Cela a contribué à confirmer notre conviction que Charcha pourrait être un outil essentiel pour l’avenir. »