Code Llama 70B est le nouveau modèle d’IA de programmation de Meta. Il est à un pas de dépasser GPT-4

La programmation n’a jamais été aussi simple. Les modèles d’IA générative qui servent d’assistants aux développeurs continuent d’avancer sans s’arrêter, et après l’apparition de plateformes comme GitHub Copilot, de plus en plus d’alternatives ont commencé à émerger. Ce dernier, développé par Meta, est particulièrement prometteur sur un point clé : sa licence Open Source permet – plus ou moins – de l’utiliser gratuitement.

Code Lama 70B. Chez Meta, ils continuent de progresser dans le développement de modèles d’IA génératifs. Le dernier d’entre eux est Code Llama 70B, qui, selon eux, est leur modèle d’IA générateur de code « le plus grand et le plus performant ». Il s’agit d’une évolution du modèle apparu en août 2023.

Vous demandez, il programme. Ce grand modèle de langage (LLM) nous permet de générer du code de tous types via des invites textuelles. Selon les responsables de Meta, « Code Llama a le potentiel d’être utilisé comme outil éducatif et de productivité pour aider les programmeurs à écrire des logiciels plus robustes et mieux documentés ».

Formation spécifique. Le modèle est une version spécialisée de Llama 2 (qui concurrence GPT-3.5 et GPT-4) qui a été créée en entraînant ce dernier modèle spécifiquement avec des référentiels de code. Code Llama 70B peut générer à la fois du code et du langage naturel sur le code (par exemple, pour expliquer ce que fait une certaine fonction) et peut être utilisé à la fois pour terminer le développement de notre code et pour le déboguer.

Jetons Go-Go. Les langages pris en charge incluent Python, C++, Java, PHP, Typescript (Javascript), C# et Bash. Le modèle est disponible en quatre tailles différentes : 7B (conçu pour fonctionner localement, un GPU suffit), 13B, 34B et 70B, et chacun de ces modèles est entraîné avec 500 milliards de jetons de code, à l’exception du modèle 70B, qui a été formé avec un milliard de paramètres.

Les performances du modèle Code Llama 70B ont été fantastiques lors des tests.

Contexte géant. Ces modèles prennent également en charge une immense fenêtre contextuelle pouvant aller jusqu’à 100 000 jetons. Un jeton équivaut normalement à un mot ou à un petit groupe de mots, ce système est donc capable d’accepter une grande quantité de code puis de travailler dessus.

Modèles spécialisés. Dans Meta, ils indiquent qu’en plus du modèle générique, Code Llama 70B, ils ont ajouté « Code Llama – Python » spécialisé dans le code dans ce langage, ainsi que « Code Llama – Instruct », plus destiné à poursuivre le processus de formation du modèle pour mieux comprendre les invites et ce dont l’utilisateur a besoin.

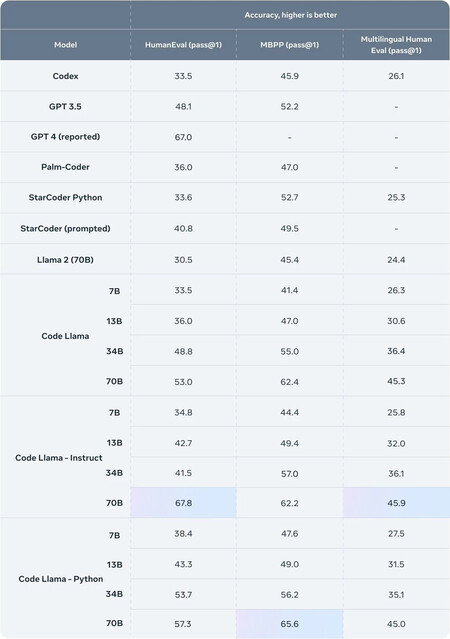

des résultats fantastiques. Les tests qui évaluent les performances du Code Llama 70B dans le domaine de la programmation montrent que ce modèle fonctionne remarquablement. Ils ont utilisé à la fois HumanEval et Mostly Basic Python Programming, et dans les deux cas, le modèle Meta surpasse GPT-3.5 et se rapproche des performances de GPT-4, le modèle le plus performant d’OpenAI.

Disponible dès maintenant. Comme pour Llama 2, ce modèle est également disponible à la fois sur des plateformes qui facilitent son utilisation directe – Hugging Face en est une parmi les plus notables – et via son référentiel GitHub. Son utilisation est gratuite et ouverte à des fins personnelles et commerciales, ce qui présente certainement une alternative très intéressante aux outils payants similaires.

Si après avoir tant entendu parler Samsung Galaxy S24 avec intelligence artificielle Vous en aviez envie, n’attendez plus. Obtenez-le chez Vodafone. Que vous soyez client ou non, vous bénéficierez d’offres exclusives pour que le smartphone du moment soit à vous. Avant!

Conseils proposés par la marque

À Simseo | « Nous avions tort » : l’IA d’OpenAI était trop ouverte, donc le secret absolu prévaut dans GPT-4