Claude Mythos, AI Anthropic parmi les cyber-risques mondiaux

Anthropic a présenté Claude Mythos Preview, un modèle d’intelligence artificielle conçu pour identifier les cybervulnérabilités à grande échelle. L’annonce, publiée le 7 avril 2026, intervient quelques jours seulement après la publication accidentelle en ligne de documents techniques et de codes sources liés à la même technologie.

La décision de limiter l’accès au modèle marque une discontinuité par rapport aux stratégies antérieures du secteur : l’entreprise affirme que les capacités de Mythos sont telles que sa distribution publique est risquée.

Accès restreint et coalition industrielle

Anthropic a choisi de mettre le système à la disposition uniquement d’un consortium de plus de 40 organisations, réunies dans le projet Glasswing. Parmi les participants figurent Amazon, Apple, Microsoft et Google, ainsi que des fournisseurs d’infrastructures tels que Cisco et Broadcom et des sociétés spécialisées telles que CrowdStrike.

Les organisations qui maintiennent des logiciels open source critiques, notamment la Linux Foundation, participent également au projet. Anthropic a alloué jusqu’à 100 millions de dollars de crédits pour encourager l’utilisation du modèle et recueillir des commentaires opérationnels.

Fuites de données et crédibilité de la sécurité

Les débuts de Mythos s’accompagnent de questions sur la sécurité interne de l’entreprise. En mars 2026, un cache public a rendu accessibles les descriptions techniques du modèle. Dans les jours suivants, une partie du code source de l’assistant Claude Code a été divulguée en ligne.

Anthropic a attribué les deux incidents à une erreur humaine. Cependant, la séquence rapprochée des incidents a suscité des doutes parmi les observateurs et les opérateurs du secteur sur la gestion des données sensibles, compte tenu notamment du caractère stratégique des technologies développées.

Claude Mythos : capacités techniques et recherche automatisée

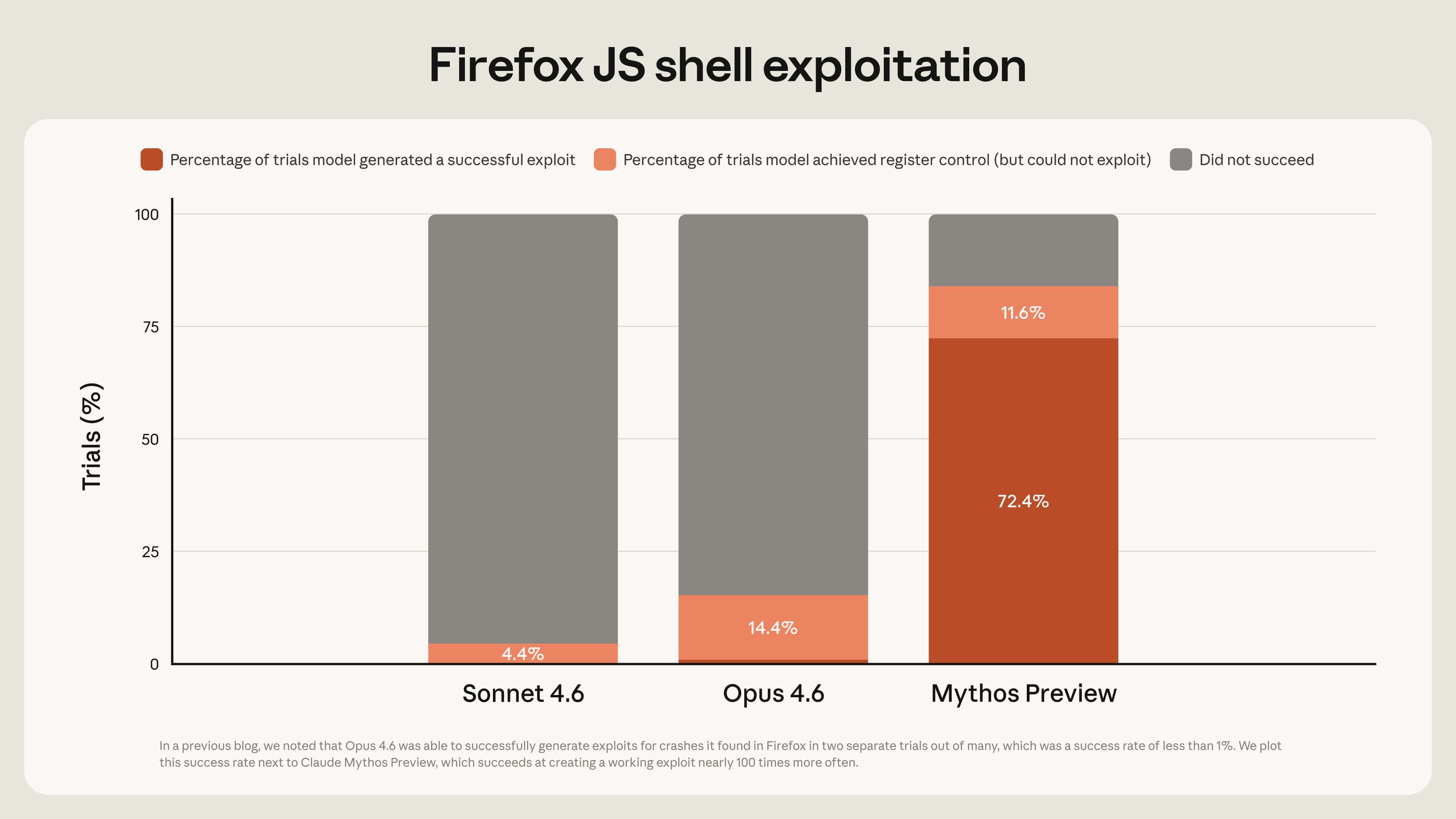

Claude Mythos est décrit par ses développeurs comme un système capable de mener des recherches autonomes en cybersécurité. Le modèle peut analyser le code, trouver des vulnérabilités et, dans certains cas, développer des exploits fonctionnels.

Selon les données publiées par Anthropic, au cours des premières semaines d’utilisation, le système a identifié des milliers de vulnérabilités « jour zéro« , c’est-à-dire des défauts inconnus même des développeurs des logiciels concernés. Le champ d’analyse inclut les systèmes d’exploitation, les navigateurs et les applications largement utilisées.

Parmi les exemples cités figurent une vulnérabilité présente depuis 27 ans dans OpenBSD, un système d’exploitation open source conçu pour être hautement sécurisé, et une erreur dans un logiciel vidéo détectée après des millions de tests automatiques infructueux.

Le double usage de la technologie

La capacité même à identifier les vulnérabilités représente le principal élément de risque. Anthropic reconnaît que des outils comme Mythos peuvent être utilisés à la fois pour renforcer la sécurité et attaquer l’infrastructure numérique.

Jared Kaplan, directeur scientifique d’Anthropic a déclaré dans une interview que l’objectif est de donner une longueur d’avance aux acteurs engagés dans la défense des systèmes informatiques en accélérant l’identification et la correction des failles.

Dans le même temps, Logan Graham, responsable des tests internes, a qualifié le modèle de révolutionnaire pour l’ensemble du secteur, avec des implications directes sur l’équilibre entre défenseurs et attaquants dans le cyberespace.

Comparaison avec les précédents du secteur

Le choix de ne pas rendre public le modèle rappelle des précédents dans le secteur de l’intelligence artificielle. En 2019, OpenAI a initialement limité le déploiement du modèle GPT-2, invoquant des risques liés à la génération automatique de contenus manipulateurs.

Dans le cas de Mythos, Anthropic affirme que le niveau de risque est plus immédiat, car lié aux infrastructures critiques et à la sécurité des systèmes informatiques mondiaux.

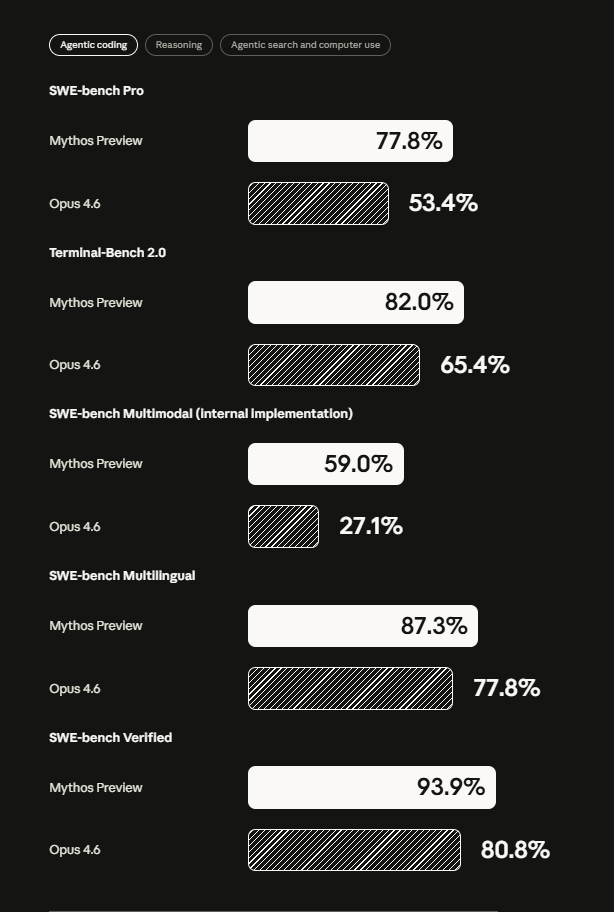

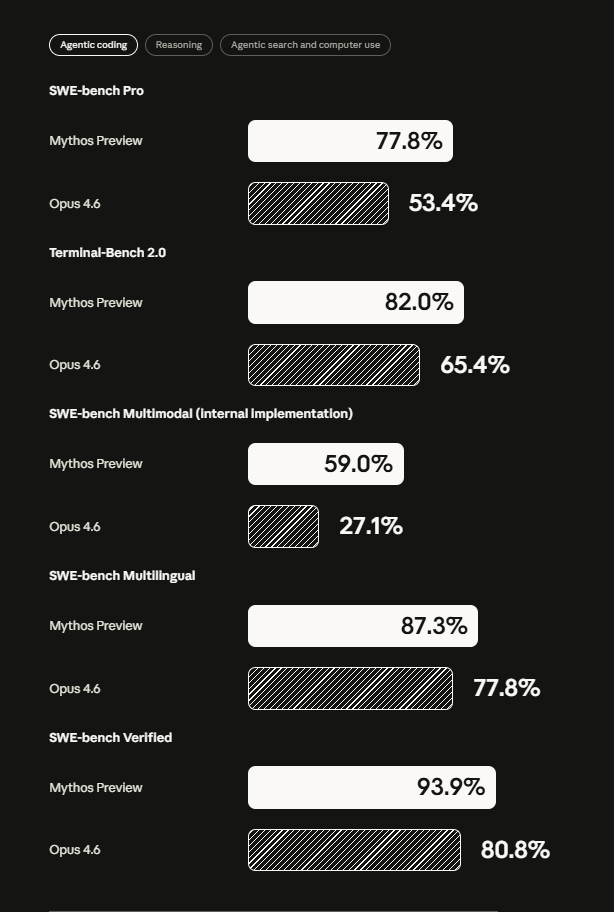

Projet Aile de Verre

Le projet Glasswing a été créé sur la base des capacités observées dans le nouveau modèle de frontière développé par Anthropic, Claude Mythos2 Preview. Un modèle généraliste – pas encore publié – qui met en évidence un fait pertinent : les systèmes d’intelligence artificielle ont atteint un tel niveau d’écriture et d’analyse de code qu’ils surpassent presque tous les êtres humains dans l’identification et l’exploitation des vulnérabilités logicielles.

Le projet tire son nom de papillon aux ailes de verrela Greta oto. La métaphore peut être interprétée de deux manières : les ailes transparentes du papillon lui permettent de se camoufler à la vue de tous, un peu à l’image des vulnérabilités évoquées dans cet article ; ils lui permettent aussi d’échapper au danger, tout comme la transparence que nous défendons dans notre démarche.

Les conséquences sur l’économie, la sécurité publique et la stabilité nationale pourraient être importantes. Le projet Glasswing est né comme une initiative visant à orienter ces capacités vers des objectifs défensifs.

Dans le cadre du projet, les partenaires impliqués utilisent Mythos Preview pour des activités de sécurité défensive. Anthropic partage ses conclusions pour générer des bénéfices à l’échelle de l’industrie.

Le projet Glasswing est présenté comme un point de départ. Aucune organisation ne peut à elle seule relever les défis de la cybersécurité : les développeurs d’IA avancés, les éditeurs de logiciels, les chercheurs, les communautés open source et les gouvernements sont tous appelés à contribuer.

Il faudra des années pour renforcer les défenses de l’infrastructure numérique mondiale, tandis que les capacités de l’IA devraient progresser rapidement à court terme.

Selon les promoteurs, une action immédiate est nécessaire pour permettre aux systèmes de défense de conserver un avantage.

Croissance économique et stratégie d’entreprise

Anthropic occupe une position unique sur le marché de l’IA. D’une part, elle développe des modèles de plus en plus avancés et génère des revenus croissants ; d’autre part, elle met publiquement en avant les risques liés à ses technologies.

Selon les données publiées par l’entreprise, les revenus annuels attendus pour 2026 dépasseront les 30 milliards de dollars, contre 9 milliards de dollars l’année précédente. La croissance est principalement liée à l’adoption du système Claude comme outil de programmation.

L’optimisation des capacités de codage a des effets directs sur la sécurité : un système capable d’écrire du code complexe est également capable de l’analyser et d’identifier ses faiblesses.

Impacts sur le marché de la cybersécurité

L’introduction de modèles comme Mythos change les temps et les méthodes de la cybersécurité. Des tâches qui nécessitaient auparavant des mois de travail humain peuvent être exécutées en quelques minutes par des systèmes automatisés.

Selon Elia Zaitsev, directeur technologique de la société de cybersécurité CrowdStrike, l’accès au modèle démontre à quel point les capacités défensives peuvent évoluer rapidement, mais suggère en même temps que des acteurs malveillants chercheront à exploiter des outils similaires.

Le risque, également souligné par les opérateurs du secteur, est que la découverte systématique de vulnérabilités devienne un processus continu et automatisé, augmentant la pression sur les entreprises et les institutions pour qu’elles mettent constamment à jour leurs systèmes.

Le nœud des infrastructures existantes

Une des questions ouvertes concerne la sécurité des systèmes basés sur du code obsolète. De nombreuses infrastructures critiques, des services numériques aux systèmes industriels, utilisent des composants développés il y a des années.

Selon Graham, ces systèmes étaient considérés comme relativement sûrs car ils nécessitaient des compétences élevées et une longue période d’attaque. L’automatisation introduite par l’intelligence artificielle pourrait modifier cet équilibre, rendant vulnérables même les plateformes auparavant considérées comme protégées.

Investissements et soutien à l’open source

En plus des crédits partenaires, Anthropic a annoncé un financement de 4 millions de dollars pour des groupes développant des logiciels open source afin de renforcer leur sécurité.

Le sujet est pertinent car de nombreux systèmes critiques sont basés sur des composants open source, souvent maintenus par de petites communautés aux ressources limitées.

Une course technologique vouée à s’accélérer

Selon les dirigeants de l’entreprise, les capacités de Mythos ne sont pas le résultat d’une formation spécifique en cybersécurité, mais une conséquence générale de l’augmentation des performances des modèles d’intelligence artificielle.

Cela implique que des fonctionnalités similaires pourraient rapidement apparaître dans d’autres systèmes développés par des concurrents. La concurrence entre acteurs publics et privés pour exploiter ces technologies va s’intensifier.

Implications systémiques

La mise en place d’outils capables d’identifier et d’exploiter les vulnérabilités à l’échelle mondiale soulève des questions sur la résilience des infrastructures numériques. La possibilité pour des acteurs non spécialisés de lancer des analyses avancées avec des commandes simples réduit les barrières à l’entrée dans le domaine des cyberattaques.

Dans le même temps, la disponibilité de ces outils pour les organisations de défense pourrait améliorer la capacité de prévention et de réponse.

Le choix d’Anthropic de limiter la diffusion du modèle signale la perception d’un risque élevé, mais n’élimine pas la perspective que des technologies similaires deviennent accessibles à l’avenir.

Mot-clé : Claude Mythe

Titre SEO (60 caractères)

Claude Mythos, AI Anthropic parmi les cyber-risques mondiaux

Méta description (130 caractères)