Chine imparable: après Deepseek arrive Qwen2.5-max par Alibaba

L’écho des actes de Deepseek n’a pas encore été éteint, qui vient une nouvelle famille de grands modèles linguistiques « Made in China »: Qwen 2.5développé par Nuage d’alibaba. Les caractéristiques de ces modèles sont certainement intéressantes, en particulier le modèle « Max ». Voici les principaux détails:

Qwen 2.5, les principales caractéristiques

La version comprend des modèles LLM Qwen2.5, avec une nouveauté significative: tout le monde a été pré-investigateur sur un ensemble de données de taille énorme qui couvre jusqu’à 20 billions (mille milliards) de jeton.

Par rapport à la version précédente, Qwen2.5 a des améliorations significatives:

- une meilleure connaissance (MMLU sur 85)

- Amélioration de la capacité de codage (Humaneval 85+)

- Amélioration des compétences mathématiques (mathématiques 80+)

- soutenir 128K jeton

- génération jusqu’à 8K jeton

- Prise en charge multilingue au-delà 29 languesy compris chinois, anglais, français, espagnol, portugais, allemand, italien, russe, japonais, coréen, vietnamien, thaï, arabe et autres.

Les modèles spécialisés

La famille comprend deux modèles d’experts:

- CODER QWEN2.5: spécialisé dans le codage

- Qwen2.5-Math: Spécialisé en mathématiques

Les modèles ont également été introduits Qwen2.5-14b Et Qwen2.5-32bqui dépassent les modèles de référence de dimensions similaires ou plus grandes, telles que le pH-3.5-MOE-Insstruit et Gemma2-27b-it.

Modèles de codage

CODER QWEN2.5 a été formé sur 5,5 billions Jeton de données relatives au code, permettant également aux modèles plus petits d’obtenir des performances concurrentielles dans la référence d’évaluation du codage.

Modèles mathématiques

Qwen2.5-Math soutient à la fois le chinois et l’anglais et intègre différentes méthodes de raisonnement, notamment:

- Chaîne de thougt (COT)

- Programme de thougt (pot)

- Raisonnement intégré aux outils (TIR)

Qwen2.5-max

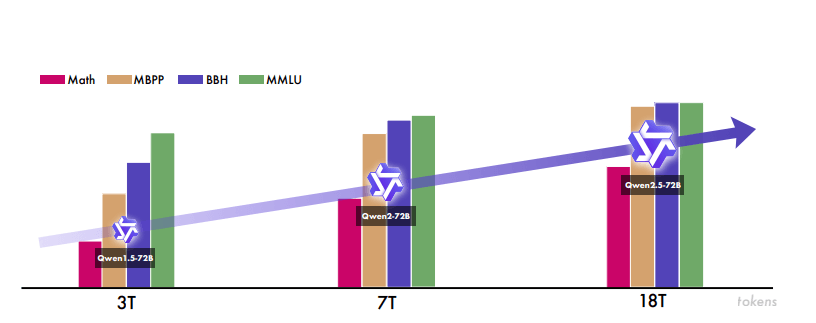

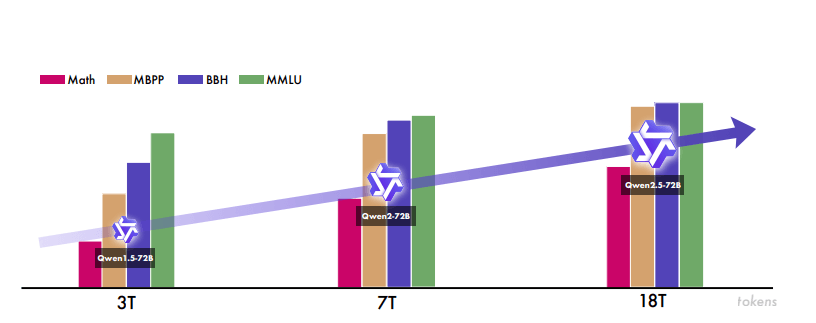

Il est maintenant reconnu qu’il grimpe continuellement à la fois de la taille des données et de celles du modèle Améliorations significatives dans l’intelligence du modèle. Cependant, la communauté de la recherche et de l’industrie a une expérience limitée dans l’escalade efficacement des modèles extrêmement importants, qu’il s’agisse de modèles et de modèles denses Mixth of-Expert (MOE). De nombreux détails critiques relatifs à ce processus de scalant n’ont été divulgués qu’avec la récente version de Deepseek V3.

Qwen2.5-max Il s’agit d’un modèle MOE à grande échelle qui a été pré-investig Plus de 20 milliards (mille milliards) de jeton et supplémentaire post-édité avec des méthodologies bien entretenues de Réglage fin supervisé (SFT) Et Renforcement d’apprentissage de la rétroaction humaine (RLHF).

28 janvier, Premier jour du Nouvel An lunaire 2025Alibaba a partagé les résultats des performances QWEN2.5-MAX et a annoncé la disponibilité de ses abeilles via Alibaba Cloud.

Vous pouvez explorer les caractéristiques de Qwen2.5-max sur le chat Qwen.

Qwen 2.5-max, performance

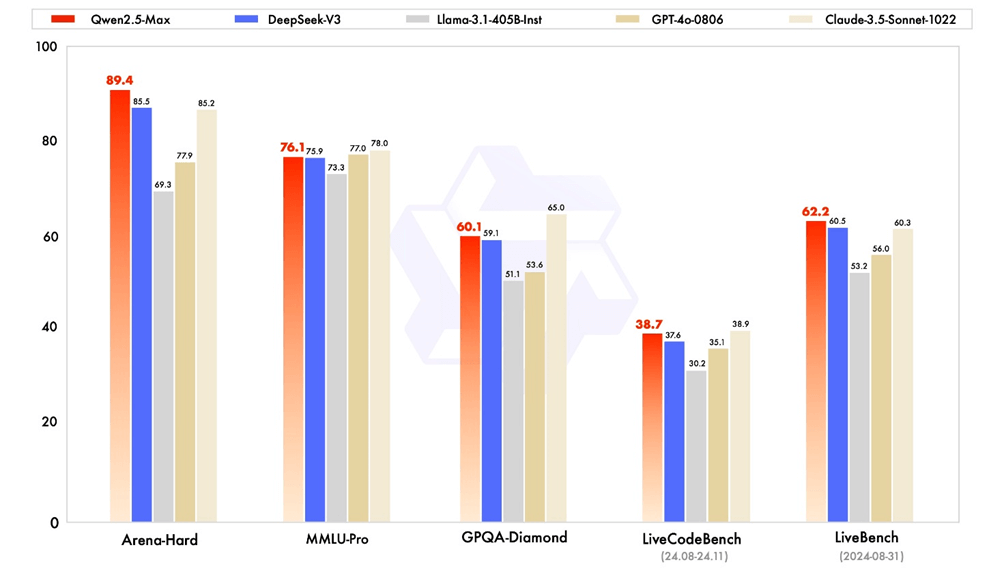

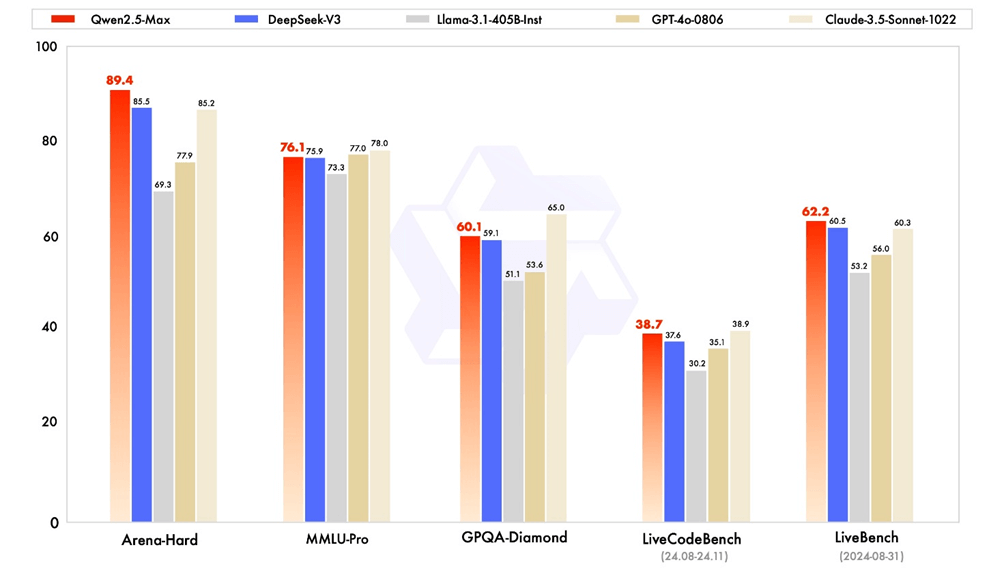

Qwen2.5-Max a été évalué avec les principaux modèles, à la fois les propriétaires et les jeux ouverts, à travers une série de repères de grand intérêt pour la communauté. Celles-ci incluent Mmlu-proqui teste les connaissances à travers des problèmes de niveau universitaire, Livecodebenchqui évalue les compétences de codage, Live-benchqui dirige pleinement les compétences générales, e Arène dureque les préférences humaines approximatives. Les résultats incluent les scores de performance pour les modèles de base et pour les modèles instructifs.

Commençons par comparer les performances des modèles qui peuvent être utilisés pour des applications telles que le chat et le codage directement. Nous présentons les résultats des performances Qwen2.5-max avec les principaux modèles de pointe, y compris Deepseek V3, GPT-4O et Claude-3.5-Sonnet.

Qwen2.5-max dépasse Deepseek v3 Dans une référence telle que Arena-Dard, LiveBench, LivecodeBench et GPQA-Diamond, montrant également des résultats compétitifs dans d’autres évaluations, telles que MMLU-PRO.

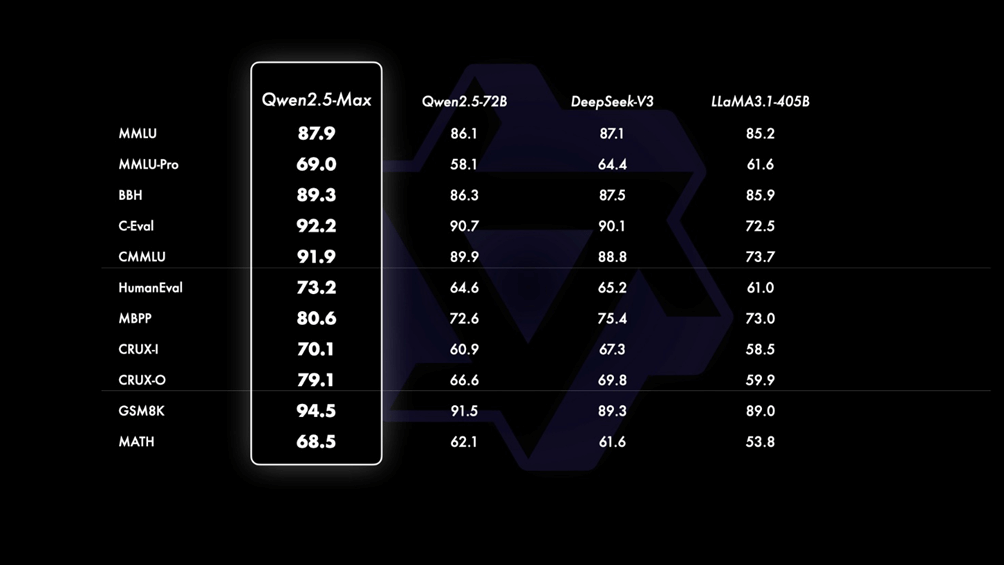

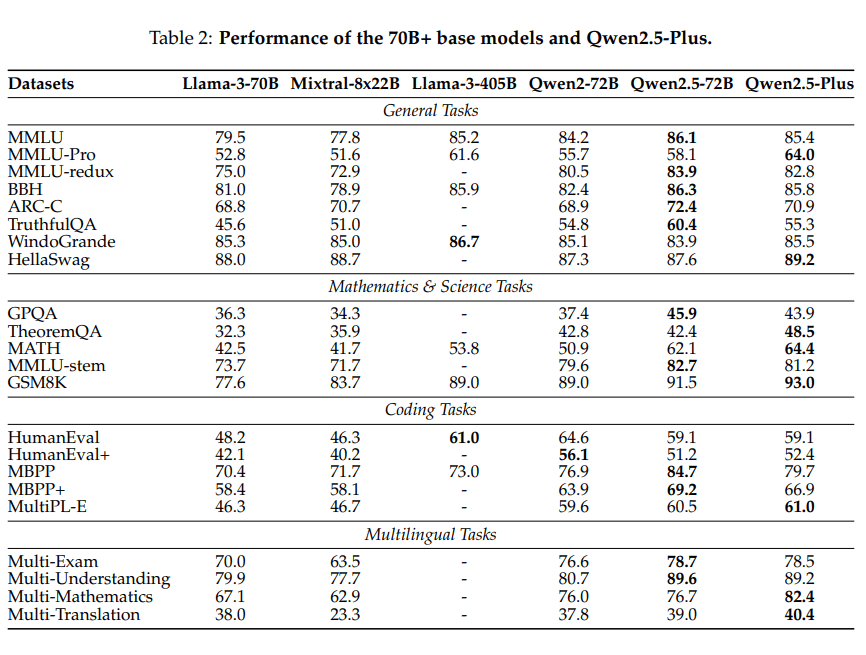

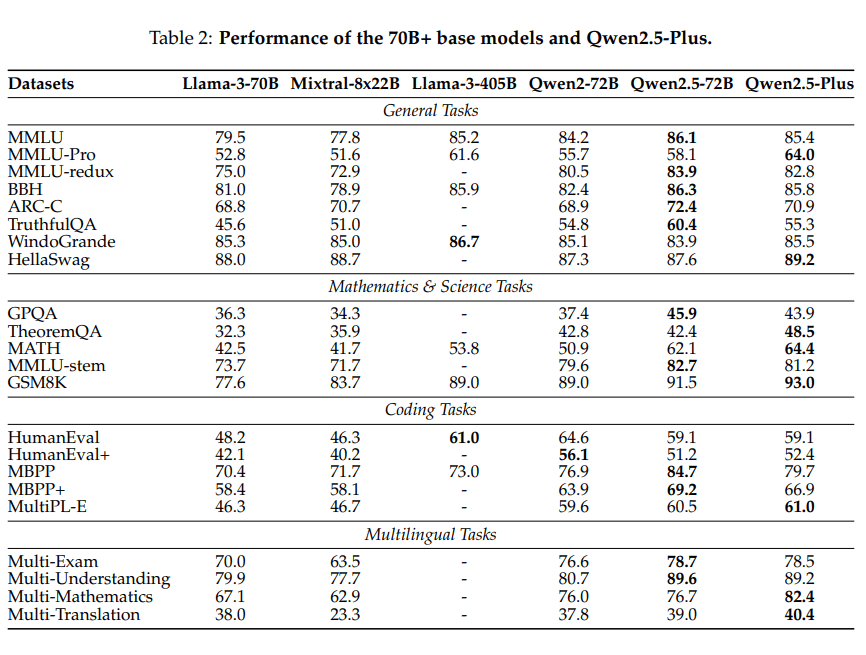

En comparant les modèles de base, Alibaba n’a pas été en mesure d’accéder aux modèles de propriétaires tels que GPT-4O et Claude-3.5-Sonnet. Par conséquent, ils ont évalué Qwen2.5-max par rapport à Deepseek V3, l’un des principaux modèles de poids ouvert MOE; Llam-3.1-405ble plus grand modèle de poids ouvert dense, e Qwen2.5-72bqui est également parmi les meilleurs modèles ouverts de poids dense. Les résultats de cette comparaison sont présentés ci-dessous.

Les modèles de base ont montré des avantages significatifs dans la plupart des références et Alibaba serait optimiste que les progrès des techniques post-entraînement apporteront la prochaine version de QWEN2.5-MAX à de nouveaux niveaux.

Qwen 2.5-max se démarque également consommation d’énergie légèrement inférieureun facteur de plus en plus important dans l’évaluation des modèles d’intelligence artificielle.

Comment utiliser qwen2.5-max

Qwen2.5-max est disponible en Chat qwen Et il est possible de discuter directement avec le modèle, de jouer avec les artefacts, d’effectuer des recherches, etc.

L’API QWEN2.5-MAX (dont le nom du modèle est QWEN-MAX-2025-01-25) est disponible. Vous pouvez enregistrer un compte Cloud Alibaba et activer le service Alibaba Cloud Model Studio Service, puis accéder à la console et créer une clé API.

Étant donné que les abeilles de Qwen sont compatibles avec OpenAI-API, la pratique courante de l’utilisation des abeilles OpenA peut être suivie directement.

Vous trouverez ci-dessous un exemple d’utilisation de Qwen2.5-max dans Python:

à partir d’Openai Import OpenII

Importer un système d’exploitation

Client = Openai (

Api_key = os.getenv (« api_key »),

Base_url = « https://dashscope-intl.aliyuns.com/compatible-mode/v1 ″,

)

Openation = client.chat.complerations.create (

Model = « Qwen-Max-2025-01-25 »,

Messages = (

{‘Role’: ‘System’, ‘Content’: ‘Vous êtes un assistant utile.’},

{‘Rôle’: ‘utilisateur’, ‘contenu’: ‘Quel numéro est grand, 9.11 ou 9.8?’}

)

)

Imprimer (complétion.choices (0) .Message)

Quels secteurs bénéficient de l’utilisation de Qwen 2.5-max

Qwen 2.5-max est particulièrement avantageux pour différents secteurs clés:

Développement de logiciels

- Assistance par écrit et correction du code

- Analyse des exigences de conception

- Prise en charge des programmeurs dédiés aux outils

Recherche scientifique

- Traitement des données complexes

- Analyse mathématique avancée

- Prise en charge des recherches interdisciplinaires

Automobile

- Développement de systèmes de conduite autonomes

- Traitement des données des capteurs et des vidéos

- Assistance dans la conception technique

Jeux vidéo

- Génération de contenu

- Développement de fiction et de scénarios

- Amélioration de l’expérience de jeu avec génératif

Services multimédias

- Génération de texte à partir de texte

- Transformation des images statiques en contenu dynamique

- Compréhension et analyse des longues vidéos.

Dans quel contexte Qwen2.5-max montre une plus grande précision sémantique

Qwen 2.5-max montre une plus grande précision sémantique dans différents contextes clés:

Développement de logiciels

- Analyse du code complexe

- Interprétation des exigences de conception

- Compréhension du contexte de programmation

Traitement linguistique

- Support multilingue (plus de 29 langues)

- Capacité à Changement de type sémantique

- Gestion des nuances contextuelles dans les différentes langues

Recherche scientifique

- Élaboration de données textuelles complexes

- Analyse des relations sémantiques subtiles

- Reconstruction de contextes scientifiques articulés

Caractéristiques distinctives

Le modèle se démarque:

- Grande capacité compréhension contextuelle

- Précision dans l’interprétation de nuances sémantiques

- Capacité à gérer dépendances sur le contexte

Sa force réside dans la capacité d’aller au-delà de l’interprétation littérale, capturant des significations implicites et des relations sémantiques complexes dans différents domaines d’application.

Les prochaines étapes

L’évolutivité des données et la taille des modèles montrent non seulement des progrès dans l’intelligence des modèles, mais reflètent également l’engagement constant dans la recherche pionnière. Alibaba se déclare engagée à améliorer les pensées de pensée et de raisonnement de grands modèles linguistiques grâce à l’application innovante de l’apprentissage pour le renforcement scalaire. Cet engagement promet de permettre à ses modèles de transcender l’intelligence humaine.

Qwen 2.5-max et censure du gouvernement

Qwen 2.5-max d’Alibaba, contrairement à Deepseek-R1, semble faire face à des sujets brûlants pour les autorités chinoises d’une manière différente. Par exemple, Alibaba répond aux questions sur les événements de la Piazza Tiananmen sans limites, mentionnant même la « censure rigoureuse imposée par le gouvernement chinois à ces événements » dans ses réponses.

Où se terminent les données?

L’utilisation de l’IA chinois telles que Deepseek et Qwen soulève des questions inquiétantes sur la confidentialité et la sécurité des données des utilisateurs. Les entrées textuelles ou audio, les fichiers chargés, les commentaires et la chronologie de chat sont en fait stockés sur des serveurs qui sont physiquement situés dans la République populaire de Chine.

Il y a donc de sérieuses préoccupations concernant la possibilité que les données collectées de l’IA puissent être partagées avec le gouvernement chinois, conformément aux lois du pays sur la sécurité informatique, qui Ils obligent les entreprises à fournir des données aux autorités sur demande.

La famille Qwen 2.5, les performances et les innovations

Actuellement, vous assistez à une tendance importante vers I Modèle de petite langue (SLM), opposé à LLM (modèle de grande langue). L’écart de performance avec le modèle grand langage réduit rapidement. Modèles avec Seulement 3 milliards de paramètres Ils obtiennent des résultats très compétitifs. Le modèle Qwen2.5-3b C’est un exemple, démontrant des performances considérables, malgré la petite taille.

Améliorations post-entraînement

Les développeurs ont affiné les méthodologies post-entraînement avec quatre mises à jour clés:

- Prise en charge de la génération de textes jusqu’à 8k jetons longs

- Amélioration de la compréhension des données structurées

- Génération plus fiable de sorties structurées (en particulier au format JSON)

- Améliorer les performances sur différentes invites de système pour faciliter le jeu de rôle.

Alibaba, un nouveau géant de l’IA

Fondée en 1999 par Jack maisAlibaba a commencé comme un marché B2B pour mettre en contact des producteurs chinois avec des acheteurs internationaux. Au fil des ans, la société a élargi sa gamme de services avec le lancement de Taobao, une plate-forme destinée aux consommateurs, et Alipay, un système de paiement numérique qui a transformé le marché financier chinois.

Au cours des dix dernières années, Alibaba a élargi ses opérations dans le cloud computing, l’intelligence artificielle et la logistique, s’affirmant comme un géant technologique mondial.

Qui est Jack mais, le visionnaire derrière Alibaba

Né en 1964 à Hangzhou, Jack mais il est l’un des entrepreneurs les plus charismatiques et les plus influents en Chine. Après avoir commencé sa carrière en tant que professeur d’anglais, il a fondé Alibaba avec l’intention d’utiliser Internet comme outil de croissance pour les petites entreprises chinoises. Jack mais a quitté le guide de l’entreprise au début de 2023

La race de l’IA entre la Chine et les États-Unis

Le développement rapide des modèles d’intelligence artificielle chinoise intensifie la concurrence avec les États-Unis. Les résultats obtenus de Deepseek dans le domaine de la formation en intelligence artificielle ont eu un impact sur les marchés financiers.

Dans une récente interview, l’ancien président Donald Trump a défini la montée en puissance de Deepsek comme une « sonne d’alarme » pour les entreprises américaines, soulignant la nécessité d’investissements plus importants dans l’intelligence artificielle pour maintenir l’avantage concurrentiel.