ce que disent maintenant les petits caractères de GhatGPT

OpenAI change le ton de sa politique d’utilisation lorsqu’il s’agit d’applications militaires et de guerre. Dans une récente mise à jour des lignes directrices qu’elle donne à ses utilisateurs, l’entreprise dirigée par Sam Altman a appliqué un petit changement, presque terminologique, mais il est significatif : elle a supprimé la mention explicite qui interdisait l’utilisation de sa technologie dans les activités. » militaire » et « guerre ».

L’organisation, derrière le populaire ChatGPT, maintient son veto sur le « développement et l’utilisation des armes », même si elle renonce désormais aux termes de guerre qui figuraient auparavant dans sa politique d’utilisation. Bien entendu, le changement n’est pas passé inaperçu.

Mise à jour de la politique d’utilisation. Il n’est pas étrange qu’une entreprise comme OpenAI applique des changements à ses politiques d’utilisation à mesure que la technologie qu’elle propose évolue. Si vous accédez à son site internet et consultez la rubrique correspondante, vous pourrez consulter un « change log » dans lequel près d’une douzaine ont été répertoriées depuis février 2021. Il y a un peu plus d’un an par exemple, en février 2023, l’entreprise a décidé de modifier ses « cas d’utilisation et politiques de contenu » et a précisé les activités qu’il n’autorise pas dans les secteurs « à haut risque ».

Le dernier changement dans les politiques d’utilisation remonte à seulement quelques jours, le mercredi 10 janvier, et se présente comme une mise à jour des lignes directrices pour les rendre « plus claires » et fournir des « conseils plus précis » aux utilisateurs.

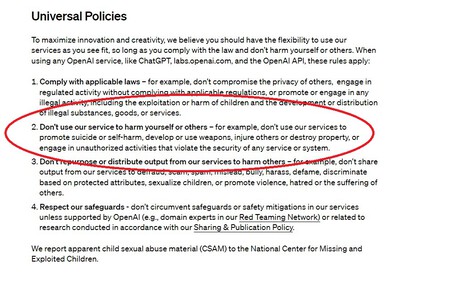

Rédaction actuelle de la politique d’utilisation.

Là où j’ai dit militaire et guerre… Les innovations appliquées par l’entreprise ne sont pas passées inaperçues auprès de Sam Biddle, journaliste de The Intercept, qui a publié hier un article faisant écho à la modification subtile et significative appliquée par l’équipe d’Altman. Le changement, dit Biddle, a eu lieu le 10 janvier.

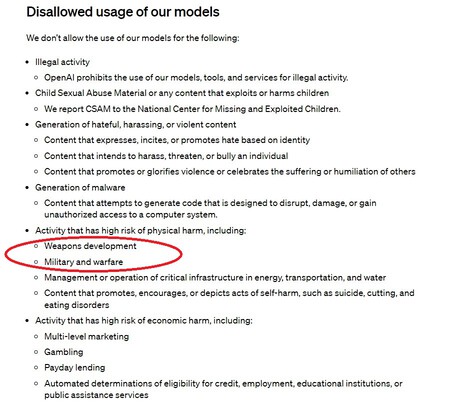

Jusqu’à ce moment, la politique d’utilisation d’OpenAI indiquait avec une clarté méditerranéenne que l’une des utilisations que l’entreprise n’autorisait pas était « militaire et de guerre ». Les deux termes ont été inclus dans la section des activités à « risque élevé de dommages physiques », qui mentionnait également expressément le « développement d’armes » et tout contenu qui « promeut, encourage ou représente des actes d’automutilation ».

Formulation précédente d’une partie de la politique d’utilisation d’OpenAI.

…Je dis seulement les armes. Désormais, la formulation de la politique d’utilisation est sensiblement différente et élimine les deux termes : militaire et guerre. Au lieu de cela, OpenAI inclut une légende interdisant aux personnes d’utiliser sa technologie pour se faire du mal ou nuire à autrui : « Par exemple, n’utilisez pas nos services pour promouvoir le suicide ou l’automutilation, développer ou utiliser des armes, nuire à autrui ou détruire des biens, ou vous engager dans des activités non autorisées qui violent la sécurité de tout service ou système. La nouvelle formulation maintient la mention du développement d’armes, et non de leur utilisation militaire.

Mais… Comment interpréter le changement ? C’est la question à un million de dollars. Les politiques d’utilisation d’OpenAI ont subi davantage de changements et l’entreprise assure que l’objectif est de les rendre « plus claires » et de fournir des « conseils spécifiques » sur le service. « Notre objectif était de créer un ensemble de principes universels faciles à retenir et à appliquer, d’autant plus que nos outils sont désormais utilisés dans le monde entier par des utilisateurs quotidiens qui peuvent désormais également créer des GPT », explique Niko Felix, porte-parole de l’entreprise.

La pertinence du changement n’est cependant pas passée inaperçue auprès des médias américains comme TechCrunch ou The Intercept lui-même, qui l’interprètent comme un « assouplissement » du veto à l’usage militaire et assure que le Pentagone surveille de près l’entreprise dirigée par Altman, un poids lourd dans le domaine de l’IA et qui bénéficie du soutien de plusieurs millions de dollars de Microsoft, qui parmi ses services vante des technologies pour « la défense et le renseignement » et a reçu, avec Amazon, Google et Oracle, quelque 9 milliards de contrats du Pentagone .

Des interprétations et des usages. « Il y a une nette différence entre les deux politiques, car la première stipule clairement que le développement d’armes et la guerre militaire sont interdits ; la seconde met l’accent sur la flexibilité et le respect de la loi », a déclaré Heidy Khlaaf à The Intercept, de la société de cybersécurité Trail of Bits. Un avis similaire est exprimé par Lucy Suchman, de l’Université de Lancaster, qui affirme que le changement « laisse un espace ouvert » à OpenAI pour soutenir des « infrastructures opérationnelles » sans développement direct d’armes.

L’agence de presse américaine rappelle que, si aucune des technologies proposées par OpenAI ne peut être utilisée pour tuer quelqu’un, il existe des tâches qu’un outil comme ChatGPT pourrait alléger, notamment l’écriture de code ou le traitement des commandes. Les ressources OpenAI seraient également utiles, par exemple, pour travailler rapidement avec de grandes quantités de documentation.

Images : Village Global et OpenAI 1 et 2

À Simseo : le nouveau GPT Store compte trois millions de chatbots personnalisés. Pas un seul ne voudra être ton petit-ami