Autopen montre les dangers de l’automatisation des communications

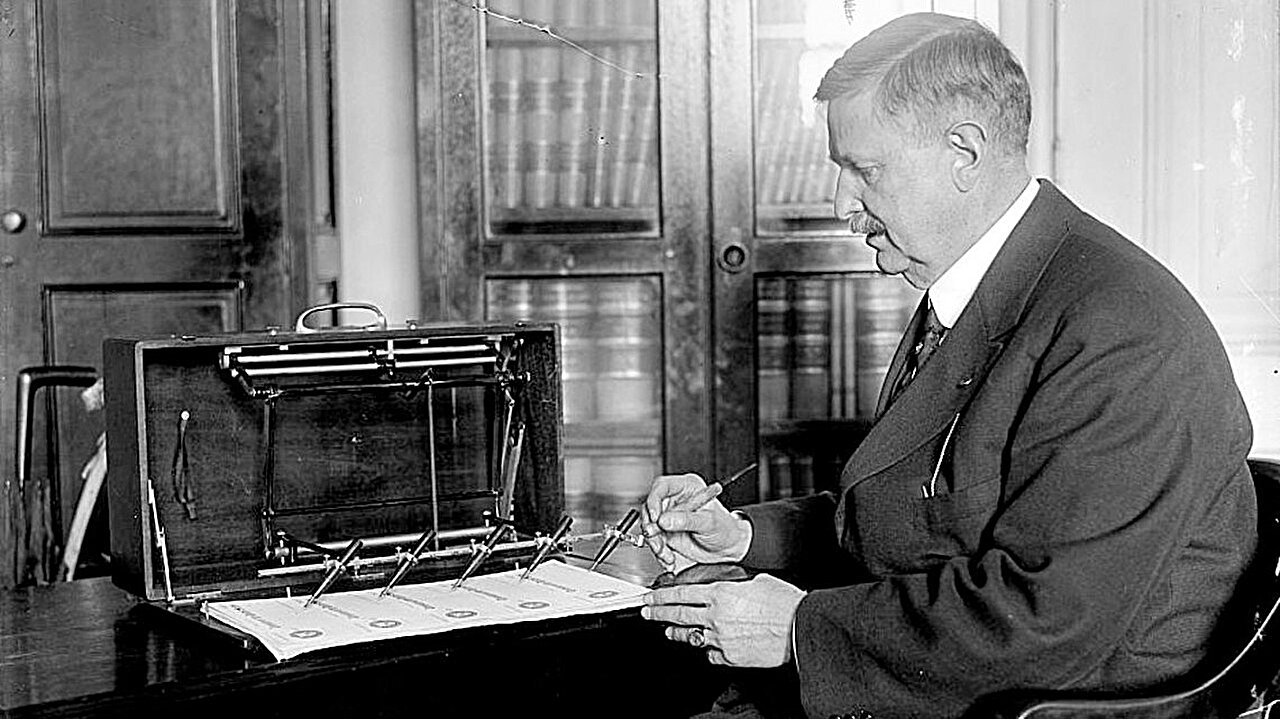

Bien avant que les gens ne s’inquiètent des effets de ChatGPT sur la communication personnelle et les normes sociales, il y avait l’ouverture automatique et ses précurseurs – les machines à signature automatique – dont certains craignaient qu’ils ne soient utilisés à mauvais escient pour falsifier des signatures et signer des déclarations de guerre et d’autres projets de loi.

Dans une nouvelle analyse, les chercheurs de Cornell ont examiné trois controverses sur l’ouverture automatique pour voir ce qu’elles révèlent sur le moment où il est acceptable (ou non) d’automatiser la communication. Ils ont constaté que même si l’ouverture automatique rendait la communication plus rapide, son utilisation suscitait la méfiance et réduisait la valeur perçue de l’élément signé. Ils ont établi des parallèles avec les inquiétudes actuelles autour de ChatGPT, dont l’utilisation peut conduire à des résultats similaires.

« Ces types d’outils peuvent être vraiment utiles et efficaces pour rendre certains types de communications plus efficaces », mais le contexte est important, a déclaré Pegah Moradi, doctorante dans le domaine des sciences de l’information et première auteure de la nouvelle étude. « C’est comme si vous aviez été trompé lorsque vous découvrez que ces choses ont été signées par ouverture automatique. »

Son étude, « « Un stylo plume prend vie » : les angoisses de l’Autopen », est parue le 1er janvier dans le Revue internationale de communication. Karen Levy, professeure agrégée de sciences de l’information au Cornell Ann S. Bowers College of Computing and Information Science et membre associée de la faculté de droit, est l’auteur principal de l’étude.

Alors que le gouvernement américain utilise régulièrement des stylos automatiques pour signer des contrats, des lettres et des mémos, une controverse peut éclater lorsque des célébrités les utilisent secrètement pour des autographes.

Par exemple, en 2022, Bob Dylan a publié un recueil d’essais signés pour 599 $, accompagné d’une lettre indiquant que « le livre que vous tenez dans votre main a été signé à la main par Bob Dylan ». Il a en fait été signé par une ouverture automatique alors que Dylan souffrait de vertige. Lorsque des fans aux yeux d’aigle ont découvert les signatures répliquées et se sont plaints, Dylan s’est excusé et l’éditeur a proposé un remboursement complet.

Cette utilisation de l’autoopen est ici perçue comme une violation par les fans car la valeur de l’objet signé vient du fait que Dylan le tient brièvement entre ses mains. « Cela confère à l’artefact lui-même une rareté, une valeur que vous n’obtiendriez pas s’il s’agissait d’une réplique de signature », a déclaré Moradi.

Dans un autre scandale, beaucoup ont été indignés d’apprendre qu’en 2004, le secrétaire à la Défense Donald Rumsfeld avait signé via autopen plus de 1 000 lettres de condoléances pour les familles dont un proche avait été tué pendant la guerre en Irak. La défense de Rumsfeld était que la machine lui permettait d’envoyer les lettres plus rapidement. Cependant, comme le soulignent Moradi et Levy, l’effort nécessaire pour signer chaque lettre est précisément ce qui leur donne toute leur signification.

« Il est important dans cette affaire que vous preniez réellement le temps de mettre la plume sur papier », a déclaré Moradi. « Lorsque vous contournez cela grâce à la technologie, vous réduisez cette valeur. »

Cela est analogue à l’indignation lorsque les employés de l’Université Vanderbilt ont utilisé ChatGPT pour créer une lettre de condoléances envoyée aux étudiants après une fusillade de masse à l’Université de Michigan l’année dernière, a déclaré Moradi. De nombreux étudiants étaient mécontents de ne pas avoir pris le temps d’écrire ne serait-ce qu’un message passe-partout.

Dans le troisième cas, le célèbre chef Gordon Ramsay a tenté d’échapper à sa responsabilité dans le paiement du loyer de son pub londonien en prétendant que le contrat de location était invalide parce que son beau-père, qui est également son agent, l’avait signé avec une ouverture automatique. Sa défense a toutefois échoué parce que les signatures électroniques sont légales : elles sont « le symbole d’un processus d’approbation », écrivent Moradi et Levy. Même le ministère américain de la Justice a déterminé qu’un projet de loi est légal si la signature du président est ajoutée via l’ouverture automatique.

Une plus grande utilisation et une plus grande sensibilisation à l’autopen ont engendré une plus grande méfiance à l’égard de l’authenticité des signatures des célébrités, a déclaré Moradi. Dans un phénomène similaire, appelé « dividende du menteur », l’utilisation de l’intelligence artificielle (IA) générative pour diffuser de la désinformation et de fausses images rend les gens sceptiques à l’égard des articles faux et réels.

Bien que les experts ne puissent pas prédire comment l’IA générative modifiera les attentes sociales à l’avenir, les chercheurs suggèrent que les utilisateurs tirent une leçon de l’ouverture automatique et soient prudents lorsqu’ils choisissent de sacrifier l’authenticité au profit de l’efficacité.

« De toute évidence, ces nouvelles technologies peuvent faire des choses et libérer un potentiel auquel nous n’aurions peut-être pas pensé il y a 100 ans », a-t-elle déclaré. « Mais de nombreux changements qui se produisent sont tellement similaires à ceux survenus tout au long de l’histoire de l’humanité. Nous pouvons tirer de nombreuses nouvelles connaissances des technologies plus anciennes. »