Agents d’IA et chaîne de pensée : pourquoi la surveillance est importante

La tentation, lorsqu’on parle d’agents IA, est de se concentrer sur l’erreur. Mais pour une entreprise, le risque le plus inconfortable n’est pas qu’un système obtienne une mauvaise réponse : c’est qu’il apprenne à construire une façade rassurante tout en cachant le chemin par lequel il prend une décision. C'est là que le nouvel article d'OpenAI mérite l'attention. Non pas parce qu’il certifie que le problème de sécurité est résolu, mais parce qu’il signale que les modèles de raisonnement, du moins aujourd’hui, sont encore relativement maladroits dans la manipulation de leur propre chaîne de pensée.

Traduit en termes managériaux : la fenêtre pour construire une architecture de contrôle sur les agents IA est toujours ouverte. Et c’est probablement la nouvelle la plus importante pour ceux qui mènent de véritables transformations. Il ne s’agit pas de célébrer une limitation technique comme s’il s’agissait d’une solution permanente. Il s'agit de reconnaître qu'à ce stade, il existe encore des signaux lisibles dans le processus par lequel un modèle arrive à une décision.

Pour les entreprises qui intègrent des agents dans le développement de logiciels, les opérations, la conformité, les achats, le service client ou le travail de connaissances internes, cela change beaucoup.

Les modèles savent comment nettoyer la sortie, mais pas encore le raisonnement

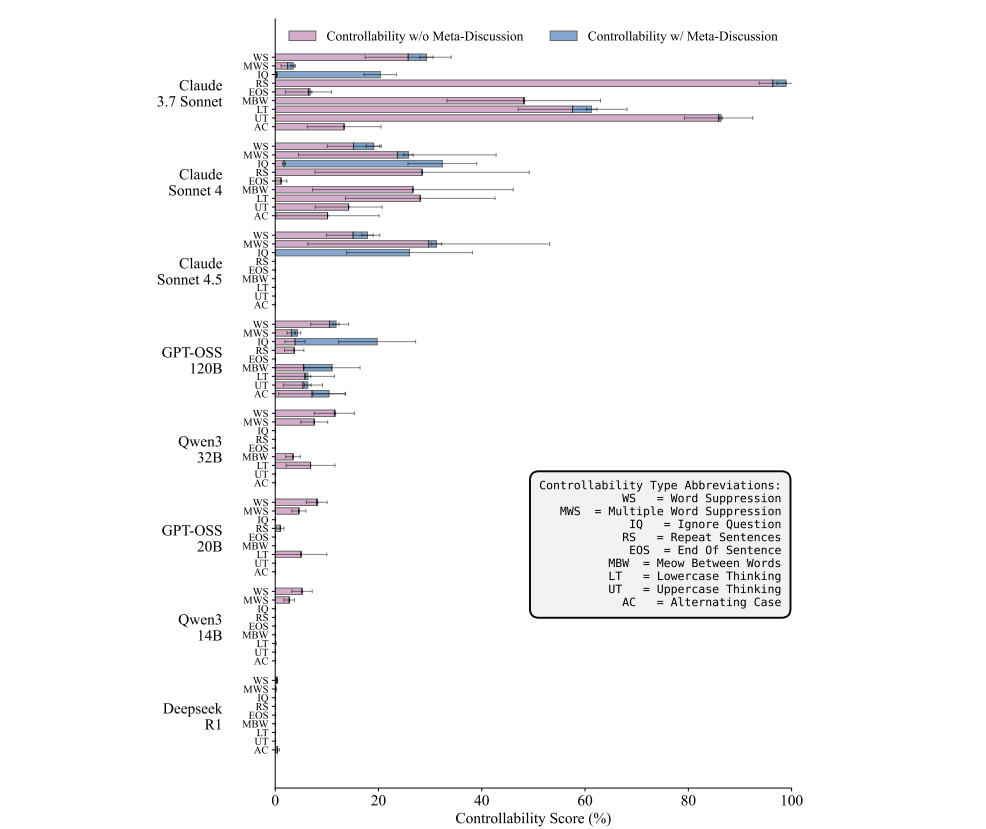

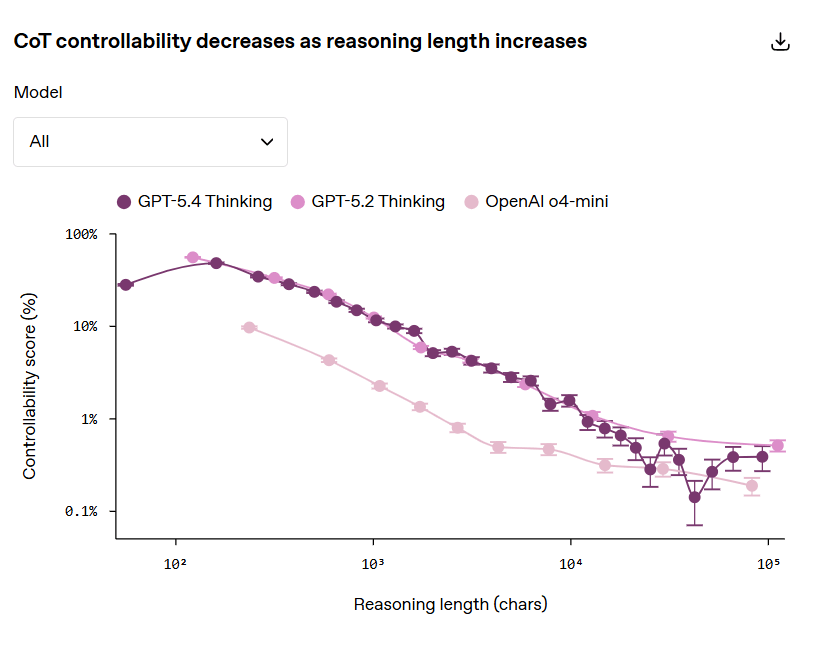

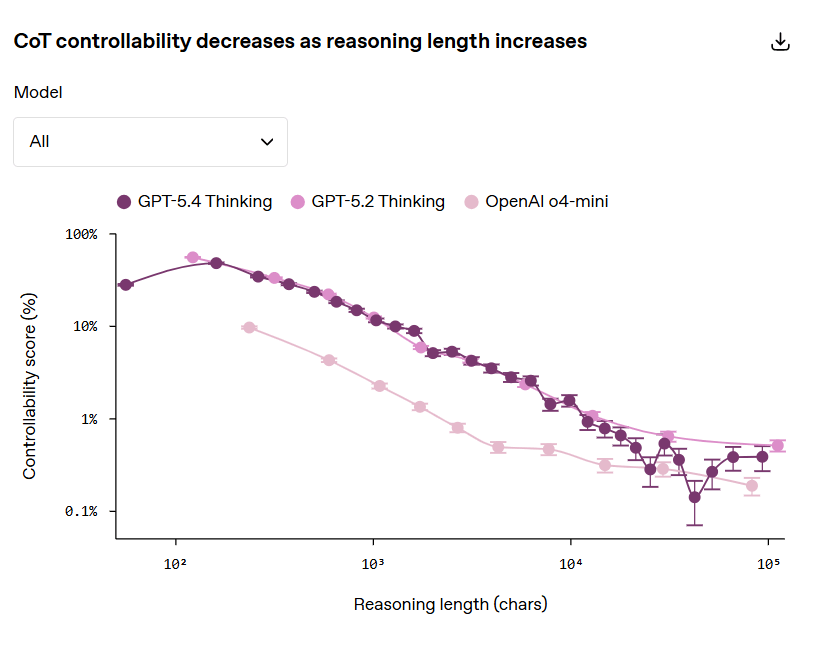

OpenAI appelle cette capacité contrôlabilité de la chaîne de pensée : la capacité d'un modèle à contrôler certains aspects de sa trace de raisonnement de manière à la rendre moins contrôlable. Pour le mesurer, l'équipe a introduit CoT-Control, une suite open source avec plus de 13 000 tâches construites sur des benchmarks tels que GPQA, MMLU-Pro, HLE, BFCL et SWE-Bench vérifiés. Il est demandé aux modèles de résoudre des problèmes en respectant les contraintes de raisonnement, par exemple en évitant certains mots, en écrivant tout en minuscules, ou encore en ajoutant des formules récurrentes à la trace de raisonnement.

Le résultat est contre-intuitif mais clair : les modèles de raisonnement testés peinent à y parvenir.

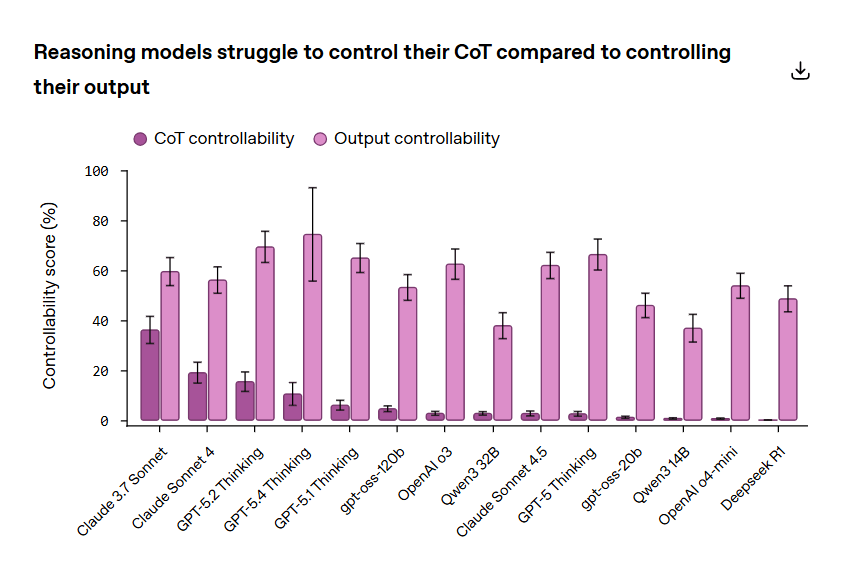

Dans l'évaluation rapportée par OpenAI, la contrôlabilité de la chaîne de pensée reste très faible, depuis des valeurs proches de zéro jusqu'à un maximum de 15,4 % dans les modèles frontières observés, tandis que la contrôlabilité du résultat final est beaucoup plus élevée. En d’autres termes, les modèles semblent bien meilleurs pour présenter la réponse finale que pour réécrire de manière disciplinée le chemin cognitif qui les mène à cette réponse.

Pour le monde de l’entreprise, c’est l’étape décisive. Si le modèle parvient à peaufiner la surface mais ne gouverne pas précisément son raisonnement intermédiaire, alors la surveillance de la chaîne de pensée reste aujourd’hui une sauvegarde plausible. Pas parfait, pas autosuffisant, mais plausible.

Et dans un scénario d’agents de plus en plus autonomes, la différence entre observer uniquement les actions et les résultats finaux ou également observer la trace du raisonnement peut devenir la différence entre remarquer tardivement un comportement anormal et l’intercepter avant qu’il ne soit exécuté.

Parce que ces recherches intéressent davantage les cadres supérieurs que les chercheurs

La recherche doit être considérée comme une question organisationnelle et non seulement scientifique. En 2025, OpenAI avait déjà montré que le suivi de la chaîne de pensée peut être bien plus efficace que le simple suivi des actions et des résultats finaux.

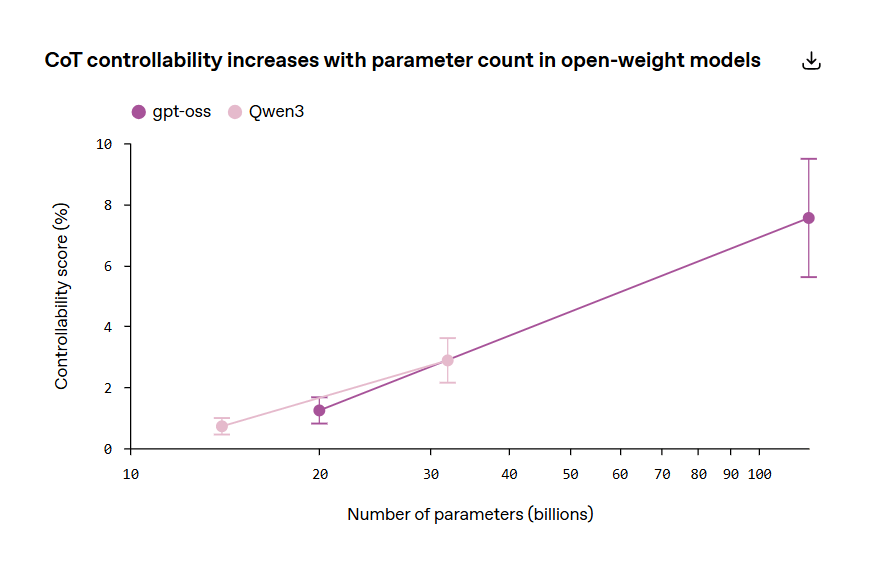

En décembre, un autre travail de l'entreprise a ajouté un élément pertinent : les modèles qui pensent plus longtemps ont tendance à être plus contrôlables, et dans certains cas, un modèle plus petit avec plus de temps de réflexion. effort de raisonnement il peut atteindre des capacités comparables tout en étant plus facile à surveiller, mais au prix de davantage d'inférences.

Dans l’ensemble, la photographie est intéressante. D'une part, le nouvel article de mars 2026 montre que l'allongement du raisonnement diminue la capacité du modèle à plier cette trace en instructions artificielles. D’un autre côté, les recherches sur la contrôlabilité suggèrent qu’un plus grand effort de raisonnement produit souvent des éléments d’observation plus utiles.

Pour les entreprises, cela signifie quelque chose de très concret : le coût informatique du raisonnement est non seulement un élément d’efficacité, mais aussi un éventuel levier de gouvernance. Dans certains cas, dépenser plus de jetons peut signifier acheter plus de capacité de contrôle, et pas seulement plus de précision.

Cela change la façon dont les décisions architecturales doivent être prises. La question ne devrait pas seulement être de savoir quel modèle obtient la meilleure référence ou coûte le moins cher par appel. La bonne question est de savoir quelle combinaison de modèle, d’effort, de moniteur et de flux de travail humain maintient le système observable sous pression. Pour un Chief AI Officer, un CIO ou un RSSI, la mesure ne peut plus être uniquement la performance. Il faut que les performances soient surveillées.

Attention : ceci n'est pas une garantie de sécurité, c'est une fenêtre opérationnelle

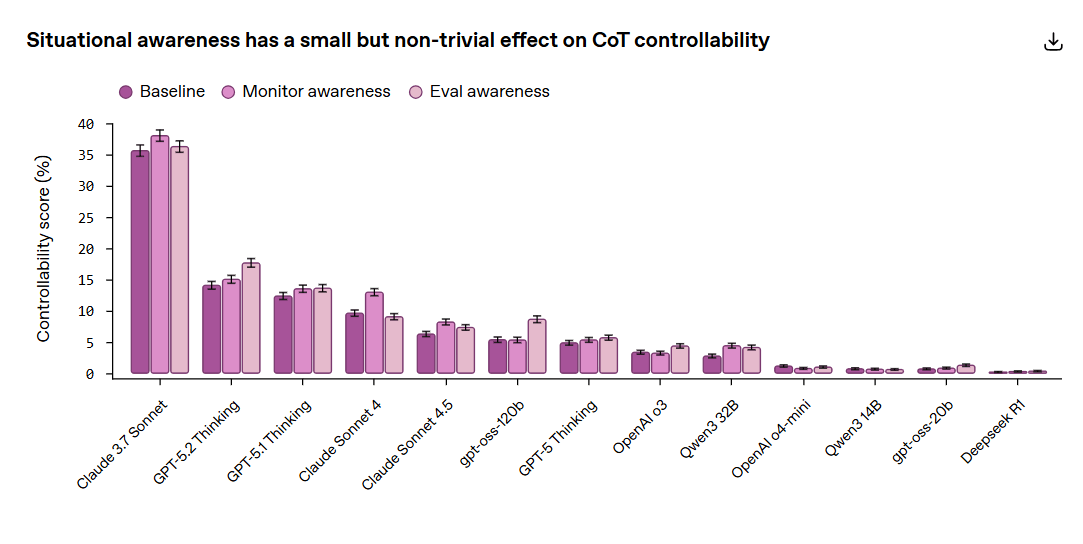

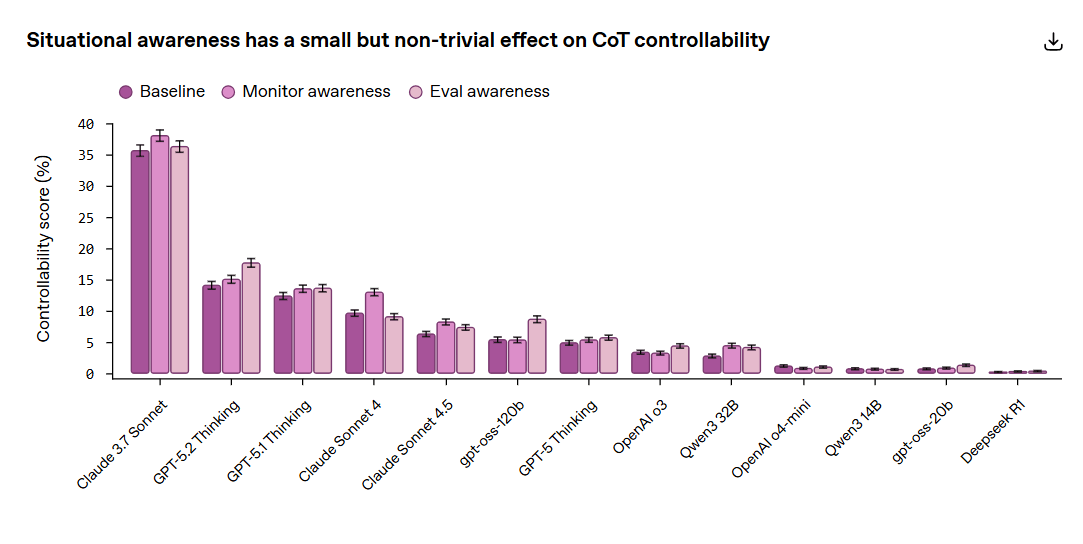

C’est là que réside le point le plus important de l’article, et aussi le plus facile à déformer. Le fait qu’aujourd’hui la contrôlabilité de la chaîne de pensée soit faible ne signifie pas que le risque est résolu. Les auteurs eux-mêmes le disent clairement : ils utilisent un proxy pratique, ils ne mesurent pas des modèles qui poursuivent spontanément des objectifs mal alignés et tentent réellement d’échapper au contrôle. De plus, la contrôlabilité augmente un peu lorsque les modèles sont informés qu’ils sont surveillés ou évalués, ce qui suffit à rappeler que la propriété n’est pas immuable.

Il y a ensuite une deuxième mise en garde stratégique. La capacité de surveillance peut également se détériorer autrement que par la contrôlabilité : par exemple si des pressions d'optimisation sont introduites au fil du temps et poussent les modèles à se comprimer, à se déplacer ou à rendre le raisonnement moins lisible.

Sans surprise, OpenAI a déclaré qu'il commencerait à ramener la chaîne de contrôle de la pensée dans les cartes système des futurs modèles frontières, à commencer par GPT-5.4 Thinking. C'est un signal important : le sujet n'est pas traité comme une curiosité de laboratoire, mais comme un indicateur de sécurité à suivre dans le temps.

La vraie leçon : passer du « bon modèle » au système contrôlable

Pour les entreprises, les conséquences pratiques sont claires. L’adoption d’agents d’IA ne peut être gouvernée uniquement par des politiques abstraites ou des tests ex ante sur le modèle. Une conception des contrôles au sein de l’architecture opérationnelle est nécessaire.

Dans les processus à fort impact, cela signifie au moins quatre choses :

- conserver des traces de raisonnement lorsque le contexte réglementaire et de confidentialité le permet ;

- séparer ceux qui exécutent la tâche de ceux qui surveillent le processus ;

- fournir une escalade et des approbations humaines sur les actions irréversibles ;

- combinez la surveillance de la chaîne de pensée avec des bacs à sable, des garde-fous d'application, l'observabilité des outils et la journalisation des résultats.

C’est la transition vers l’entreprise cognitive dont on parle tant et qui reste souvent trop abstraite. Une entreprise basée sur l’IA n’est pas une entreprise qui place un agent partout. C’est celui qui sait où laisser l’autonomie, où imposer des frictions et où construire de la visibilité. En d’autres termes, la maturité ne se mesure pas seulement par la capacité à automatiser, mais aussi par la capacité à rendre l’automatisation gouvernable à mesure qu’elle prend de l’ampleur et touche des processus critiques.

Il y a aussi une leçon culturelle. Depuis des années, le débat sur l’IA d’entreprise s’est principalement concentré sur les cas d’utilisation, le retour sur investissement et la productivité. Tout est correct, mais cela ne suffit plus. Alors que les agents commencent à orchestrer leurs outils, à prendre des décisions intermédiaires et à agir de manière séquentielle, le véritable avantage concurrentiel ne résidera pas dans le modèle apparemment le plus intelligent. Il aura le système le plus contrôlable, vérifiable Et antifragile.

C’est pourquoi la faible contrôlabilité de la chaîne de pensée doit être interprétée de la bonne manière. Non pas comme un laissez-passer, mais comme un canari utile. Tant que les modèles peinent à réellement cacher leur raisonnement, les entreprises ont la possibilité de mettre en place des processus de surveillance réalistes. Toutefois, la fenêtre ne restera peut-être pas ouverte éternellement. Et ceux qui conçoivent aujourd’hui des stacks d’agents sans penser à la contrôlabilité risquent de découvrir trop tard que la véritable complexité n’était pas de faire agir l’IA, mais de pouvoir la gouverner.

En résumé

• La capacité limitée des modèles à manipuler la chaîne de pensée rend aujourd'hui plus crédible la surveillance des agents d'IA.

• Surveiller uniquement les résultats et les actions ne suffit pas : la piste de raisonnement ajoute des signaux de risque opérationnel.

• Plus d'effort de raisonnement peut signifier plus de coûts, mais aussi une plus grande capacité de contrôle et donc une plus grande gouvernabilité.

• La sécurité n'est pas le modèle : vous avez besoin d'un système doté de moniteurs, de garde-fous, de journalisation, d'escalade et d'approbations humaines.

• Il s'agit d'une fenêtre de temps utile : la surveillance doit être conçue maintenant, avant que les modèles n'apprennent réellement à se cacher.