Recherche scientifique et IA : combien coûte réellement son utilisation

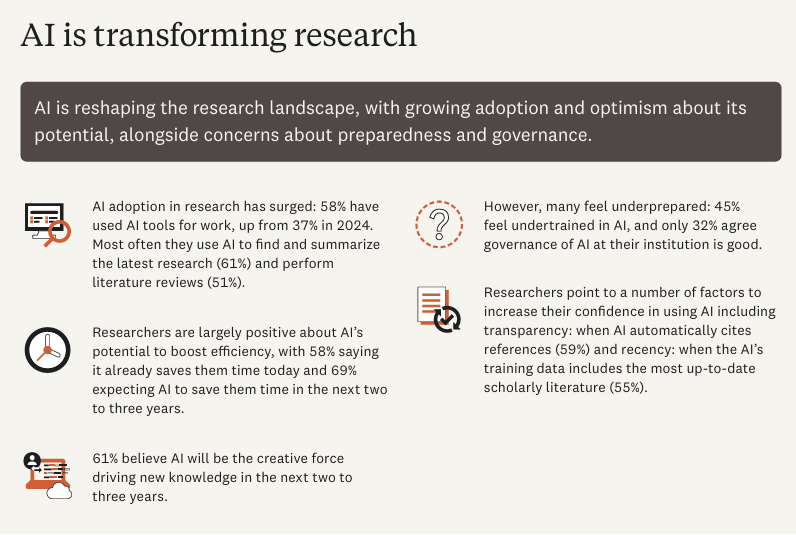

L’intelligence artificielle fait désormais partie des workflows de recherche. Il permet de rechercher et de synthétiser des études, d’accélérer la revue de littératureprend en charge le codage, aide à l’analyse des données et facilite certains travaux préparatoires dans demande de subvention. Selon Elsevier, groupe international actif dans l’information scientifique et l’édition académique, dans le rapport 2025 «Chercheur du futur — Une confiance dans la recherche», sur la base de plus de 3 200 chercheurs actifs dans 113 pays, 58 % des chercheurs utilisent déjà des outils d’IA dans leur travail ; parmi les utilisations les plus fréquentes :

- 61% les utilisent pour trouver et résumer de nouvelles études,

- 51% pour les revues de littérature

- 38 % pour l’analyse des données.

Cependant, l’adoption est en train de changer de nature. Nous ne parlons plus seulement d’expérimentations à faible coût ou de quelques licences individuelles.

Le 12 mai 2026, l’hebdomadaire scientifique international Nature a rapporté le cas du laboratoire dirigé à Stanford par le scientifique des données biomédicales James Zou, qui, l’année dernière, a dépensé plus de 100 000 dollars en outils d’IA pour des activités de recherche. Ce seuil est important car il fait passer l’IA d’une dépense de productivité à un poste budgétaire structurel.

Où l’IA crée de la valeur dans la recherche

Le premier avantage est la réduction du temps consacré aux activités à forte intensité d’information. Trouver des articles pertinents, résumer la littérature, nettoyer les données, préparer le code de support ou construire une première structure de travail sont des tâches où l’IA peut réduire le temps et les étapes manuelles.

Dans le rapport 2025 d’Elsevier, 58 % des chercheurs affirment que l’IA fait déjà gagner du temps, tandis que près de 70 % s’attendent à un bénéfice encore plus important dans les années à venir.

Il existe ensuite un deuxième niveau, plus ambitieux, qui concerne l’accompagnement à la formulation d’hypothèses et à la planification des recherches.

En février 2025, Google Research a dévoilé «Co-scientifique en IA »décrit comme un système multi-agents conçu pour aider les scientifiques à générer des hypothèses et des propositions de recherche, qui sont ensuite validées expérimentalement.

C’est un signal important : l’IA ne se limite plus à accélérer des tâches accessoires, mais vise également à entrer dans les phases les plus qualifiées du travail scientifique.

Parce que les coûts réels augmentent

Le point critique est que le prix d’entrée en dit de moins en moins sur le coût réel. Dans la recherche, les flux de travail sont souvent longs, itératifs et multi-sessions : vous basculez continuellement entre les invites, le raisonnement, le codage, la vérification, le retour aux données et la réinterrogation du modèle. Dans ce contexte, la consommation réelle croît beaucoup plus rapidement que ne le suggère un abonnement mensuel.

Le marché corrige déjà cette distorsion. Le 27 avril 2026, GitHub a officiellement annoncé qu’à partir du 1er juin 2026, Copilot passerait à un modèle de facturation basé sur la consommation réelle via les crédits IA, expliquant que l’utilisation agentique et les sessions en plusieurs étapes ont considérablement augmenté les coûts d’inférence. Le message est le suivant : plus les modèles sont utilisés comme agents opérationnels et non comme simples assistants, plus le coût se déplace du forfait vers la consommation.

Des forfaits premium sont également développés pour intercepter les usages intensifs. Dans la documentation mise à jour d’OpenAI sur les forfaits ChatGPT Pro, disponible en mai 2026, les niveaux Pro sont répertoriés à 100 $ et 200 $ par mois, avec des seuils d’utilisation beaucoup plus élevés que le forfait Plus. Cela ne prouve pas à lui seul une augmentation générale des prix, mais montre que les usages professionnels intensifs sont désormais segmentés en bandes dédiées.

Le coût caché : le travail de vérification humaine

Le problème n’est pas seulement de savoir combien coûte l’accès au modèle. C’est aussi ce qu’il en coûte pour l’utiliser de manière fiable. Dans le cas raconté par Natureplusieurs chercheurs rapportent que le goulot d’étranglement se déplace vers le contrôle des résultats : vérifier si le modèle a correctement interprété le contexte, comprendre quand la réponse commence à dérailler, refaire certaines parties du travail à la main, comparer les résultats.

Cet aspect réduit l’avantage économique attendu. Selon Elsevier, dans le rapport de 2025 cité, seuls 22 % des chercheurs qui utilisent l’IA déclarent considérer ces outils comme fiables ; 59 % déclarent qu’ils font davantage confiance lorsque les réponses incluent des références claires, tandis que 49 % indiquent qu’une validation humaine régulière est une condition nécessaire.

En pratique, une partie du travail que l’IA promet d’éliminer rapporte comme le coût de la supervision, du contrôle qualité et de la responsabilité méthodologique.

Quand le modèle le moins cher finit par coûter plus cher

Il y a ensuite un point moins intuitif, mais très pertinent pour ceux qui gèrent les budgets de recherche. En mars 2026 une prépublication publiée sur arXiv avec le titre «Le phénomène d’inversion des prix : quand les modèles de raisonnement moins chers finissent par coûter plus cher» a observé que dans 21,8% des comparaisons entre paires de modèles, celui dont le prix catalogue est le plus bas génère en réalité un coût total plus élevé ; dans certains cas, l’écart peut atteindre 28 fois.

La raison, selon les auteurs, réside avant tout dans la grande variabilité de la consommation. jetons de réflexion entre différents modèles.

Pour ceux qui travaillent en laboratoire, cela change le critère d’achat. Il ne suffit plus de regarder le prix du token ou le coût de l’abonnement. Le coût de la tâche complète doit être mesuré, y compris le nombre d’itérations, la qualité du résultat, le temps humain nécessaire à la vérification et la continuité du flux de travail.

Cette lecture ressort également bien d’une synthèse des signaux les plus récents.

| Indicateur | Ce que cela signale | Impact pour les équipes de recherche |

|---|---|---|

| Plus de 100 mille dollars dépensés en un an par un laboratoire de Stanford | L’IA peut devenir un poste de dépense comparable au personnel qualifié | Il vous faut un budget dédié, plus seulement des dépenses annexes |

| Copilot passe à la facturation à l’utilisation à partir du 1er juin 2026 | Les fournisseurs déplacent le coût vers l’utilisation réelle | Les flux de travail intensifs deviennent moins prévisibles |

| Forfaits ChatGPT Pro à 100 $ et 200 $ par mois | Une utilisation intensive est placée sur les bandes premium | Le prix de base ne couvre pas tous les cas d’utilisation |

| 58 % des chercheurs utilisent l’IA, mais seulement 32 % jugent la gouvernance bonne | L’adoption est plus rapide que les règles internes | Le risque opérationnel et l’utilisation incohérente augmentent |

| Seulement 22 % des utilisateurs font confiance aux outils d’IA | La valeur n’élimine pas le problème de fiabilité | La vérification reste un travail humain et a un coût |

Les autres compromis : accès, gouvernance, confidentialité

Le premier compromis est économique et compétitif. Si les meilleures fonctionnalités nécessitent des forfaits premium ou une facturation à l’utilisation, l’IA risque d’accentuer une logique de paiement pour gagner entre des groupes de recherche aux disponibilités très différentes. Le même article que Nature souligne les craintes que le passage à des modèles plus chers ne creuse l’écart entre ceux qui peuvent se permettre un accès premium et ceux qui ne le peuvent pas.

Le deuxième compromis est organisationnel. Toujours deuxième Elsevier, dans le rapport 2025 déjà mentionné, 45 % des chercheurs se sentent sous-formés à l’utilisation de l’IA et seulement 32 % jugent bonne la gouvernance de l’IA de leur institution.

Une image similaire se dégage également de Wiley, un éditeur scientifique international, qui dans la recherche « Explications» publiés en février 2025 et basés sur près de 5 000 chercheurs, des rapports selon lesquels plus de 60 % indiquent le manque de lignes directrices et de formation comme un obstacle important à une utilisation plus étendue de l’IA.

Le problème n’est donc pas seulement d’acheter des licences : il est de créer des règles, des compétences et des processus d’utilisation cohérents.

Le troisième compromis concerne la confidentialité. Dans les lignes directrices destinées aux évaluateurs publiées par UK Research and Innovation en juillet 2025, l’organisme britannique précise que l’insertion de documents confidentiels dans des outils d’IA générative constitue une violation de la confidentialité et de l’intégrité du processus.

Pour évaluation par les pairs, demande de subventiondes documents non publics, des données exclusives ou des recherches soumises à des contraintes contractuelles, le coût d’une erreur peut rapidement dépasser le gain de productivité.

Quand l’IA s’avère vraiment payante

L’IA est particulièrement utile dans les tâches à volume élevé et à faible risque, où un chercheur expert peut facilement contrôler le résultat : sélection initiale de la littérature, organisation des notes, synthèses préliminaires, aide au codage, exploration d’ensembles de données non sensibles, premières versions opérationnelles à réviser. Dans ces cas-là, le gain de temps a tendance à être concret.

C’est beaucoup moins pratique, ou nécessite des règles beaucoup plus rigides, lorsque le workflow exige une forte traçabilité, une exactitude non négociable, une confidentialité ou une solidité méthodologique : revue par les pairs, évaluations comparatives, revues de subventions, recherche qualitative, interprétation fine des résultats, documents ne tolérant pas d’erreurs ou de fuites de données.

L’IA ne doit donc pas être considérée comme un raccourci universel ni comme un coût à éviter. Il s’agit d’une capacité d’infrastructure de recherche, mais avec un impact économique différent de celui que beaucoup avaient imaginé au cours des premiers mois d’adoption. L’avantage reste réel.

Le fait est que le coût réel, en 2026, ne coïncide plus avec l’abonnement : il comprend la consommation réelle, les heures de vérification, les règles de gouvernance, la formation et la gestion des risques. Pour les laboratoires, les universités et les centres de R&D, c’est sur cette base qu’il faut décider où l’IA produit réellement de la valeur nette.