Qwen 3.6 Alibaba : la Chine accélère les agents IA et redessine le marché

Alibaba Cloud a publié Qwen 3.6-Plus début avril 2026. Dix-huit jours plus tard, le 20 avril, l’aperçu du Max est arrivé. Deux communiqués serrés qui, lus ensemble, disent une chose : la course chinoise aux agents d’IA est entrée dans la phase industrielle.

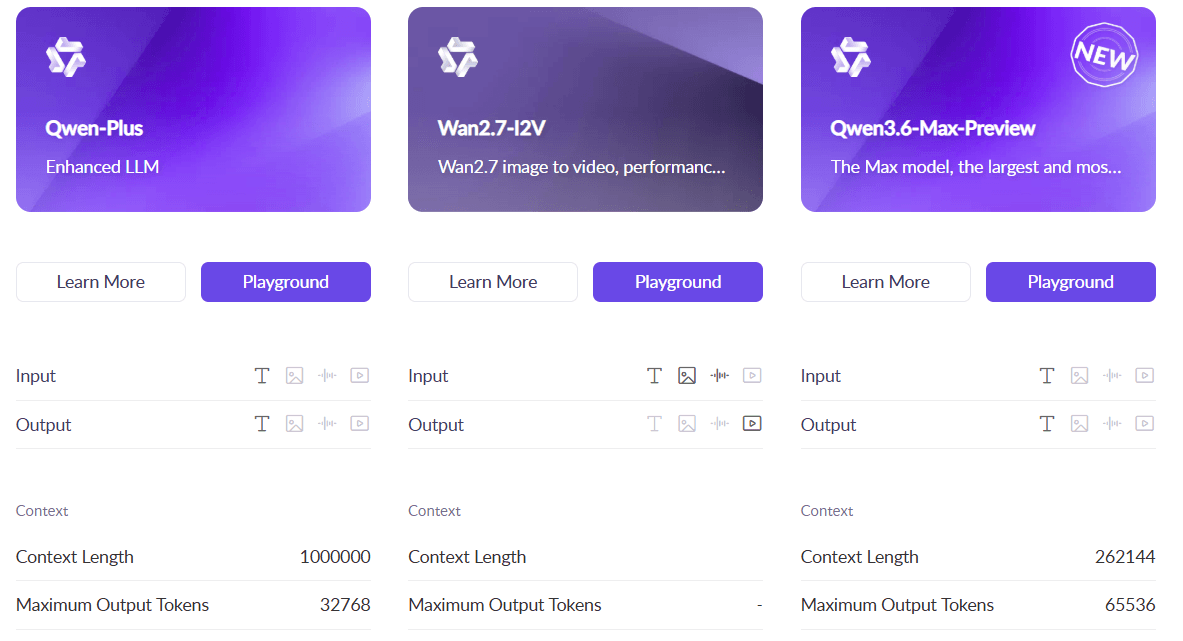

La fenêtre contextuelle atteint un million de tokens, soit suffisamment pour contenir un référentiel logiciel complet, une archive documentaire d’entreprise, de longues séquences d’interaction. L’architecture hybride, une attention linéaire combinée à un mélange clairsemé d’experts, réduit le coût par jeton sans sacrifier les capacités de raisonnement.

Et sur le marché mondial, le prix de l’API démarre à partir de 0,276 dollars par million de jetons d’entrée, contre 5 dollars pour Claude Opus 4.6, soit un ratio d’environ dix-sept pour un après intégration dans la pile de production.

Pour ceux qui nous regardent depuis l’Europe, la question de la concurrence a changé. Jusqu’à hier, l’IA générative de pointe était un outil destiné aux entreprises disposant de marges industrielles et de contrats cloud solides. Aujourd’hui, c’est un produit également accessible aux PME italiennes qui souhaitent automatiser le service client ou le traitement des documents.

Avec tout cela, cette accessibilité apporte cependant de réelles opportunités et de nouvelles dépendances.

Un modèle construit pour performer

La documentation technique d’Alibaba parle d’une architecture conçue autour du concept de «boucle de capacités« , percevoir, raisonner, agir au sein d’un seul workflow. Qwen 3.6-Plus interprète une capture d’écran d’une interface et génère le code front-end correspondant, lit un filaires dessiné à la main et le transforme en HTML fonctionnel, planifie un correctif dans un référentiel de logiciels et itère sur les correctifs jusqu’à leur achèvement. Les actions ne sont plus médiatisées par un copier-coller humain, elles deviennent des chaînes exécutées par l’agent avec une supervision finale.

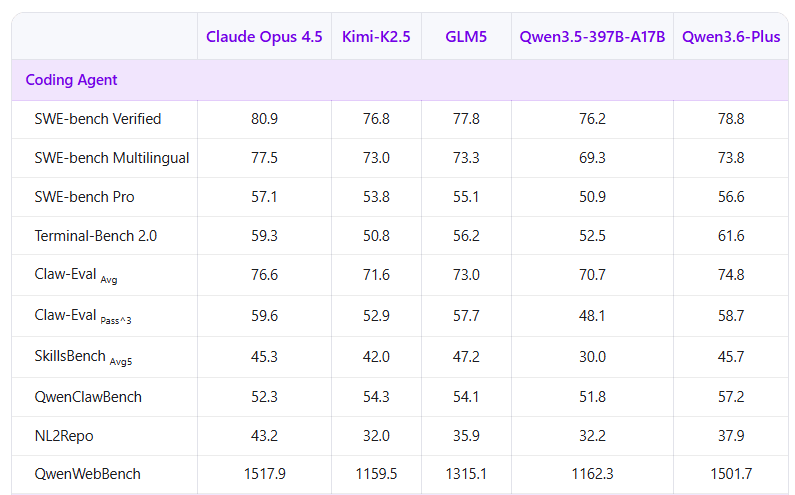

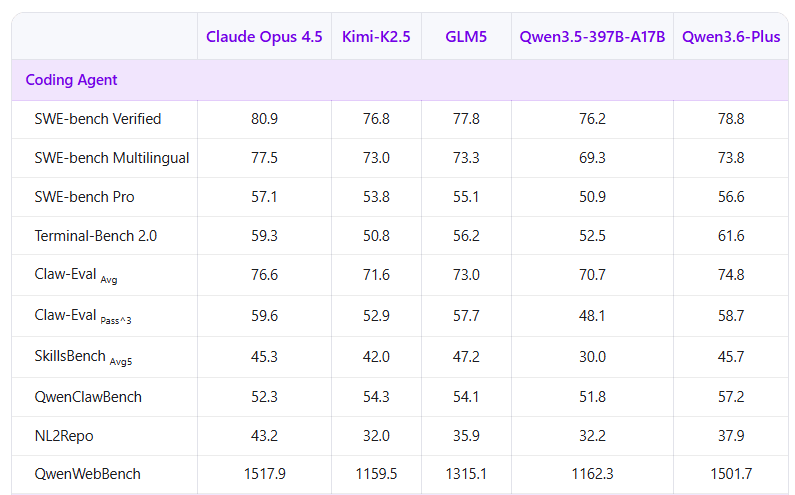

Sur le benchmark SWE-bench Verified, qui mesure la capacité de GitHub à résoudre de vrais problèmes, Qwen 3.6-Plus obtient 78,8 points, contre environ 80 pour Claude Opus 4.6. Un écart de moins de deux points, le plus proche jamais atteint par un laboratoire chinois sur ce test, sur une métrique que l’industrie reconnaît comme un proxy fiable du codage des agents en production.

Il ne s’agit pas seulement d’un résultat de laboratoire : Airbnb a déclaré publiquement que son chatbot de service client fonctionnait en grande partie sur des modèles Qwen, et des cas similaires commencent à émerger dans des entreprises mondiales.

Suite à ce choix architectural, la compatibilité des API avec les spécifications OpenAI et Anthropic est presque un détail, mais cela change la vie des développeurs. Remplacer le modèle occidental par Qwen dans vos pipelines nécessite, dans la plupart des cas, une ligne de configuration modifiée.

Le coût par token comme levier industriel

Le coût d’un modèle d’IA influe directement sur la marge opérationnelle de ceux qui l’utilisent en production, et c’est un fait que ceux qui travaillent sur des flux de travail d’agents à volume élevé le savent depuis longtemps. Les tarifs douaniers sur le marché mondial révèlent une distance structurelle.

Claude Opus 4.6 à 5 dollars par million de tokens en entrée, 25 en sortie. GPT-5.4 à 2,50 entrée, 15 sorties. Qwen 3.6-Plus, dans la gamme inférieure à 256 000 jetons, à 0,276 entrée et 1,651 sortie.

Une analyse indépendante de Coût du jeton a quantifié l’impact sur un scénario typique d’agent IA en production, soit environ 4 700 $ d’économies par mois par rapport à Claude Opus 4.6, environ 2 450 $ par rapport à GPT-5.4. Des chiffres qui, pour une PME qui doit décider si elle souhaite intégrer l’IA générative dans ses processus, ou reporter l’investissement d’un an supplémentaire, peuvent être un facteur discriminant.

Alibaba, en parallèle, continue de publier des variantes poids ouvert. Qwen 3.6-35B-A3B, sorti quelques jours avant le Max, est disponible sous licence Apache2.0 et active seulement 3 milliards de paramètres par inférence, optimisés pour l’auto-hébergement sur les GPU de milieu de gamme.

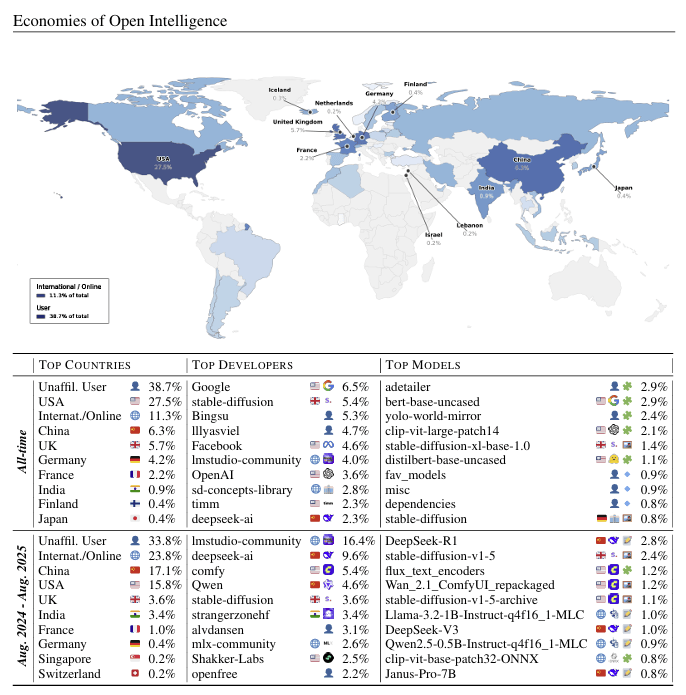

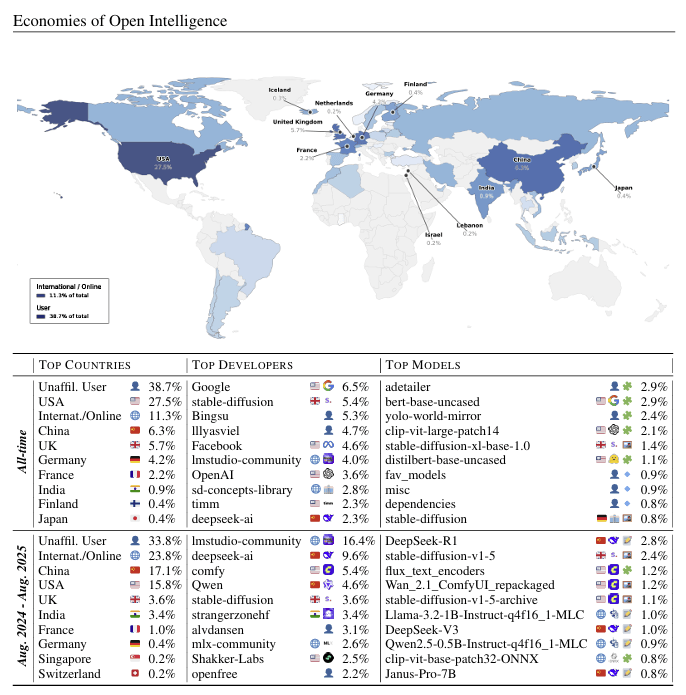

La stratégie est celle à deux voies qui caractérise désormais les grands groupes chinois, fleuron propriétaire de la monétisation du cloud, modèles ouverts pour une adoption généralisée. Sur la plateforme Visage câlinla famille Qwen a généré plus de 180 000 variantes dérivées, soit plus que les modèles Google et Meta réunis !

Part de la Chine dans les plateformes d’inférence

OuvrirRouterun agrégateur d’API qui collecte le trafic réel des développeurs vers les principaux modèles, renvoie des données qui méritent attention.

Il y a un an, les modèles chinois représentaient moins de 2 % du trafic global ; en avril 2026, leur part globale dépassait 45 %.

Xiaomi, avec le modèle MiMo-V2-Pro, détient à lui seul 21,1% contre 7,5% d’OpenAI. Ce sont les jetons qui circulent réellement dans les pipelines de ceux qui fabriquent des produits.

Une étude des chercheurs du MIT et de Hugging Face publiée fin 2025 a révélé que les modèles chinois à poids ouvert dépassaient pour la première fois les modèles américains en termes de téléchargements mondiaux, 17,1 % contre 15,86 %.

RAND Corporation a mesuré une hausse de 3 à 13 % de la part de marché chinoise au cours des deux mois suivant la sortie de DeepSeek, avec une pénétration supérieure à 20 % dans onze pays du Sud.

Ce qui se passe, en aval de ces chiffres, c’est que le choix de la pile d’IA pour les entreprises mondiales devient indépendant de la nationalité du modèle. Les performances, le coût et la disponibilité des API compatibles sont importants.

La géographie industrielle qui semblait cristallisée jusqu’en 2024 autour de trois à quatre acteurs californiens s’est effondrée en moins de dix-huit mois.

Frontière américaine, exécution chinoise

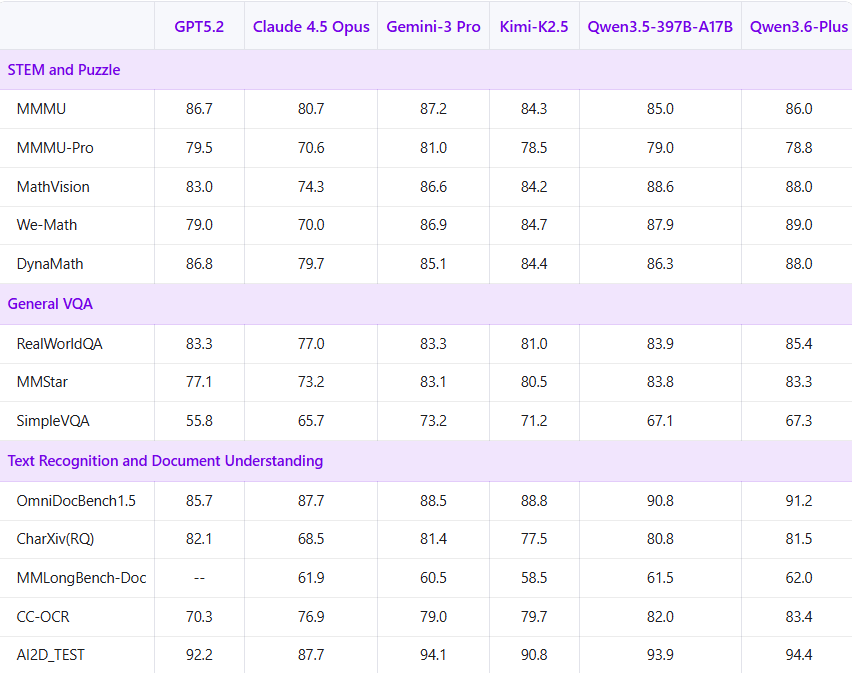

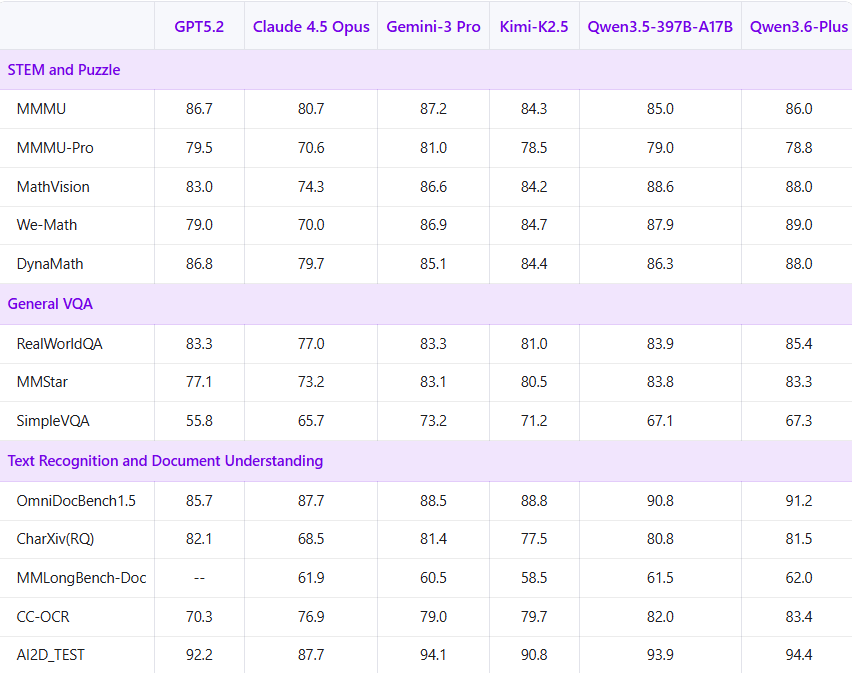

Ce serait une lecture superficielle d’interpréter ces données comme un dépassement. Les modèles américains restent en tête sur les benchmarks frontières, Gemini 3.1 Pro mène ARC-AGI-2 et GPQA Diamond, Claude Opus 4.6 maintient la tête sur le banc SWE Verified.

Les écosystèmes construits autour d’OpenAI et d’Anthropic, les outils de productivité, les environnements de développement intégrés, les accords avec les grands fournisseurs de cloud, ont une profondeur que les laboratoires chinois n’ont pas encore répliquée.

L’écart de capacité moyen, selon des analyses indépendantes, reste d’environ sept mois, même s’il s’accélère en se raccourcissant. Toutefois, cet écart se réduit de manière asymétrique, et c’est là qu’il devient pertinent pour l’Europe. Sur les tâches d’exécution, de codage d’agents et d’automatisation des workflows, où l’écosystème environnant vaut moins que la qualité intrinsèque du modèle, la distance est quasiment supprimée.

Sur les tâches qui nécessitent une intégration profonde avec les infrastructures de productivité existantes, typiquement américaines, l’écart reste plus large.

Les entreprises européennes utilisent rarement Claude ou GPT dans le cadre d’un écosystème propriétaire américain intégré ; elles les consomment sous forme d’API appelées à partir de piles hétérogènes. Dans ce scénario d’usage concret, la distance entre le modèle américain et le modèle chinois se réduit drastiquement, et le coût par token devient le critère de choix déterminant.

La dépendance infrastructurelle, un problème que l’Europe ne peut éviter

La disponibilité de modèles avancés à des coûts réduits ouvre des opportunités aux entreprises européennes qui, jusqu’à récemment, étaient l’apanage de celles disposant de gros budgets industriels. Gestion automatisée des documents, assistance au code, analyse de grandes quantités de données avec des invites en langage naturel, aide aux processus décisionnels. Des activités peu automatisées qui, avec un rapport qualité-prix si avantageux, deviennent économiquement durables même pour les moyennes et petites entreprises.

L’inconvénient porte un nom précis : la dépendance infrastructurelle. Adopter Qwen signifie envoyer des invites commerciales à Alibaba Cloud ou passer par des agrégateurs tiers qui les transmettent à leur tour.

Pour les secteurs réglementés, le RGPD et l’AI Act imposent des contraintes non négligeables sur la traçabilité des processus décisionnels automatisés. Générer une image marketing avec un modèle chinois est une chose, analyser des contrats juridiques ou des données cliniques avec le même modèle en est une autre.

Il y a ensuite une question plus subtile, soulevée à Sommet de Montréal sur la sécurité internationale en octobre dernier avec l’expression « colonisation des infrastructures ». L’adoption généralisée des modèles chinois intègre des choix de modération, un cadrage narratif et des priorités d’information qui reflètent le contexte réglementaire et politique d’origine dans les flux de travail européens.

Un modèle est également un objet culturel, il comporte des hypothèses implicites sur ce qui peut être généré et ce qui ne peut pas être généré, sur les sujets qui sont évités et sur ceux qui sont complets.

La question industrielle européenne, au-delà de la régulation

L’Union européenne a répondu à la pression de l’IA avec l’AI Act, un instrument réglementaire conçu pour protéger les citoyens et les entreprises contre l’utilisation inappropriée des systèmes automatisés. Toutefois, la réglementation ne coïncide pas avec la capacité industrielle. Entre la production de modèles frontières et la disponibilité d’infrastructures européennes capables de les former, la distance reste grande tant en termes d’investissements que de capacités de calcul disponibles sur le sol européen.

Les investissements chinois racontent une histoire d’une autre ampleur. En 2025, le gouvernement chinois a engagé 56 milliards de dollars dans les infrastructures d’IA ; Alibaba a annoncé à lui seul 50,6 milliards de dollars sur un horizon de trois ans. Des chiffres auxquels ni les pays européens pris individuellement ni l’Union dans son ensemble ne sont aujourd’hui en mesure de répondre avec des ressources équivalentes, quelles que soient les intentions politiques affichées.

Sans capacité de calcul souveraine, l’autonomie des modèles reste un objectif théorique.

Le risque européen n’est pas de rester en dehors de l’IA générative, le scénario le plus probable est le contraire, une adoption massive mais dépendante, où chaque processus critique des entreprises européennes passe par un modèle hébergé ailleurs. Lorsque nous parlons de souveraineté numérique, nous avons tendance à penser uniquement aux données, alors que le véritable problème est de savoir qui contrôle tout le cycle de vie du modèle, de la formation aux mises à jour, jusqu’à la journalisation des interactions qui ont lieu chaque jour entre l’IA et les utilisateurs professionnels.

Du modèle agent au système d’exploitation de production

Qwen 3.6 n’est pas le premier modèle d’agent en circulation, mais c’est le premier à amener la logique d’agent à un niveau de prix qui en fait une marchandise accessible. Lorsqu’une opération qui coûtait auparavant plusieurs dollars commence à coûter quelques centimes, toute l’économie du processus dans lequel elle s’insère est réorganisée, et ce qui était une expérience pilote devient une composante structurelle du fonctionnement de l’entreprise.

La chaîne de valeur numérique est réorganisée en conséquence. Le code est de plus en plus orchestré par des agents qui exécutent et vérifient, l’analyse documentaire devient un processus automatisé avec une supervision humaine sur un échantillon, le service client passe d’un centre de coûts à une infrastructure conversationnelle au coût marginal proche de zéro.

Le travail humain ne disparaît pas, sa position dans la chaîne change, il évolue vers la définition des contraintes, la vérification du résultat, la gestion des exceptions.

Dans Changement spatial J’ai tenté de décrire comment l’évolution des systèmes numériques redessine les espaces d’interaction entre les personnes, les environnements et les objets. Ce qui se passe avec les modèles agentiques ouvre un nouveau chapitre dans cette trajectoire, l’intelligence informatique quitte l’interface conversationnelle pour se distribuer au sein des activités elles-mêmes, fonctionnant comme une présence continue qui fonctionne en arrière-plan tandis que l’équipe s’occupe de ce qui nécessite un jugement humain.

Utilisateurs ou producteurs, le choix reste sur la table

La concurrence entre la Chine et les États-Unis en matière d’intelligence artificielle a cessé de se jouer uniquement à la frontière des benchmarks, elle se joue désormais sur la rapidité de diffusion dans l’économie réelle, sur la capillarité avec laquelle les modèles entrent dans les processus de production. Qwen 3.6 est un signal fort en ce sens, un modèle calibré pour coûter peu et fonctionner en production.

Pour l’Europe, le carrefour se pose en termes industriels plutôt que réglementaires. Acceptez le rôle d’utilisateur des plateformes d’autrui, avec tous les avantages financiers immédiats qui en découlent, ou investissez pour construire des alternatives qui répondent aux contraintes de souveraineté, de gouvernance et de transparence.

Quiconque lira cet article dans trois ans verra comment le choix a été fait, par les entreprises avec des contrats cloud signés et par les institutions avec des infrastructures financées ou reportées. Sans aucun doute, une question reste en suspens pour ceux qui décident aujourd’hui : qui construira l’infrastructure sur laquelle les agents d’IA effectueront le travail numérique quotidien de la prochaine décennie ?