IA de cybersécurité : accès sécurisé et modèle de cybersécurité GPT-5.4

L’accès fiable aux outils de cyberdéfense entre dans une nouvelle phase pour OpenAI avec l’expansion du programme Trusted Access for Cyber (TAC) et le lancement de GPT-5.4-Cyber, un modèle d’IA formé pour les cas d’utilisation de cybersécurité. L’initiative surgit dans un contexte où la croissance des capacités de l’IA s’accompagne d’une augmentation des risques numériques.

Ces dernières années, les infrastructures numériques mondiales ont montré des vulnérabilités structurelles. Les systèmes logiciels, les réseaux et les services publics sont exposés à des menaces de plus en plus sophistiquées. L’intelligence artificielle a accéléré ce processus : d’une part elle permet aux défenseurs d’identifier et de corriger plus rapidement les failles, d’autre part elle offre également de nouveaux outils aux attaquants.

OpenAI a construit sa stratégie selon trois axes :

- accès démocratisé,

- diffusion progressive des technologies

- renforcer l’écosystème de sécurité.

L’expansion du programme TAC représente une étape opérationnelle de cette approche.

TAC, un programme en expansion : plus d’accès, plus de contrôles

Le programme Trusted Access for Cyber s’étend à des milliers de professionnels vérifiés et à des centaines d’équipes protégeant les logiciels critiques. L’objectif déclaré est d’augmenter le nombre de défenseurs sans compromettre les systèmes de sécurité.

L’accès aux outils les plus avancés n’est pas gratuit, mais réglementé par des critères vérifiables. Il s’agit notamment de procédures d’identification rigoureuses (KYC, connaissez votre client) et des systèmes automatisés de validation d’identité. Le principe est d’éviter les décisions arbitraires sur qui peut utiliser des technologies sensibles, en les remplaçant par des critères objectifs et traçables.

Cette approche vise à inclure différentes parties prenantes : grandes entreprises, développeurs indépendants, organismes publics et organisations qui gèrent des infrastructures critiques. La logique est d’étendre les capacités défensives là où existe une responsabilité concrète de protection des systèmes numériques.

GPT-5.4-Cyber : Un modèle de sécurité offensive et défensive

Le cœur technologique de l’initiative est GPT-5.4-Cyber, une version du modèle GPT-5.4 modifié pour prendre en charge les activités avancées de cybersécurité. Le modèle a été formé pour être plus « permissif » dans des contextes de sécurité légitimes, réduisant ainsi les limites automatiques qui bloquent souvent les opérations à double usage.

Parmi les principales fonctionnalités figure la possibilité d’analyser les logiciels compilés, même en l’absence du code source. Cela permet des activités telles que l’ingénierie inverse binaire, essentielle pour identifier les logiciels malveillants, les vulnérabilités et les problèmes structurels des programmes.

L’accès à GPT-5.4-Cyber est limité dans la phase initiale. La diffusion se fait de manière progressive et contrôlée, impliquant des sociétés de sécurité, des chercheurs et des organismes vérifiés. Le choix reflète la nature délicate de l’instrument, qui peut être utilisé aussi bien en défense qu’en attaque.

Défenseurs et attaquants : une course parallèle

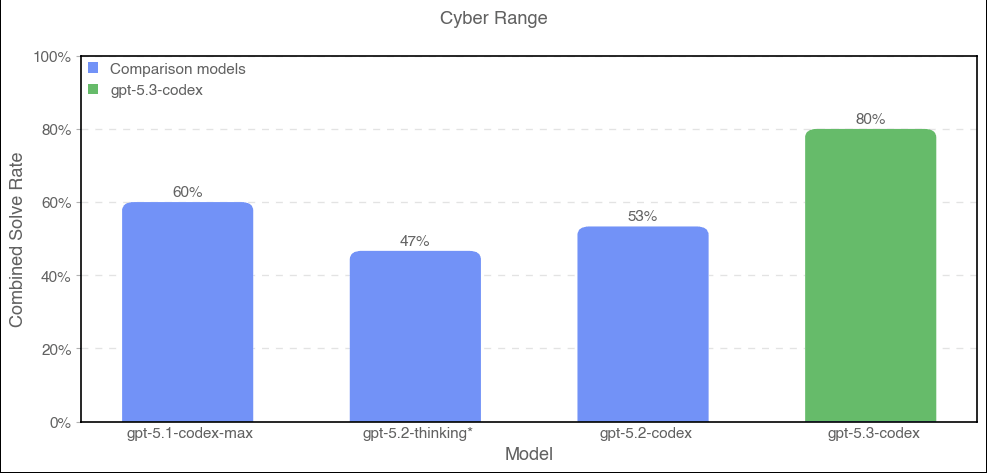

L’évolution de l’intelligence artificielle a réduit le temps nécessaire pour analyser le code, identifier les vulnérabilités et développer des exploits. Selon OpenAI, les modèles existants sont déjà capables de prendre en charge les phases pertinentes du cycle opérationnel cyber, de l’analyse à la correction.

Dans le même temps, des groupes hostiles expérimentent des approches basées sur l’IA pour améliorer leurs capacités. L’utilisation de techniques avancées, comme l’augmentation de la puissance de calcul lors des tests (test-time computing), permet d’obtenir des résultats de plus en plus sophistiqués même à partir de modèles déjà disponibles.

Ce scénario nécessite un changement de stratégie : les mesures de sécurité ne peuvent pas attendre un futur seuil de risque, mais doivent évoluer parallèlement aux capacités technologiques.

Le rôle des sauvegardes et du contrôle d’accès

Un point central de la stratégie est la gestion du risque lié au « double usage », c’est-à-dire à l’utilisation ambiguë des cybertechnologies. Le risque ne dépend pas seulement du modèle, mais aussi de celui qui l’utilise, des méthodes d’utilisation et des signaux de fiabilité associés à l’utilisateur.

Pour cette raison, OpenAI fait la distinction entre l’accès généralisé aux modèles et l’accès avancé à des fonctionnalités plus sensibles. Les niveaux supérieurs nécessitent des contrôles plus rigoureux et offrent une plus grande visibilité sur les activités réalisées.

Dans certains cas, l’accès est limité en cas de manque de transparence dans l’utilisation, comme dans les configurations avec zéro conservation des données (ZDR) ou via des plateformes tierces qui réduisent la capacité de surveillance.

Investissements et résultats : chiffres de stratégie

La stratégie de renforcement de la sécurité informatique s’accompagne d’investissements et d’initiatives concrètes. Parmi ceux-ci :

- un programme de financement de 10 millions de dollars pour des projets de cybersécurité, lancé en 2023 ;

- prise en charge de plus de 1 000 projets open source via des outils d’analyse des vulnérabilités ;

- le développement de Codex Security, un système automatisé de surveillance des codes.

Selon les données publiées par l’entreprise, Codex Security a contribué à la résolution de plus de 3 000 vulnérabilités classées comme critiques ou de gravité élevée. À cela s’ajoutent de nombreux problèmes de niveau inférieur résolus au sein de l’écosystème logiciel.

Le système fonctionne en surveillant les référentiels, en validant les problèmes identifiés et en proposant des solutions. À mesure que les modèles s’amélioraient, la précision et l’utilité des analyses augmentaient.

Sécurité intégrée dans le développement de logiciels

L’un des axes stratégiques concerne l’intégration de la sécurité directement dans les processus de développement. L’objectif est de dépasser une approche basée sur des contrôles périodiques et des audits isolés, en introduisant à la place une vérification continue lors de l’écriture du code.

L’intégration de modèles avancés dans les flux de travail des développeurs permet un retour immédiat sur les vulnérabilités et les risques. Cela réduit les temps d’exposition et améliore la qualité globale du logiciel.

La transition est également pertinente d’un point de vue économique : corriger une erreur dès les premières étapes coûte moins cher qu’intervenir sur des systèmes déjà en production.

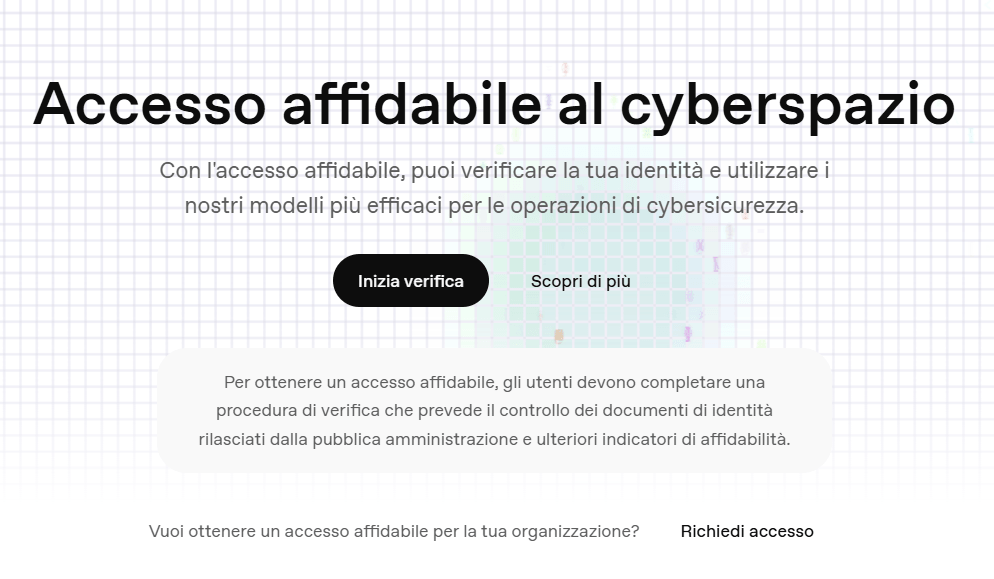

Accès vérifié : comment fonctionne le système TAC

L’accès au programme Trusted Access for Cyber est structuré sur plusieurs niveaux. Les utilisateurs individuels peuvent vérifier leur identité via un processus en ligne. Les entreprises peuvent demander l’accès pour leurs équipes via des canaux dédiés.

Une fois approuvés, les utilisateurs obtiennent des versions des modèles avec moins de restrictions dans les contextes de cybersécurité. Cela permet des activités telles que la recherche de vulnérabilités, la formation et le développement de solutions défensives.

Pour accéder aux niveaux plus avancés, y compris ceux impliquant l’utilisation de GPT-5.4-Cyber, une vérification supplémentaire est requise qui certifie le rôle réel d’un cyberdéfenseur.

Déploiement progressif et gestion des risques

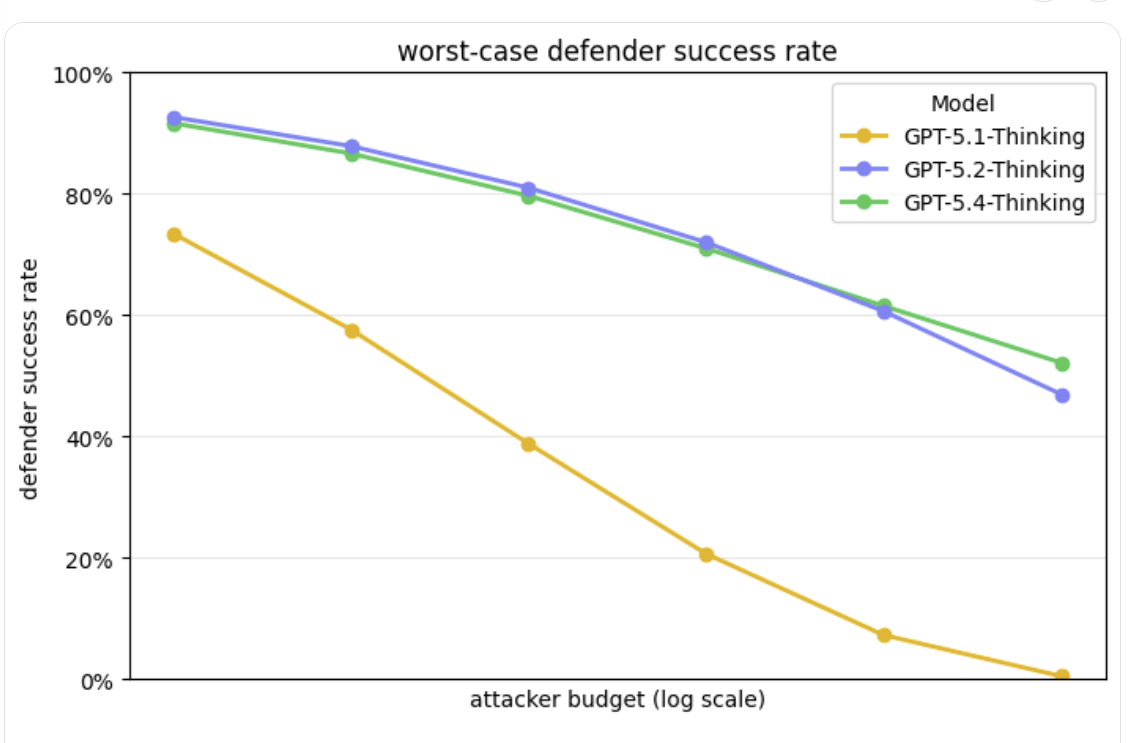

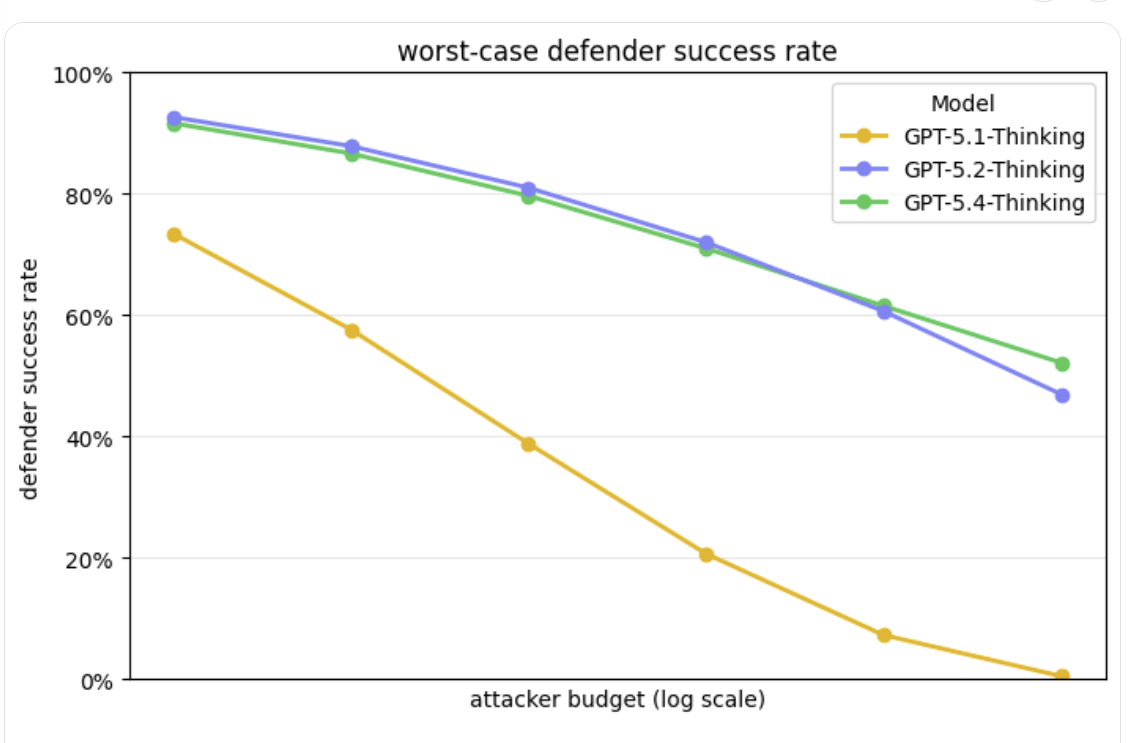

La diffusion des nouvelles technologies se fait selon un modèle itératif. Les systèmes sont diffusés dans des environnements contrôlés, surveillés et mis à jour en fonction des résultats observés.

Cette approche nous permet de mieux comprendre à la fois le potentiel et les risques. Les aspects surveillés comprennent la résistance aux attaques, la capacité à éviter les abus et l’efficacité des activités défensives.

Les seuils de rejet des demandes sont calibrés au fil du temps, en essayant de réduire les faux positifs qui gênent les défenseurs sans compromettre la sécurité.

Perspectives : des modèles plus puissants, des défenses plus complexes

Les perspectives indiquées par OpenAI prévoient une augmentation rapide des capacités des modèles dans les mois à venir. Cela conduit à la nécessité de renforcer davantage les mesures de sécurité.

Selon l’entreprise, les garanties actuelles sont suffisantes pour soutenir le déploiement des modèles existants. Cependant, les futurs modèles plus avancés nécessiteront des systèmes de défense plus complexes.

L’évolution concerne à la fois la technologie et les mécanismes de contrôle d’accès. L’objectif est de maintenir un équilibre entre ouverture et protection, en évitant que les outils conçus pour la sécurité ne deviennent un avantage pour les attaquants.

GPT-5.4-Cyber : entre potentiel opérationnel et risques de surévaluation

Le lancement de GPT-5.4-Cyber a suscité un certain intérêt, mais aussi une dose importante de scepticisme de la part des analystes et des acteurs du secteur. D’une part, la presse spécialisée met en avant la valeur opérationnelle d’un modèle capable de supporter des activités avancées comme la rétro-ingénierie et l’analyse de vulnérabilité, dans un contexte de concurrence croissante entre les grands acteurs de l’IA comme OpenAI et Anthropic (Voir : The Times of India).

D’un autre côté, des doutes concrets émergent quant à l’efficacité réelle et à l’impact pratique : certains experts soulignent que de nombreux outils d’IA identifient des vulnérabilités déjà connues ou difficiles à exploiter, tandis que les coûts de calcul et la complexité d’utilisation pourraient limiter leur adoption à grande échelle (Voir : Axios).

Mais dans la communauté technique, le point le plus critique concerne le risque « d’illusion de compétence » : des modèles plus permissifs peuvent pousser des analystes moins experts à surestimer des résultats encore incomplets ou ambigus, confondant hypothèses et preuves opérationnelles (Voir : penligent.ai).

Dans ce cadre, GPT-5.4-Cyber apparaît moins comme un tournant définitif que comme une étape intermédiaire : un outil puissant, mais qui déplace le problème de la capacité technique vers l’accès à la gouvernance et à la responsabilité d’usage.

En termes documentaires, GPT-5.4-Cyber se situe dans une zone intermédiaire : suffisamment avancée pour nécessiter des restrictions opérationnelles, mais pas encore accompagnée d’un modèle de carte autonome. La transparence reste ancrée dans le modèle « mère » (GPT-5.4), tandis que les changements les plus sensibles – précisément ceux qui distinguent la version cyber – ne sont décrits qu’au niveau de la divulgation et non dans un document technique structuré.

Conclusion

L’expansion du programme Trusted Access for Cyber et l’introduction de GPT-5.4-Cyber marquent un changement dans la gestion des risques numériques. L’intelligence artificielle devient un élément central de la cybersécurité, avec des effets directs sur les entreprises, les infrastructures et les services publics.

La stratégie vise à étendre les capacités défensives tout en maintenant un contrôle strict de l’accès. L’enjeu concerne la rapidité avec laquelle les technologies évoluent et la capacité des institutions et des entreprises à adapter leurs outils de protection.