Des chatbots aux agents IA : évolution et niveaux

Il y a une grande distance entre répondre à une question et résoudre un problème. La plupart des entreprises en sont encore à la première étape. Voici comment lire la trajectoire de l’IA conversationnelle et où il est possible d’aller.

Je sais, le terme « chatbot » semble déjà démodé. C’est un mot qui évoque les premiers assistants virtuels de 2015, ces petites pop-ups du site e-commerce qui ne comprenaient rien et répondaient par « Je n’ai pas compris votre demande ». Il faut pourtant partir de là. Car sans comprendre d’où vient cette technologie, impossible de comprendre où elle va, et surtout ce que cela signifie aujourd’hui quand quelqu’un dit « nous avons implémenté un agent IA ».

Si vous avez interagi avec un assistant virtuel au cours des dernières années, vous avez probablement vécu cette séquence : vous posez une question, recevez une réponse plausible, essayez de faire quelque chose de concret et vous vous retrouvez redirigé vers un formulaire, un numéro vert ou un opérateur humain.

Ce n’est pas un défaut de mise en œuvre, c’est la limite structurelle de la catégorie.

La plupart des outils d’IA conversationnelle en production aujourd’hui sont conçus pour répondre et non pour agir. Ils savent récupérer l’information, la paraphraser avec fluidité, vous guider vers la solution. Mais quand la solution nécessite une action, ils s’arrêtent.

Cette frontière est sur le point de bouger : comprendre comment se structure l’évolution de ces technologies est devenu un enjeu stratégique et non seulement technique.

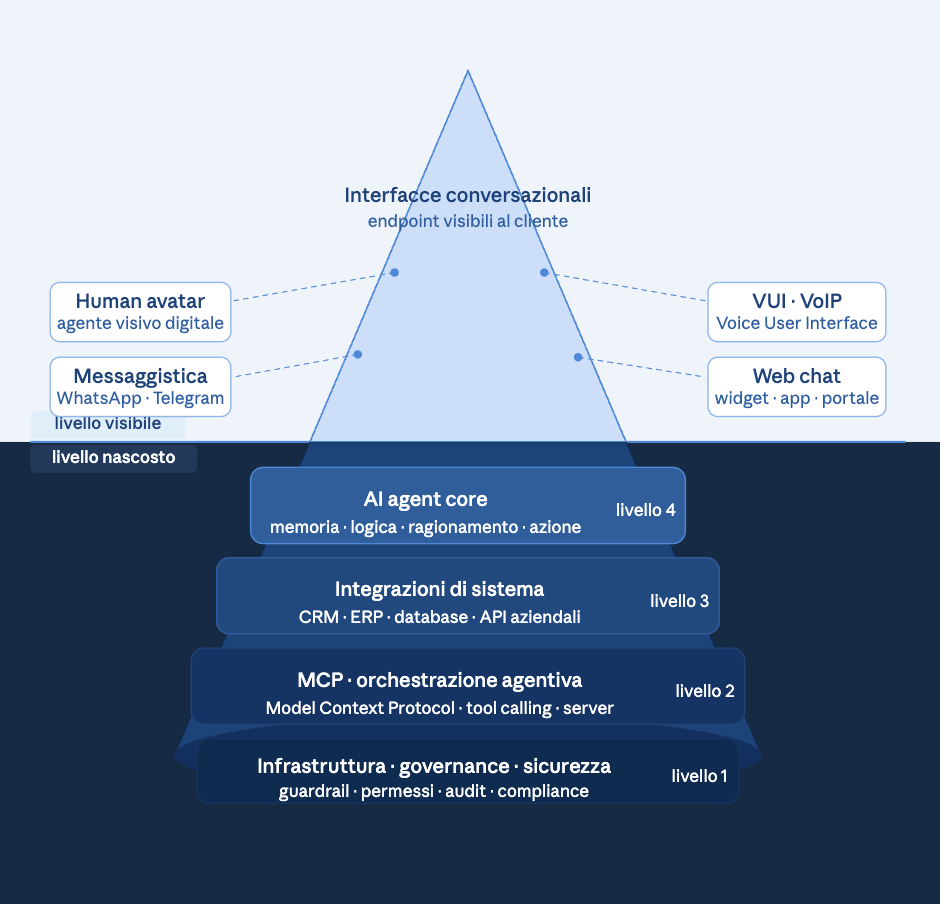

L’interface n’est pas le cerveau

Il existe un élément qui génère souvent de la confusion, notamment dans les entreprises qui abordent ces outils pour la première fois. Lorsqu’une organisation voit un avatar humain répondre sur WhatsApp, ou une voix synthétique traitant un appel via VoIP, elle a tendance à se concentrer sur cela : sur le point final, sur l’interface visible. Et sur la base de cette perception, elle construit sa propre idée de ce qu’est l’IA conversationnelle.

Le problème est que l’interface n’est que la dernière couche. En dessous, il peut y avoir n’importe quoi : un chatbot avec des règles des « dix » années, un assistant GenAI de niveau deux, ou un agent autonome de niveau quatre capable d’effectuer des transactions complexes, l’avatar ne dit rien du niveau d’intelligence du système. La messagerie sur Telegram n’implique pas sophistication, la voix n’est pas synonyme de capacité.

Ces points de terminaison, qu’il s’agisse d’interfaces textuelles comme WhatsApp ou Telegram, d’avatars conversationnels ou de systèmes VUI (interface utilisateur vocale) pour la gestion vocale, ce sont des canaux d’accès. Ils définissent la manière dont l’utilisateur interagit avec le système, et non ce que le système peut faire.

Confondre le point final avec la technologie sous-jacente est l’une des erreurs les plus courantes, et l’une des plus coûteuses : cela conduit à surestimer les solutions superficielles et à sous-estimer le travail nécessaire pour construire quelque chose qui fonctionne vraiment.

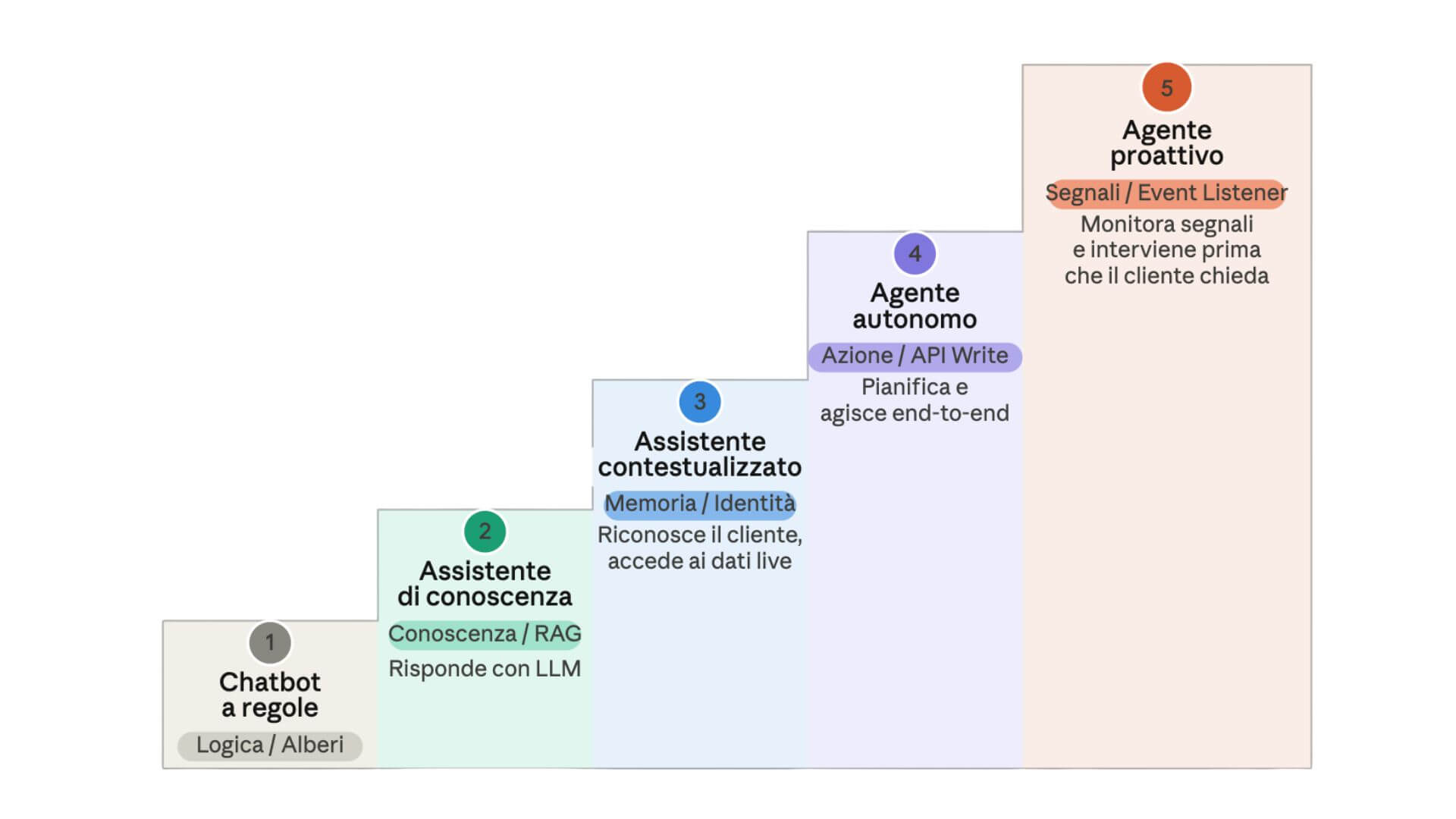

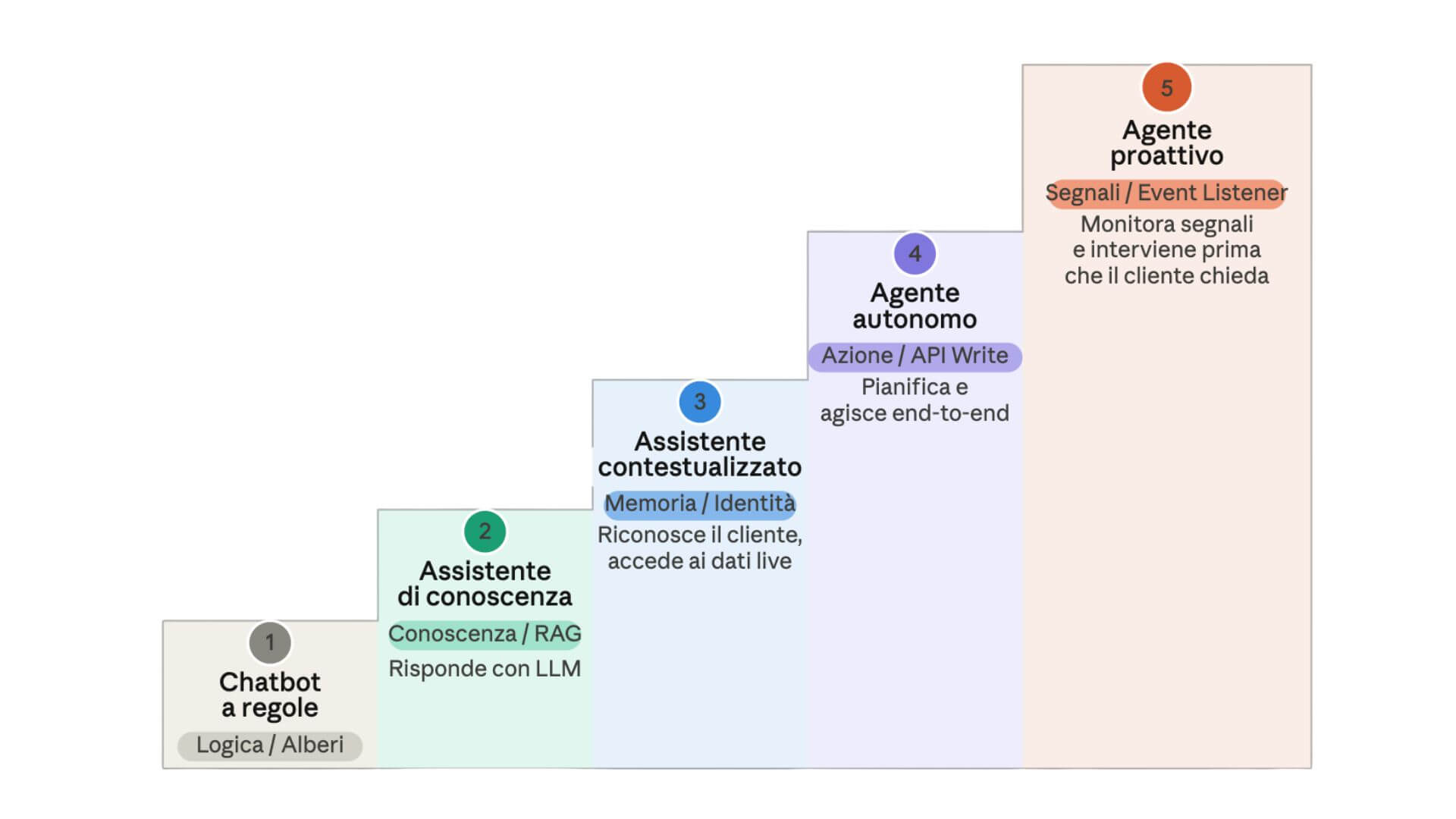

Cinq niveaux, une trajectoire

Il existe une progression logique qui mène du chatbot le plus basique à l’agent IA le plus sophistiqué et il ne s’agit pas d’un remplacement étape par étape, mais d’une évolution cumulative : chaque niveau ajoute des capacités sans nécessairement éliminer le précédent.

Les cinq étapes se distinguent par trois variables fondamentales : la mémoire, la logique, l’action.

La mémoire décrit la quantité de contexte que le système est capable d’apporter, au-delà de la simple conversation ; la logique décrit comment le système prend des décisions, en choisissant l’étape suivante en fonction du contexte disponible ; l’action décrit ce que le système peut réellement faire, de la récupération d’informations à l’écriture de données dans les systèmes de l’entreprise.

Niveau 1 : chatbot basé sur des règles

C’est le point de départ. Le chatbot suit des flux prédéfinis, répond à des questions scriptées, oriente l’utilisateur vers des parcours de décision écrits à l’avance. Prévisible, contrôlable, mais fragile. Dès que la demande déraille, le système plante ou redirige ailleurs. La mémoire est inexistante entre les différentes sessions. La logique est un arbre de décision, donc l’action est nulle.

Niveau 2 : Assistant de connaissances

C’est là qu’intervient le langage naturel, rendu possible par les modèles linguistiques de dernière génération. Le système ne suit plus un script, mais récupère les réponses dans la base de connaissances de l’entreprise et les formule de manière fluide. C’est le niveau où se retrouvent de nombreuses implémentations actuelles : FAQ intelligentes, assistants documentaires, robots intégrés aux portails de support. Ils fonctionnent bien pour des requêtes simples, mais la mémoire s’arrête à une seule session. La logique est toujours statique et l’action reste consultative : je peux vous dire quoi faire, pas le faire à votre place.

Niveau 3 : assistant contextualisé

Le véritable saut qualitatif commence ici. L’assistant cesse de traiter chaque interaction comme si c’était la première. Il reconnaît l’utilisateur, récupère l’historique des interactions précédentes, accède aux données transactionnelles en temps réel : statut des commandes, informations de facturation, historique des relations.

Cela change radicalement la qualité de l’expérience. L’utilisateur n’a pas besoin de se répéter, les réponses sont calibrées en fonction de la situation spécifique et non d’une question générique.

Cependant, la limite réside dans la capacité d’agir : le système sait tout ce dont il a besoin pour résoudre le problème, mais il ne peut pas encore le résoudre directement. Il peut vous guider, pas exécuter à votre place.

Niveau 4 : agent autonome

C’est là que se produit la transformation la plus significative. L’agent ne se contente pas d’expliquer la prochaine étape : il la franchit. Grâce aux capacités agentiques, le système peut planifier une séquence d’actions, sélectionner les outils appropriés, interagir avec les systèmes de l’entreprise en lecture et en écriture. Ouvrez une demande, lancez un remboursement, mettez à jour les informations d’un profil, planifiez un rendez-vous.

L’autonomie n’est pas illimitée. Les entreprises définissent des garde-fous précis : autorisations par rôle, seuils de risque, critères d’escalade. L’agent agit avec flexibilité lorsque le risque est faible et avec prudence lorsque les implications sont plus pertinentes.

Cette couche nécessite une infrastructure : API sécurisées, qualité de données fiable, gouvernance des processus. Ce n’est pas seulement une question technologique, c’est une question organisationnelle.

Niveau 5 : Agent proactif

Le niveau le plus mature n’attend pas que le client pose une question. Il surveille les signaux tout au long du parcours client et intervient lorsque les conditions le justifient, avant même que le problème ne devienne visible.

- Un retard d’expédition détecté avant que l’utilisateur ne se rende compte du problème.

- Une anomalie de facturation corrigée de manière anticipée.

- Un risque d’abandon intercepté dans le comportement d’utilisation du produit.

L’agent proactif est connecté aux systèmes de surveillance des événements, qui l’invoquent lorsque certaines conditions se produisent. Cela fait passer le service d’une fonction réactive à un niveau de surveillance continue, réduisant les contacts évitables et intervenant là où cela compte, quand cela compte.

Toutes les entreprises n’ont pas besoin d’atteindre le niveau cinq

C’est peut-être la considération la plus utile pour quiconque élabore une feuille de route. L’évolution vers des niveaux de maturité plus élevés entraîne une complexité croissante : coûts d’intégration technique, de gouvernance, de développement et de maintenance. Toutes les entreprises n’ont pas les mêmes priorités, la même combinaison de cas d’utilisation, la même tolérance au risque.

La bonne question n’est pas « jusqu’où pouvons-nous aller ? » mais « quel est le niveau de maturité qui génère le plus grand impact par rapport à nos objectifs et capacités actuels ?

Pour certaines entreprises, un assistant contextualisé de niveau trois qui réduit considérablement le volume des requêtes répétitives vaut plus qu’un agent autonome mal gouverné. Pour d’autres, l’automatisation transactionnelle de niveau quatre constitue le véritable saut d’efficacité qu’ils recherchent.

Le point de départ est une analyse honnête de notre situation actuelle : ce que l’outil peut faire aujourd’hui, dans quels domaines il dépend encore de transferts humains et où ces transferts représentent le plus grand coût ou friction.

Mémoire, logique, action : trois variables, trois leviers. Chaque progrès dans le chemin de maturation nécessite des investissements selon ces axes, la qualité de la mémoire dépend de la structure des données et de leur accessibilité. La qualité de la logique dépend de la gouvernance des processus et de la clarté des critères de décision, la qualité de l’action dépend de la sécurité des intégrations et de la redondance des contrôles.

Le résultat n’est pas seulement un outil plus performant, c’est une infrastructure qui permet à l’IA de créer une réelle valeur, et pas seulement de répondre à des questions.

Le chatbot dévie, l’agent résout. La distance entre les deux n’est pas seulement technologique : elle est stratégique.