L’humain dans la boucle : le rôle stratégique de l’humain à l’ère des agents IA

Selon le Best Practice Report de Forrester, d'ici 2026, l'intelligence artificielle sera capable d'automatiser entre 80 % et 99,9 % des tâches quotidiennes dans certaines fonctions de l'entreprise. Une perspective qui oblige les CEO, les RH et les data leaders à procéder à une remise en question approfondie de la conception même du travail.

2025 a marqué un point de rupture. De nombreuses organisations ont suspendu le recrutement pour déterminer si un nouveau rôle devrait être confié à une personne ou à un agent numérique. La conséquence a été une paralysie du processus décisionnel accompagnée de craintes généralisées.

Les données de Forrester montrent que 62 % des adultes en ligne familiers avec l’IA générative craignent un impact direct sur l’emploi. Dans divers secteurs, il y a déjà eu des réductions de personnel au profit des plateformes travail numérique.

Toutefois, transformation ne coïncide pas avec substitution. Forrester estime que d’ici 2030, l’IA générative aura un impact sur 4,5 fois plus d’emplois qu’elle n’en éliminera. Le changement concerne la nature des activités et non leur existence.

La signification stratégique de l’humain dans la boucle

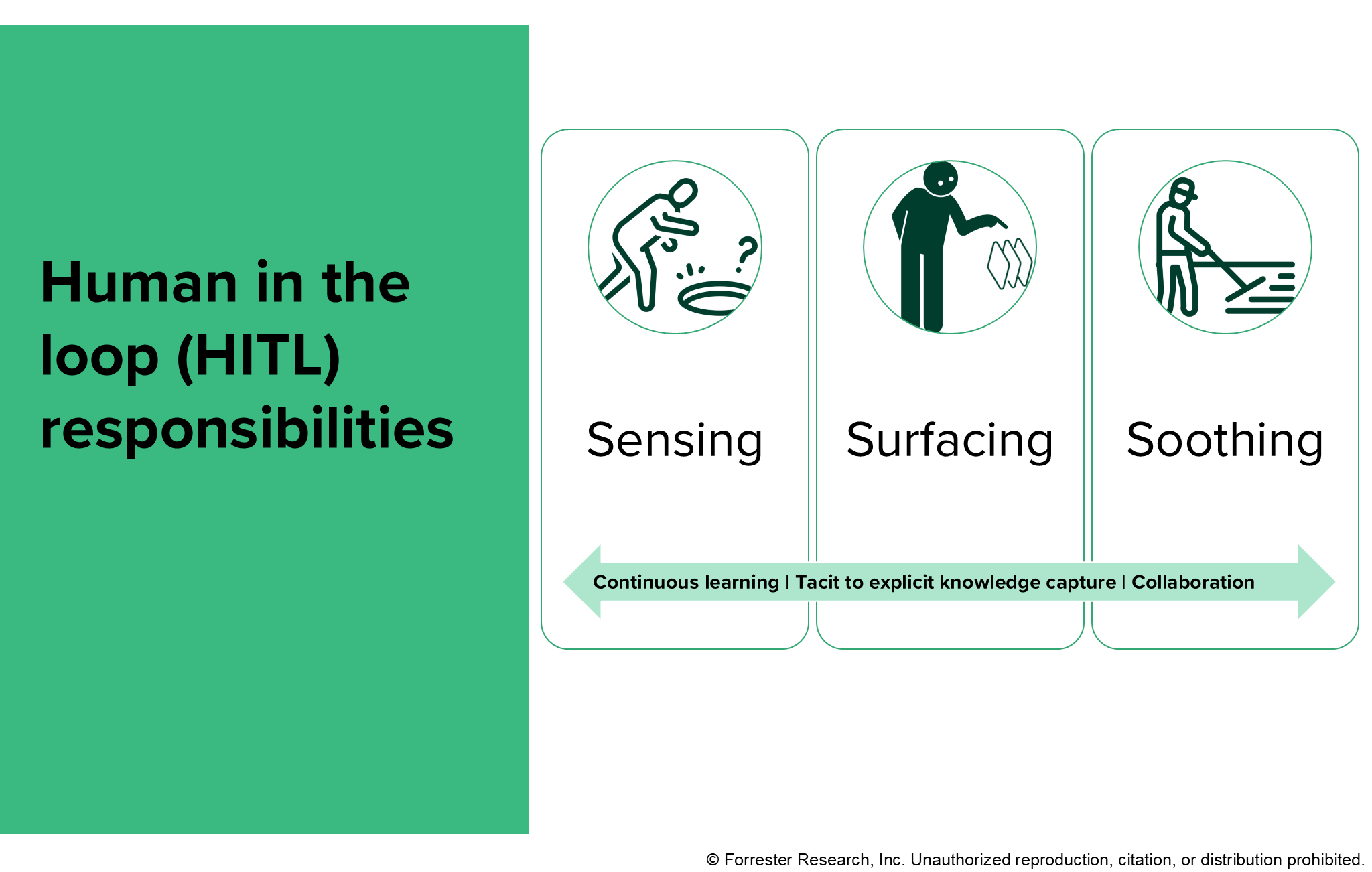

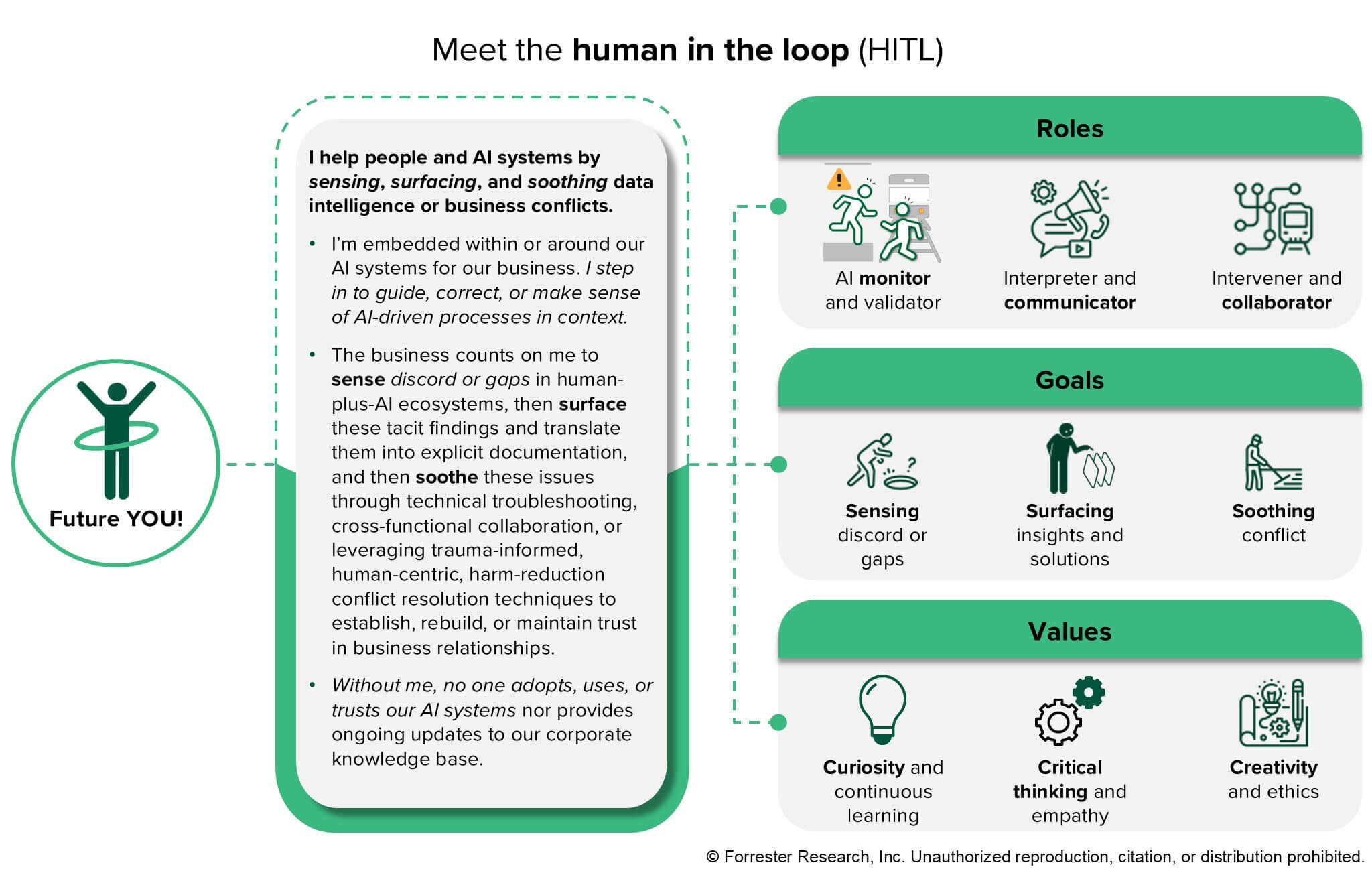

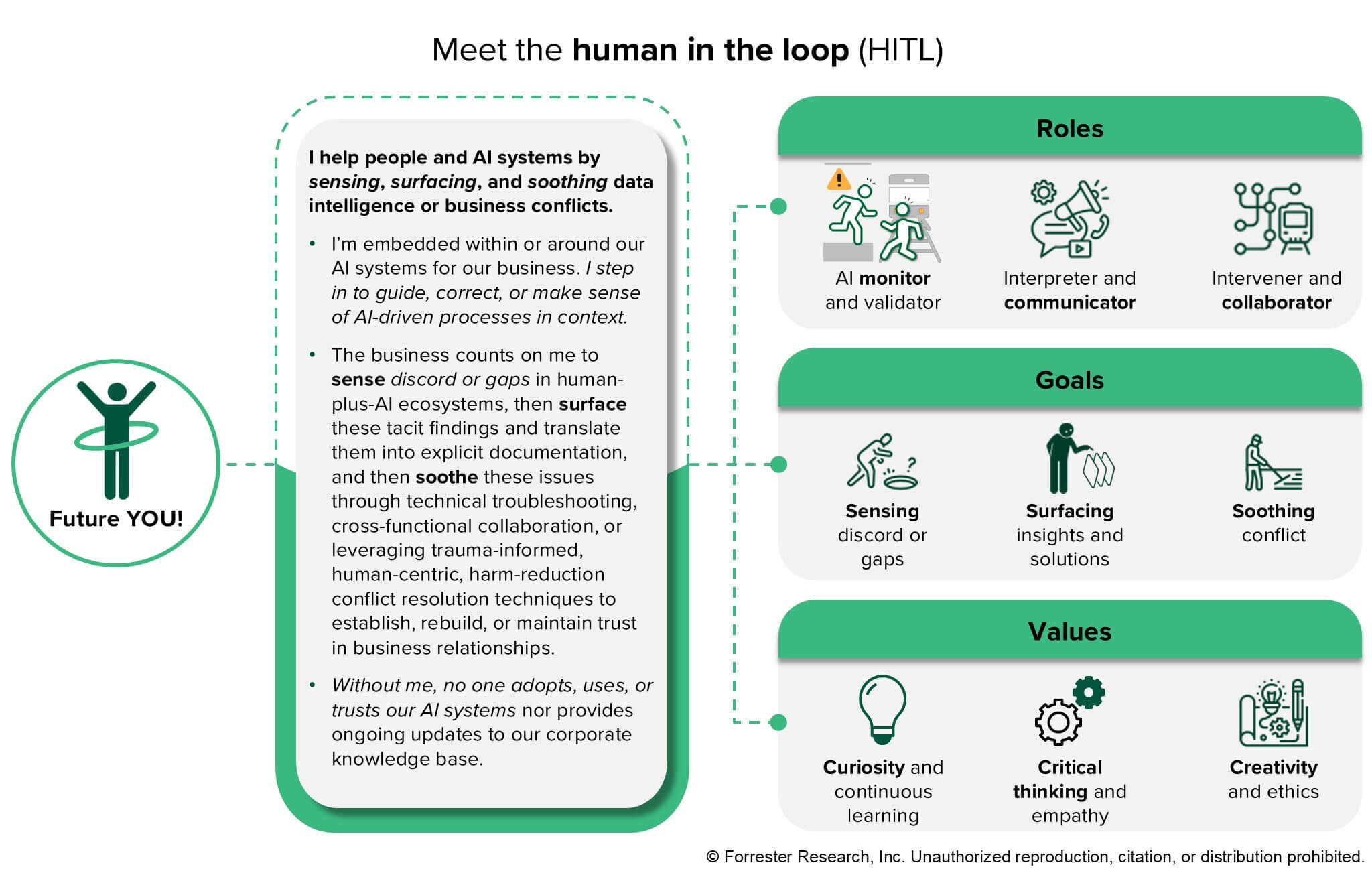

Dans ce contexte, le concept d’humain dans la boucle (HITL) prend une place centrale. Il n'est pas un personnage résiduel, ni un simple contrôleur technique. Il s’agit d’un rôle structurel inséré dans, autour ou au-dessus des systèmes d’IA, avec des responsabilités de validation, d’interprétation et d’intervention. Forrester distille les contributions humaines en trois fonctions clés qui définissent la nouvelle architecture du travail.

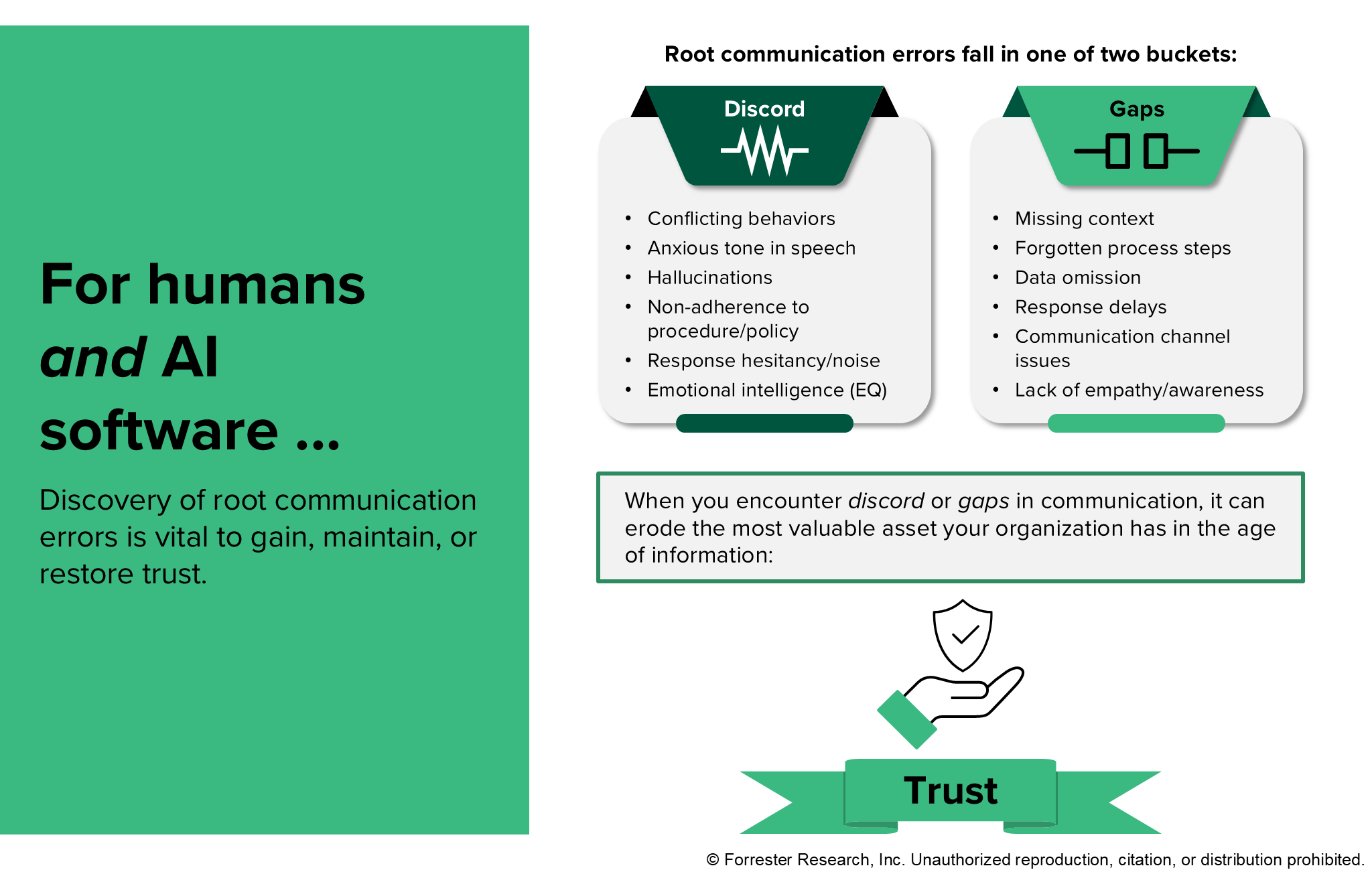

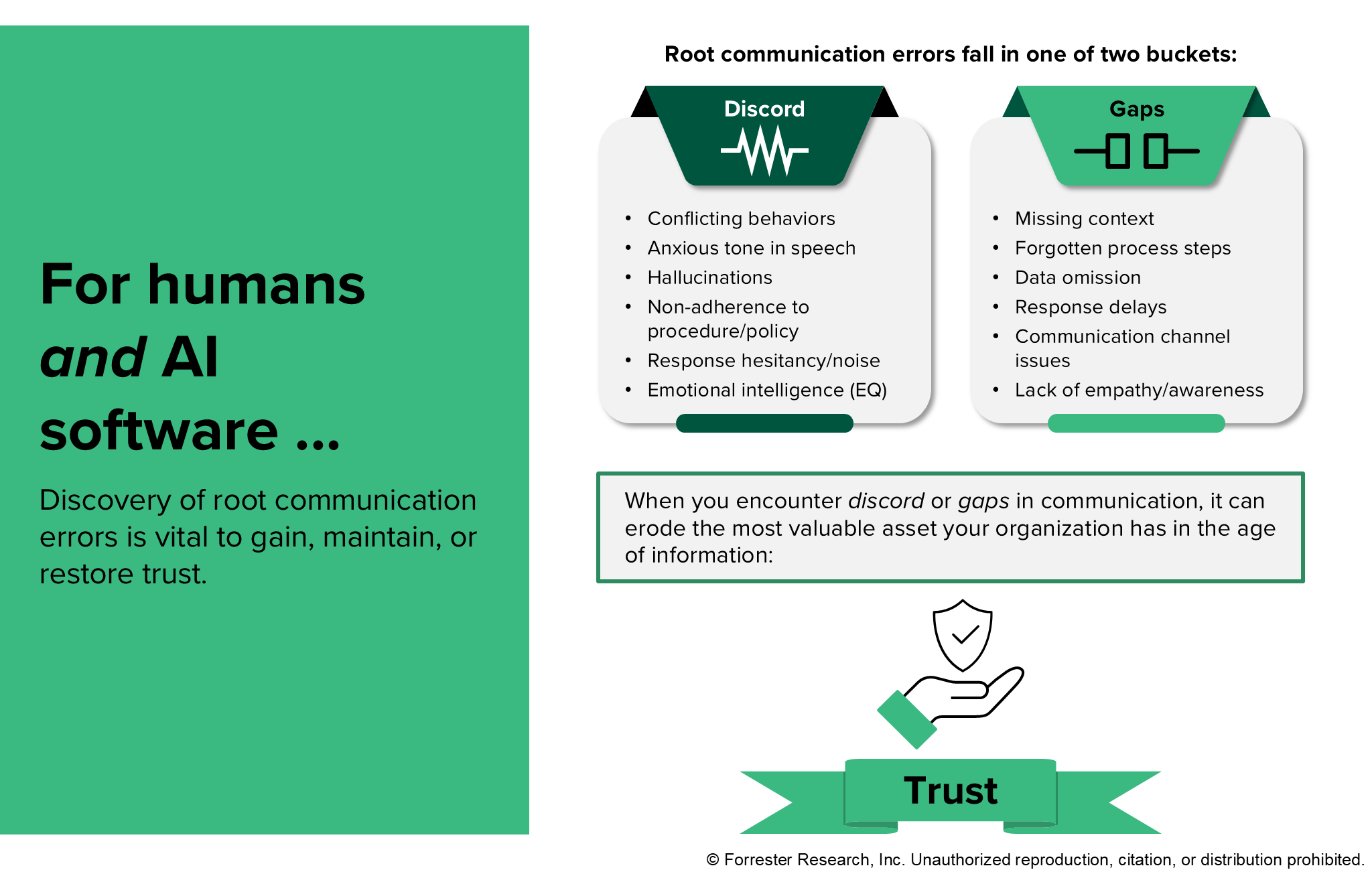

Le premier est la détection. Les humains restent des capteurs sophistiqués dans les systèmes socio-techniques. Ils sont capables d'intercepter des anomalies que les modèles ne reconnaissent pas : tensions de communication, incohérences entre directives, lacunes documentaires, erreurs de contexte, hallucinations ou signaux faibles qui anticipent des frictions organisationnelles. Modèles de processus d’IA ; les êtres humains perçoivent des désalignements culturels, émotionnels et relationnels.

La deuxième fonction est de faire surface. Une fois le problème identifié, HITL le rend explicite. Il traduit les signaux implicites en documentation structurée, met en lumière les biais opérationnels ou les problèmes critiques et les relie aux objectifs commerciaux. Cette étape évite qu’un dysfonctionnement reste confiné aux logs ou aux métriques, mais le transforme plutôt en apprentissage organisationnel.

La troisième fonction est apaisante, c'est à dire la capacité à stabiliser le système après une erreur ou une friction générée par l'IA. C’est là qu’intervient la reconstruction de la confiance. Lorsqu’un agent numérique produit un résultat inapproprié ou génère une insatisfaction, l’humain intervient pour expliquer, corriger et rétablir la cohérence. La confiance représente l'atout le plus fragile de l'économie de l'information : sans confiance, aucun système n'est adopté, mis à jour ou alimenté avec des données de qualité.

Compétences hybrides : la vraie frontière

Le profil HITL requiert une combinaison de compétences techniques et relationnelles qui dépassent les catégories traditionnelles. Au niveau humain, l’intelligence émotionnelle, la capacité narrative, la gestion du changement et la capacité à transformer des connaissances tacites en documentation explicite sont nécessaires. HITL agit comme médiateur entre les systèmes et les personnes, réduit les frictions et assure la continuité des activités.

Sur le plan technique, une solide maîtrise des données, une expertise en ingénierie rapide, une familiarité avec la gestion des bases de connaissances et une compréhension de la logique de fonctionnement des modèles sont requises. Même une base en codage et en mathématiques reste pertinente lorsque des erreurs complexes ou des intégrations entre systèmes apparaissent.

HITL devient donc un connecteur entre quatre dimensions : la communication entre les personnes, le dialogue avec les agents IA, l'alignement avec le métier et l'intégration entre systèmes automatisés. La pérennité de la transformation est en jeu dans cette position intermédiaire.

Responsabilité partagée entre les data leaders et les RH

Le rapport souligne la nécessité d'une collaboration structurée entre les responsables des données et les fonctions RH. Des réductions prématurées des effectifs peuvent compromettre la capacité de l’organisation à maintenir et à mettre à jour ses connaissances internes, qui constituent la matière première de l’IA elle-même.

Une stratégie durable privilégie la reconversion et le réaménagement plutôt que les coupes aveugles. Le temps libéré par l’automatisation peut être réinvesti dans l’amélioration continue, la gouvernance des données et le développement de nouvelles compétences. Dans ce scénario, l’organisation doit adopter une forme résiliente, capable de se reconfigurer sous la pression sans perdre sa cohérence.

Le plus grand risque n’est pas l’adoption de l’IA, mais une gestion à courte vue de la transition. L’augmentation de la productivité peut s’accompagner d’un creusement des inégalités si nous n’investissons pas dans la maîtrise de l’IA et le développement des compétences internes. L’ère des agents IA n’élimine pas l’être humain. Il redéfinit sa fonction. Et cette fonction est moins exécutive et plus systémique : percevoir, rendre visible et stabiliser.