Agentic AI 2026 : observabilité et contrôle des opérations autonomes

L’adoption de l’IA agentique dépasse la phase expérimentale et entre dans les processus de production des entreprises. D'après le rapport Le pouls de l’IA agentique en 2026basé sur une enquête mondiale auprès de 919 décideurs d'entreprise, les systèmes autonomes capables de raisonner, d'apprendre et d'exécuter des tâches complexes sans intervention humaine continue sont désormais une réalité opérationnelle.

Dans le même temps, un point critique apparaît clairement : l’autonomie sans contrôle augmente le risque opérationnel au lieu de le réduire.

Le document analyse la maturité des projets, les barrières technologiques, les modèles de gouvernance et les critères de mesure de la valeur, identifiant l'observabilité comme le véritable facteur permettant l'évolutivité de l'IA agentique dans les environnements d'entreprise.

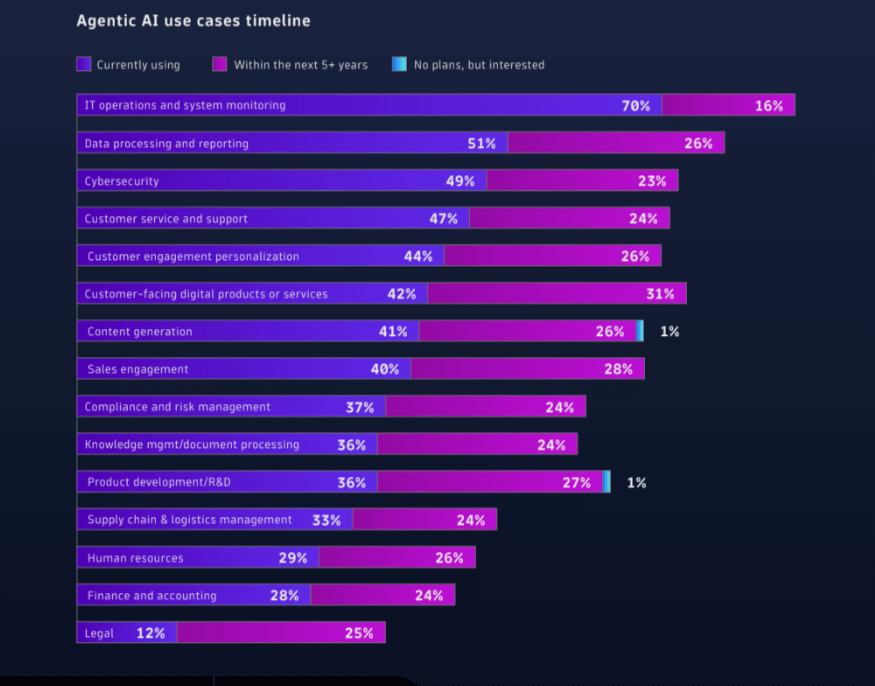

L'IA agentique s'étend au-delà de l'informatique, mais commence par les fonctions critiques

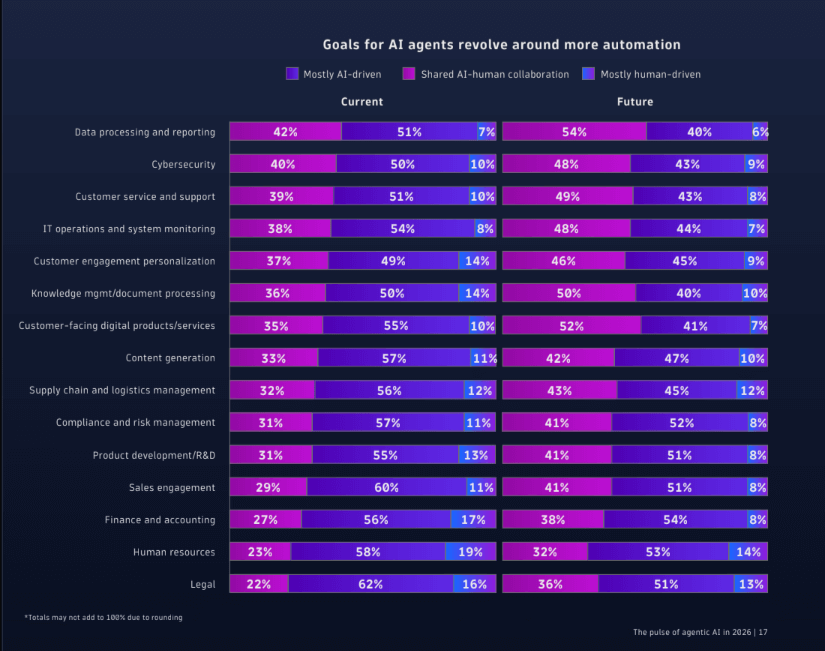

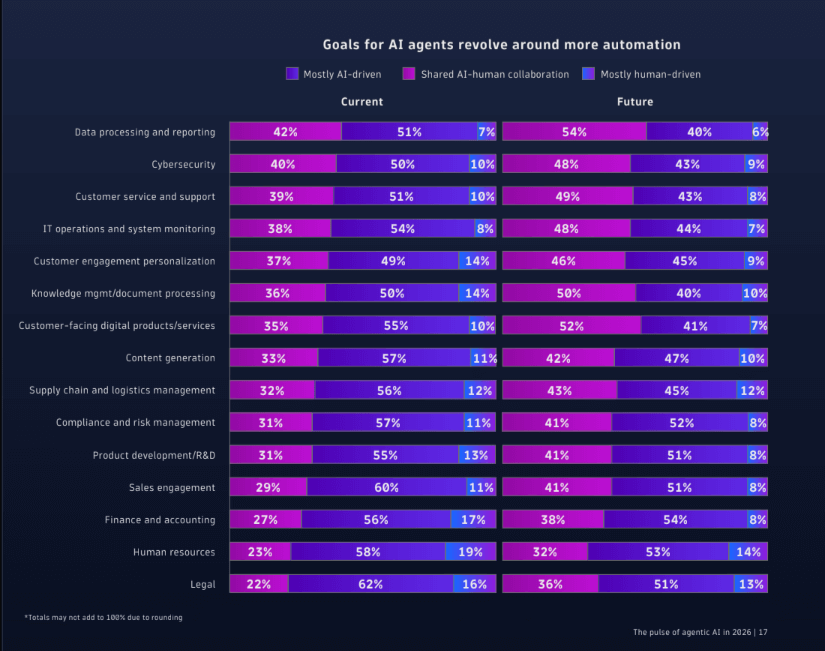

En 2026, 72 % des organisations utilisent des agents IA pour les opérations informatiques et DevOps, tandis que 50 % les emploient dans des cas d'utilisation internes et externes. Les domaines les plus surveillés restent ceux qui présentent la plus grande criticité opérationnelle, comme la surveillance des systèmes, la cybersécurité, le traitement des données et le support client, où l'erreur a des impacts immédiats sur la continuité et la sécurité du service.

Dans le même temps, une attention croissante est portée aux applications orientées client, notamment la personnalisation de l'expérience, les produits numériques et l'automatisation des processus de vente. Ces mises en œuvre affichent les taux de croissance les plus élevés à moyen terme, confirmant une stratégie qui vise à étendre l'autonomie également à l'extérieur, tout en maintenant de solides mécanismes de contrôle.

Des investissements croissants et des priorités orientées vers le retour opérationnel

Les budgets dédiés à l’IA agentique restent élevés. Les dépenses moyennes actuelles se situent entre 2 et 5 millions de dollars, 74 % des entreprises s'attendant à une augmentation au cours des douze prochains mois. Près de la moitié des personnes interrogées estiment une augmentation supplémentaire comprise entre 2 et 5 millions de dollars. Le retour sur investissement est avant tout associé aux opérations informatiques, à la cybersécurité et au traitement des données, domaines dans lesquels les bénéfices sont plus mesurables et reproductibles. Cette approche confirme une approche prudente, qui privilégie les cas d’usage structurels avant d’étendre l’autonomie à des processus moins standardisés.

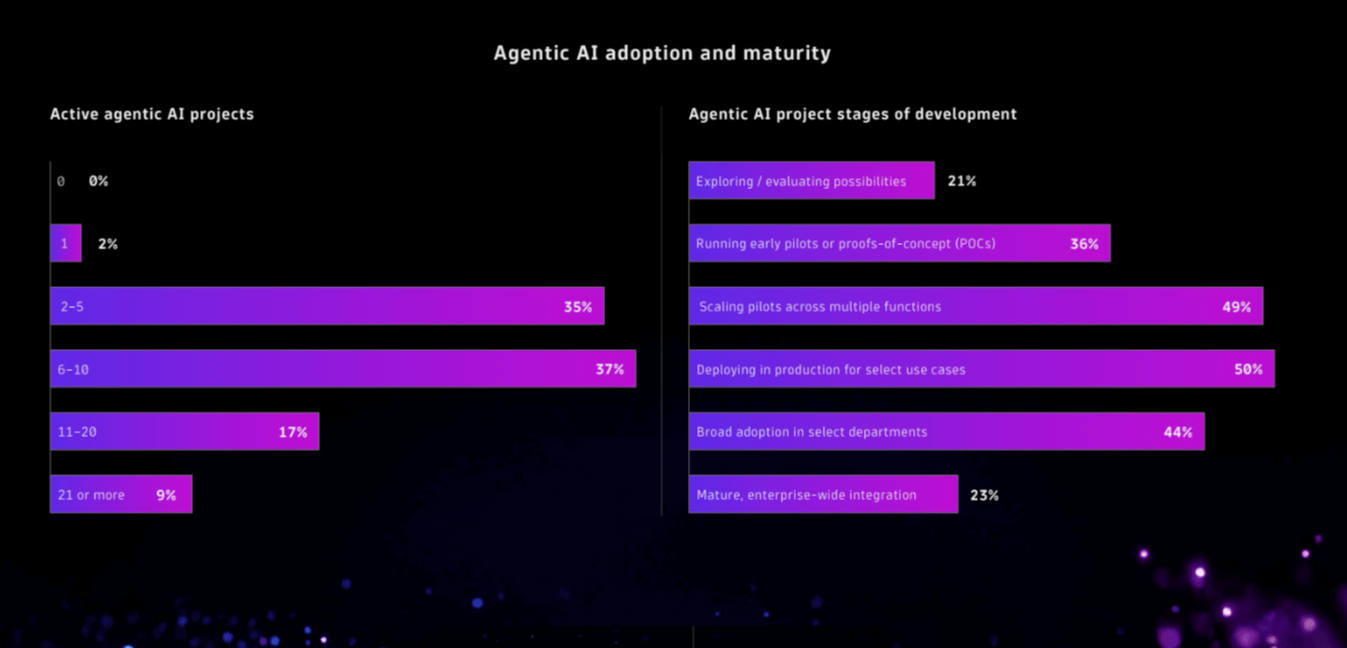

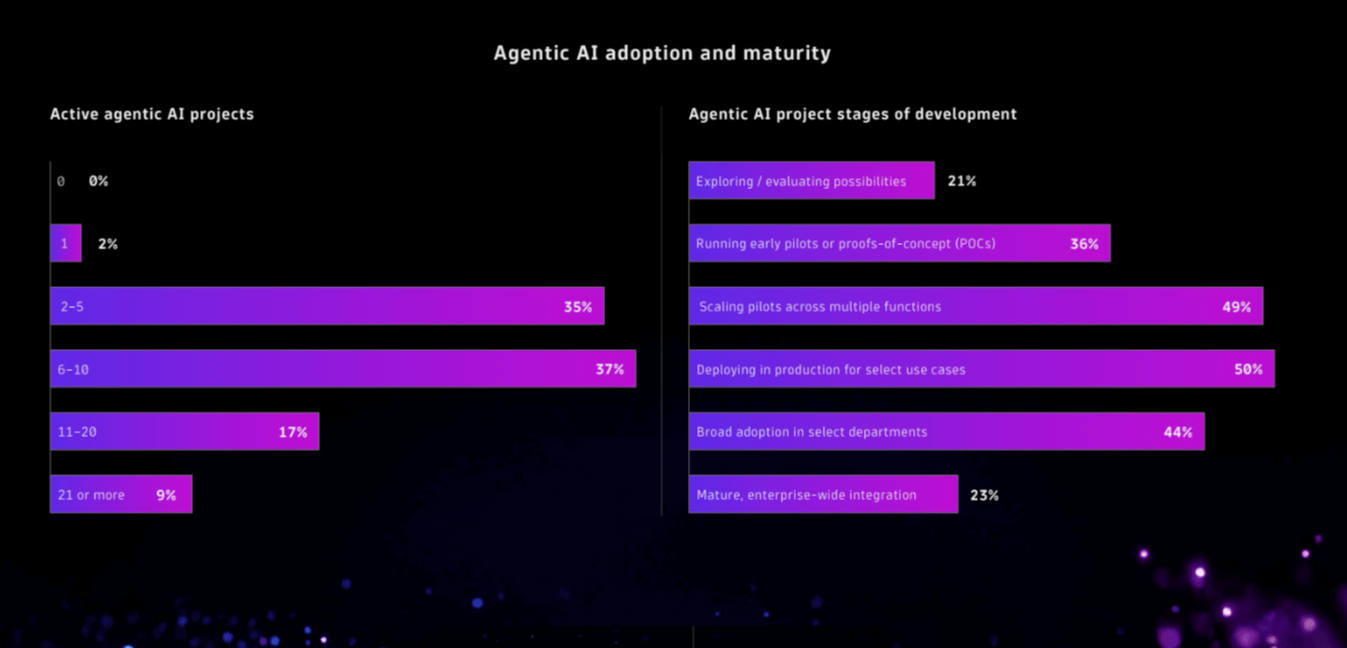

Une adoption en hausse, mais avec des barrières techniques encore importantes

La transition de l’automatisation traditionnelle vers des opérations autonomes se déroule rapidement, mais non sans obstacles. 50 % des entreprises ont déjà des projets en production pour des cas d'utilisation limités, tandis que 44 % envisagent un déploiement plus large dans des départements spécifiques. La majorité des organisations gèrent encore un nombre limité d'initiatives, entre 2 et 10 projets actifs, signe d'une phase de consolidation. Les principaux défis concernent la confiance dans les systèmes autonomes et la capacité limitée à observer et comprendre le comportement des agents d’IA. L’absence de règles claires sur le moment où un agent peut agir de manière autonome, la mauvaise traçabilité des décisions et la difficulté de relier les résultats techniques aux objectifs commerciaux ralentissent le chemin vers la pleine maturité.

Fiabilité et sécurité comme critères d’entrée en production

Lorsqu’un projet d’IA agentique passe du pilote à la production, les priorités sont claires. La sécurité et la protection des données représentent le premier critère de décision pour 59 % des personnes interrogées, suivies par l'exactitude et la fiabilité des résultats.

Ce n'est qu'en second lieu que des aspects tels que l'évolutivité, le retour sur investissement ou la conformité réglementaire entrent en jeu. Les évaluations d’éthique, d’équité ou de partialité sont moins centrales dans cette phase, non pas en raison d’un manque d’intérêt, mais parce que les entreprises privilégient la stabilité technique comme condition préalable essentielle à toute gouvernance future.

L’humain dans la boucle comme modèle dominant

Malgré la poussée vers l'autonomie, le rapport met en évidence un choix clair : l'être humain reste partie intégrante du processus de prise de décision. Plus des deux tiers des décisions générées par l’IA agentique sont désormais vérifiées par un opérateur humain, via des contrôles de qualité des données, des revues de résultats et une surveillance des dérives comportementales.

Seules 13 % des organisations développent des agents totalement autonomes, tandis que la majorité adopte des modèles hybrides alliant autonomie et supervision. Cette approche est considérée comme structurelle et non transitoire, en particulier pour les processus métiers plus complexes ou ceux ayant un plus grand impact sur la réputation.

La mesure de la valeur passe par la résilience et la fiabilité

Le succès de l’IA agentique ne se mesure pas principalement en termes d’utilisation, mais plutôt en termes de performances techniques, de résilience du système et de réactivité en temps réel. 60 % des entreprises citent les indicateurs techniques comme principal indicateur de succès, suivis de l'efficacité opérationnelle, de la satisfaction client et de la réduction des risques.

Un chiffre significatif concerne les pratiques de contrôle : 44% des organisations analysent encore manuellement les flux de communication entre agents, une limite qui freine l'évolutivité et augmente les temps de réaction en cas d'anomalies.

L'observabilité comme plan de contrôle pour les opérations autonomes

Le cœur du rapport est le rôle de l’observabilité, qui évolue d’un outil de surveillance à un plan de contrôle pour les systèmes autonomes. Avec les modèles probabilistes et les comportements non déterministes, les tests de pré-production ne suffisent plus. Nous avons besoin d’une visibilité continue, contextuelle et en temps réel sur les décisions des agents.

Près de 70 % des organisations utilisent des solutions d'observabilité pendant la phase de mise en œuvre, tandis que plus de la moitié les utilisent également en développement et en exploitation. Cependant, les outils traditionnels présentent des limites évidentes : comportements de « boîte noire », signaux fragmentés et difficultés à relier les mesures techniques aux résultats commerciaux.

Le rapport propose un modèle multi-niveaux, dans lequel l'observabilité relie l'infrastructure, les modèles, les communications entre les agents et les résultats des applications, fournissant des données déterministes pour soutenir les décisions génératives.

Vers un fonctionnement autonome gouverné

La prochaine phase de l’IA agentique ne consiste pas à introduire de nouveaux agents, mais à instaurer la confiance, la fiabilité et la résilience. Sans une base solide et observable, l’autonomie risque d’amplifier les erreurs et les vulnérabilités. Avec un contrôle basé sur des données contextuelles et vérifiables, il devient un facteur d’échelle de productivité et d’efficacité.

Le rapport de Dynatrace indique une direction claire : l'IA agentique est vouée à se développer, mais seules les organisations capables d'intégrer l'observabilité, la gouvernance et la surveillance humaine seront en mesure de la transformer en un avantage concurrentiel durable.