Le dernier deepfake de Stranger Things est si étonnant qu'il montre que la réalité commence à être facultative

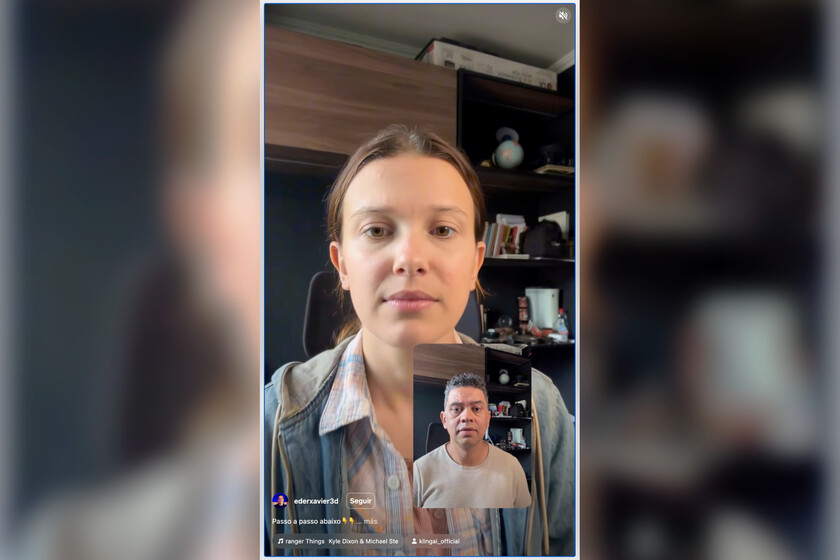

Cette semaine, un créateur de contenu brésilien nommé ederxavier3d a publié une vidéo étonnante sur son compte Instagram. On y voyait plusieurs des protagonistes de la série « Stranger Things » faisant exactement les gestes et les expressions qu'il faisait dans la fenêtre inférieure. Il a expliqué qu'il y était parvenu de manière simple et grâce au nouveau Kling 2.6 et à sa fonction Motion Control.

Cette option permet de transférer les mouvements que nous effectuons dans une vidéo à n'importe quelle personne réelle ou fictive, quel que soit le style dans lequel elle est représentée (il peut s'agir d'un personnage de bande dessinée) avec un résultat étonnant.

Et dans le cas de la vidéo du créateur brésilien, cela se voit clairement : ces vidéos pourraient parfaitement passer pour réelles dans presque tous les cas. Il est vrai que si vous regardez attentivement, vous pouvez sentir que quelque chose ne va pas, mais uniquement parce que la vidéo a été partagée, indiquant clairement qu'elle a été créée avec l'IA.

Cette vidéo a une nouvelle fois réveillé un débat lié depuis quelques temps à ce type de deepfakes. Justine Moore, associée de la société d'investissement a16z, a expliqué que « nous ne sommes pas préparés à la rapidité avec laquelle les flux de production (vidéo) vont changer avec l'IA. Certains des derniers modèles vidéo ont des implications immédiates pour Hollywood. Des échanges de personnages sans fin à des coûts négligeables ».

Comment l'histoire a changé. En avril 2023, nous avons proposé un petit jeu à tous ceux qui nous lisent : seriez-vous capable de distinguer une image réelle de celle générée par l'IA ? À cette époque, l’IA obtenait déjà des résultats remarquables – l’image du pape avec le manteau le démontrait – mais le sentiment était que l’on pouvait encore distinguer si une image avait été créée avec une IA ou non. Avec la vidéo, les choses étaient encore plus claires, car à cette époque, la génération de vidéos IA en était à ses balbutiements.

Trois ans plus tard, les choses sont très différentes, et il existe plusieurs plateformes d'IA (Veo 3, Sora 2, Kling, Runway) qui génèrent des vidéos que n'importe qui pourrait facilement confondre sans problème. Dites-le à Will Smith.

La vidéo d'ederxavier3d le démontre également, et en fait quelque chose d'unique s'est produit avec elle : il y avait des rumeurs selon lesquelles les personnages de Stranger Things avaient effectivement enregistré ces apparitions et le créateur avait imité leurs mouvements, puis des rumeurs sont apparues qui niaient que cela était vrai et qui suggéraient que depuis le début les vidéos n'étaient rien de plus que ce qu'elles semblaient : des deepfakes créés avec l'IA.

A priori tout laisse penser que c'est le cas : la fonctionnalité de Kling 2.6 n'est pas du tout nouvelle et d'autres plateformes permettent de transférer nos mouvements et nos gestes – et même notre voix – vers un personnage généré par l'IA. Le problème est qu’à ce stade, il est presque impossible de distinguer si la personne qui apparaît à l’écran est réelle ou non.

Cette technologie est extraordinairement frappante et provoque cet « effet wow » que recherchent tant les entreprises d’IA, mais malgré les options créatives qu’elle offre, les risques semblent ici particulièrement notables.

Le vol d’identité est désormais plus facile que jamais, ce qui signifie probablement que nous verrons beaucoup plus de cas dangereux. Souvenez-vous simplement de l'employé qui a transféré 25 millions de dollars en croyant que la personne qui le lui avait dit par vidéoconférence était son véritable patron.

On ne sait pas comment, par exemple, les studios hollywoodiens réagiront à cette technologie, mais pour l'instant certains prennent déjà des mesures en la matière pour tenter de se protéger.

Le meilleur exemple est Matthew McConaughey, qui s'est ces jours-ci « breveté » pour disposer d'une ressource juridique supplémentaire (dont nous ne sommes pas sûrs qu'elle soit nécessaire) pour se protéger contre d'éventuelles vidéos se faisant passer pour lui. Les implications sont énormes et nous entrons dans une époque où quelque chose d’inquiétant va se produire : nous ne pourrons pas faire confiance à ce que nous voyons sur un écran.

À Simseo | « Bonjour, je suis ton petit-fils et j'ai besoin de 3 000 dollars » : il y a déjà des arnaques aux personnes âgées avec des voix générées par l'IA