Les TPU de Google sont le premier grand signe que l'empire de NVIDIA s'effondre

C'était en 2013 et Jeff Dean, l'un des dirigeants de Google, et son équipe ont réalisé quelque chose : si chaque utilisateur d'Android utilisait sa nouvelle option de recherche vocale trois minutes par jour, l'entreprise devrait doubler le nombre de centres de données pour faire face à la charge de calcul. À l’époque, Google utilisait des processeurs et des GPU standards pour cette tâche, mais ils ont paniqué et ont réalisé qu’ils devaient créer leurs propres puces pour ces tâches.

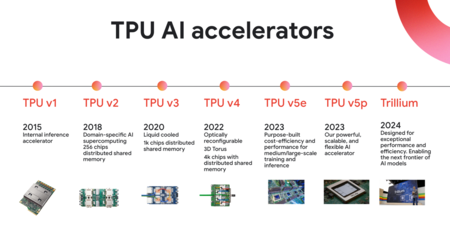

Ainsi est né le premier Tensor Processing Unit (TPU) de Google, un ASIC spécialement conçu pour exécuter les réseaux neuronaux qui alimentent ses services vocaux. Cela n'a cessé de croître et en 2015, avant que le monde ne s'en rende compte, ces premiers TPU ont accéléré Google Maps, Google Photos et Google Translate. Une décennie plus tard, Google a créé des TPU si puissants qu’ils sont devenus, presque involontairement, une menace surprenante et inattendue pour le tout-puissant NVIDIA. Là, ce n'est rien.

Bienheureuse panique.

Les TPU de Google tiennent leur promesse

Jusqu’à présent, lorsqu’une entreprise d’IA souhaitait entraîner ses modèles, elle se tournait vers les puces avancées NVIDIA. La situation a changé ces derniers temps et nous avons en fait observé deux signes récents qui marquent certainement un tournant.

Il manque à cette chronologie le dernier et le plus frappant membre de cette famille, Ironwood, présenté en avril 2025. Source : Google.

Le premier a été le lancement de Claude Opus 4.5, un modèle exceptionnel, notamment dans les tâches de programmation. Les responsables d'Anthropic ont déjà expliqué que ce nouveau modèle ne dépend pas uniquement de NVIDIA, mais combine plutôt la puissance de trois propositions différentes : celle de NVIDIA, mais aussi Trainium d'Amazon et les TPU de Google.

Mais Google a également fait sensation car son tout nouveau modèle Gemini 3 AI a été exclusivement entraîné avec les nouveaux TPU Ironwood présentés en avril et qui font sensation.

Comme nous l'avons dit, Google a démarré ce projet en 2013 et a lancé son premier TPU en 2015, mais ce besoin interne est devenu une bénédiction, car ce que Google ne pouvait pas savoir, c'est que ces TPU finiraient par arriver au bon moment : le lancement de ChatGPT les a transformés en une fantastique opportunité de renforcer son infrastructure d'IA, mais aussi d'être utilisés pour la formation et l'inférence de ses modèles d'IA.

De là, nous finissons par atteindre les TPU Ironwood actuels, qui dans leur septième génération sont exceptionnels tant en inférence qu'en formation (comme l'a démontré leur utilisation pour Gemini 3).

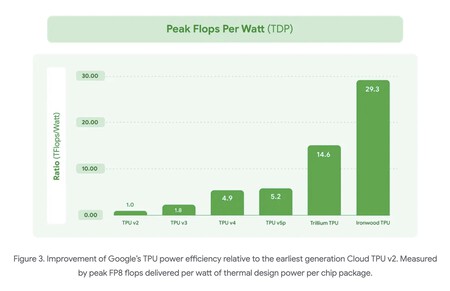

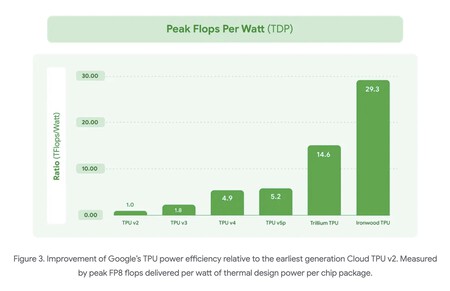

Google a réussi à tirer encore plus de profit de ses puces et a doublé le pic FLOPS par watt par rapport à sa génération précédente. Source : Google.

L'efficacité et la puissance de ces puces font un bond très notable par rapport à leurs prédécesseurs, et elles parviennent par exemple à doubler la performance FLOPS par watt obtenue avec les puces Trillium.

Si on les compare avec le TPU v5p de 2023, les puces parviennent à atteindre 4 614 TFLOPS, 10 fois plus que les 459 TFLOPS de ces modèles d'il y a deux ans. C'est un bond extraordinaire en termes de performances (et d'efficacité).

La clé pour 2025 : Google laisse désormais les autres utiliser ses TPU

Mais dans l'évolution des TPU, il y a un autre élément différenciateur en 2025. C'est l'année où Google a cessé « d'être égoïste » avec ses TPU. Auparavant, elle seule pouvait les utiliser, mais ces derniers mois, elle a conclu des accords avec OpenAI – qui cherche également à fabriquer ses propres puces – et notamment avec Anthropic.

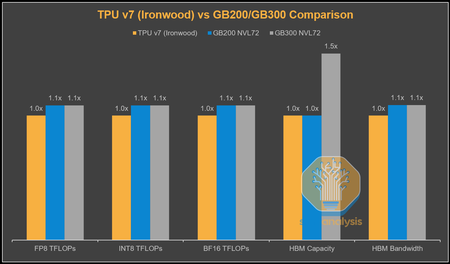

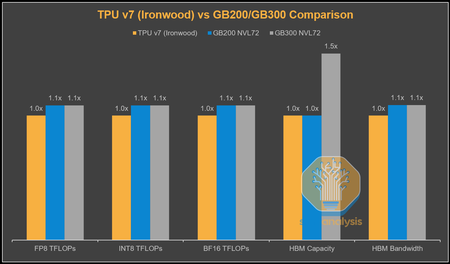

Les performances d'Ironwood sont déjà comparables à celles du GB200 et même du GB300 de NVIDIA. Source : SemiAnalyse.

Cette deuxième alliance est particulièrement monumentale dans le cadre de cette stratégie d’externalisation. Google ne se contente pas de louer de la capacité dans son cloud, mais facilite également la vente physique de matériel. L'accord porte sur un million de TPU : 400 000 unités de son Ironwood TPUv7 vendues directement via Broadcom et 600 000 louées via Google Cloud (GCP).

Un rapport détaillé dans SemiAnalysis révèle comment, d'un point de vue technique, le TPUv7 Ironwood est un redoutable concurrent. L'écart de performances avec NVIDIA se réduit et le TPU de Google est pratiquement égal à la puce Blackwell de NVIDIA en termes de FLOPS et de bande passante mémoire.

Mais le véritable avantage réside dans le coût. Le coût total de possession (TCO) d'un serveur Ironwood est estimé 44 % inférieur pour Google à celui d'un serveur NVIDIA GB200, permettant au géant de la recherche de proposer des prix très compétitifs à des clients comme Anthropic.

Pour aider encore plus dans cette course, soulignent-ils dans SemiAnalysis, Google a un autre atout dans sa manche. Il s'agit de l'Inter-Chip Interconnect (ICI) de Google, une architecture réseau qui permet de connecter jusqu'à 9 216 puces Ironwood à l'aide d'une topologie torique 3D.

Google utilise également des commutateurs de circuits optiques qui permettent d'acheminer les données optiques sans conversion électrique, réduisant ainsi à la fois la latence et la consommation d'énergie. Cela vous permet de reconfigurer la topologie de ce réseau à la volée pour éviter (ou atténuer) les pannes et optimiser différents types de parallélisme.

Le « fossé » de NVIDIA avec CUDA se rétrécit

Nous avons souvent répété que même si les fabricants de semi-conducteurs disposent déjà de puces flashy – dites-le à AMD – la véritable force de NVIDIA réside en réalité dans CUDA, la plate-forme logicielle qui est devenue de facto le standard pour les développeurs et les chercheurs en IA.

Google veut également changer les choses ici. Ces dernières années, l'entreprise a tenté de se concentrer sur les bibliothèques Python telles que JAX ou

Cela est crucial pour permettre aux ingénieurs et aux développeurs de commencer plus facilement à migrer vers leurs TPU plutôt que vers les GPU NVIDIA. Avant, il était possible d'utiliser PyTorch sur les TPU, mais c'était fastidieux, comme s'il fallait parler une langue à l'aide d'un dictionnaire en temps réel, alors que pour les GPU NVIDIA, c'était la langue « native ».

Avec XLA, Google a utilisé une bibliothèque intermédiaire comme traducteur pour pouvoir utiliser PyTorch, mais c'était un cauchemar pour les développeurs. Le support natif permet aux TPU Google de se comporter comme les GPU NVIDIA aux yeux du développeur.

L’autre grande avancée réalisée par Google dans le domaine des logiciels vise à prendre en charge les écosystèmes d’inférence ouverts. Ici, vLLM et SGLang sont comme un moteur hautes performances pour une voiture de course : ces bibliothèques logicielles vous permettent d'exécuter des modèles d'IA de manière efficace et à moindre coût, et elles fonctionnaient en standard sur les GPU NVIDIA.

La solution de Google pour pouvoir utiliser vLLM consistait encore une fois à prendre ce code et à le traduire en temps réel en JAX, ce qui s'est avéré inefficace. Il n'y a pas eu d'optimisation, mais Google résout ce problème avec un groupe de travail qui propose une fois de plus un support beaucoup plus « natif » dans les TPU de Google. Celui-ci est actuellement en plein développement, mais il vise également à « réduire le fossé » dont dispose NVIDIA et qui constitue un atout important pour continuer à dominer ce marché.

Nous sommes donc confrontés à un potentiel tournant des événements dans le monde des fabricants de puces IA. La situation actuelle de Google en fait clairement la menace la plus sérieuse pour NVIDIA à ce jour.

Nous ne sommes plus devant un fournisseur d’infrastructure cloud qui optimise ses propres charges de travail, mais plutôt une entreprise qui vend des solutions complètes et qui offre de meilleures performances par dollar, une plus grande échelle de réseau et une feuille de route prometteuse dans le domaine logiciel.

NVIDIA a bien sûr des problèmes. Nous verrons comment il réagit.

À Simseo | Le problème d'AMD n'est pas qu'il ne fabrique pas de bons GPU pour l'IA. Ce n'est même pas proche de NVIDIA