L'IA apprend à suivre les normes prédéfinies grâce à une combinaison de logique et d'apprentissage automatique

L'intelligence artificielle devient de plus en plus polyvalente – de la planification de l'itinéraire à la traduction de texte, elle est devenue depuis longtemps un outil standard. Mais il ne suffit pas que l'IA donne simplement des résultats utiles: il devient de plus en plus important que cela conforme également aux normes juridiques, éthiques et sociales. Mais comment enseigner de telles normes à une machine?

Chez Tu Wien, une nouvelle approche a maintenant été développée. En combinant l'apprentissage automatique et la logique, les agents autonomes peuvent être formés pour suivre les normes prédéfinies. Il est même possible d'établir une hiérarchie de ces normes – en développant certains plus importants que d'autres. À IJCAI 2025, une conférence sur l'IA tenue cette année à Montréal, au Canada, ce travail a été reconnu avec le Distinguished Paper Award.

Essais et erreur

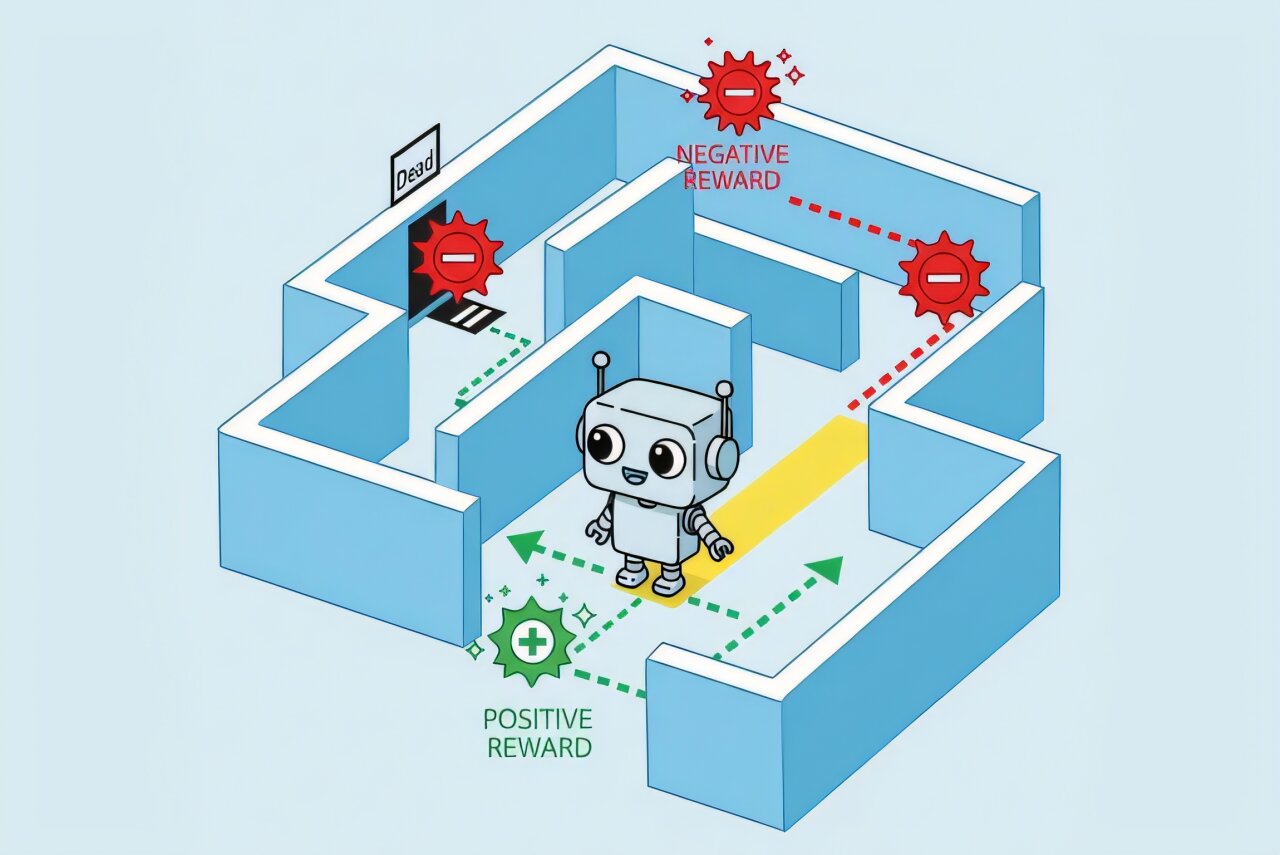

L'enseignement de nouvelles capacités de l'IA fonctionne parfois un peu comme des astuces d'enseignement à un animal de compagnie: récompenser si la tâche est effectuée correctement, punition si la réponse est erronée. L'IA essaie différents comportements et, par essais et erreurs, apprend à maximiser sa récompense. Cette méthode est appelée apprentissage du renforcement et joue un rôle clé dans la recherche sur l'IA.

« On pourrait essayer d'enseigner certaines règles en récompensant l'agent pour les normes suivantes. Cette technique fonctionne bien dans le cas des contraintes de sécurité », explique le professeur Agata Ciabattoni de l'Institut de logique et de calcul de Tu Wien. « Mais cela ne fonctionnerait pas, par exemple, avec des normes conditionnelles (« faire une sous-condition B »). Si l'agent trouve un moyen de gagner une récompense, cela pourrait retarder la finition de son travail réel exprès, pour avoir plus de temps pour marquer des points faciles. »

Normes comme formules logiques

L'équipe Tu Wien a choisi une voie fondamentalement différente, inspirée des anciennes œuvres philosophiques: les normes sont toujours représentées comme des formules logiques, mais les agents reçoivent une punition lorsqu'ils ne sont pas respectés à eux. Par exemple, « vous ne devez pas dépasser la limite de vitesse » est traduit par « Si vous dépassez la limite de vitesse, vous obtenez une punition de X. » Plus important encore, chaque norme est traitée comme un objectif indépendant.

« L'agent artificiel a un objectif à poursuivre – par exemple, pour trouver la meilleure route vers une liste de destinations. En même temps, nous définissons également des règles et normes supplémentaires qu'il doit observer en cours de route », explique Emery Neufeld, le premier auteur du journal. « Le fait que chaque norme soit traitée comme un objectif différent nous permet de calculer algorithmique le poids relatif que nous devons attribuer à ces objectifs afin d'obtenir un bon résultat global. »

Avec cette technique, il devient possible de coder des ensembles de règles même compliqués – par exemple, les normes qui ne s'appliquent que dans certaines conditions ou les normes qui dépendent de la violation d'autres normes.

Normes flexibles

« La grande chose est que lorsque les normes changent, la formation n'a pas à recommencer », explique Agata Ciabattoni. « Nous avons un système qui apprend à se conformer aux normes, mais nous pouvons ensuite ajuster ces normes par la suite, ou changer leur importance relative, déclarant qu'une règle est plus importante qu'un autre. »

Dans leur article, Ciabattoni et son équipe ont pu montrer que cette technique permet d'imposer un large éventail de normes, tandis que l'IA continue de poursuivre ses principaux objectifs.