Les chercheurs découvrent une vulnérabilité GPU qui pourrait menacer les modèles d'IA

Une équipe d'informaticiens de l'Université de Toronto a récemment découvert qu'un certain type d'attaque matérielle est efficace contre les unités de traitement graphique (GPU), les moteurs de calcul de base qui alimentent les modèles d'intelligence artificielle d'aujourd'hui et les services d'apprentissage automatique basés sur le cloud.

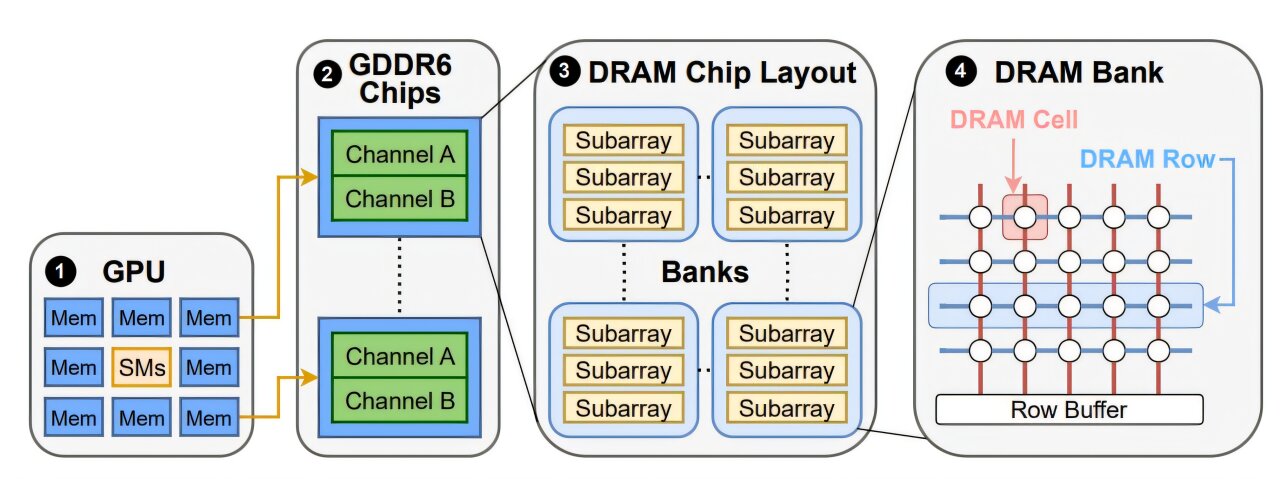

Les chercheurs ont constaté qu'une attaque de marteau, auparavant connu pour affecter la mémoire dans les unités de traitement central (CPU), est également efficace contre les GPU équipés d'une mémoire graphique Double Data Cate (GDDR). GDDR est conçu pour le transfert de données à grande vitesse et se trouve couramment dans les cartes graphiques.

Une attaque réussie contre les GPU exécutant des modèles d'IA pourrait entraîner des « lésions cérébrales catastrophiques » avec la précision du modèle passant de 80% à seulement 0,1%, explique Gururaj Saveshwar, professeur adjoint au Département d'informatique à la Faculté des arts et des sciences.

Une telle dégradation pourrait avoir de graves conséquences sur les applications d'IA qui dépendent de ces modèles, de l'analyse d'imagerie médicale dans les hôpitaux aux systèmes de détection de fraude dans les banques.

Dans une attaque de marteau en rangée, les cellules de mémoire sont manipulées dans des bits de retournement – detins de données – en accédant rapidement à des rangées de cellules adjacentes encore et encore. Cela provoque une interférence électrique qui conduit à des erreurs dans les régions de mémoire que l'attaquant n'a pas directement accessible, ce qui leur permet de contourner la sécurité ou de prendre le contrôle d'un système.

« Traditionnellement, la sécurité a été considérée à la couche logicielle, mais nous constatons de plus en plus des effets physiques sur la couche matérielle qui peuvent être exploitées comme des vulnérabilités », explique Sailshwar, qui est interdit à l'Edward S. Rogers Sr. Department of Electrical and Computer Engineering et à la Faculté de sciences et d'ingénierie appliqués.

Travailler avec le doctorat en informatique de deuxième année. L'étudiant Chris (Shaopeng) Lin et le premier cycle de quatrième année de premier cycle en informatique Joyce Qu, Saveshwar a développé une attaque GPUhammer de la preuve de concept ciblant la mémoire GDDR6 dans un NVIDIA RTX A6000, un GPU largement utilisé pour l'informatique haute performance. Ils ont découvert qu'un flip unique pour modifier l'exposant du poids d'un modèle d'IA pourrait entraîner une réduction massive de la précision du modèle.

« Cela introduit une nouvelle façon dont les modèles d'IA peuvent échouer au niveau matériel », a déclaré Saveshwar, qui a co-écrit un article avec Lin et Qu qui a été accepté au Usenix Security Symposium 2025, qui s'est tenu du 13 au 15 août à Seattle.

Les utilisateurs de GPU sont les plus à risque sont ceux qui gèrent les environnements de cloud computing – pas les utilisateurs individuels de la maison ou du bureau. Dans les paramètres cloud, plusieurs utilisateurs peuvent accéder simultanément au même GPU, permettant à un attaquant de falsifier le traitement des données d'un autre utilisateur.

Saileshwar note que les chercheurs devaient tenir compte des différences clés entre la mémoire CPU et GPU. Les GPU sont plus difficiles à cibler en raison de leurs taux de rafraîchissement de mémoire plus rapides, de la latence de la mémoire plus lente et d'autres différences architecturales. En fin de compte, les chercheurs ont tiré parti du parallélisme du GPU – sa capacité à exécuter plusieurs opérations simultanément – pour optimiser leurs modèles de martèlement. Ce réglage a conduit aux flips de bits qui ont démontré une attaque réussie.

Ce n'était pas facile. « Le martelage sur les GPU, c'est comme marteler l'aveugle », explique Saileshwar, notant que l'équipe a presque abandonné après des échecs répétés pour déclencher des flips de bits.

Sur les processeurs, les chercheurs peuvent utiliser des outils pour inspecter l'interface de mémoire et comprendre comment les accès à la mémoire se comportent et comment les instructions sont envoyées du CPU à la mémoire. Mais parce que les puces de mémoire GPU sont soudées directement sur la carte GPU, il n'y a pas de moyen facile d'effectuer des inspections similaires, dit Saileshwar. Le seul signal que l'équipe a observé était les flips de bits éventuels.

Plus tôt cette année, les chercheurs ont divulgué en privé leurs résultats au géant du GPU Nvidia – maintenant l'entreprise la plus précieuse du monde. En juillet, la société américaine a publié un avis de sécurité à ses clients.

Le remède suggéré de NVIDIA est de permettre une fonctionnalité appelée Code de correction d'erreur (ECC), qui peut repousser une attaque GPUHAMMER. Cependant, les chercheurs ont constaté que le remède ralentit les tâches d'apprentissage automatique jusqu'à 10%. Ils ont également averti que les attaques futures impliquant plus de flips bits pourraient être en mesure de submerger même les protections de l'ECC.

Les résultats soulignent la nécessité d'une attention accrue à la sécurité du GPU – une zone où Saileshwar dit que le travail ne fait que « commencer ».

« Une enquête plus importante révélera probablement plus de problèmes. Et c'est important, car nous menons des charges de travail incroyablement précieuses sur les GPU. Les modèles d'IA sont utilisés dans des contextes réels comme les soins de santé, la finance et la cybersécurité. S'il existe des vulnérabilités qui permettent aux attaquants de falsifier ces modèles au niveau du matériel, nous devons les trouver avant d'être exploités. »