L'outil d'IA identifie 1 000 revues «douteuses»

Une équipe d'informaticiens dirigée par l'Université du Colorado Boulder a développé une nouvelle plate-forme d'intelligence artificielle qui cherche automatiquement des revues scientifiques « douteuses ».

L'étude, publiée le 27 août dans la revue Les avancées scientifiques, aborde une tendance alarmante dans le monde de la recherche.

Daniel Acuña, auteur principal de l'étude et professeur agrégé au Département d'informatique, en rappelle plusieurs fois par semaine dans sa boîte de réception par courrier électronique: ces messages de spam proviennent de personnes qui prétendent être éditeurs dans des revues scientifiques, généralement des tarifs accuña, et proposent de publier ses papiers – à des frais élevés.

Ces publications sont parfois appelées journaux «prédateurs». Ils ciblent les scientifiques, les convaincant de payer des centaines, voire des milliers de dollars pour publier leurs recherches sans vérification appropriée.

« Il y a eu un effort croissant parmi les scientifiques et les organisations pour examiner ces revues », a déclaré Acuña. « Mais c'est comme Whack-A-Mole. Vous en attrapez un, puis un autre apparaît, généralement de la même entreprise. Ils créent simplement un nouveau site Web et procurent un nouveau nom. »

Le nouvel outil d'IA de son groupe mène automatiquement des revues scientifiques, évaluant leurs sites Web et autres données en ligne pour certains critères: les revues ont-elles un comité de rédaction avec des chercheurs établis? Leurs sites Web contiennent-ils beaucoup d'erreurs grammaticales?

Acuña souligne que l'outil n'est pas parfait. En fin de compte, il pense que les experts humains, et non les machines, devraient faire appel final à savoir si un journal est réputé.

Mais à une époque où des personnalités importantes remettent en question la légitimité de la science, l'arrêt de la propagation de publications douteuses est devenue plus importante que jamais, a-t-il déclaré.

« En science, vous ne partez pas de zéro. Vous construisez au-dessus des recherches des autres », a déclaré Acuña. « Donc, si le fondement de cette tour s'effondre, alors le tout s'effondre. »

Le secouer

Lorsque les scientifiques soumettent une nouvelle étude à une publication réputée, cette étude subit généralement une pratique appelée Examen par les pairs. Les experts extérieurs lisent l'étude et l'évaluent pour la qualité – ou, au moins, c'est l'objectif.

Un nombre croissant d'entreprises ont cherché à contourner ce processus pour réaliser un profit. En 2009, Jeffrey Beall, bibliothécaire à CU Denver, a inventé les revues «prédatrices» pour décrire ces publications.

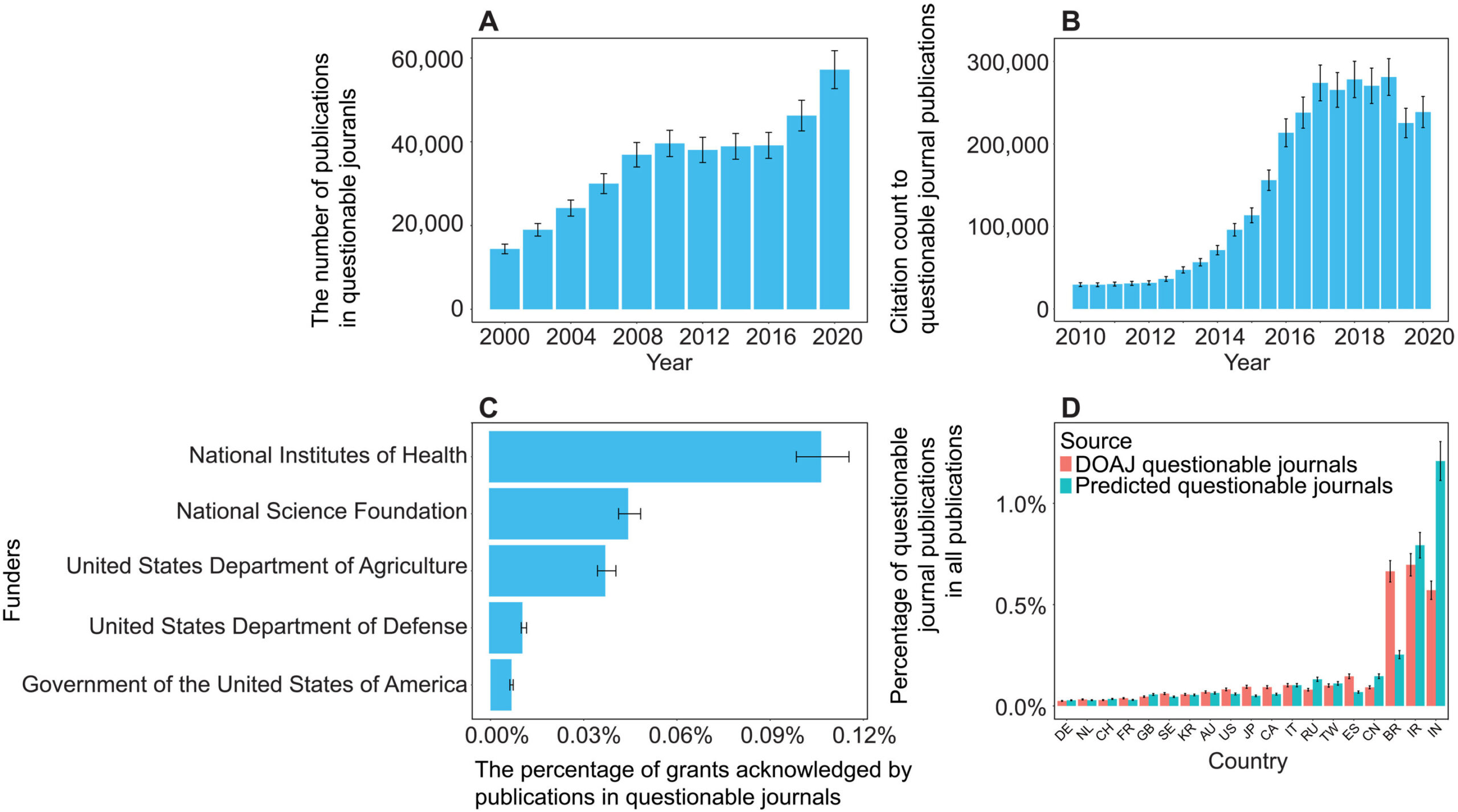

Souvent, ils ciblent des chercheurs en dehors des États-Unis et de l'Europe, comme en Chine, en Inde et en Iran – les pays où les institutions scientifiques peuvent être jeunes, et la pression et les incitations pour les chercheurs à publier sont élevés.

« Ils diront: » Si vous payez 500 $ ou 1 000 $, nous examinerons votre article « », a déclaré Acuña. « En réalité, ils ne fournissent aucun service. Ils prennent simplement le PDF et le publient sur leur site Web. »

Quelques groupes différents ont cherché à freiner la pratique. Parmi eux, une organisation à but non lucratif appelée The Directory of Open Access Journals (DOAJ). Depuis 2003, les bénévoles du DOAJ ont signalé des milliers de revues comme suspectes sur la base de six critères. (Les publications réputées, par exemple, ont tendance à inclure une description détaillée de leurs politiques d'examen par les pairs sur leurs sites Web.)

Mais suivre le rythme de la propagation de ces publications a été intimidant pour les humains.

Pour accélérer le processus, Acuña et ses collègues se sont tournés vers l'IA. L'équipe a formé son système à l'aide des données du DOAJ, puis a demandé à l'IA de passer au crible une liste de près de 15 200 revues à accès libre sur Internet.

Parmi ces revues, l'IA a initialement signalé plus de 1 400 comme potentiellement problématiques.

Acuña et ses collègues ont demandé aux experts humains de passer en revue un sous-ensemble des revues suspectes. L'IA a commis des erreurs, selon les humains, signalant environ 350 publications comme discutables lorsqu'ils étaient probablement légitimes. Cela a encore laissé plus de 1 000 revues que les chercheurs ont identifiées comme discutables.

« Je pense que cela devrait être utilisé comme assistant pour préscreen un grand nombre de revues », a-t-il déclaré. « Mais les professionnels humains devraient faire l'analyse finale. »

Acuña a ajouté que les chercheurs ne voulaient pas que leur système soit une « boîte noire » comme certaines autres plates-formes d'IA.

« Avec Chatgpt, par exemple, vous ne comprenez souvent pas pourquoi cela suggère quelque chose », a déclaré Acuña. « Nous avons essayé de rendre la nôtre aussi interprétable que possible. »

L'équipe a découvert, par exemple, que des revues douteuses ont publié un nombre inhabituellement élevé d'articles. Ils ont également inclus des auteurs avec un plus grand nombre d'affiliations que des revues plus légitimes et des auteurs qui ont cité leurs propres recherches, plutôt que la recherche d'autres scientifiques, à un niveau inhabituellement élevé.

Le nouveau système d'IA n'est pas accessible au public, mais les chercheurs espèrent le mettre à la disposition des universités et des sociétés d'édition bientôt. Acuña considère l'outil comme un moyen pour les chercheurs de protéger leurs domaines contre les mauvaises données – ce qu'il appelle un «pare-feu pour la science».

« En tant qu'informaticien, je donne souvent l'exemple de quand un nouveau smartphone sort », a-t-il déclaré. « Nous savons que le logiciel du téléphone aura des défauts, et nous nous attendons à ce que les corrections de bogues viennent à l'avenir. Nous devrions probablement faire de même avec la science. »