Nos conversations avec Claude étaient intouchables. Aujourd'hui, l'urgence des pressions de données pour en faire des matières premières de l'IA

Nous parlons généralement à l'intelligence artificielle comme si j'étais une personne de plus et parfois nous faisons confiance aux informations très personnelles. Cependant, nous nous arrêtons rarement pour réfléchir à ce qui arrive à ces conversations. Jusqu'à présent, la norme en bonne partie du secteur avait été de les utiliser pour former des modèles, à moins que l'utilisateur ne s'opposait. Anthropic représentait une exception: Claude avait une politique explicite de ne pas utiliser les conversations de ses clients privés à cette fin. Cette exception vient de rompre. La raison est directe et énergique: les données sont la matière première de l'IA.

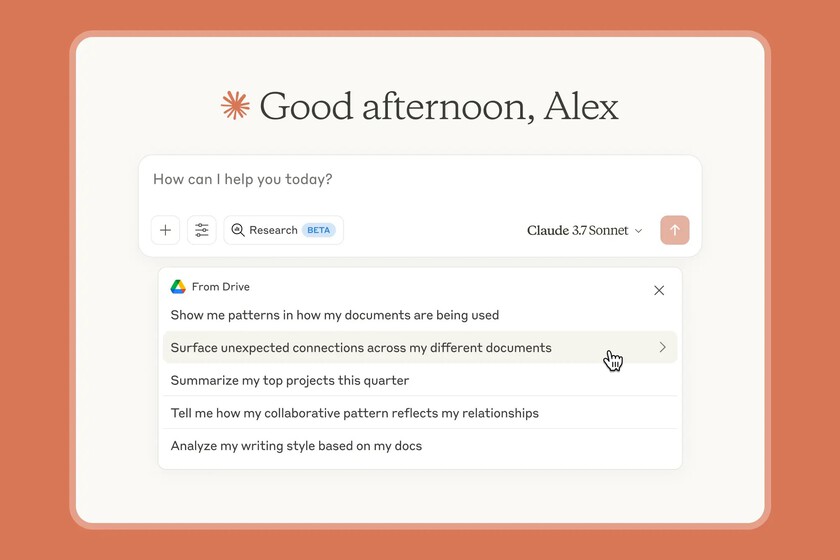

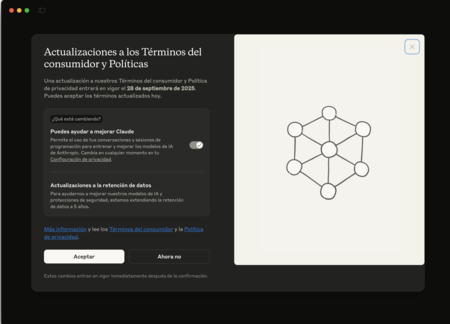

Anthropic vient d'annoncer dans son blog officiel une mise à jour de ses conditions de service pour les consommateurs et leur politique de confidentialité. Les utilisateurs des plans gratuits, pro et max, y compris les sessions dans Claude Code, doivent explicitement accepter ou rejeter que leurs conversations sont utilisées pour la formation de modèles futurs. La société a fixé la date limite jusqu'au 28 septembre 2025 et a averti qu'après cette date, il sera nécessaire de choisir la préférence pour continuer à utiliser Claude.

Le virage anthropique. La modification n'affecte pas tout le monde également: les services soumis à des termes commerciaux sont laissés de côté, tels que Claude pour le travail, Claude Gov, Claude for Education ou l'accès par API via des tiers tels que Amazon Bedrock ou Vertex AI de Google Cloud. Anthropic indique que la nouvelle configuration ne s'appliquera qu'aux chats et sessions de code initiées ou repris après avoir accepté les conditions, et que les anciennes conversations sans activité supplémentaire ne seront pas utilisées pour former des modèles. Il s'agit d'une distinction opérationnelle pertinente: le changement agit sur l'activité future.

Pourquoi ce changement? Anthropic souligne que tous les modèles de langue « s'entraînent en utilisant de grandes quantités de données » et que les interactions réelles offrent des signaux précieux pour améliorer les capacités telles que le raisonnement ou la correction du code. Dans le même temps, plusieurs spécialistes ont pointé vers un problème structurel: le site Web ouvert est épuisé comme une source d'informations fraîches et facilement accessibles, afin que les entreprises recherchent de nouvelles voies de données pour maintenir l'amélioration continue des modèles. Dans ce contexte, les conversations des utilisateurs acquièrent une valeur stratégique.

Bien que Anthropic met l'accent sur la sécurité (améliorer Claude et renforcer les garanties contre les utilisations nuisibles, telles que les escroqueries et les abus), la décision répond probablement également à la concurrence: Openai et Google restent des références sur le terrain et nécessitent de grands volumes d'interaction pour avancer. Sans suffisamment de données, les distances de la race de l'IA dont nous assistons en direct peuvent augmenter.

Cinq ans au lieu de trente jours. Avec un permis de formation, Anthropic a élargi la période de rétention pour les données partagées à des fins d'amélioration: cinq ans si l'utilisateur accepte de participer, par rapport aux 30 jours qui régissent si cette option n'est pas activée. La société précise également que les chats supprimés ne seront pas inclus dans la formation future et que l'envoyé peut également être conservé. Il indique également qu'il combine des processus et des outils automatisés pour filtrer ou obscurcir les informations sensibles qui ne vendent pas de données utilisateur à des tiers.

Images | Claude | Capture d'écran

Dans Simseo | Microsoft préfère son propre 7 qu'un 10 d'Openai. Les 13 000 millions investis dans Openai ont juste du sens